一句话定义:OpenClaw不是ChatGPT的平替,而是你电脑里24小时待命的“数字员工”

2026年,人工智能领域正在经历一场深刻的范式转移:AI不再满足于“回答问题”,而是要“动手干活”。从Anthropic的Computer Use功能到OpenAI的Operator,各大模型厂商纷纷布局“可执行AI”。而在开源社区,一个名为OpenClaw的项目正以惊人的速度崛起——截至2026年3月,其GitHub Star量已突破28万,成为AI智能体领域当之无愧的“顶流”。

这个昵称为“小龙虾”的开源项目,究竟凭什么引爆技术圈?它和ChatGPT有什么区别?为什么开发者们疯狂“养虾”?本文将为你全面拆解OpenClaw的前世今生、核心定位与技术全景。

1.1 一句话讲清楚

OpenClaw是一个开源的、本地优先的AI智能体(Agent)框架,它可以运行在你自己的电脑或服务器上,通过WhatsApp、Telegram、飞书、钉钉等20多种消息渠道接收指令,然后代替你执行文件操作、浏览器自动化、代码运行、API调用等真实任务。

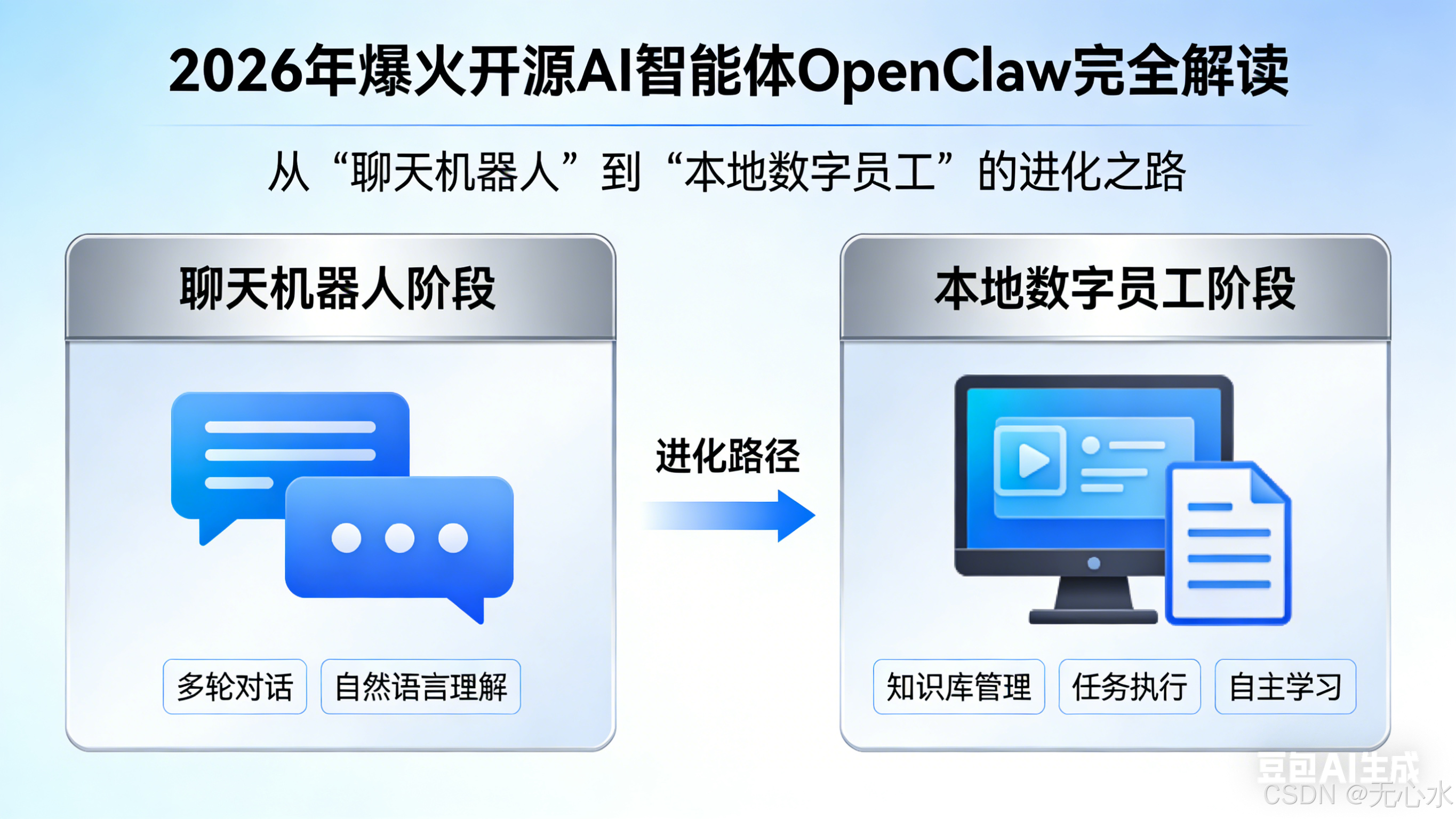

它不是ChatGPT那样的“对话工具”,而是一个能真正干活的执行框架。用创始人Peter Steinberger的话说,OpenClaw的愿景是 “the AI that actually does things”(真正做事的AI)。

1.2 它不是ChatGPT平替,是“本地私有化AI数字员工”

很多人第一次接触OpenClaw时会问:这不就是能调用工具版的ChatGPT吗?这个理解不够准确。我们通过对比表格看清本质差异:

最关键的区别在于:ChatGPT给你答案,OpenClaw帮你干活。比如你说“帮我整理本周下载文件夹里的文件,按类型分类”,ChatGPT只能告诉你“你可以打开文件夹,右键排序……”,而OpenClaw会真的扫描你的下载目录,创建分类子文件夹,把文件移动进去,然后告诉你整理结果。

1.3 对比传统自动化工具:n8n/Zapier/传统RPA

如果把OpenClaw放在自动化工具的坐标系中,它的定位也非常清晰:

选择建议:

- 选Zapier:想要快速上手、非技术背景、轻量级自动化

- 选n8n:需要复杂工作流、数据自托管、有开发支持

- 选OpenClaw:想探索AI智能体、自主执行、构建下一代自动化

OpenClaw的演进史,也是AI智能体从概念走向落地的缩影。

第一阶段:Clawdbot(2026年1月)

项目最初名为Clawdbot,由资深开发者Peter Steinberger(PSPDFKit创始人)启动。首版实现了基础的任务自动化功能,支持通过主流通讯软件接收指令并执行简单操作。这时的Clawdbot已经具备了“智能体”的雏形,但在模型兼容性和跨平台能力上仍有局限。

第二阶段:Moltbot(2026年1月27日)

由于商标合规问题,项目更名为Moltbot。这次更名不仅是为了合规,更重要的是强化了模型路由能力。Moltbot开始支持多模型切换,为后续的“模型无关设计”打下基础。

第三阶段:OpenClaw(2026年1月30日)

最终定名为OpenClaw,确立了开源技术路线和模块化架构。这次迭代解决了三个核心痛点:

- 隐私问题:数据不上云,所有记忆和配置存储在本地

~/.openclaw/目录 - 跨平台:支持macOS、Windows、Linux、甚至树莓派,统一调度

- 离线可用:配合Ollama等本地模型,可在无网络环境下运行

3.1 本地优先:数据不上云的技术实现逻辑

OpenClaw的“本地优先”不是营销话术,而是实打实的技术设计:

- 所有数据默认存储在本地:

~/.openclaw/目录下,包括配置文件、会话历史、记忆文件 - 记忆存为Markdown:MEMORY.md和memory/文件夹中的Markdown文件,人类可读可编辑,可用Git进行版本控制

- 无专有数据库:会话存储使用JSONL格式,每行一个JSON对象;向量检索基于SQLite + FTS5扩展实现

- 配置即代码:AGENTS.md、SOUL.md等文件直接定义AI的行为规则和人格设定

这种设计的优势显而易见:你完全掌控自己的数据,没有厂商锁定,没有云端泄露风险。对于处理敏感信息的企业用户或隐私意识强的个人用户,这是根本性的差异。

3.2 多模型兼容:GPT/Claude/Gemini/DeepSeek/Ollama适配原理

OpenClaw是“模型无关”的——它不绑定任何特定的大模型,而是通过统一适配层支持几乎所有主流LLM。

支持的模型列表(部分):

- OpenAI:GPT-4、GPT-5.4系列

- Anthropic:Claude 3⁄3.5⁄3.7系列

- Google:Gemini 1.5⁄2.0/3.1系列

- 国内:通义千问、文心一言、DeepSeek、MiniMax

- 本地:Ollama(Llama 3、Qwen等)

适配原理:OpenClaw使用provider/model格式标识模型,如openai/gpt-4o、anthropic/claude-sonnet-4-。如果省略provider,则使用默认配置。通过LiteLLM等适配层,OpenClaw将不同厂商的API差异封装起来,对上层提供统一调用接口。

最新动态:2026年3月发布的v2026.3.7版本,OpenClaw已首发适配GPT-5.4与Gemini Flash 3.1双引擎,推理速度提升30%,响应延迟低至100ms。

3.3 跨端控制:浏览器/手机/桌面应用的统一调度

OpenClaw的“跨端”体现在两个层面:

第一,多端接入:通过一个Gateway进程,同时连接20+消息渠道:

- 即时通讯:WhatsApp、Telegram、Signal、iMessage

- 团队协作:Slack、Discord、Microsoft Teams、飞书、钉钉

- 传统渠道:SMS(Twilio)、Email(SMTP)、IRC、Matrix

- 自建界面:Web控制台(默认18789端口)

无论你在手机WhatsApp上发指令,还是在公司Slack频道里@它,背后都是同一个OpenClaw实例在响应,共享相同的记忆和上下文。

第二,多端控制:OpenClaw不仅能操作宿主机(运行Gateway的电脑),还能通过Nodes(节点)控制其他设备:

- Android/iOS设备:通过配对作为节点,AI可以调用摄像头拍照、获取屏幕录制、读取定位

- 远程计算机:通过SSH执行命令,实现分布式任务执行

这意味着你可以:在手机上发一条消息,让OpenClaw控制办公室的电脑整理文件,再通过配对的手机摄像头拍下结果——所有操作通过一个统一的AI接口完成。

4.1 ClawHub:技能市场的爆发

随着OpenClaw的爆红,ClawHub成为开发者分享AI技能的中心市场。截至2026年2月,ClawHub已有超过6000个社区贡献的Skills,覆盖:

- 邮件管理:自动分类、智能回复、重要邮件提醒

- 数据分析:Excel处理、报表生成、趋势分析

- 代码部署:CI/CD集成、PR审查、环境配置

- 内容创作:SEO优化博客撰写、配图生成、多语言翻译

- 个人助理:日程安排、待办管理、天气提醒

4.2 社区贡献者生态

OpenClaw采用Apache 2.0协议,已形成包含378位贡献者的开发生态,核心贡献领域包括:

- 执行器插件开发(45%)

- 模型适配层优化(30%)

- 测试用例完善(25%)

社区中不仅有个人开发者,还涌现出智谱、月之暗面、MiniMax等大模型公司的身影——它们纷纷基于OpenClaw推出自己的定制版本,如AutoGLM-OpenClaw、Kimi Claw、MaxClaw等。

4.3 平台级集成

2026年3月,腾讯正式接入OpenClaw框架,用户仅需四步即可创建专属机器人,让AI从问答工具升级为能直接执行任务的数字助手。同期,360集团创始人周鸿祎宣布将发行OpenClaw一键安装版,进一步降低使用门槛。

基于OpenClaw的技术分层,我整理了一条适合普通开发者的学习路径:

第一阶段:使用者(1-2周)

- 目标:跑通OpenClaw,实现日常自动化

- 技能点:命令行基础、YAML配置、API Key申请

- 任务:本地部署、接入IM渠道、调用ClawHub现成Skill完成文件整理/定时任务

第二阶段:定制者(1-2个月)

- 目标:根据自身需求开发自定义Skill

- 技能点:TypeScript基础、Node.js模块、Prompt工程

- 任务:理解三文件系统(SOUL/AGENTS/MEMORY)、开发第一个文件统计Skill、发布到ClawHub

第三阶段:开发者(3个月+)

- 目标:参与核心开发,构建商业应用

- 技能点:源码理解、性能优化、安全加固

- 任务:阅读Gateway源码、贡献PR、基于OpenClaw构建垂直领域Agent解决方案

如果你正在准备AI Agent相关的技术面试,以下考点值得重点关注:

Q1:OpenClaw和ChatGPT的本质区别是什么?

核心答案:ChatGPT是对话工具,OpenClaw是执行框架。ChatGPT只能输出文本,OpenClaw可以调用工具、操作文件、发送消息——不仅能“说”,还能“做”。

Q2:OpenClaw的五大核心组件是什么?

标准回答:Gateway(网关)、Brain(大脑)、Memory(记忆)、Skills(技能)、Heartbeat(心跳)。

- Gateway:长期运行的WebSocket服务器,负责从各渠道路由消息

- Brain:核心推理引擎,运行ReAct循环,调用LLM解析意图

- Memory:基于Markdown的记忆系统,混合检索(向量+BM25)

- Skills:存储为Markdown文件的提示词模板,扩展AI能力

- Heartbeat:定时触发机制,让AI从“被动响应”变“主动执行”

Q3:OpenClaw为什么选择Markdown存记忆而不用数据库?

四点原因:

- 本地优先:无需额外基础设施,开箱即用

- 人类可读:可直接用编辑器查看和修改记忆内容

- 版本控制:可用Git管理记忆变更,追踪AI的“学习过程”

- 与Workspace天然融合:符合Agent工作目录的设计理念

Q4:Gateway崩溃如何保证消息不丢失?

技术实现:

- 任务通道队列:每个会话对应专属任务通道,消息先入队再处理

- 默认串行执行:避免竞态条件,只有显式声明的任务才并行

- 持久化存储:未处理完的消息会持久化到磁盘,重启后恢复

- 死信队列:处理失败的任务进入死信队列,支持重试机制

Q5:OpenClaw如何保证执行安全?

三层防护:

- 命令审批:危险命令(如

rm -rf、sudo)需用户单次/始终允许 - 沙箱隔离:默认在Docker容器中执行命令,限制系统访问

- 白名单机制:安全命令(如

grep、jq)预批准,其他需配置

从Clawdbot到OpenClaw,这个开源项目用不到三个月的时间,完成了从概念验证到28万Star的惊人跨越。它代表的不仅是一个技术框架的成熟,更是AI从“对话”到“执行”这一产业变革的缩影。

对于开发者而言,OpenClaw提供了一个绝佳的切入点:你可以用自己熟悉的Node.js/TypeScript技术栈,参与到AI智能体这个前沿领域。无论是作为个人效率工具的搭建者,还是企业自动化方案的构建者,OpenClaw都值得你投入时间深入学习。

正如项目愿景所言——“the AI that actually does things”。在2026年的今天,让AI真正“干活”的时代,已经到来。

下篇预告:在下一篇文章中,我们将详细拆解OpenClaw的四层架构,用一张图看懂消息从输入到执行的完整调用链。欢迎关注本专栏,一起“养虾”进阶!

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/257611.html