亲爱的朋友们,创作不容易,若对您有帮助的话,请点赞收藏加关注哦,您的关注是我持续创作的动力,谢谢大家!有问题请私信或联系邮箱:

2026 年的大模型市场已从“一家独大”演变为多强并立的格局:OpenAI、Anthropic、Google、Meta、阿里、DeepSeek、月之暗面……每家都声称自己是“最强”,每隔数月便有新旗舰发布。

然而对于工程师和产品团队而言,真正的问题从不是“哪个模型最强”,而是“哪个模型最适合我的场景、预算与合规要求”。本文跳出基准分数的游戏,从模型能力矩阵、API 接入方式、定价结构、典型场景匹配四个维度,系统梳理 2026 年大模型选型的完整决策框架。

2.1 闭源旗舰模型

模型 厂商 发布时间 上下文窗口 核心优势 定价(输入/输出,每百万 Token)

GPT-4.1 OpenAI 2026 Q1 1M 工具调用、代码、指令遵循

\(2 / \)8

o3 / o4-mini OpenAI 2025–2026 200K 数学推理、复杂逻辑、慢思考

\(10 / \)40(o3)

Claude Opus 4.6 Anthropic 2025 200K 长文档、写作、对齐安全

\(15 / \)75

Claude Sonnet 4.6 Anthropic 2025 200K 性价比、编程、日常任务

\(3 / \)15

Gemini 2.5 Pro Google 2025 1M 多模态、长上下文、Google 生态

\(1.25 / \)10

Gemini 2.5 Flash Google 2025 1M 极速、低成本、高并发

\(0.15 / \)0.6

Grok-3 xAI 2025 131K 实时联网、X 平台数据

\(3 / \)15

2.2 开源 / 可私有化模型

模型 厂商 参数量 上下文 核心优势 许可证

LLaMA 3.3 70B Meta 70B 128K 综合能力强,社区最活跃 Llama License

DeepSeek-V3 DeepSeek 671B(MoE) 128K 低成本 SOTA,中英双优 MIT

DeepSeek-R1 DeepSeek 671B(MoE) 128K 推理与数学,媲美 o1 MIT

Qwen2.5 72B 阿里云 72B 128K 中文最强开源,代码/数学专项 Qianwen License

Mistral Large 2 Mistral 123B 128K 欧洲合规,多语言,函数调用 Mistral Research

Phi-4 Microsoft 14B 16K 小模型高性能,边缘部署 MIT

不同模型在不同能力维度上差异显著,选型前需明确核心诉求:

能力维度 第一梯队 第二梯队 注意事项

复杂逻辑 / 数学推理 o3、DeepSeek-R1 Gemini 2.5 Pro 慢思考模型延迟高,不适合实时场景

代码生成与调试 Claude Sonnet 4.6、GPT-4.1 DeepSeek-V3 需结合实际技术栈测试

长文档理解(>100K) Gemini 2.5 Pro、Claude Opus GPT-4.1(1M) 超长上下文成本急剧上升

中文语言质量 Qwen2.5、DeepSeek-V3 Claude Sonnet 本土化数据覆盖决定质量

多模态(图文) Gemini 2.5 Pro、GPT-4.1 Claude Opus 图像理解复杂度差异大

函数调用 / Tool Use GPT-4.1、Claude Sonnet Mistral Large 2 JSON Schema 格式支持差异需测试

实时联网搜索 Grok-3、Perplexity Gemini 2.5 信息时效性要求高时必选

私有化部署 DeepSeek-V3、LLaMA 3.3 Qwen2.5 需评估硬件成本

低延迟高并发 Gemini 2.5 Flash、Groq+LLaMA Claude Haiku Groq 芯片加速可达亚秒响应

4.1 主要接入渠道对比

渠道类型 代表平台 优势 适用场景

官方 API OpenAI、Anthropic、Google AI 功能最全、更新最快 对特定模型有强依赖

云厂商托管 AWS Bedrock、Google Vertex、Azure OpenAI 合规、SLA、企业账单 企业级、金融/政府合规

聚合平台 OpenRouter、Together AI、Groq 统一接口、多模型切换 多模型对比、成本优化

本地部署 Ollama、vLLM、LM Studio 数据不出境、无 API 费用 隐私敏感、高并发私有化

国内中转 火山引擎、百度千帆、阿里云百炼 国内合规、低延迟 国内 C 端产品

4.2 统一接口标准

几乎所有主流平台均兼容 OpenAI Chat Completions API 格式,这意味着切换模型只需修改 base_url 和 api_key,业务代码无需重写:

平台 Base URL 示例 兼容格式

OpenAI

https://api.openai.com/v1 原生

Anthropic

https://api.anthropic.com/v1 自有格式 + OpenAI 兼容层

Ollama 本地

http://localhost:11434/v1 OpenAI 兼容

Groq

https://api.groq.com/openai/v1 OpenAI 兼容

OpenRouter

https://openrouter.ai/api/v1 OpenAI 兼容

火山引擎

https://ark.cn-beijing.volces.com/api/v3 OpenAI 兼容

5.1 Token 成本速查(每百万 Token,2026 Q1)

模型 输入 输出 缓存命中 适合场景

Gemini 2.5 Flash

\(0.15 \)0.60 — 高并发、对话、分类

Claude Haiku 4.5

\(0.80 \)4

\(0.08 轻量任务、实时响应

GPT-4.1 Mini \)0.40

\(1.60 — 日常助手、低成本推理

Claude Sonnet 4.6 \)3

\(15 \)0.30 编程、分析、产品开发

GPT-4.1

\(2 \)8

\(0.50 通用旗舰、工具调用

Gemini 2.5 Pro \)1.25

\(10 — 长上下文、多模态

Claude Opus 4.6 \)15

\(75 \)1.50 高价值复杂任务

o3

\(10 \)40 — 数学/科学推理

DeepSeek-V3(API)

\(0.27 \)1.10

\(0.07 极致性价比,中英双强

5.2 实际成本估算框架

场景 典型 Token 消耗 / 次 月调用量 推荐模型 月成本估算

AI 客服对话 500 输入 + 200 输出 100 万次 Gemini Flash ~\)270

代码 Review 2000 输入 + 800 输出 10 万次 Claude Sonnet

$720

长文档摘要(50K) 50K 输入 + 1K 输出 1 万次 Gemini 2.5 Pro

\(725

数学题批量求解 500 输入 + 2K 输出 5 万次 DeepSeek-R1 / o3-mini ~\)200

根据核心诉求选择模型:

核心诉求 首选 备选 排除

成本极致压缩 DeepSeek-V3 / Gemini Flash Qwen2.5 API o3、Opus

最强推理/数学 o3 / DeepSeek-R1 Gemini 2.5 Pro 普通 Chat 模型

中文内容生成 Qwen2.5 72B / DeepSeek-V3 Claude Sonnet 纯英文训练模型

私有化/合规 DeepSeek-V3(开源)/ LLaMA 3.3 Qwen2.5 闭源 API 模型

多模态图文理解 Gemini 2.5 Pro / GPT-4.1 Claude Opus 纯文本模型

实时低延迟(<1s) Groq + LLaMA / Gemini Flash Claude Haiku o3、Opus

企业合规(金融/政府) Azure OpenAI / AWS Bedrock 本地部署 直连境外 API

Agent 工具调用 GPT-4.1 / Claude Sonnet Gemini 2.5 Pro 不支持 Function Call 的模型

对于数据不出境场景,本地部署是必选路径:

工具 定位 支持模型 推荐场景

Ollama 一键本地运行 LLM LLaMA、Qwen、DeepSeek、Phi 开发调试、个人使用

vLLM 高性能推理引擎 主流 HuggingFace 模型 生产级高并发推理

LM Studio GUI 桌面工具 GGUF 格式模型 非技术用户本地体验

llama.cpp CPU/GPU 混合推理 GGUF 量化模型 低显存设备、边缘部署

TGI(HF) Text Generation Inference 大多数 HF 模型 企业级 API 服务化

私有化部署的显存需求参考:

模型规模 INT4 量化 INT8 量化 BF16

7B ~5 GB ~8 GB ~14 GB

13B ~9 GB ~14 GB ~26 GB

70B ~35 GB ~70 GB ~140 GB

维度 核心要点

选型原则 场景先行:明确推理/生成/多模态/合规需求,再匹配模型

成本控制 分层调用:简单任务用 Flash/Haiku,复杂任务升级旗舰

中文场景 Qwen2.5 / DeepSeek-V3 在中文质量上显著优于纯英文旗舰

合规路径 国内 C 端→国内云托管;政企敏感数据→私有化部署

避免锁定 用 OpenAI 兼容接口 + 模型路由层,随时切换 Provider

推理场景 慢思考模型(o3/R1)不适合实时场景,需异步处理架构配合

大模型选型没有“万能答案”,只有与业务场景高度匹配的最优解。随着模型迭代加速,保持技术路线的灵活性——选择兼容多 Provider 的调用方式——才是最经得起时间检验的工程决策。

参考资料:

- OpenAI API Pricing — platform.openai.com/pricing

- Anthropic API Pricing — anthropic.com/pricing

- Google AI Gemini Pricing — ai.google.dev/pricing

- DeepSeek API 文档 — platform.deepseek.com

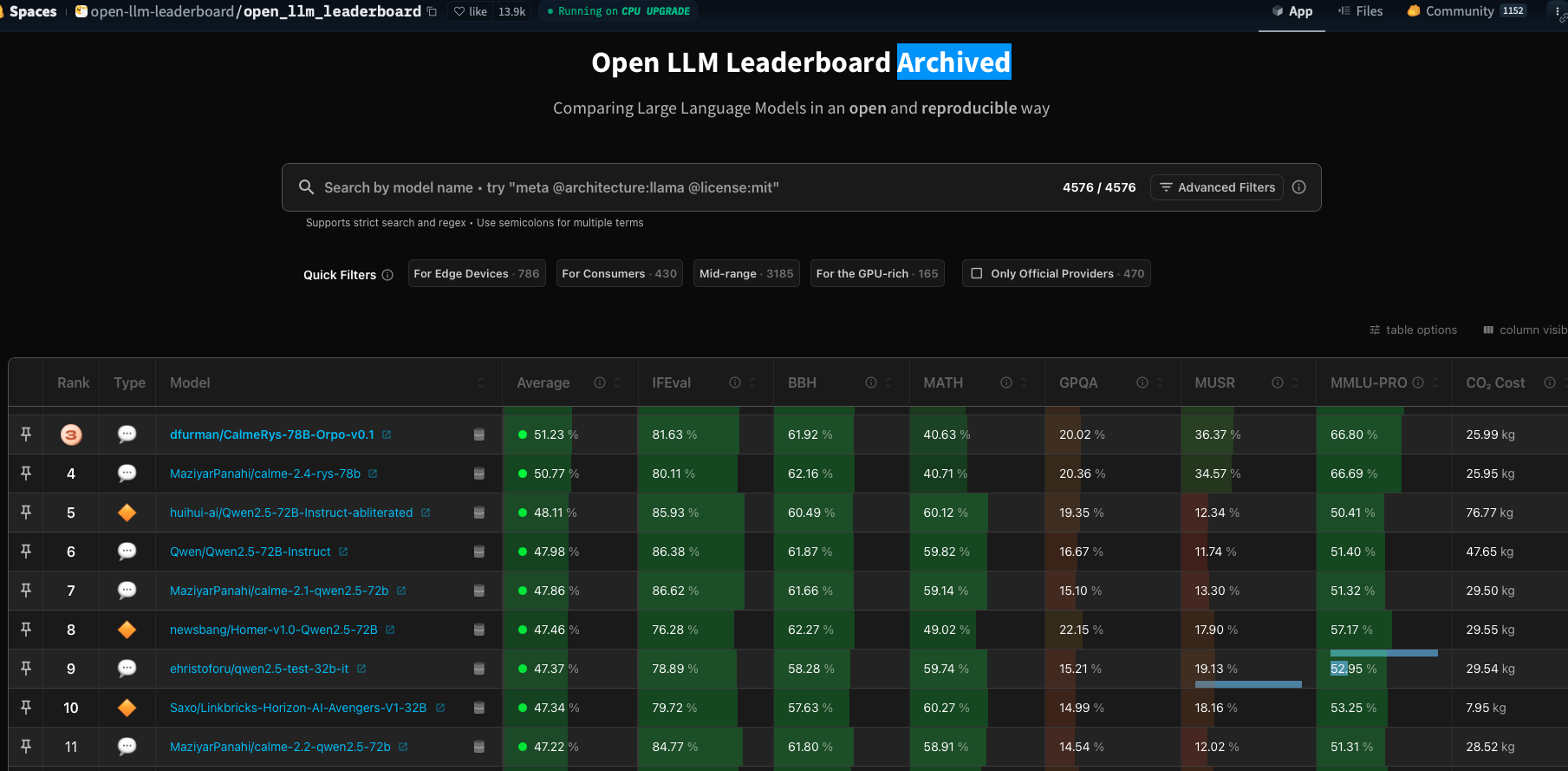

- Hugging Face Open LLM Leaderboard — huggingface.co/spaces/open-llm-leaderboard

- vLLM 官方文档 — docs.vllm.ai

- Ollama 官方网站 — ollama.com

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/256348.html