2026 年 4 月 7 日,一张截图在 AI 圈悄悄流传:SWE-bench Pro 全球排行榜的第一名,变成了一个中文名字——GLM-5.1。

发布它的公司叫 Z.ai,也就是曾经的智谱 AI。

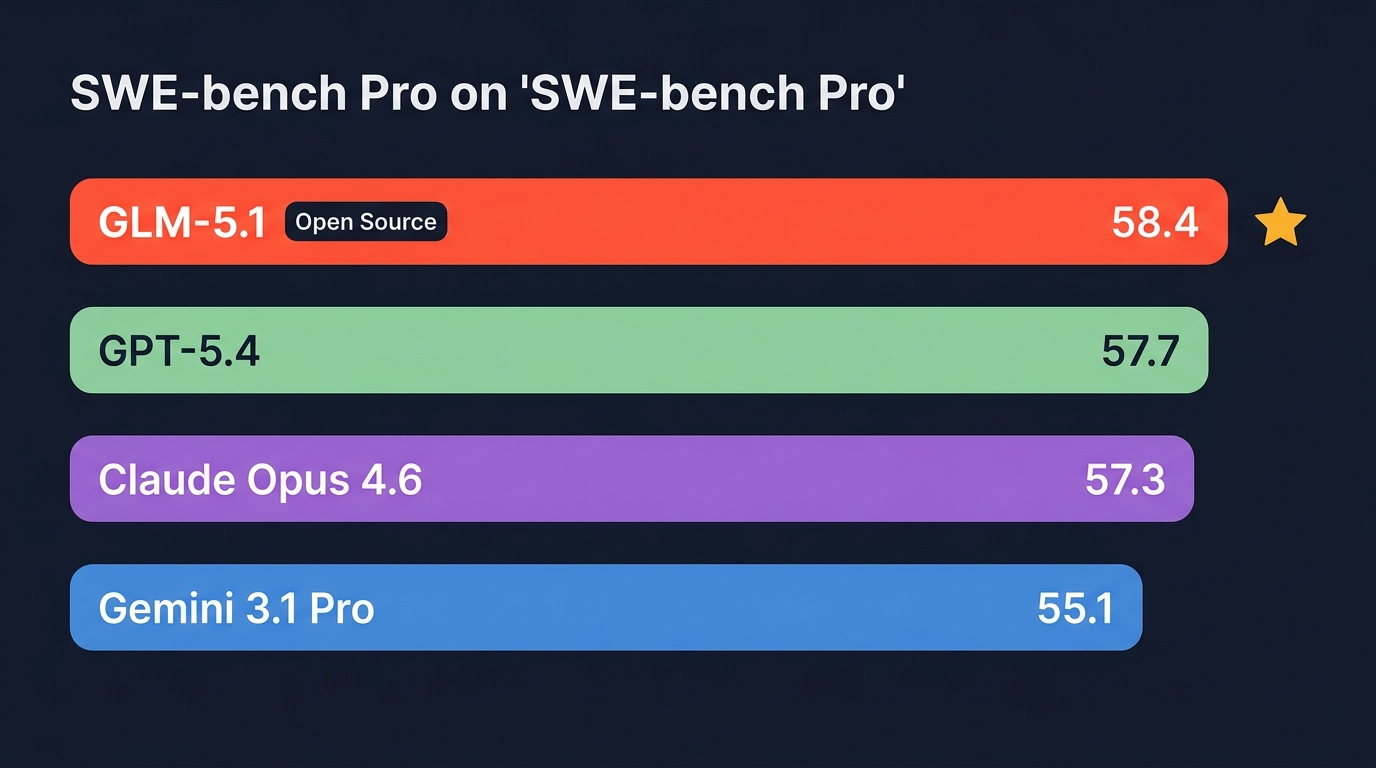

得分 58.4,超过 Claude Opus 4.6 的 57.3,超过 GPT-5.4 的 57.7,超过 Gemini 3.1 Pro 的 55.1。开源,免费,MIT 协议。

这是中国大模型第一次在软件工程最重要的基准测试上登顶全球。但在你转发庆祝之前,有一些细节值得认真看。

SWE-bench 是目前公认的软件工程能力最权威的评测标准之一,由普林斯顿大学研究团队设计。它的逻辑很简单:给模型一个真实 GitHub 仓库的 Bug 报告,让它自动修复,然后用原始测试套件验证是否真的修好了。

没有选择题,没有简答题——只看能不能真的修 Bug。

SWE-bench Pro 是进阶版,题目难度更高,来自更复杂的生产级代码库。能在这里得高分,意味着模型不只是会"写看起来像代码的东西",而是真正能理解代码意图、定位问题根源、生成可运行的修复。

这为什么重要?因为这正是开发者每天在做的事情。

在这一项测试上,GLM-5.1 是全球第一。而且它是完全开源的——代码、权重、训练细节全部开放,MIT 协议,可商用。

这意味着任何人都可以在自己的服务器上运行一个"超越 Claude Opus 4.6 的代码模型",成本几乎为零。

SWE-bench Pro 只是代码能力的一个维度。

如果把测试范围扩大到代码综合能力榜单(结合 Terminal-Bench 2.0 和 NL2Repo),排名就变了:

Claude 在综合评估中仍然领先。GLM-5.1 在 Bug 修复这个单项上是第一,但在需要跨文件理解、长上下文操作、自然语言转代码等综合场景下,差距依然存在。

这不是说 GLM-5.1 的胜利是假的——但"国产模型全面超越 Claude"的说法也过于夸大。更准确的描述是:在特定的、最接近真实开发场景的任务上,开源中国模型已经可以与世界最强的闭源模型掰手腕。

GLM-5.1 还有一个特性值得单独说——它支持持续 8 小时的自主执行任务。

它可以独立完成一个完整的"实验—分析—优化"循环:写代码、跑测试、看结果、调整参数、再跑测试……不需要人在旁边盯着。

目前大多数模型的 Agent 能力在遇到复杂任务时很快就会"迷路",或者在上下文过长后开始犯低级错误。GLM-5.1 的 8 小时自主运行,如果数据真实可靠,代表着一种质的提升——AI 开始能够独立完成工程师要花一整个工作日才能完成的任务。

这里有一个值得思考的问题:GLM-5.1 在 SWE-bench Pro 上击败了所有闭源对手,然后选择把模型开源。为什么?

可以从几个角度理解:

1. 开源是竞争策略,不是慈善。 Llama 系列让 Meta 拿到了大量外部开发者为其生态做贡献;智谱开源 GLM-5.1,同样是在建立护城河——让更多人用、更多人贡献、更多公司围绕这个模型构建服务。

2. 商业化走另一条路。 GLM-5.1 提供 API 付费访问,开源模型权重本身并不是收入来源,而是获客手段。这和 Anthropic、OpenAI 的商业逻辑完全不同。

3. 对 Anthropic 和 OpenAI 的压制。 当一个开源免费的模型能在关键指标上达到顶尖闭源模型的水平,付费使用 Claude 的理由就少了一个。

两年前,业界的普遍认知是:国产开源模型能达到 GPT-3.5 的水平就不错了,到达 GPT-4 级别还要等。

现在,2026 年 4 月,一个国产开源模型在软件工程基准上拿到了全球第一。

这个速度,超出了几乎所有人的预期。

但这也提出了新的问题:SWE-bench Pro 代表的是"修复给定 Bug"的能力——这是相对标准化、可量化的任务。真实的软件工程还包括需求理解、架构设计、跨团队协作……这些能力的评测,还没有统一标准。

国产模型赢了这场比赛,但整个赛道还很长。

如果你感兴趣,GLM-5.1 已经开源在 Hugging Face,MIT 协议。

几个实际的使用路径:

- 本地部署:有 GPU 的开发者可以直接下载运行,对比 Claude Code 在你自己的项目上的表现

- API 调用:Z.ai 和第三方 API 平台(如 APIYI)已经提供 GLM-5.1 的 API,价格低于 Claude

- 基准测试复现:SWE-bench 是开源的,可以用自己的代码库来测试看看差距在哪

最重要的是:不要只看排行榜,在你自己的任务上测一测才算数。

GLM-5.1 登顶 SWE-bench Pro,是一个真实的里程碑。不是宣传稿,不是水分,是同行评审的基准测试。

但它不是"国产 AI 全面超越 OpenAI 和 Anthropic"的证明——在综合能力、长上下文、多模态等维度上,差距依然存在。

这场比赛的节奏,比任何人预期的都快。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/255324.html