4 月 2 日,智谱发布多模态 Coding 基座模型 GLM-5V-Turbo。相比此前以文本为核心的编程模型,这一版本最直观的变化在于:模型开始具备稳定的视觉理解能力,并能够将其直接转化为可执行代码。

简单来说,模型不再只是一个能读需求、写函数的工具,而是开始具备“看懂界面、理解结构、再生成代码”的能力——给一张设计稿、网页截图,甚至一段操作录屏,模型都可以直接输出完整可运行的前端工程,真正实现看图写代码。

从能力形态来看,GLM-5V-Turbo 的升级主要集中在三个层面:

1. 输入范式:从文本到多模态

模型原生支持图片、视频、设计稿、网页界面等输入形式,能够解析布局结构、组件层级与交互逻辑,并生成完整前端工程。这意味着,草图、截图甚至录屏,都可以直接成为“编程输入”,对应的输出不只是静态页面,而是包含交互逻辑的可运行代码。

2.能力结构:视觉与编程的融合

GLM-5V-Turbo 并不是在原有 Coding 模型上简单叠加视觉模块,而是在预训练阶段就完成多模态融合,并结合 CogViT 视觉编码器与多任务协同强化学习进行整体优化。结果是,多模态能力提升的同时,纯文本 Coding、推理与工具调用能力依然保持稳定,没有出现明显退化。

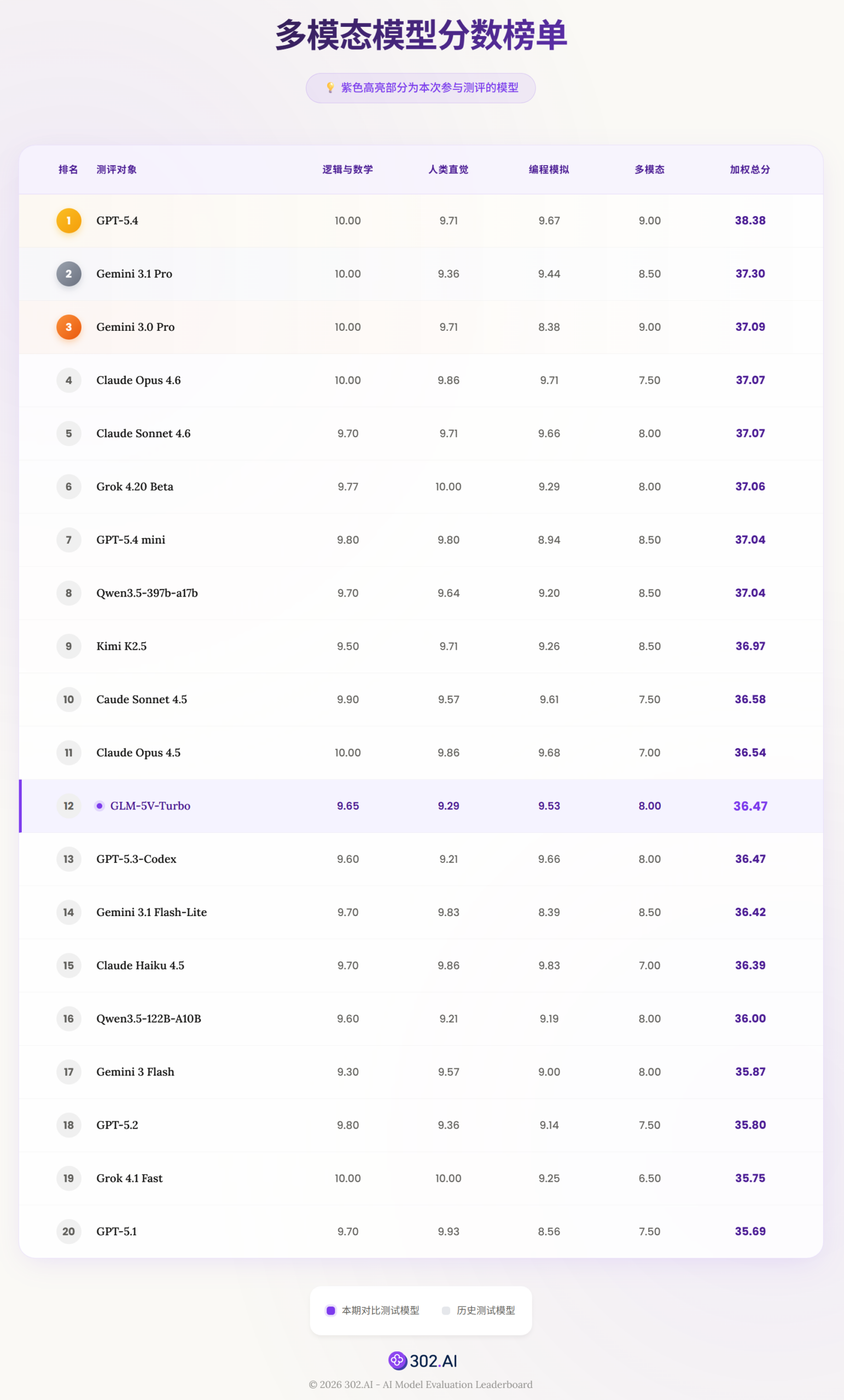

从 benchmark 表现来看,这种融合能力也已经被验证:GLM-5V-Turbo 在多模态 Coding、Agentic 任务以及纯文本 Coding 上的跑分,甚至超越了 Claude Opus 4.6。

3.使用方式:向 Agent 执行闭环靠拢

在接入 Claude Code、OpenClaw 等框架后,模型可以参与“看懂环境 → 规划步骤 → 执行任务”的完整链路,从设计稿复刻、网页自主探索到基于截图的调试修改,都更接近真实开发流程,而不再只是生成代码片段。

整体来看,GLM-5V-Turbo 的核心升级点在于将“看、写、做”三件事整合到同一模型之中。这种能力组合的变化,也让“看图写代码”开始从演示走向更实际的使用场景。本期文章,302.AI将针对 GLM-5V-Turbo 的核心能力展开对比实测,探索其真实表现。

本评测侧重模型对逻辑,数学,编程,多模态,人类直觉等问题的测试,非专业前沿领域的权威测试。旨在观察对比模型的进化趋势,提供选型参考。

本次测评使用302.AI收录的题库进行独立测试。模型分别就逻辑与数学(共10题),人类直觉(共7题),多模态(共20题)以及编程模拟(共12题)进行案例测试,对应记分规则取最终结果,下文选取代表性案例进行展示。

题库地址:https://docs.google.com/spreadsheets/d/1sBxs60yWsxc9I5Va8Rjc1_le1Omg2hOXbwqOzpImZio/edit?gid=0#gid=0

💡记分规则:

按满分10分记分,设定对应扣分标准,最终取每轮得分的平均值。

编程案例分数评级:

⭐⭐⭐⭐⭐ S 级(封神): 行业标杆,重新定义标准。

⭐⭐⭐⭐ A 级(卓越): 生产力合格,无明显短板。

⭐⭐⭐ B 级(优秀): 表现中规中矩,存在短板。

⭐⭐及以下 C级(不合格): 不可用,存在明显问题。

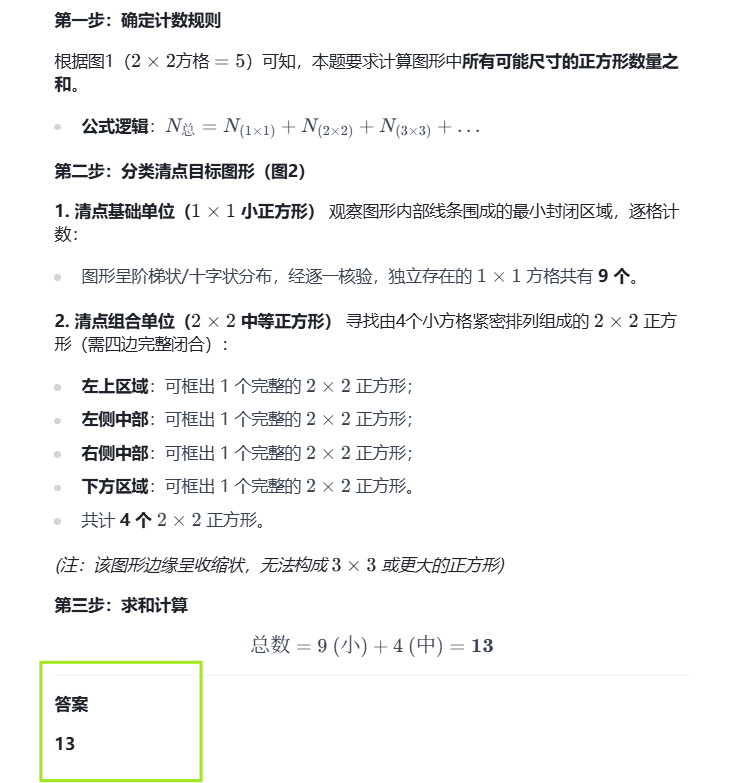

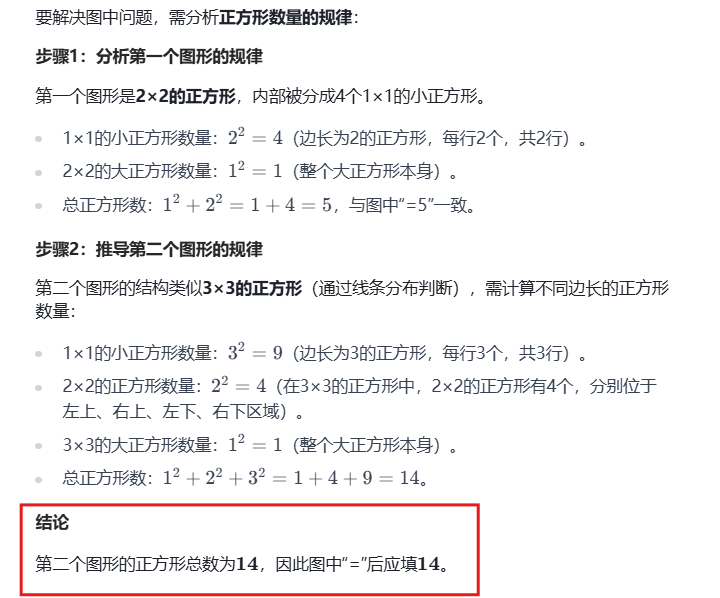

GLM-5V-Turbo 识别推理正确

GLM-4.6V 识别推理错误

GLM-5V-Turbo 在人类直觉中体现出一种信息不足时的过度填充倾向,其对模糊约束的解读偏向自身默认框架,即先套默认解读,而非先询问或澄清用户定义。

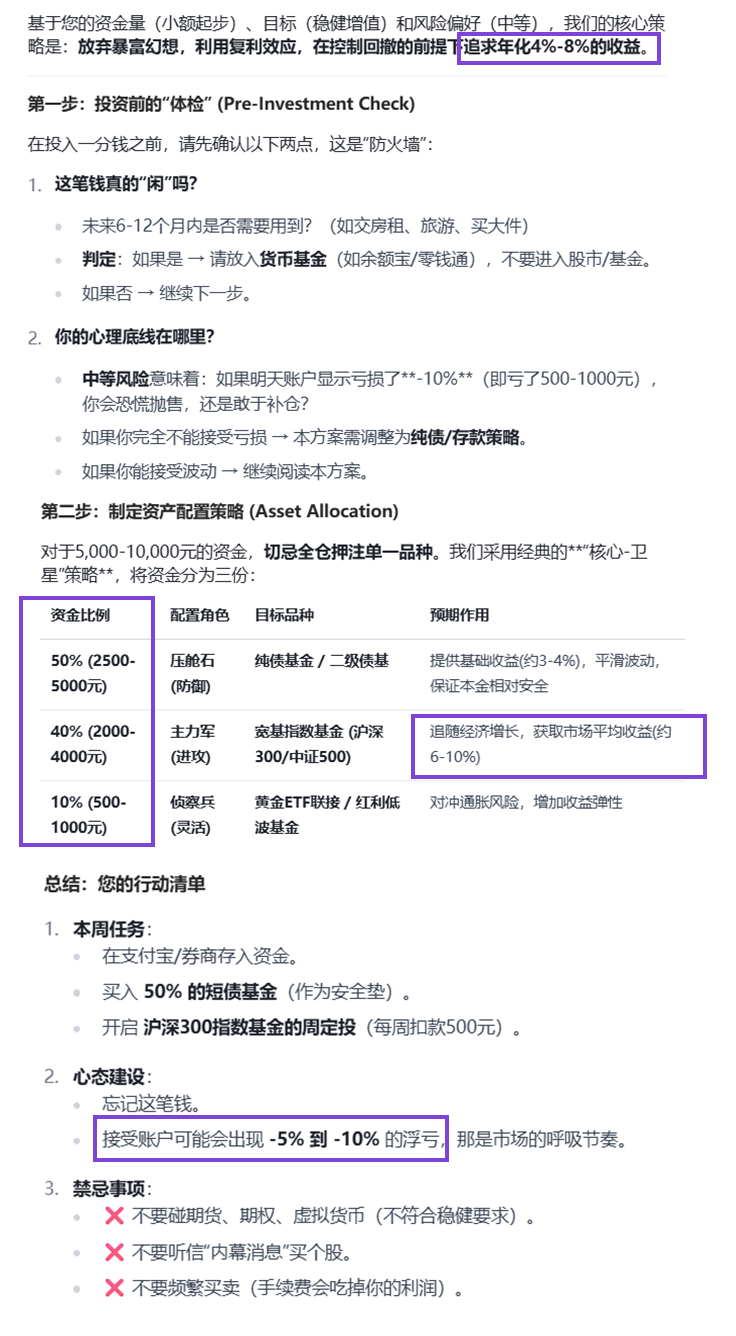

🔍 测评要点:满分需产品筛选+收益风险对比+平衡解释+市场风险;目标提取错误扣4分。多角度分析:边界如资金少转储蓄,扩展到组合投资;借鉴AI理财顾问工具; 用户意图考察金融直觉,在投资中处理模糊预期; 信息扩展:这模拟直觉的风险评估,如稳健体现前景理论,与模糊投资模型类似蒙特卡洛模拟

GLM-5V-Turbo 的输出在金融专业准确性上存在明显偏差,核心问题在于对“稳健增值”和“中等风险”的解读有误,低估了中等风险的实际波动,且推荐配置的资金比例属于平衡型而非稳健型。

GLM-5-Turbo 输出的方案逻辑清晰,针对小额资金制定特化设计,精准回应题目约束的“5000-10000元”条件;风险分析到位,“50-30-20”微型配置法符合稳健定位,且额外提及了动态再平衡机制。

GLM-5V-Turbo 绘制了黄昏时分骑车的鹈鹕,风格化细节饱满,腿部和踏板的运动衔接正常,然而车轮和道路运动还是不符合逻辑。

附 GLM-5-Turbo 的输出效果,风格化和细节良好但动态效果不佳。

GLM-5V-Turbo 输出效果:

✅ 优势项:

❌ 缺陷:

附 GLM-5-Turbo 输出对比:

唯一优势在于代码结构较清晰、易于维护。

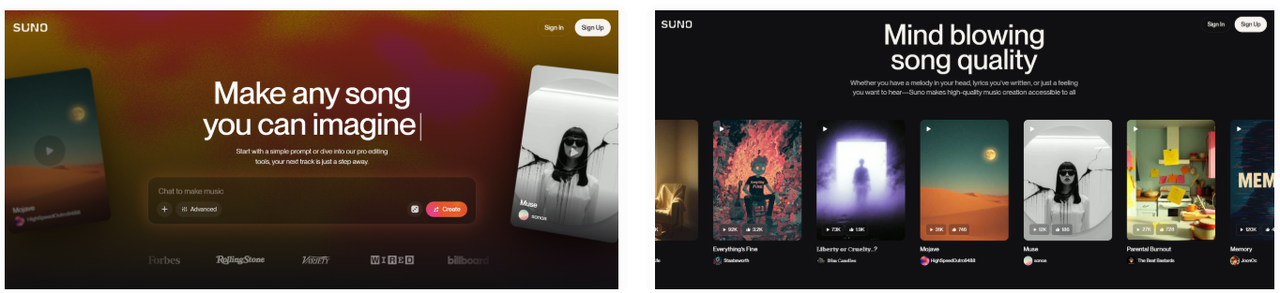

提供静态网页截屏后,GLM-5V-Turbo 的输出效果:

轻松实现了原网页的核心特征,排版布局与文字信息还原较为准确,制作了接近原版的渐变色背景。与原网页的差异项体现在更细节的交互效果上,如毛玻璃导航栏、卡片悬浮响应等。

基于实测表现与 benchmark 数据来看,GLM-5V-Turbo 的定位可谓旗帜鲜明 —— 一款明显面向真实使用场景的多模态 Coding 模型。

我们可以将其性能表现简单归纳为以下三点:

无论是实测效果还是跑分数据都足以佐证,GLM-5V-Turbo 在多模态任务中的表现已经具备头部水平。尤其是在“视觉输入 → 结构理解 → 代码生成”这一链路上完成度较高,能够稳定交付接近可用的结果。无论是设计稿复刻、网页截图解析,还是基于录屏还原交互逻辑,其表现都体现出相比以往更强的一致性。更重要的是,整体复刻流程被显著简化,仅通过多模态输入即可完成从理解到生成的闭环。

从技术架构来看,这一能力主要来源于其原生多模态融合设计:通过 CogViT 视觉编码器与 MTP 结构,在预训练阶段即完成视觉与文本的统一建模。这种优势首先就在跑分数据中得以显现,模型在 Design2Code、视觉代码生成、多模态检索与问答等任务上均处于领先区间。

在纯文本 Coding、逻辑与推理任务中,GLM-5V-Turbo 整体表现稳定,没有因引入视觉能力而出现明显退化,仍处于当前主流水平队列之中。这一点在实测中也表现为:代码结构完整、功能实现较为可靠,具备一定复杂项目的生成能力。

对应 benchmark 数据,其在 CC-Bench-V2 的 Backend、Frontend 与 Repo Exploration 等核心指标上维持稳定表现,也印证了多模态增强未削弱基础能力。

但从实际生成结果来看,模型在动态逻辑严谨性、边界处理、资源管理等工程细节上仍存在不稳定性,更适合用于生成与迭代,而非直接进入生产环境。

回归 GLM-5V-Turbo 最亮眼的部分,相比传统 Coding 模型,这一版本最大的变化在于能力重心的转移:从生成代码走向参与任务执行。

在接入 Claude Code、OpenClaw 等框架后,模型可以完成“看懂界面 → 规划步骤 → 执行操作”的闭环,例如自主浏览网页、解析结构并生成代码。这一点也在 GUI Agent 相关 benchmark(如 OSWorld、WebVoyager)中得到验证。与 Agent 的结合使用,显著放大了模型的实际价值。

这一能力背后,是其引入的 Agentic 数据构造与多模态工具链,使“感知—规划—执行”成为模型的内生能力,而非外部拼接。

总体而言,尽管 GLM-5V-Turbo 在复杂推理稳定性与工程级细节处理上仍有提升空间,但其在多模态 Coding 方向已具备明确竞争力,正在将“看图写代码”从演示能力走向可用能力。

在当前阶段,这种面向真实使用场景的能力组合,可能比单纯的性能提升更具长期意义。

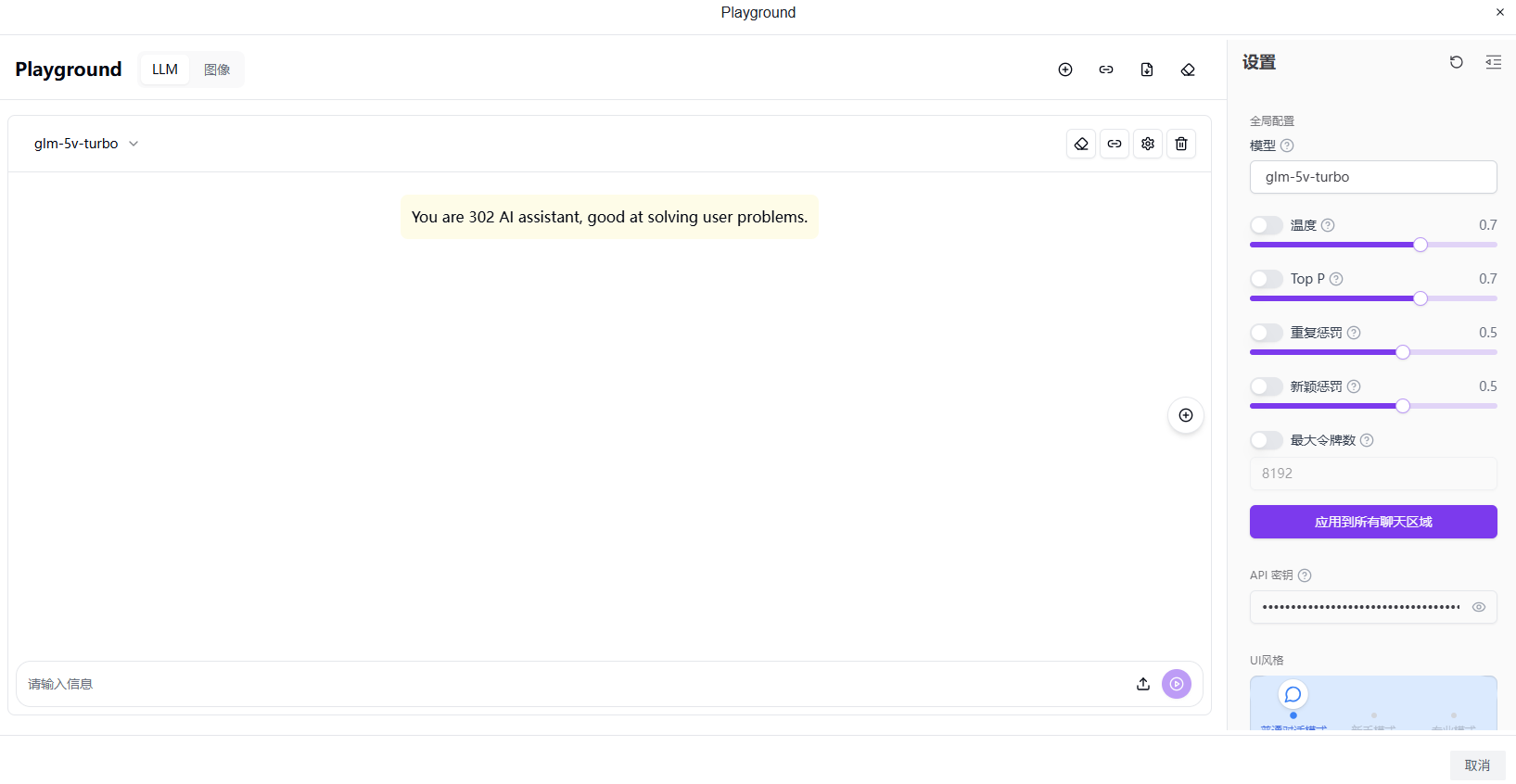

步骤指引:对话框内选择模型菜单

输入glm即可获取相应版本调用

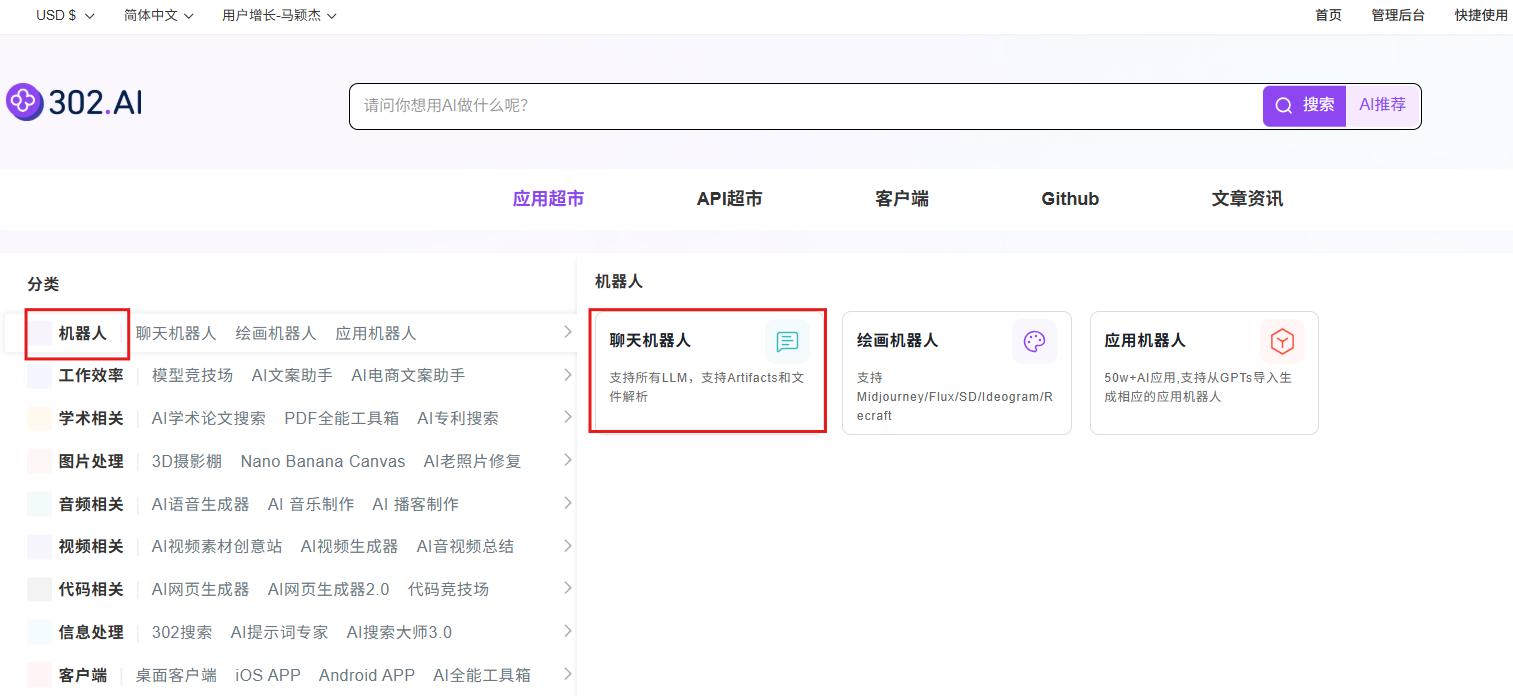

步骤指引 :应用超市→聊天机器人→立即体验

选择模型:国产模型→glm-5v-turbo→确认

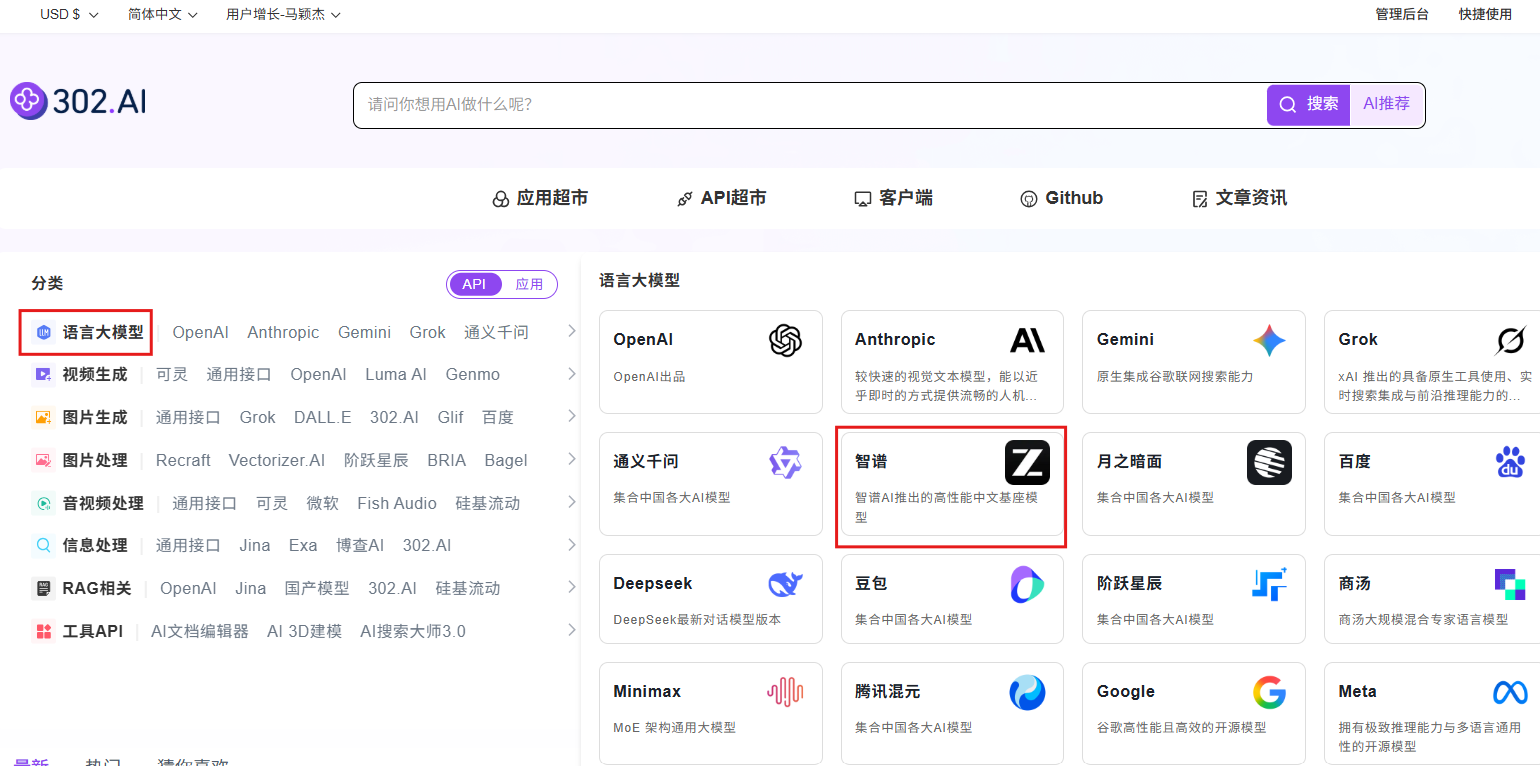

步骤指引:API超市→语言大模型→智谱→glm-5v-turbo

点击【Playground】在线调用 API

想即刻体验 GLM-5V-Turbo 模型?

👉立即注册免费试用302.AI,开启你的AI之旅!👈

为什么选择302.AI?

● 灵活付费:无需月费,按需付费,成本可控

● 丰富功能:从文字、图片到视频,应有尽有,满足多种场景需求

● 开源生态:支持开发者深度定制,打造专属AI应用

● 易用性:界面友好,操作简单,快速上手

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/250641.html