本文深入探讨了多模态大模型的核心原理,介绍了其定义、主流架构方案(单编码器、双编码器、统一编码器)以及典型架构Vision-LLM。详细解析了视觉编码器选择、投影层设计、训练策略(三阶段训练)、损失函数等关键组件,并总结了图像分辨率、视觉token数量、训练稳定性等常见踩坑点。最后,通过搭建一个简单的VQA模型实战,展示了多模态大模型的应用。文章旨在帮助读者全面理解多模态大模型的工作原理,并提供实用的搭建和训练建议。

从GPT-4V到Gemini,多模态大模型正在重新定义AI的能力边界。今天我们来手撕多模态架构的核心原理。

多模态大模型(Multimodal LLM)是指能够理解和生成多种模态信息(文本、图像、音频、视频)的大语言模型。

核心能力:

- 图像理解(Image Understanding)

- 图像生成(Image Generation)

- 视觉问答(Visual QA)

- 文档理解(Document Understanding)

2.1 架构对比

2.2 典型架构:Vision-LLM

import torchimport torch.nn as nnfrom transformers import CLIPVisionModel, LlamaForCausalLMclass VisionLLM(nn.Module): “”“视觉语言模型架构”“” def init(self, vision_model, llm, projection_dim=4096): super().init() self.vision_encoder = CLIPVisionModel.from_pretrained(vision_model) self.llm = LlamaForCausalLM.from_pretrained(llm) # 视觉-语言投影层 vision_dim = self.vision_encoder.config.hidden_size # 1024 llm_dim = self.llm.config.hidden_size # 4096 self.projection = nn.Sequential( nn.Linear(vision_dim, projection_dim), nn.GELU(), nn.Linear(projection_dim, llm_dim) ) def encode_image(self, pixel_values): “”“编码图像为视觉token”“” vision_outputs = self.vision_encoder(pixel_values) image_features = vision_outputs.last_hidden_state # [B, 257, 1024] return self.projection(image_features) # [B, 257, 4096] def forward(self, pixel_values, input_ids, attention_mask): # 编码图像 image_embeds = self.encode_image(pixel_values) # 获取文本embedding text_embeds = self.llm.get_input_embeddings()(input_ids) # 拼接 [图像token] + [文本token] inputs_embeds = torch.cat([image_embeds, text_embeds], dim=1) # 扩展attention mask image_mask = torch.ones(image_embeds.shape[:2], device=input_ids.device) extended_attention_mask = torch.cat([image_mask, attention_mask], dim=1) # LLM前向传播 outputs = self.llm( inputs_embeds=inputs_embeds, attention_mask=extended_attention_mask, return_dict=True ) return outputs# 使用示例model = VisionLLM(“openai/clip-vit-large-patch14”, “meta-llama/Llama-2-7b-hf”) 3.1 视觉编码器选择

# CLIP ViT-L/14(推荐)# 输入: 224x224 图像# 输出: 257个token(1个class token + 256个patch token)# 特征维度: 1024# 实测性能对比| 视觉编码器 | 参数量 | 分辨率 | 特征维度 | 推理速度 ||———–|——-|——–|———|———|| CLIP ViT-B/32 | 87M | 224 | 768 | 快 || CLIP ViT-L/14 | 304M | 224 | 1024 | 中 || SigLIP-SO400M | 400M | 384 | 1152 | 慢 | 3.2 投影层设计

方案一:线性投影(简单高效)

projection = nn.Linear(vision_dim, llm_dim) 方案二:MLP投影(效果更好)

projection = nn.Sequential( nn.Linear(vision_dim, llm_dim), nn.GELU(), nn.Linear(llm_dim, llm_dim)) 方案三:Q-Former(BLIP-2)

class QFormer(nn.Module): “”“可学习的查询向量提取视觉特征”“” def init(self, llm_dim, num_queries=32): super().init() self.queries = nn.Parameter(torch.randn(num_queries, llm_dim)) self.cross_attention = nn.CrossAttention(llm_dim) def forward(self, image_features): # queries作为Q,image_features作为K,V return self.cross_attention(self.queries, image_features, image_features) 4.1 三阶段训练

阶段1: 预训练(对齐视觉-语言)- 冻结视觉编码器和LLM- 只训练投影层- 数据: 图文对(Laion-400M)阶段2: 指令微调- 解冻LLM- 训练投影层 + LLM- 数据: 视觉指令数据(LLaVA-Instruct)阶段3: 任务微调- 全参数微调- 数据: 下游任务数据 4.2 损失函数

def compute_loss(model, batch): “”“计算多模态模型损失”“” pixel_values = batch[‘pixel_values’] # [B, 3, 224, 224] input_ids = batch[‘input_ids’] # [B, seq_len] labels = batch[‘labels’] # [B, seq_len] outputs = model(pixel_values, input_ids) logits = outputs.logits # 只计算文本部分的损失(跳过图像token) shift_logits = logits[:, :-1, :].contiguous() shift_labels = labels[:, 1:].contiguous() loss = F.cross_entropy( shift_logits.view(-1, shift_logits.size(-1)), shift_labels.view(-1), ignore_index=-100 ) return loss 5.1 图像分辨率问题

# 问题: CLIP固定224x224输入,高清图像信息丢失# 解决: 使用滑动窗口或自适应分辨率def process_high_res_image(image, max_size=224): if max(image.size) > max_size: # 滑动窗口提取多个patch patches = sliding_window_crop(image, crop_size=max_size) return torch.stack([preprocess(p) for p in patches]) return preprocess(image).unsqueeze(0) 5.2 视觉token数量过多

# 问题: 257个视觉token占用过多上下文# 解决: 使用Perceiver Resampler压缩class PerceiverResampler(nn.Module): def init(self, dim, num_latents=64): super().init() self.latents = nn.Parameter(torch.randn(num_latents, dim)) self.layers = nn.ModuleList([ nn.TransformerDecoderLayer(dim, nhead=8) for _ in range(4) ]) def forward(self, image_features): # 将257个token压缩为64个 x = self.latents.unsqueeze(0).expand(image_features.size(0), -1, -1) for layer in self.layers: x = layer(x, image_features) return x 5.3 训练不稳定

# 问题: 多模态训练容易出现梯度爆炸# 解决: 使用梯度裁剪 + warmupfrom transformers import get_linear_schedule_with_warmupoptimizer = torch.optim.AdamW(model.parameters(), lr=1e-5)scheduler = get_linear_schedule_with_warmup( optimizer, num_warmup_steps=100, num_training_steps=1000)# 梯度裁剪torch.nn.utils.clip_gradnorm(model.parameters(), max_norm=1.0) import torchfrom transformers import AutoProcessor, LlavaForConditionalGeneration# 加载预训练模型model = LlavaForConditionalGeneration.from_pretrained( “llava-hf/llava-1.5-7b-hf”, torch_dtype=torch.float16, device_map=“auto”)processor = AutoProcessor.from_pretrained(“llava-hf/llava-1.5-7b-hf”)def visual_qa(image, question): “”“视觉问答”“” prompt = f“USER: ![]() {question} ASSISTANT:” inputs = processor( text=prompt, images=image, return_tensors=“pt” ).to(model.device) output = model.generate( inputs, max_new_tokens=256, do_sample=True, temperature=0.7 ) return processor.decode(output[0], skip_special_tokens=True)# 使用示例from PIL import Imageimage = Image.open(“example.jpg”)answer = visual_qa(image, “图片中有什么?”)print(answer)

{question} ASSISTANT:” inputs = processor( text=prompt, images=image, return_tensors=“pt” ).to(model.device) output = model.generate( inputs, max_new_tokens=256, do_sample=True, temperature=0.7 ) return processor.decode(output[0], skip_special_tokens=True)# 使用示例from PIL import Imageimage = Image.open(“example.jpg”)answer = visual_qa(image, “图片中有什么?”)print(answer)

AI行业迎来前所未有的爆发式增长:从DeepSeek百万年薪招聘AI研究员,到百度、阿里、腾讯等大厂疯狂布局AI Agent,再到国家政策大力扶持数字经济和AI人才培养,所有信号都在告诉我们:AI的黄金十年,真的来了!

在行业火爆之下,AI人才争夺战也日趋白热化,其就业前景一片蓝海!

我给大家准备了一份全套的《AI大模型零基础入门+进阶学习资源包》,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。😝有需要的小伙伴,可以VX扫描下方二维码免费领取🆓

人才缺口巨大

人力资源社会保障部有关报告显示,据测算,当前,*我国人工智能人才缺口超过500万,*供求比例达1∶10。脉脉最新数据也显示:AI新发岗位量较去年初暴增29倍,超1000家AI企业释放7.2万+岗位……

单拿今年的秋招来说,各互联网大厂释放出来的招聘信息中,我们就能感受到AI浪潮,比如百度90%的技术岗都与AI相关!

就业薪资超高

在旺盛的市场需求下,AI岗位不仅招聘量大,薪资待遇更是“一骑绝尘”。企业为抢AI核心人才,薪资给的非常慷慨,过去一年,懂AI的人才普遍涨薪40%+!

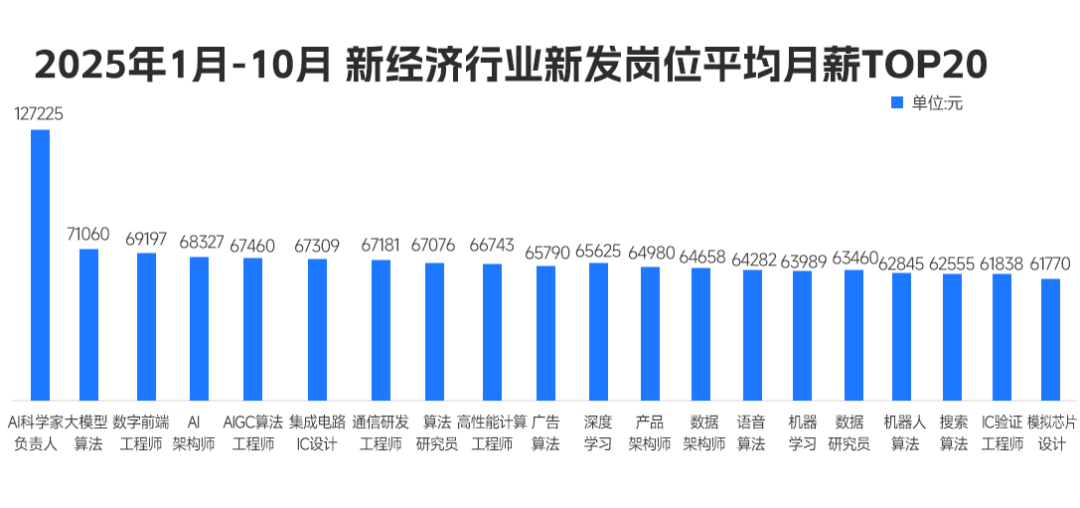

脉脉高聘发布的《2025年度人才迁徙报告》显示,在2025年1月-10月的高薪岗位Top20排行中,AI相关岗位占了绝大多数,并且平均薪资月薪都超过6w!

在去年的秋招中,小红书给算法相关岗位的薪资为50k起,字节开出228万元的超高年薪,据《2025年秋季校园招聘白皮书》,AI算法类平均年薪达36.9万,遥遥领先其他行业!

总结来说,当前人工智能岗位需求多,薪资高,前景好。在职场里,选对赛道就能赢在起跑线。抓住AI风口,轻松实现高薪就业!

但现实却是,仍有很多同学不知道如何抓住AI机遇,会遇到很多就业难题,比如:

❌ 技术过时:只会CRUD的开发者,在AI浪潮中沦为“职场裸奔者”;

❌ 薪资停滞:初级岗位内卷到白菜价,传统开发3年经验薪资涨幅不足15%;

❌ 转型无门:想学AI却找不到系统路径,83%自学党中途放弃。

他们的就业难题解决问题的关键在于:不仅要选对赛道,更要跟对老师!

我给大家准备了一份全套的《AI大模型零基础入门+进阶学习资源包》,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。😝有需要的小伙伴,可以VX扫描下方二维码免费领取🆓

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/250066.html