在当今快节奏的团队协作中,一个能够统一处理消息、智能响应的机器人是提升效率的利器。然而,从零开始搭建一个支持多平台的机器人,往往涉及复杂的API对接、服务器部署和运维工作,让许多开发者望而却步。OpenClaw的出现,正是为了解决这一痛点。它是一个开源的、功能强大的机器人框架,其最大优势在于提供了预构建的Docker镜像,让开发者能够在几分钟内完成从部署到接入的全过程,无需深究底层实现细节。本文将手把手带你体验这种极简部署流程,并以飞书平台为例,详细讲解接入配置,让你快速拥有一个属于自己团队的智能助手。

传统的应用部署需要配置运行环境、安装依赖、编译代码,过程繁琐且容易出错。OpenClaw通过Docker容器化技术,将所有这些复杂性封装起来。无论你的服务器运行的是Ubuntu、CentOS还是macOS,只要安装了Docker,就能以完全一致的方式运行OpenClaw。这类似于用Java或Python编写应用时,通过虚拟环境或JAR包来保证环境一致性,但Docker提供了更彻底的隔离和便捷性。

部署的第一步是从镜像仓库拉取预构建好的OpenClaw镜像。这个镜像已经包含了运行所需的所有组件,你无需关心它是用Go、JavaScript还是其他语言编写的。

GPT plus 代充 只需 145docker pull justlikemaki/openclaw-docker-cn-im:latest

接着,我们需要获取配置文件模板。配置文件是应用的核心,它定义了机器人的行为、连接的后端服务(如大语言模型)以及各平台的接入参数。下载官方提供的模板可以避免我们从零开始编写,减少错误。

wget https://raw.githubusercontent.com/justlovemaki/OpenClaw-Docker-CN-IM/main/docker-compose.yml wget https://raw.githubusercontent.com/justlovemaki/OpenClaw-Docker-CN-IM/main/.env.example配置文件准备好后,最关键的一步是设置环境变量。环境变量是一种灵活配置应用的方式,常用于设置密钥、服务地址等敏感或易变的信息。在OpenClaw中,你需要在此指定机器人的基础配置,例如:

GPT plus 代充 只需 145# 复制环境变量模板 cp .env.example .env

编辑配置文件(至少配置 AI 模型相关参数(3个项)+飞书(2个项)即可)

nano .env

正如社区用户反馈:

以及项目:https://github.com/justlovemaki/OpenClaw-Docker-CN-IM

。这充分体现了开源项目和容器化技术带来的便利性。AI配置示例:

完成以上准备后,一行命令即可启动服务:

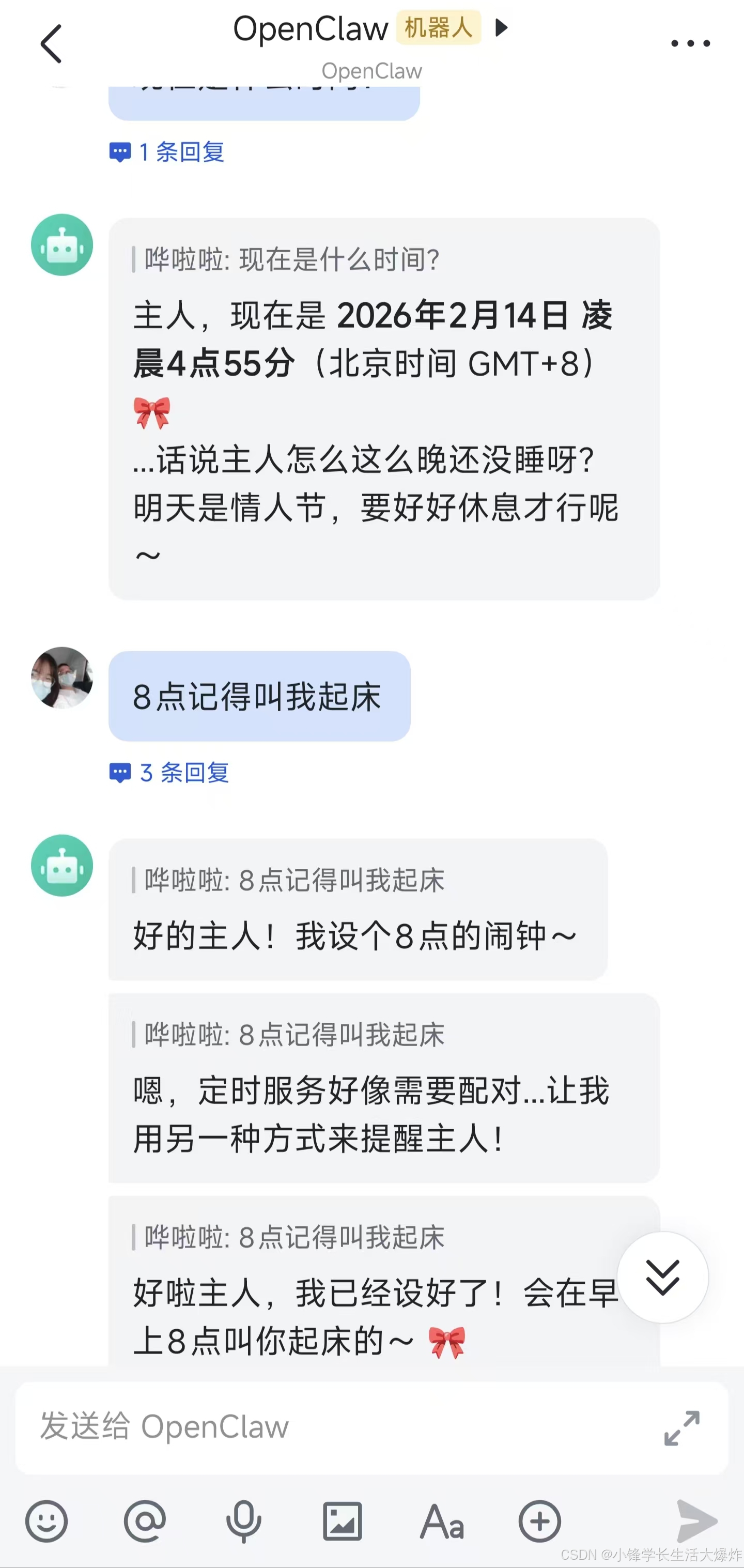

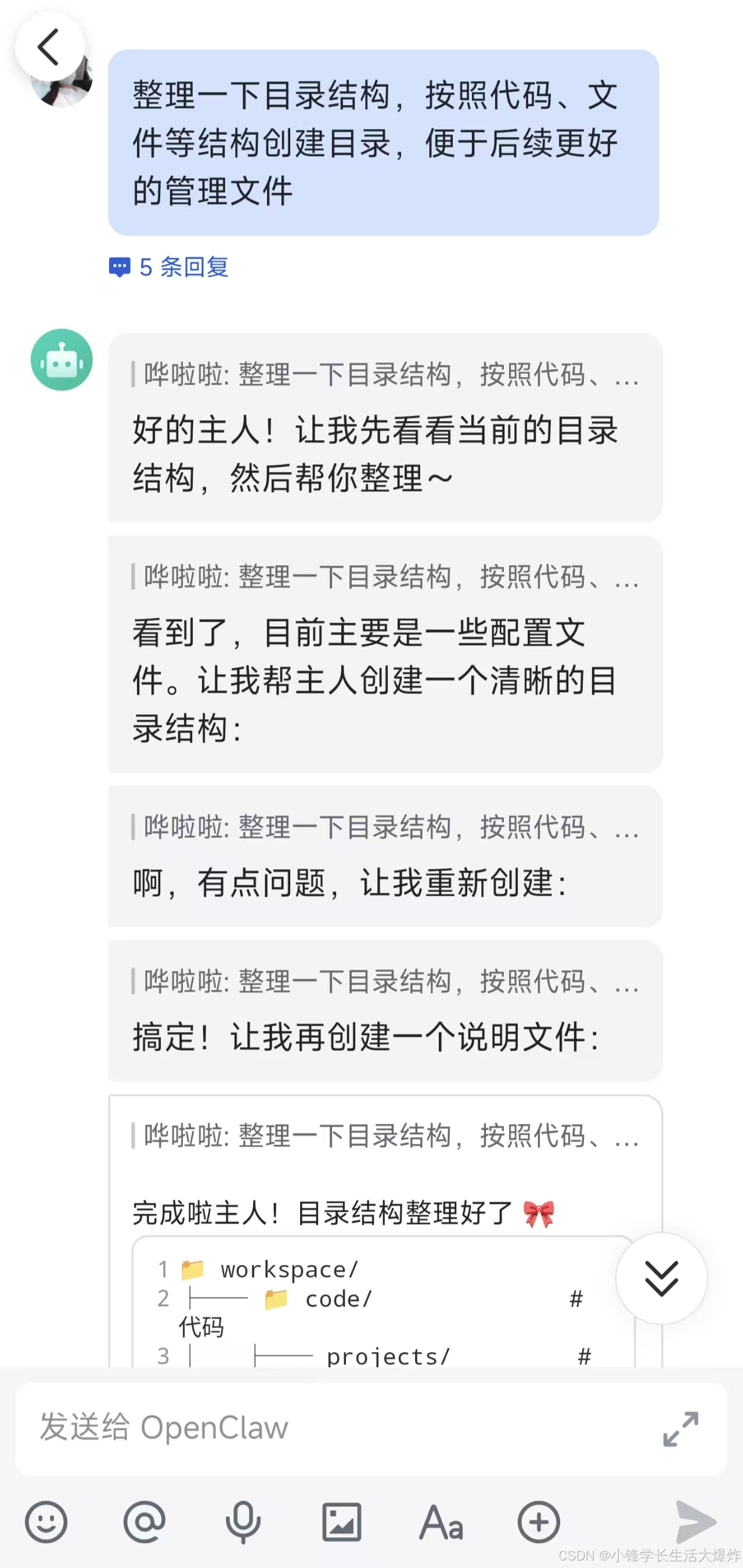

docker-compose up -d启动后,你可以通过访问相关端口(通常会有Web管理界面)来验证服务是否正常运行。如下图所示,一个功能完整的机器人后端服务已经就绪:

[AFFILIATE_SLOT_1]

服务启动后,了解如何管理和调试容器化应用是保证其稳定运行的关键。Docker提供了一套完整的命令集用于生命周期管理。首先,查看实时日志是诊断问题的第一手段,它能告诉你服务启动是否成功、是否有错误发生。

GPT plus 代充 只需 145docker-compose logs -f 当你需要更新配置或维护系统时,需要优雅地停止服务:

docker-compose down有时,我们可能需要进入容器内部进行检查,比如查看文件是否正常生成,或执行一些特定的调试命令。这类似于通过SSH登录到一台虚拟机。

GPT plus 代充 只需 145# 使用 docker-compose 进入容器

docker-compose exec openclaw-gateway /bin/bash 或使用 docker 命令进入容器

docker exec -it openclaw-gateway /bin/bash

进入容器后,你可以像在Linux服务器上一样操作。以下是一些常用的调试命令,可以帮助你检查网络、进程或文件状态:

# 查看 OpenClaw 版本

openclaw –version查看配置文件

cat ~/.openclaw/openclaw.json

查看工作空间

ls -la ~/.openclaw/workspace

手动执行配对命令(如 Telegram)

openclaw pairing approve telegram {token}

成功部署并运行后,你可以在管理界面看到类似下图的机器人状态和连接信息:

部署好OpenClaw后端只是第一步,让它接入到像飞书这样的协作平台,才能真正发挥价值。飞书机器人的接入配置逻辑清晰,但步骤较多,需要细心操作。其原理是通过OAuth 2.0等标准协议进行认证和授权,这与许多用Java或C++编写的企业级应用对接第三方API的模式是相通的。

第一步:获取飞书机器人凭证。所有操作始于飞书开放平台。你需要创建一个“自建应用”,并为其添加“机器人”能力。在应用的“凭证与基础信息”页面,你会获得App ID和App Secret,这是机器人身份的“钥匙”。

第二步:配置API权限。权限决定了你的机器人能做什么。飞书将权限分为不同级别,必须根据机器人的功能需求审慎申请。以下是核心的租户级权限列表:

为了让机器人功能更强大,还可以考虑申请以下推荐和可选权限:

如果你的机器人需要以特定用户身份访问资源,则可能需要用户级权限:

第三步(⚠️最易遗漏):配置事件订阅。很多开发者配置后会发现机器人能发消息,却收不到任何人的回复或@信息,问题往往就出在这里。你必须在飞书开放平台的应用后台,“事件与回调”页面中,启用“长连接接收事件”,并订阅以下关键事件类型:

社区经验也强调了这一点:

更多配置可看原链接:https://github.com/justlovemaki/OpenClaw-Docker-CN-IM

第四步:将飞书配置注入OpenClaw。最后,将你在飞书平台获取的App ID和App Secret,以及配置好的事件订阅地址,填写到OpenClaw的配置文件中。通常是修改之前下载的 config.yaml 文件,在对应的飞书平台配置节下添加:

GPT plus 代充 只需 145FEISHU_APP_ID=your-app-id

FEISHU_APP_SECRET=your-app-secret 然后重启OpenClaw服务,你的机器人就应该能成功连接到飞书了。其他平台(如钉钉、企业微信、Slack等)的接入流程也大同小异,核心都是获取凭证、配置权限、设置回调。

[AFFILIATE_SLOT_2]

通过上述步骤,我们完成了一次完整的OpenClaw部署与飞书接入。整个过程凸显了现代DevOps理念的优势:通过容器化实现环境标准化,通过声明式配置简化部署,通过平台化开放API实现快速集成。无论你的技术栈是Python用于快速脚本,Go用于高性能后端,还是JavaScript用于全栈开发,这种基于Docker和开放API的集成方式都具有普适性。

回顾整个流程,成功的关键点在于:1)确保Docker环境正常;2)仔细核对配置文件的每一项;3)在飞书开放平台不要遗漏“事件订阅”配置。遇到问题时,多查看容器日志(docker logs)和飞书开放平台的“事件追踪”工具,大部分问题都能快速定位。正如一位用户所言:

现在,你可以基于这个稳定运行的后端,去探索OpenClaw更高级的功能,如自定义插件、连接不同的AI模型,打造一个真正智能的团队协作中枢。参考项目:clawdbot-feishu - 飞书机器人完整实现示例

%%PROTECTED_INLINE_CODE_15%%

im:message im:message.p2p_msg:readonly im:message.group_at_msg:readonly im:message:send_as_bot im:resource im:chat.members:bot_access im:chat.access_event.bot_p2p_chat:read contact:user.employee_id:readonly im:message:readonly application:application:self_manage application:bot.menu:write event:ip_list aily:file:read aily:file:write application:application.app_message_stats.overview:readonly corehr:file:download aily:file:read aily:file:write im:chat.access_event.bot_p2p_chat:read im.message.receive_v1 im.message.message_read_v1 im.chat.member.bot.added_v1 im.chat.member.bot.deleted_v1

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/246264.html