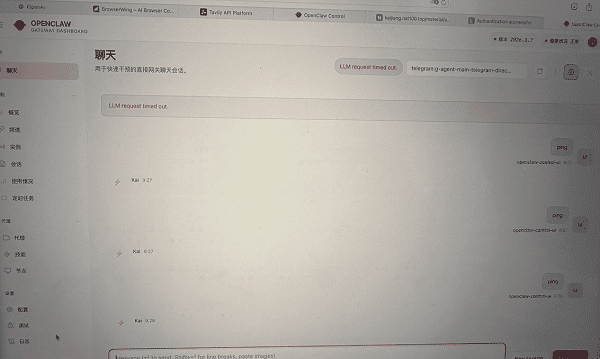

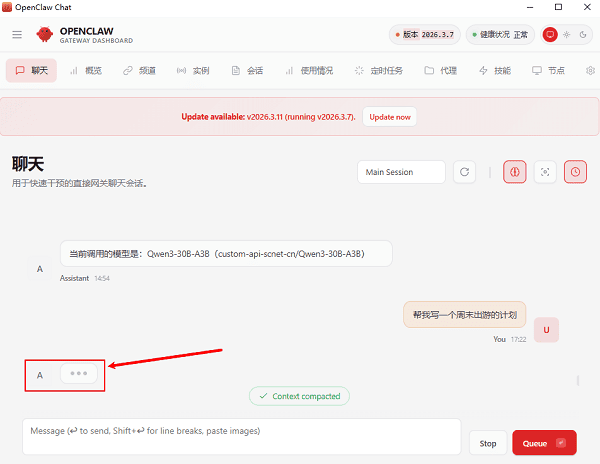

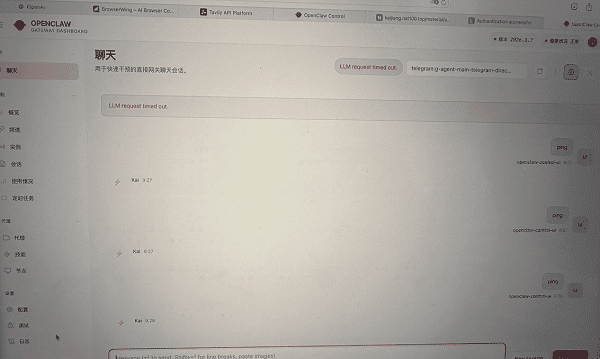

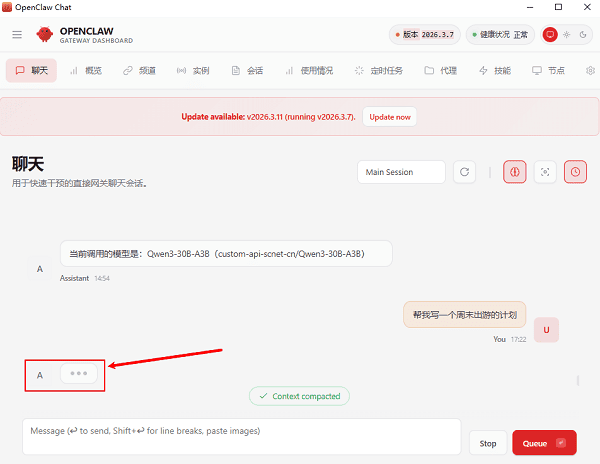

在本地部署或使用OpenClaw接入大模型时,不少人都会遇到这样一个报错:LLM request timed out。看起来像是系统“卡死”,其实本质很简单——请求已经发出,但模型在规定时间内没有返回结果,系统直接判定为超时。下面就帮你把常见原因和对应解决思路一次讲清楚。

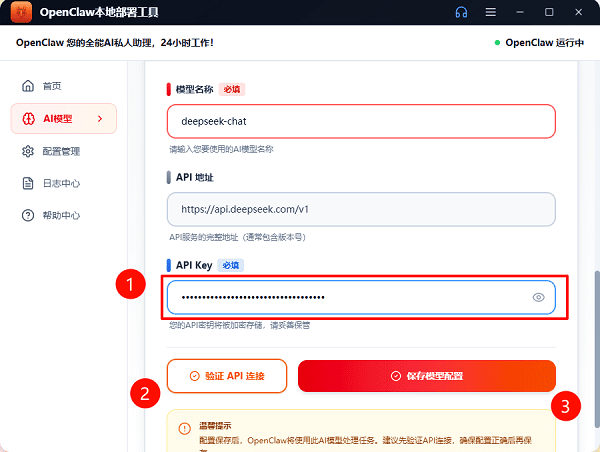

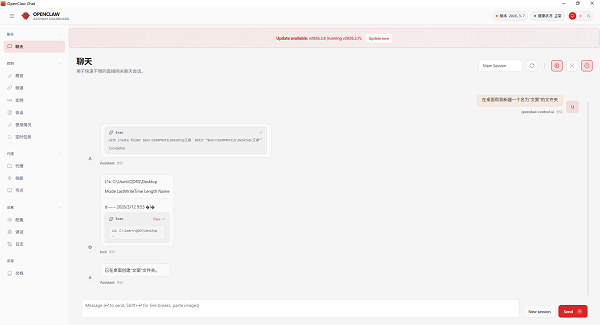

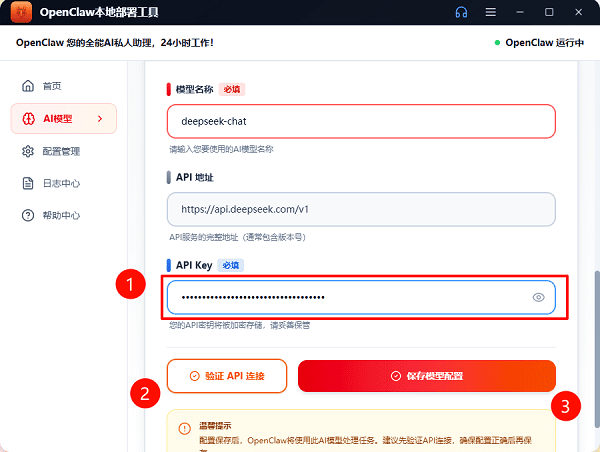

OpenClaw报错LLM request timed out怎么解决?超全解决方案在本地部署或使用 OpenClaw 接入大模型时 不少人都会遇到这样一个报错 LLM request timed out 看起来像是系统 卡死 其实本质很简单 请求已经发出 但模型在规定时间内没有返回结果 系统直接判定为超时 下面就帮你把常见原因和对应解决思路一次讲清楚 1 模型响应时间过长 大模型推理本身就需要时间 如果任务复杂 上下文过长或者涉及多轮调用 很容易超过默认等待时间 2

在本地部署或使用OpenClaw接入大模型时,不少人都会遇到这样一个报错:LLM request timed out。看起来像是系统“卡死”,其实本质很简单——请求已经发出,但模型在规定时间内没有返回结果,系统直接判定为超时。下面就帮你把常见原因和对应解决思路一次讲清楚。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/245098.html