2026年初,一个名为OpenClaw的开源AI智能体框架以惊人的速度席卷全球开发者社区。短短4个月内,GitHub星标数从0飙升至26万,超越了深耕十余年的React和诞生三十余年的Linux,创下了GitHub历史上增长最快的非聚合类软件项目纪录。这一现象级增长背后,反映了一个深刻的产业趋势:AI技术正从"被动对话"向"主动执行"的历史性跨越。

OpenClaw的核心理念是"让AI真正拥有双手"——不仅能够理解自然语言指令,更能直接操作系统资源、执行复杂任务、管理日常工作流。与传统聊天机器人(如ChatGPT、Claude)相比,OpenClaw实现了从"交互层"到"执行层"的技术突破,为用户提供了一个真正能够"替人打工"的数字员工。

本文将深入OpenClaw源码内部,系统拆解其核心模块架构与关键技术实现,重点分析插件体系设计、技能调度机制、模型集成管理等核心技术点,为开发者提供从原理到实践的深度指导。

OpenClaw采用了独特的"网关-节点-渠道"三层解耦架构设计,这种分层思想是其工程优雅性的核心体现。整个系统以Gateway(网关)为中央协调器,作为长期运行的守护进程,负责管理所有消息通道的连接和路由。

1.1 架构分层解析

Gateway网关层:系统的"神经中枢",基于Node.js v22+构建的常驻后台进程,监听在127.0.0.1:18789端口。它负责连接各类渠道、路由消息、管理设备,是整个系统的核心枢纽。网关内部采用WebSocket全双工通信,支持req/res/event三种消息类型,并通过TypeBox Schema进行严格的数据校验。

Agent智能体层:系统的"大脑",负责思考、决策和任务执行。OpenClaw采用了创新的Lobster智能体循环模式,包含四个核心步骤:思考(Think)、执行(Act)、观察(Observe)、反馈(Reflect)。这种设计体现了"感知-规划-决策-执行-反馈-学习"的闭环智能体逻辑。

Channels渠道层:支持超过20种通信平台的接入,包括WhatsApp、Telegram、Discord、飞书、微信、钉钉等主流工具。每个渠道都有对应的适配器,将不同平台的消息格式统一为内部标准格式。

1.2 设计哲学:本地优先与模型无关

OpenClaw坚持两大核心设计哲学:

本地优先(Local-First):所有运算和数据都优先在本地设备上完成,仅在必要时调用云端服务。这种设计带来了多重优势:

- 数据隐私:用户数据完全自主控制,无需上传第三方

- 离线运行:即使在网络中断的情况下,基础功能仍可正常运行

- 低延迟:本地调用避免了网络传输带来的延迟

模型无关(Model-Agnostic):OpenClaw不绑定任何特定的大语言模型,而是通过统一的Provider抽象层,支持多种模型的动态切换:

- 云端模型:OpenAI GPT系列、Anthropic Claude、Google Gemini、国内大模型

- 本地模型:通过Ollama集成的Llama、Gemma、Qwen等开源模型

2.1 Gateway网关层:控制平面实现

Gateway是OpenClaw系统的控制平面,负责会话管理、消息路由、节点注册和HTTP API暴露。其核心功能模块包括:

WebSocket连接管理:所有Agent通过WebSocket接入系统,Gateway维护全局连接池并处理心跳检测、重连机制。

GPT plus 代充 只需 145

消息路由机制:基于会话ID和渠道类型进行智能路由,支持多级绑定(peer > guild > team > channel > default)。

会话状态管理:每个用户会话都有独立的状态隔离,通过Redis或内存存储维护上下文历史。

2.2 Agent智能体层:推理引擎与执行循环

Agent层是OpenClaw的智能核心,实现了完整的智能体执行循环。其技术实现围绕以下几个关键组件:

Pi Embedded Runner:嵌入式运行时引擎,直接嵌入主进程而非RPC调用,显著提升性能。

上下文引擎(Context Engine):动态构建和维护Agent的执行上下文,包括短期记忆、长期记忆检索和系统指令注入。

思维链管理器:支持多种推理模式,包括ReAct(推理+行动交替)、Plan-and-Execute(先规划再执行)、Self-Ask(自我提问式推理)。

2.3 Skills技能系统:可扩展性架构设计

Skills系统是OpenClaw最具创新的模块之一,它实现了AI能力的无限扩展。一个完整的Skill包含以下组件:

SKILL.md文件结构:每个Skill的核心定义文件,采用YAML Frontmatter + Markdown说明的格式。

GPT plus 代充 只需 145

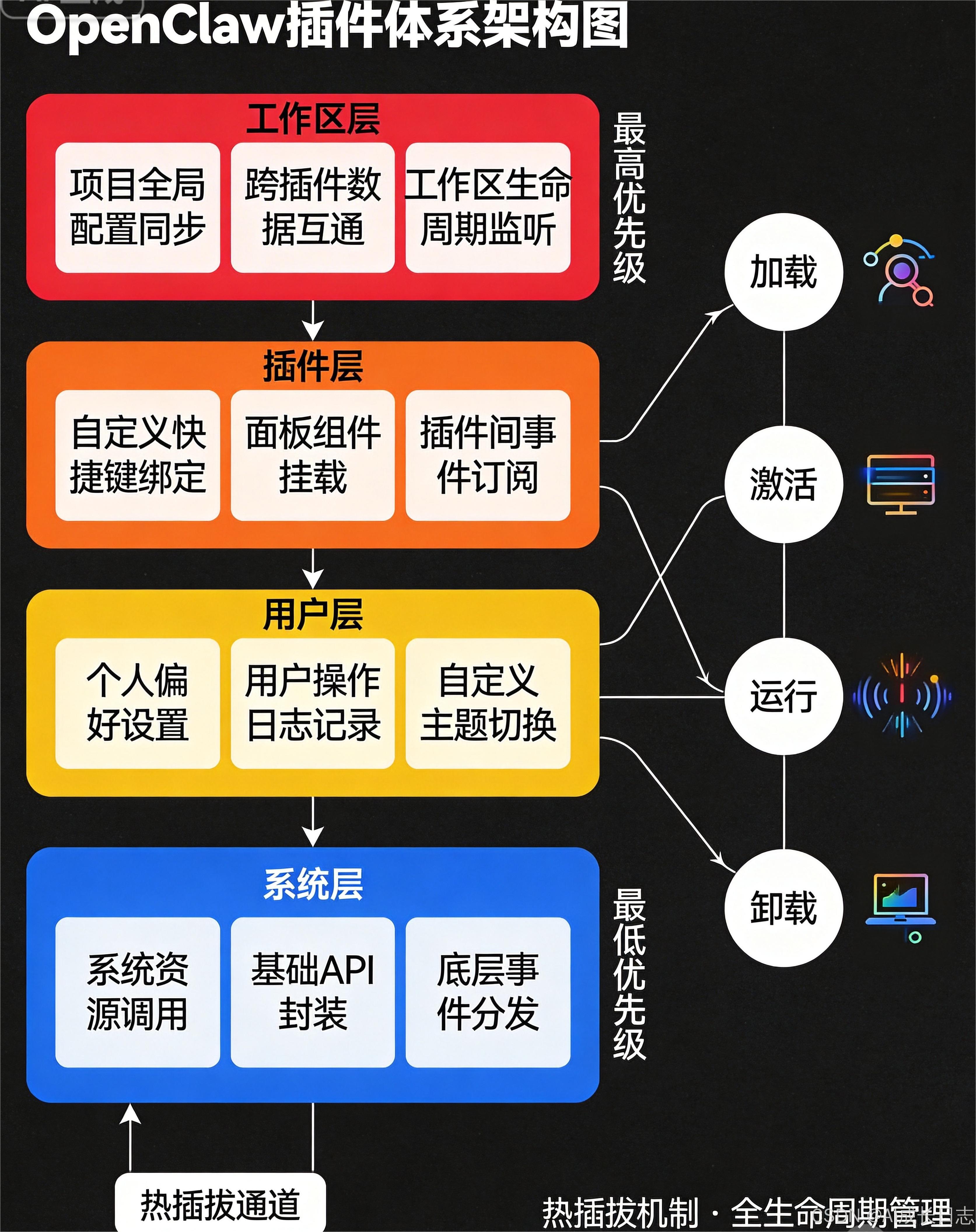

技能加载优先级:OpenClaw采用四层优先级架构,实现了高度的灵活性和可定制性:

- 工作区层(最高):,仅当前Agent可见

- 插件层:通过插件发布的Skill,动态加载

- 用户层:,本机所有Agent共享

- 系统层(最低):内置Skill,随安装包发布

热重载机制:默认开启文件监听,修改Skill文件无需重启服务。

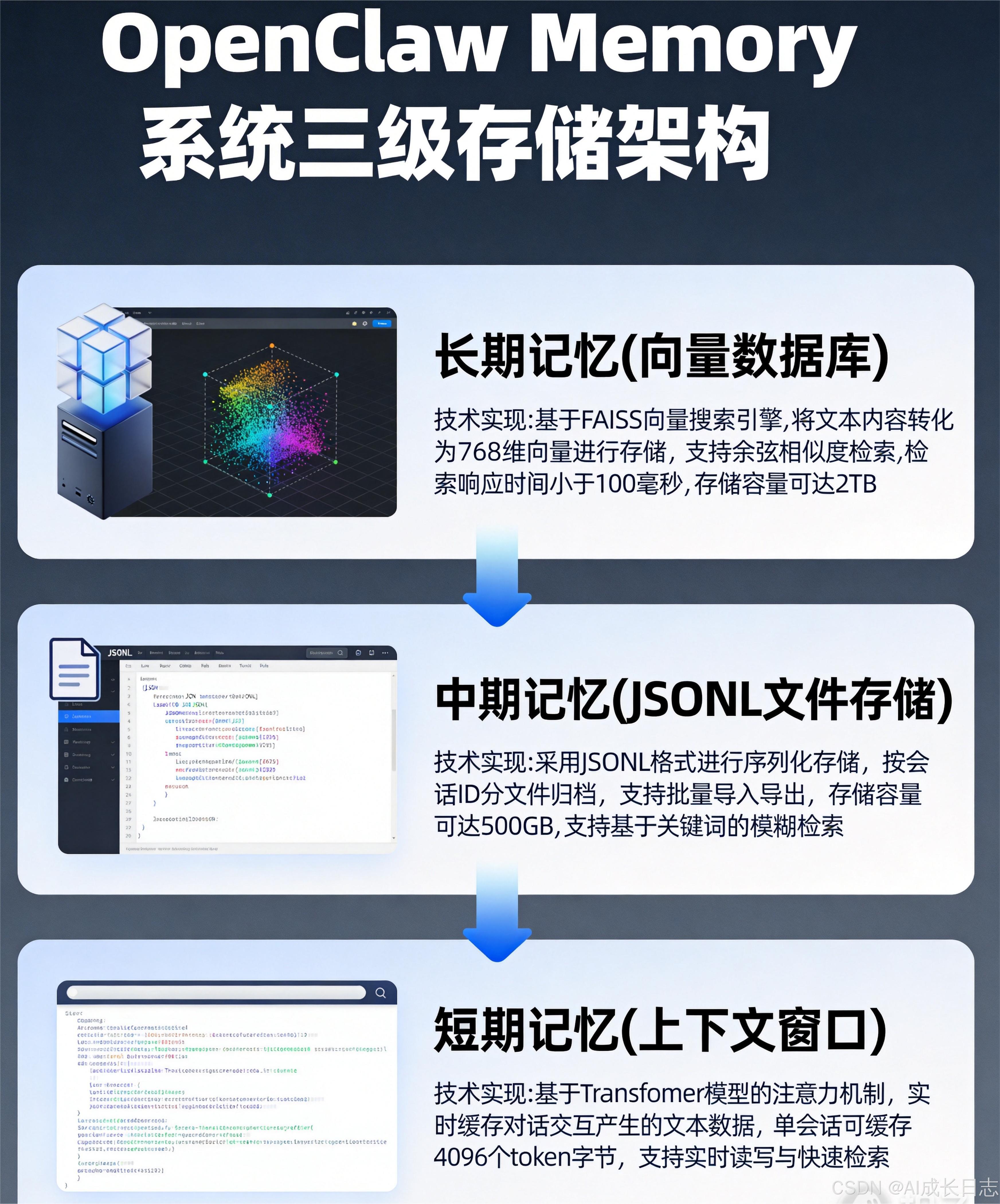

2.4 Memory记忆系统:三级存储架构

OpenClaw的Memory系统实现了复杂的三级存储架构,为Agent提供了长期记忆能力。

短期记忆:存储在上下文窗口内,直接用于当前推理循环。通过智能摘要算法压缩历史对话,保留核心信息。

中期记忆:以JSONL格式文件存储会话历史,支持完整审计追溯。采用增量存储策略,避免文件过大。

长期记忆:基于SQLite + sqlite-vec构建的向量数据库,实现语义搜索和精准记忆激活。

GPT plus 代充 只需 145

记忆检索算法:结合MMR(Maximal Marginal Relevance)算法,平衡相关性与多样性:

其中 ,优先保留与查询高相关的结果,同时惩罚与已选结果过于相似的候选。

2.5 Plugin插件系统:热插拔扩展机制

Plugin系统是OpenClaw架构设计的又一亮点,通过标准化接口实现了系统的无限扩展。

插件类型支持:

- Channel插件:新增通信渠道(如自定义IM工具、企业微信专版)

- Tool插件:新增Agent工具(如专业数据库查询、内部API调用)

- Provider插件:新增AI模型提供商

- Hook插件:注册生命周期钩子

- HTTP-Route插件:添加自定义HTTP路由

插件生命周期管理:

Context Engine插件接口:v2026.3.7版本引入的革命性特性,允许开发者完全自定义上下文管理策略:

- Bootstrap钩子:插件初始化

- Ingest钩子:上下文内容摄入

- Assemble钩子:提示词组装

- Compact钩子:历史压缩

- AfterTurn钩子:回合后处理

3.1 模型解析器与智能路由算法

OpenClaw的模型解析器(Model Resolver)是大模型层的核心组件,负责根据任务特性选择最合适的模型。其核心算法实现如下:

GPT plus 代充 只需 145

模型匹配度计算:基于多维度评分体系选择最优模型

其中权重参数根据用户配置动态调整。

3.2 工具调用安全沙箱机制

OpenClaw的工具系统配备了严格的安全沙箱,确保AI执行操作的安全性。安全架构包括多个防护层级:

沙箱类型:

- Docker沙箱:非主会话的工具调用在隔离的Docker容器中执行

- 命名空间隔离:通过Linux命名空间限制文件系统访问

- 能力限制:基于Capabilities机制控制系统权限

工具执行策略管道:

循环调用检测:防止无限递归工具调用

GPT plus 代充 只需 145

3.3 上下文窗口防护与压缩算法

长周期任务中上下文溢出是AI系统的常见问题。OpenClaw通过智能Token管理策略,实现了可控的降级而非直接截断。

上下文选择优化算法:

其中:

- 是模型的最大上下文窗口大小

- 衡量上下文片段 的重要性

- 衡量上下文片段 的时效性

- 是权重参数(默认 )

重要性评分算法:

3.4 多模态融合与执行引擎

OpenClaw支持文本、图像、语音等多种输入模态,实现了真正的多模态AI智能体。

多模态输入处理管道:

GPT plus 代充 只需 145

视觉-语言对齐算法:通过对比学习实现跨模态语义对齐

其中 为图像特征向量, 为文本特征向量, 为温度参数。

4.1 项目目录结构解析

OpenClaw采用TypeScript + Node.js技术栈,项目结构清晰,遵循“单一职责”原则。

4.2 工程化设计模式

OpenClaw大量运用了经典的设计模式,确保了代码的可维护性和扩展性:

依赖注入(Dependency Injection):通过IoC容器管理组件依赖

GPT plus 代充 只需 145

观察者模式(Observer Pattern):事件驱动架构实现组件解耦

策略模式(Strategy Pattern):动态切换算法实现

GPT plus 代充 只需 145

4.3 测试与质量保障

OpenClaw拥有完善的测试体系,确保系统的稳定性和可靠性:

测试类型覆盖:

- 单元测试:Vitest框架,组件级测试

- 集成测试:Gateway与Agent集成测试

- 端到端测试:完整业务流程测试

- 安全测试:工具调用安全边界测试

测试代码示例:

5.1 内存与计算优化策略

向量检索优化:通过量化压缩降低内存占用

GPT plus 代充 只需 145

KV Cache智能管理:减少重复计算,提升推理速度

5.2 部署架构方案

OpenClaw支持多种部署模式,适应不同场景需求:

单机部署:适用于个人用户,数据完全本地化

GPT plus 代充 只需 145

分布式部署:适用于企业环境,支持多节点协同

云端托管服务:各大云厂商提供的一键部署方案

- 腾讯云:OpenClaw专属镜像,支持弹性伸缩

- 阿里云:AI智能体服务,集成阿里云大模型

- AWS:Bedrock集成,支持多种推理后端

6.1 技术创新的深远意义

OpenClaw的成功不仅仅是又一个开源项目的火爆,它代表了AI技术发展的一个重要里程碑:

从“能说”到“能做”的跨越:传统AI停留在对话交互层面,OpenClaw让AI真正拥有了执行能力,实现了从“顾问”到“员工”的角色转变。

本地优先的范式革命:在数据隐私日益重要的今天,OpenClaw的本地优先设计为用户提供了完全可控的数据主权,这可能是未来AI应用的重要方向。

工程化智能体平台:OpenClaw将复杂的AI智能体系统工程化,提供了完整的插件体系、工具调用、记忆管理等功能,为开发者构建了完善的生态系统。

6.2 未来发展趋势

基于OpenClaw的技术架构和产业应用,我们可以看到以下几个发展趋势:

垂直领域深度定制:OpenClaw的插件化架构为行业应用提供了无限可能,未来将看到更多针对特定领域(教育、医疗、金融、制造)的定制化解决方案。

多模态能力增强:随着视觉、语音、传感器等多模态技术的融合,OpenClaw将能够处理更加复杂的现实世界任务。

自主进化能力提升:通过强化学习和持续学习,OpenClaw智能体将能够从经验中不断优化自身行为,实现真正的自主进化。

边缘计算集成:结合边缘计算设备,OpenClaw将在资源受限的环境下实现高效运行,拓展应用边界。

6.3 给开发者的建议

对于想要深入学习和应用OpenClaw的开发者,我们建议:

- 从源码开始理解:OpenClaw的设计理念和架构思想是其核心价值,深入源码理解是掌握该技术的**途径。

- 实践驱动学习:尝试开发自己的Skill或Plugin,通过实践加深对系统工作机制的理解。

- 参与社区贡献:OpenClaw拥有活跃的开源社区,参与贡献不仅能提升技术水平,还能建立行业联系。

- 关注安全**实践:AI执行系统涉及敏感操作,必须重视安全设计和权限控制。

OpenClaw作为一个开源AI智能体框架,通过其创新的三层解耦架构、本地优先设计、插件化扩展机制,为我们展示了AI技术从“对话”到“执行”的完整路径。它不仅是一个技术工具,更是一种新的计算范式——执行式AI。

通过深入源码分析,我们看到OpenClaw在架构设计、算法实现、工程实践等方面的卓越成就。它为开发者提供了一个构建智能、自主、可扩展AI系统的完整框架,为AI技术的产业应用开辟了新的可能性。

随着技术的不断演进和生态的持续完善,OpenClaw有望成为下一代AI应用的基础设施,让每个人都能拥有自己的数字员工,真正实现AI赋能人类工作的愿景。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/239116.html