作为一名常年和大模型部署打交道的开发者,最近发现技术圈里刮起了用 OpenClaw “养龙虾” 的风,各大技术社区、开源论坛里全是开发者分享的 OpenClaw 实操教程、场景落地案例,甚至还有不少人基于 OpenClaw 做了二次开发,“养龙虾” 也成了开发者之间对用 OpenClaw 做工作流编排的趣味称呼。究其原因,还是因为本地大模型部署后落地难的问题被诟病已久,而 OpenClaw 作为轻量化的调度编排工具,恰好能打通模型部署和业务应用的最后一公里,和 OpenStation 的搭配更是成了开发者的首选组合,今天就从实操角度,聊聊这套组合的本地大模型部署和对接全流程。

做本地大模型部署,第一步就是选对底座工具,OpenStation 作为专门的本地大模型部署底座,从模型选择到部署后管理形成了完整的技术体系,完全贴合开发者的实际开发需求,其核心设计理念为场景化适配与资源高效利用,可满足不同开发场景下的本地大模型部署需求,同时大幅降低本地大模型部署的技术门槛。

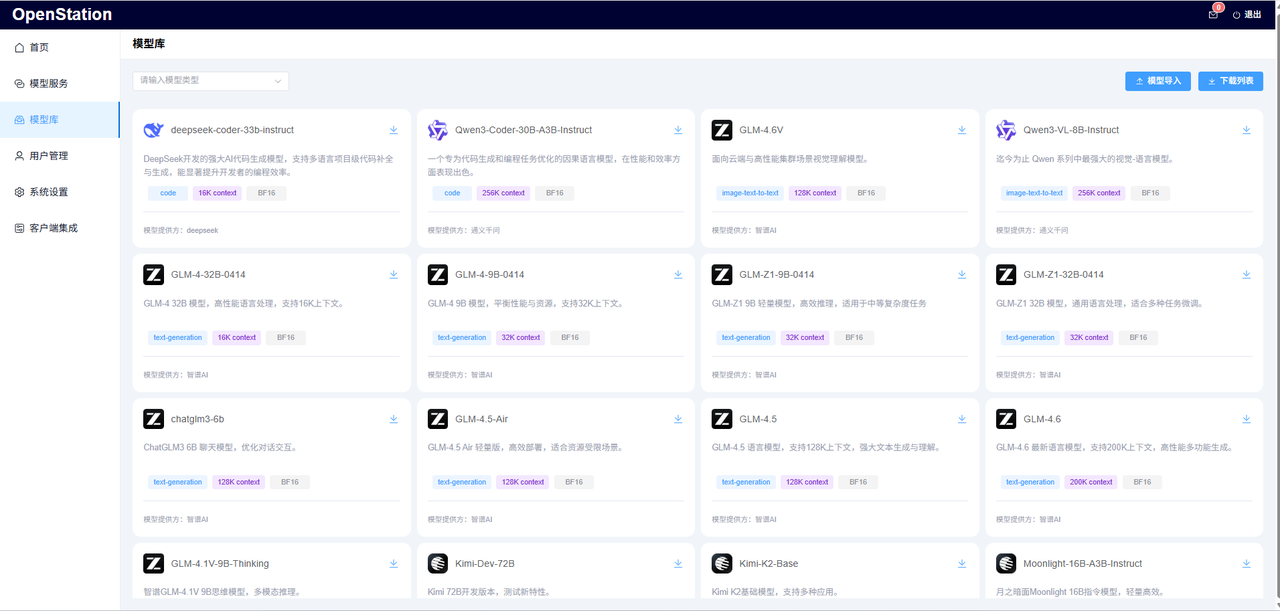

1.1 模型库

在模型来源选择上,OpenStation 内置了全场景覆盖的模型库,主流大模型系列均已完成集成,无需开发者手动寻找模型资源,其中 Qwen3 系列参数量从 0.6B 到 80B 全覆盖,小参数量适合实时代码补全这类轻量任务,大参数量能处理复杂逻辑优化;DeepSeek-V3 在代码生成场景表现突出,写算法模块时逻辑和语法都更精准;ZhipuAI GLM4 系列的多轮对话上下文保持能力优异,技术文档查询、行业术语解析的场景里输出更靠谱。同时平台还支持模型断点续传下载,下载后自动完成环境适配,不用手动配置依赖,大幅节省了部署准备时间。

1.2 部署模式

针对不同的开发场景、硬件资源和协作需求,OpenStation 设计了三种差异化的部署模式,开发者可按需选择。Single 单机部署模式适合单人日常编码辅助,推理引擎选用 SGLang(GPU),启动快、推理延迟低,能实现代码补全的秒级响应;Distributed 分布式部署模式则针对开发团队协作场景,支持跨节点部署大参数量模型,平台自动实现负载均衡,保证多开发者同时调用的服务稳定性;CPU-Only 纯 CPU 部署模式,专门适配无 GPU 的测试服务器,虽然推理速度稍慢,但能满足代码检查、逻辑验证等轻量测试任务,完美覆盖了测试阶段的需求。

1.3 节点选择

在节点选择上,OpenStation 做到了精细化的硬件资源配置,从底层避免资源浪费。单机部署时,可精准选择节点中的单张加速卡,剩余硬件资源能正常处理其他开发任务,实现资源按需分配;分布式部署时,支持跨节点选择不同节点的加速卡,平台自动完成张量并行部署,不用开发者手动编写分布式脚本,降低了分布式部署的技术门槛;CPU 部署则无特殊硬件限制,只要满足基础硬件要求的节点,都能快速启动服务,特别适合临时测试这类轻量化、高灵活性的开发场景。

1.4 运维管理

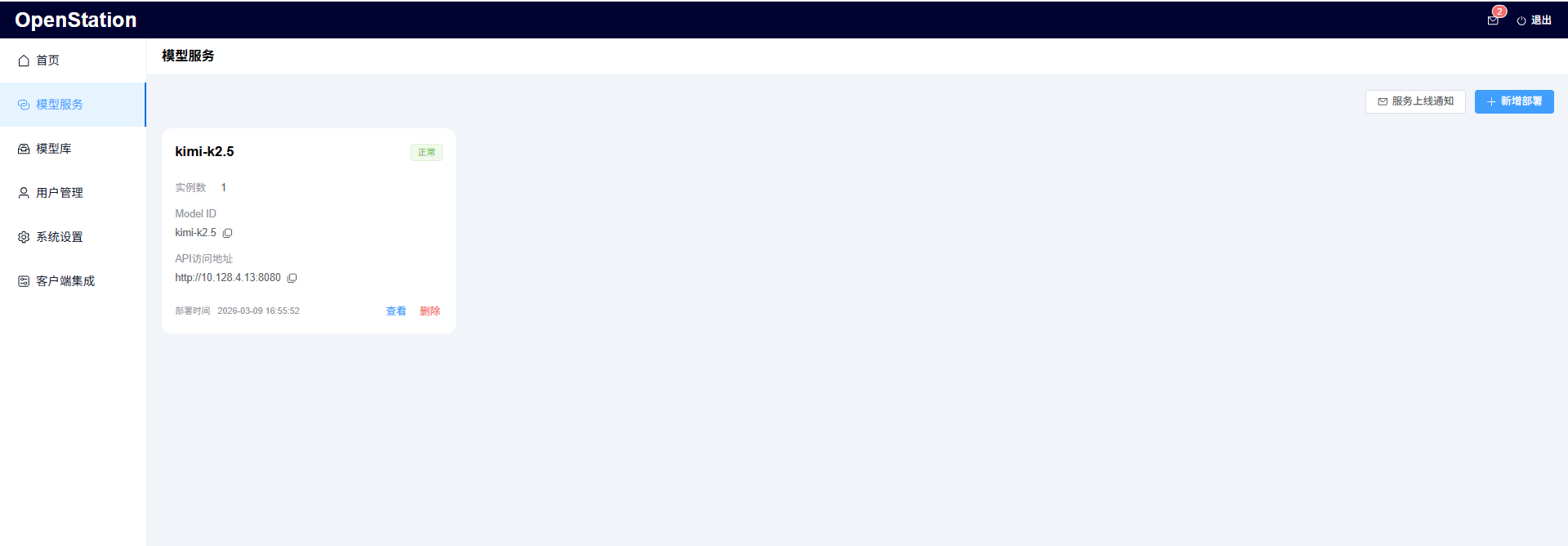

部署后的运维管理,也是 OpenStation 的一大亮点,全程实现可视化和便捷化。服务上线后,平台界面会清晰展示实例状态、Model ID、API 访问地址、部署时间等核心信息,开发者能快速获取模型调用的关键参数。运维操作上,支持一键删除无用实例,及时释放硬件资源,避免资源闲置;故障排查层面,平台内置日志功能,可通过日志快速定位 GPU 驱动、推理引擎等环节的故障,无需登录服务器手动排查,大幅提升了运维效率。

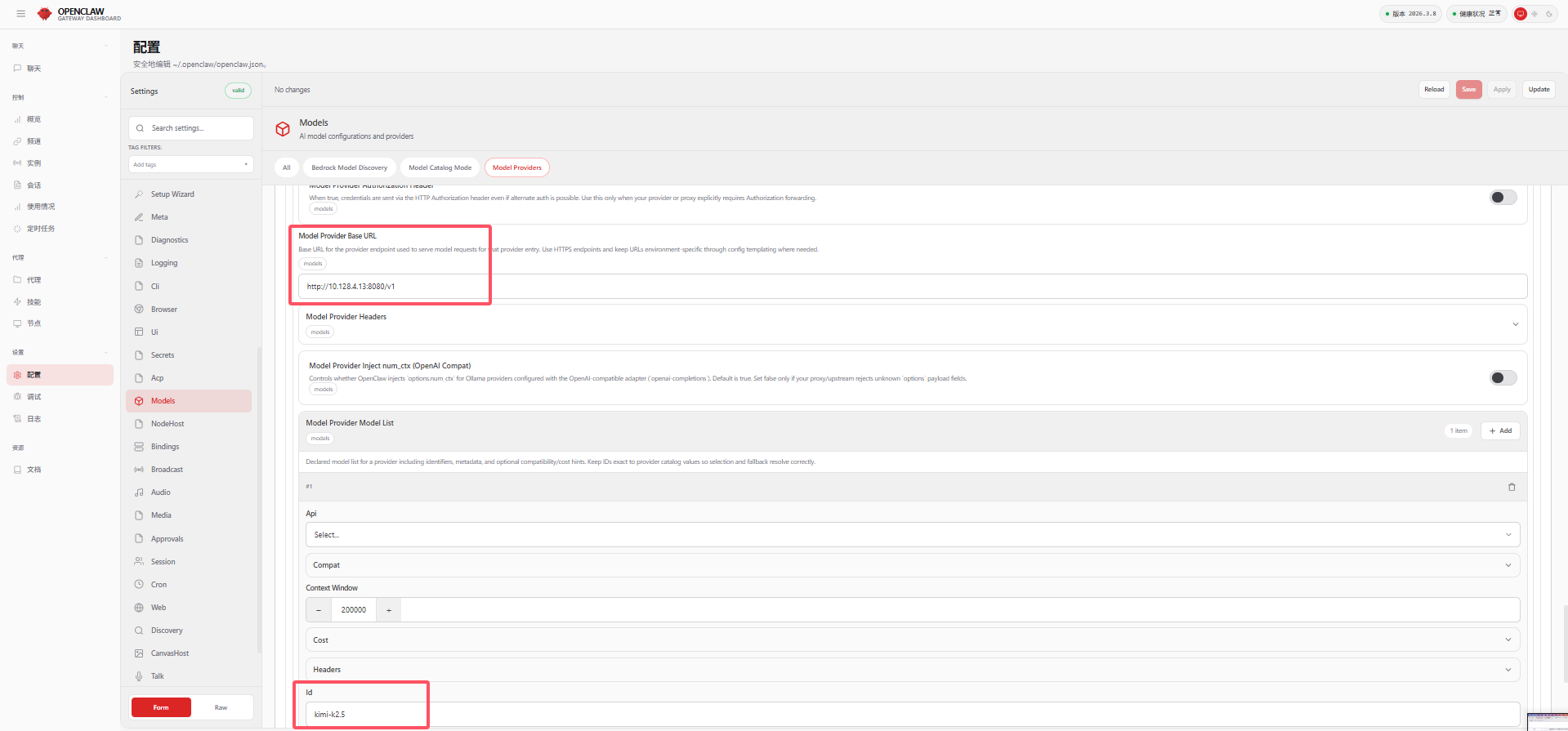

以 kimi-k2.5 模型实例部署为例,其 API 访问地址为http://10.128.4.13:8080,Model ID 为 kimi-k2.5,开发者可直接通过该参数实现模型的基础调用,运维过程中可通过平台界面实时监控实例运行状态。

完成 OpenStation 的本地大模型部署后,就该搭建上层的调度编排体系,这也是 “养龙虾” 的核心环节,首先要做的就是 OpenClaw 的安装部署。

2.1 OpenClaw 平台的安装部署

OpenClaw 支持跨操作系统部署,Windows、macOS、Linux 等主流系统都能快速安装,操作十分简单:

- macOS/Linux 系统:通过 Shell 命令执行安装,命令为

GPT plus 代充 只需 145

- Windows 系统:通过 PowerShell 执行安装,命令为

安装完成后,执行启动 OpenClaw 核心服务,通过命令验证版本号,若能正常显示版本信息则说明部署成功。OpenClaw 部署完成后的本地默认访问地址为http://localhost:18789。

2.2 模型参数的配置与添加

接下来就是 OpenStation 和 OpenClaw 的核心对接环节,这套流程的关键在于参数的精准同步和配置,全程可视化操作,无需复杂的代码开发。

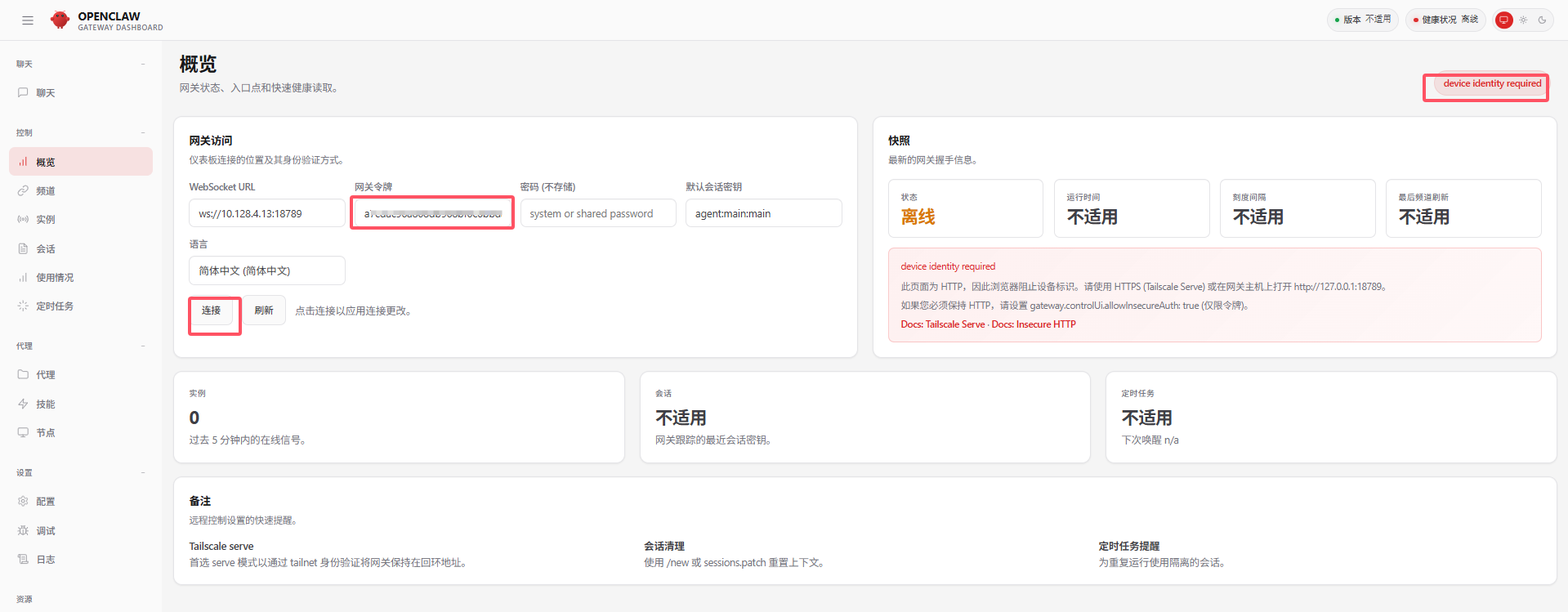

第一步:添加“网关令牌”(从/root/.openclaw/openclaw.json获取),点击“连接”按钮解决页面“device identity required”提示错误;

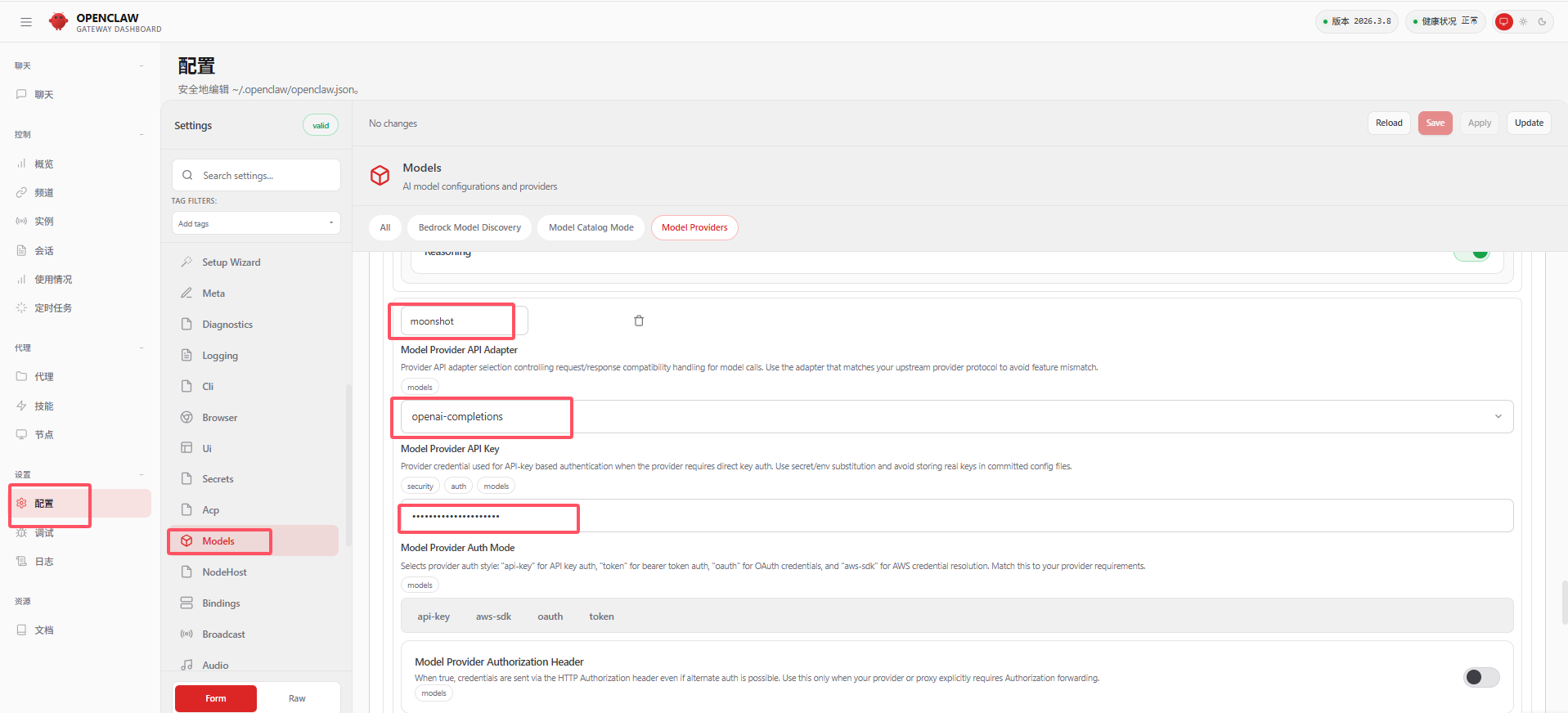

第二步:点击 OpenClaw 平台的「Config」>「Models」>「Providers」菜单,添加 Api、Api Key、Base Url、Id、Name 五个核心参数,其中Api Key、Base Url、Id三个参数可直接从 OpenStation 平台的模型实例信息中获取,其余参数按平台要求完成基础配置即可。

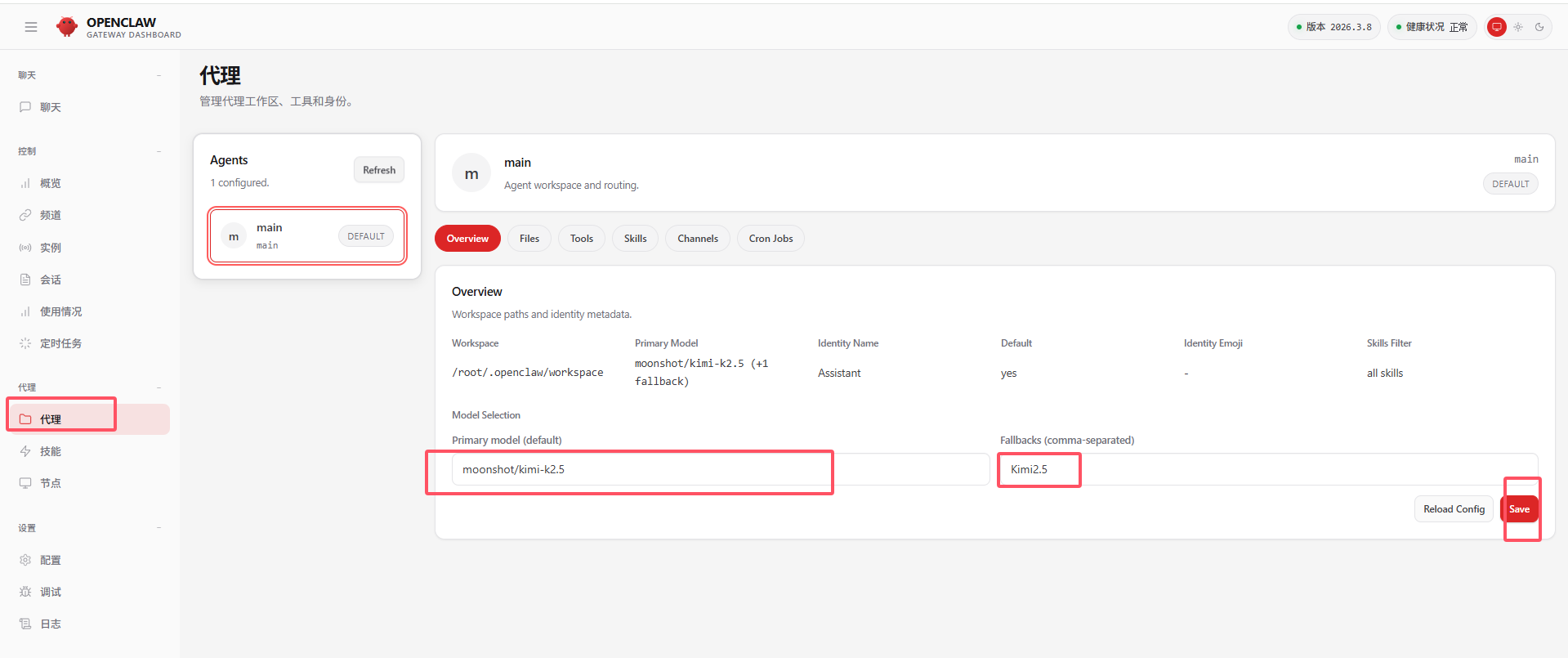

2.3 默认模型服务的设置

参数配置完成后,需将目标模型设置为 OpenClaw 的默认模型服务,确保平台调度时可优先调用该模型,具体操作流程为:点击 OpenClaw 平台的「Agents」>「Overview」>「Primary model」,在下拉选项中选择目标模型(如 moonshot/kimi-k2.5),完成选择后保存配置,即可实现模型服务的默认调度设置。

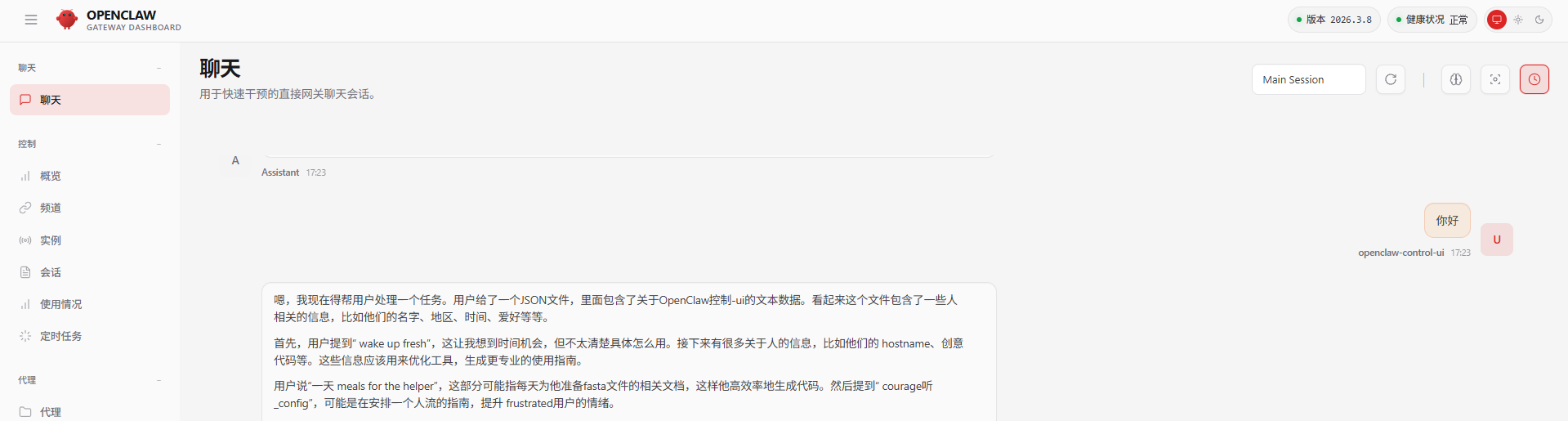

2.4 模型调用的对话功能测试

完成上述配置后,可通过 OpenClaw 平台的聊天功能进行模型调用测试,验证全链路的连通性。在 OpenClaw 的「Chat」模块中发起简单的测试请求(如基础的数值计算、代码片段生成),若平台能正常返回模型响应结果,则说明 OpenStation 与 OpenClaw 的全链路对接完成,模型可实现正常调用。

项目地址:https://github.com/fastaistack/OpenStation

- 在线安装(支持Ubuntu22.04 / 20.04 / 18.04系列及Centos7系列)

GPT plus 代充 只需 145

也可直接下载在线安装包(openstation-pkg-online-latest.tar.gz),上传至Linux服务器后执行:

- 离线安装(仅支持Ubuntu 22.04.2/20.04.6/18.04.6)

点击「离线 OpenStation 安装包下载」,参考上述OpenStation项目地址中离线安装文档。

部署完成后,登录页面如下:

作为开发者,实际使用后能感受到 OpenStation+OpenClaw 组合的实用性,OpenStation 解决了本地大模型部署的所有技术痛点,轻量化、高效化的部署能力降低了技术门槛;OpenClaw 则用简单的操作实现了上层调度编排,让模型能力真正融入业务流程。二者的对接流程简洁、适配性强,不用关注底层复杂细节,只需聚焦业务本身,是本地大模型工程化落地的高效解决方案,也难怪会成为技术圈的 “香饽饽”。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/236670.html