本文整理自《Hello Agents》第一章,系统梳理智能体的定义、构成、运行机制与协作模式,并附有课后思考题的详细解析。

📖 全文约 3200 字,预计阅读时间 7 分钟

智能体被定义为:任何能够通过传感器(Sensors)感知其所处环境(Environment),并自主地通过执行器(Actuators)采取行动(Action)以达成特定目标的实体。

真正赋予智能体"智能"的,是其自主性(Autonomy)。智能体并非只是被动响应外部刺激、严格执行预设指令的程序——它能够基于感知和内部状态进行独立决策,以达成其设计目标。这种从感知到行动的闭环,构成了所有智能体行为的基础。

在 LLM 智能体出现之前,规划旅行意味着用户需要在多个专用应用(天气、地图、预订网站)之间手动切换,由用户自己扮演信息整合与决策的角色。而一个 LLM 智能体可以将这个流程整合起来。

以"规划一次厦门之旅"为例,LLM 智能体的工作方式体现了以下三个核心特征:

① 规划与推理

智能体首先将高层级目标分解为一系列逻辑子任务:

这是一个内在的、由模型驱动的规划过程,而非预设脚本。

② 工具使用

在执行规划时,智能体识别到信息缺口,会主动调用外部工具补全。例如调用天气查询接口获取实时天气,并基于"预报有雨"这一信息,在后续规划中倾向于推荐室内活动。

③ 动态修正

智能体将用户的反馈(如"这家酒店超出预算")视为新的约束,据此调整后续行动,重新搜索并推荐符合新要求的选项。整个"查天气 → 调行程 → 订酒店"的流程,展现了其根据上下文动态修正自身行为的能力。

3.1 任务环境:PEAS 模型

通常使用 PEAS 模型来精确描述一个任务环境,四个维度分别为:

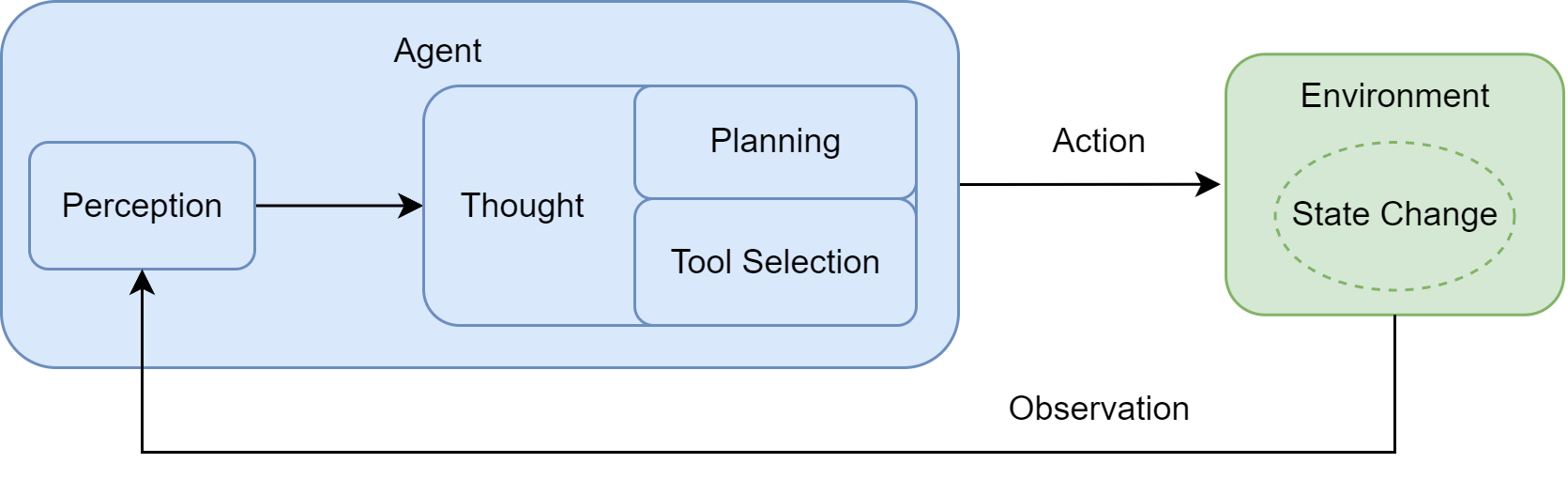

3.2 智能体循环(Agent Loop)

智能体并非一次性完成任务,而是通过一个持续的循环与环境进行交互。这个核心机制被称为智能体循环(Agent Loop),包含以下四个相互关联的阶段:

GPT plus 代充 只需 145

- 感知:智能体通过传感器接收来自环境的输入(用户指令、上一步行动的环境状态反馈)。

- 思考:核心决策阶段,包含两个子步骤:

- 规划(Planning):基于当前观察与内部记忆,更新对任务的理解,制定或调整行动计划,可能将复杂目标拆解为子任务。

- 工具选择(Tool Selection):从可用工具库中选择最合适的工具,并确定调用参数。

- 行动:通过执行器执行具体行动,调用选定工具(如代码解释器、搜索引擎 API),从而对环境施加影响。

- 观察:行动引起环境状态变化,环境产生新的观察结果作为反馈,进入下一轮循环。

核心闭环:感知 → 思考 → 行动 → 观察,持续迭代直到目标达成。

Workflow 是让 AI 按部就班执行指令,Agent 则是赋予 AI 自由度去自主达成目标。

以智能旅行助手为例:当用户下达"查询今天北京天气,并根据天气推荐合适景点"的指令时,Agent 不依赖任何写死的 的规则——如果天气是"雨天",它会自主推理并推荐国家博物馆等室内场所。这种基于实时信息进行动态推理和决策的能力,正是 Agent 的核心价值所在。

Q1:用 PEAS 模型描述"智能健身教练"

场景:智能体通过可穿戴设备监测生理数据,根据健身目标动态调整训练计划,提供实时语音指导和饮食建议。

PEAS 描述:

- Performance(性能度量):体脂率/肌肉量变化、训练完成率、动作准确度评分、心率是否保持在目标区间、用户满意度。

- Environment(环境):用户(生理状态、情绪)、可穿戴设备数据流、健身场地与器材。

- Actuators(执行器):语音指导接口、手机屏幕(显示训练视频/饮食建议)、振动提醒。

- Sensors(传感器):心率监测器、加速度计(G-sensor)、陀螺仪、GPS、语音采集器。

环境特性分析:

Q2:Workflow vs. Agent 处理电商退款

两种方案对比:

选择建议:

- Workflow 合适场景:高频、标准、低价值的交易,以及法律法规严格限制的环节。

- Agent 合适场景:非标商品、涉及用户情感维系、复杂背景下的纠纷判罚。

- 负责人倾向:初期采用 Workflow 确保底线,中后台引入 Agent 辅助决策。

方案 C:混合架构(Human-in-the-loop + Agentic Workflow)

核心思路是用 Workflow 定义"硬边界"(如定制品不退),在 Workflow 的分叉口调用 Agent:

- Agent 作为 Router(路由):分析非结构化的用户描述,决定走哪个流程分支。

- Agent 作为 Consultant(顾问):为客服审核提供风险提示,降低人工决策的认知负担。

这种架构实现了"规则保底、智能增益"的扬长避短效果。

Q3:为智能旅行助手添加新功能

在 Thought-Action-Observation 循环的基础上,三个功能的设计思路如下:

① 添加"记忆"功能

在循环开始前,加载用户的 Profile(长期记忆)和 Short-term History(短期对话记录),并将其注入 Prompt:

② 景点售罄时自动推荐备选

在 Observation 阶段添加检测逻辑:当返回结果为"售罄"时,自动触发重试并替换查询参数:

GPT plus 代充 只需 145

③ 连续拒绝 3 次后的反思机制

添加拒绝计数器,当累计达到 3 次 Negative Feedback 时,触发独立的 Reflect 步骤,让模型分析用户偏好偏差并调整后续推荐策略。这本质上是在循环中插入了一个元认知层。

Q4:智能体的局限性分析

① 为什么智能体会产生"幻觉"?

- 概率本质:LLM 本质是预测下一个 Token,而非提取事实;

- 知识截断:训练数据中缺乏最新事实信息;

- 模式过拟合:智能体过度拟合某种语言模式,在缺乏数据支撑时"一本正经地胡说八道"。

② 不设最大循环次数会有什么问题?

- 无限死循环:当两个工具的结果互相矛盾时,Agent 可能反复切换尝试;

- 成本爆炸:每次循环消耗 Token,无限循环会导致费用失控;

- 资源耗尽:导致服务器并发阻塞,影响整体系统可用性。

③ 如何评估智能体的"智能"程度?

仅使用准确率是不够的,完整的评估体系应涵盖以下维度:

本文对应《Hello Agents》第一章内容。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/235605.html