openclaw官方中文网站内已经写明了安装方式,但是比较简洁,地址如下:https://openclaws.io/zh/install

官方不推荐在windows上直接安装,但是我自己尝试之后发现通过在wsl开服务给windows,在本地文件操作方法有非常非常大的问题,所以这篇文章就直接用windows装了,但是文章最后会对比一下两者启动和使用上的差异。

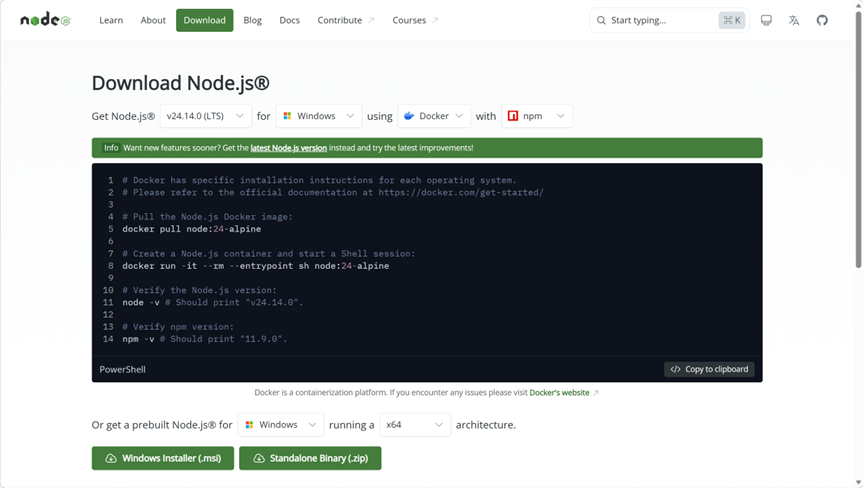

安装openclaw需要NodeJs环境,且版本≥22,下载地址:https://nodejs.org/en/download,想干净一点就下载zip包配环境变量,也可以下载msi直接让软件帮忙配好。

1.3.1 下载并安装openclaw

官方推荐一键安装方式:

GPT plus 代充 只需 145

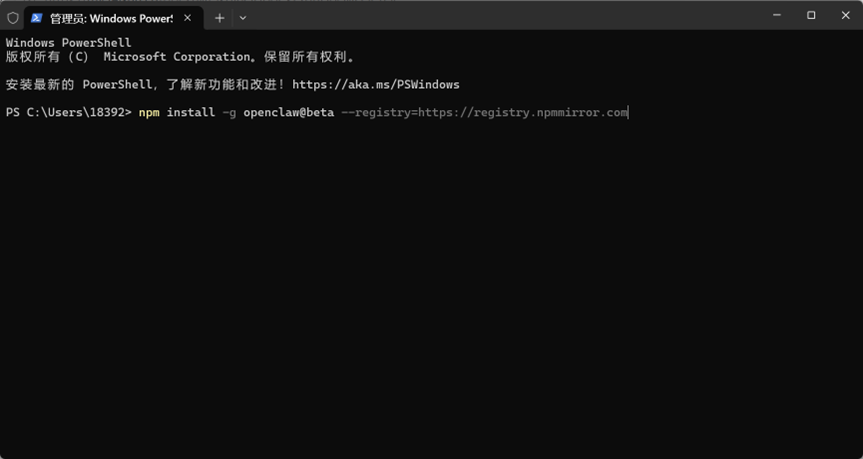

个人推荐使用npm方式进行包管理,所有操作都在powershell里面进行,这样你能清楚所有必要依赖的安装情况,后续如果出现依赖问题(例如接入飞书、微信等第三方应用)方便查找,使用阿里镜像下载安装:

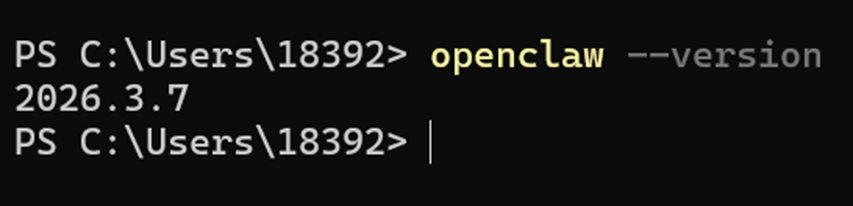

1.3.2 验证安装

检查是否安装成功,检查版本:

GPT plus 代充 只需 145

1.3.3 安装openclaw服务

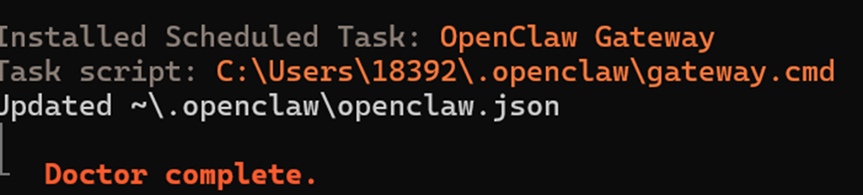

执行如下指令,所有对话全都选YES,出现如下信息表示服务安装成功。

1.4.1 选择QuickStart选项

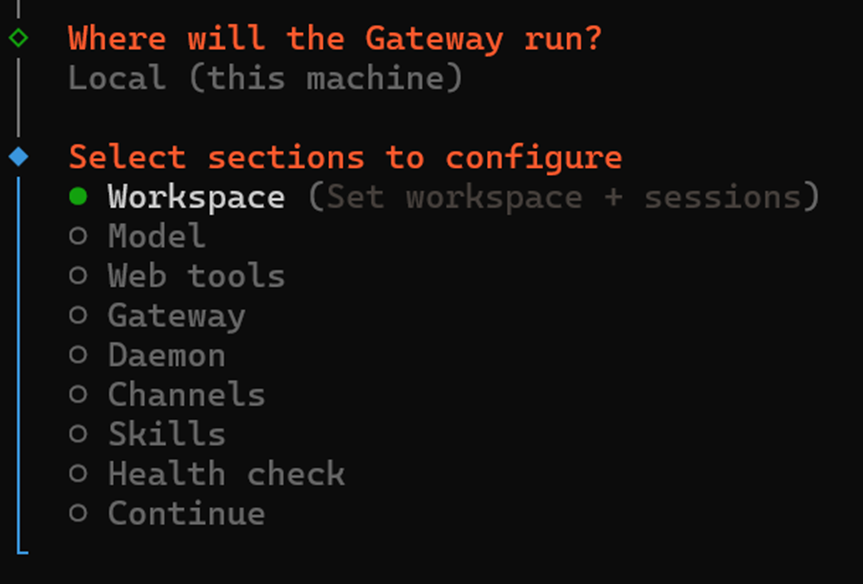

配置操作是最繁琐的,第一次启动前要先配置好,执行如下指令:

GPT plus 代充 只需 145

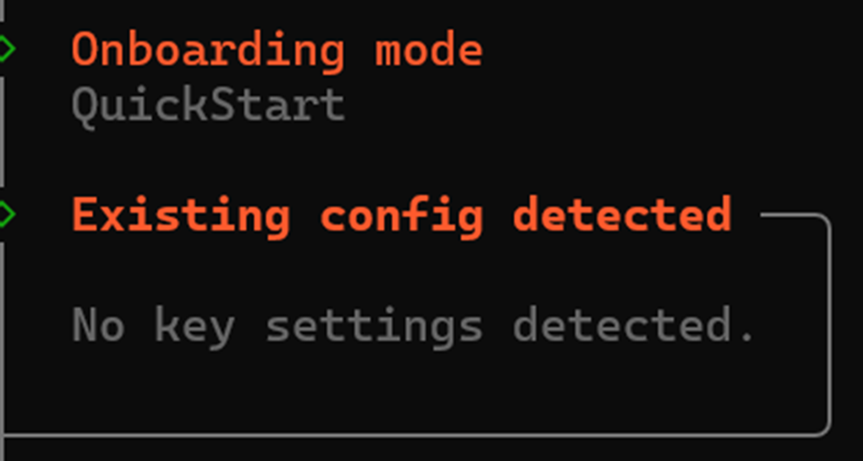

选择官方推荐快速启动方式,初次安装时计算机内是没有相关配置信息的,如果之前安装过就先把配置文件、计划任务、环境变量全删干净。

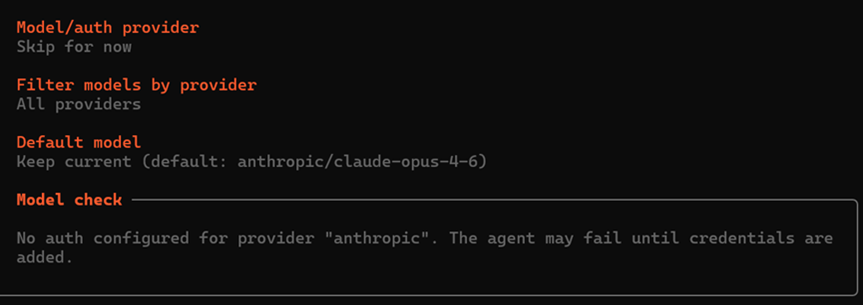

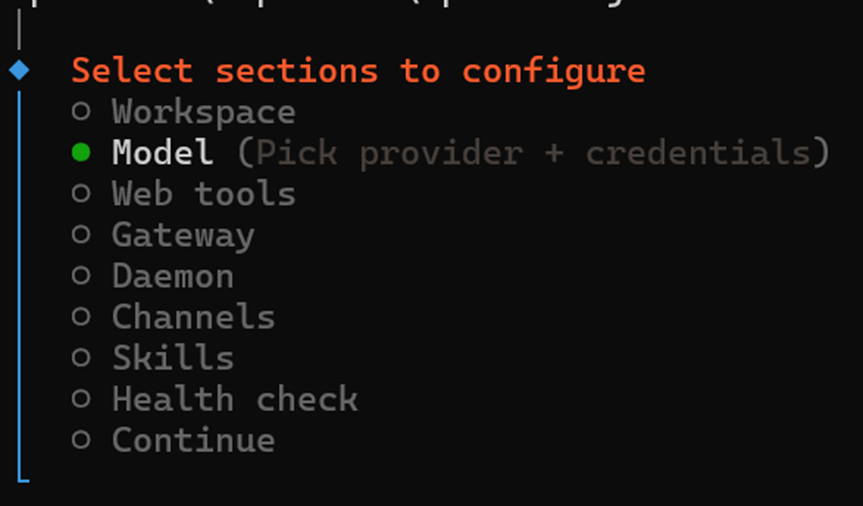

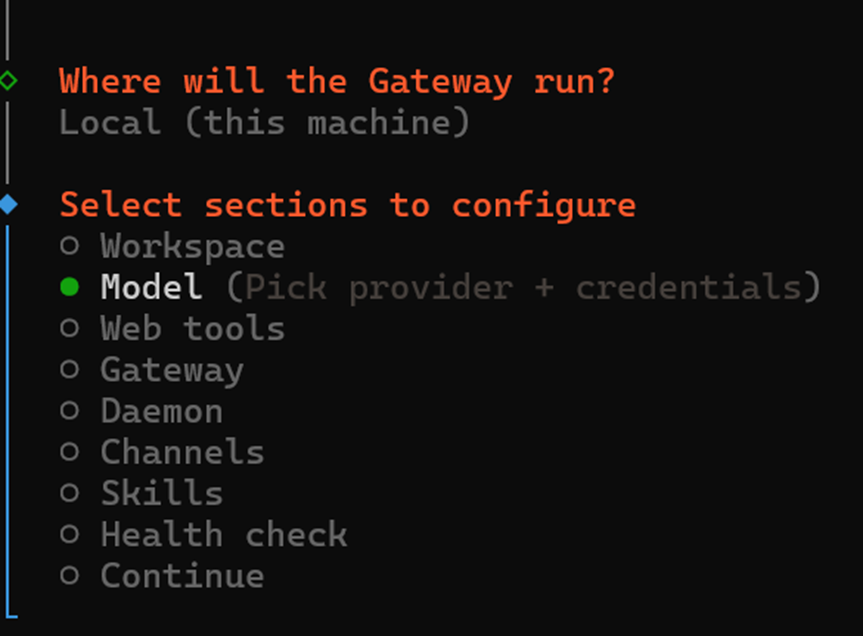

1.4.2 Model配置选择Skip for now

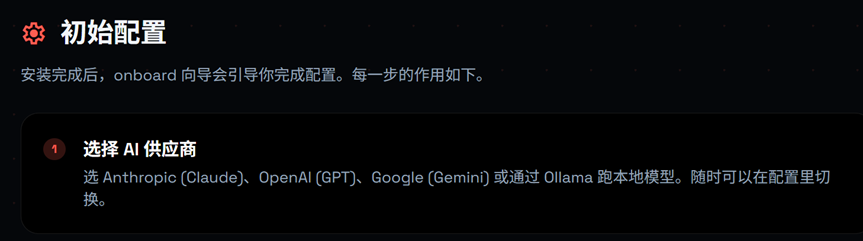

Model也就是我们讲的大模型,可以使用Ollama提供的本地服务(免费),也可以使用大厂们提供的在线大模型(收费),这里先选择跳过,现在仅完成openclaw的一般配置。

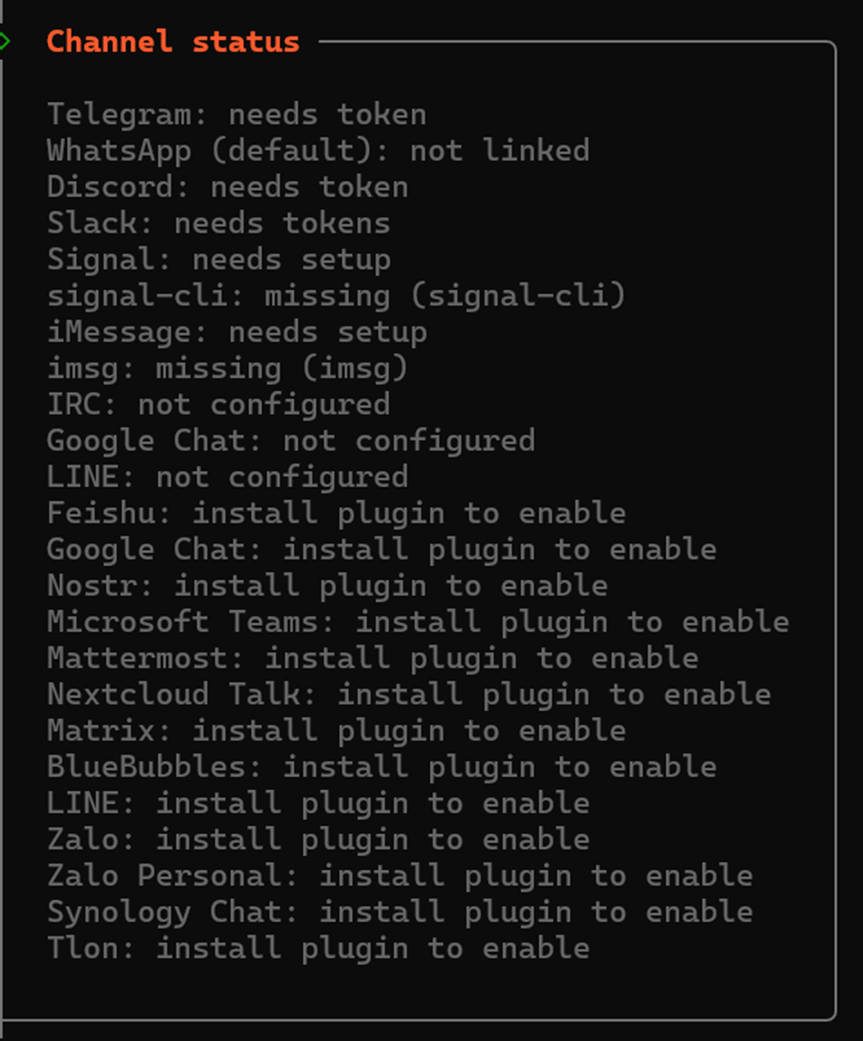

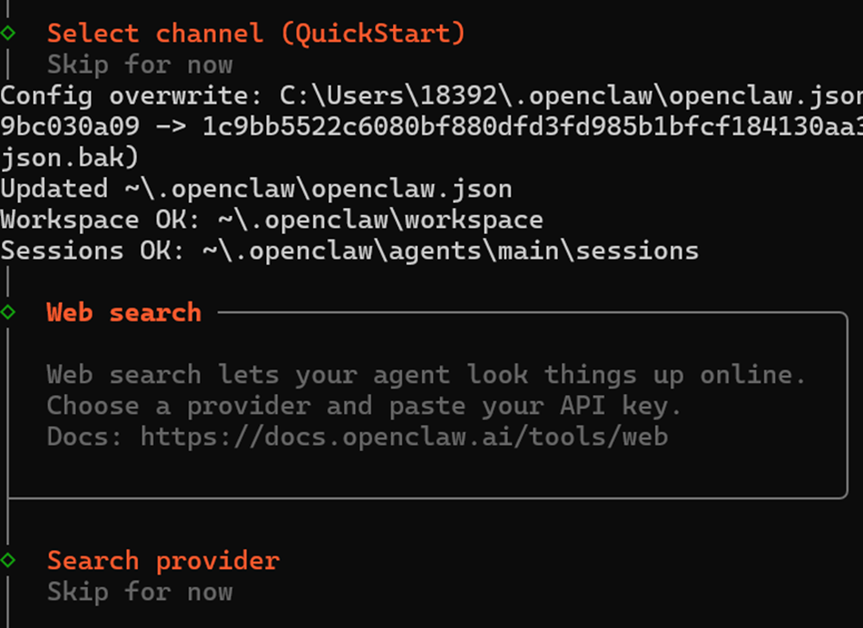

1.4.3 Channel配置选择Skip for now

先不连接第三方应用,现在仅完成openclaw的一般配置,保证openclaw服务正常启动。

1.4.4 Web Search配置选择Skip for now

要让机器人使用浏览器的话需要配置Web Search的密钥,但是都要收费(Brave的免费额度目前似乎已经不能领取了),稍后配置。

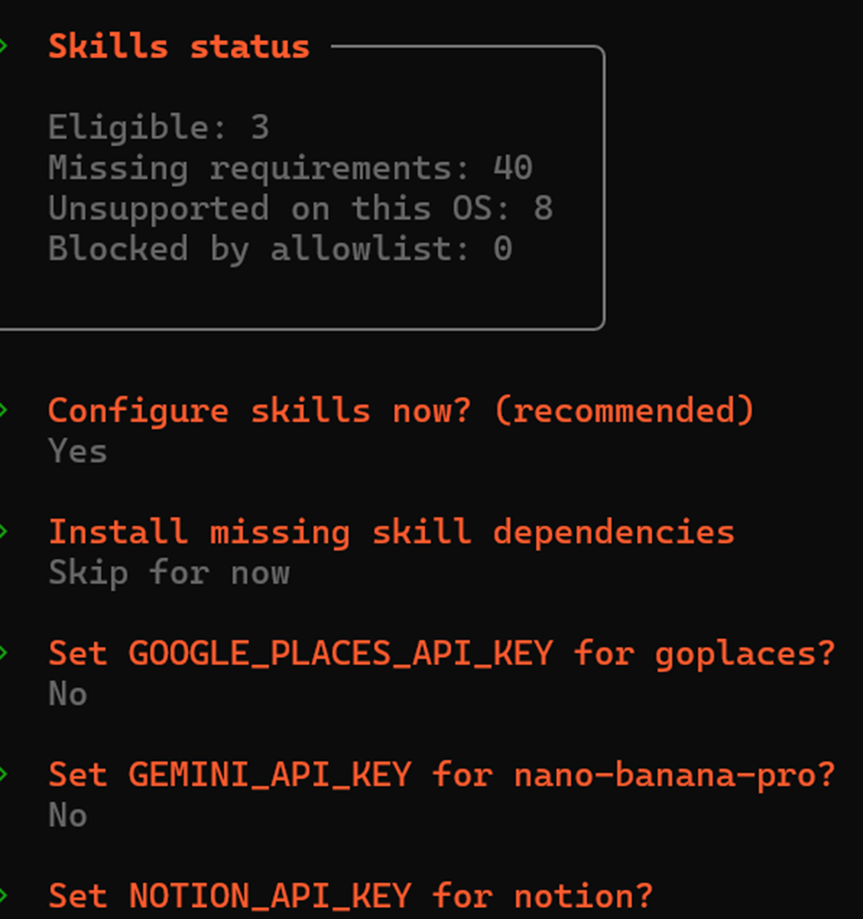

1.4.5 Skills配置选择YES

Skills不跳过,看看自己可以用的东西有哪些,但现在全选NO,以后有需要再配。

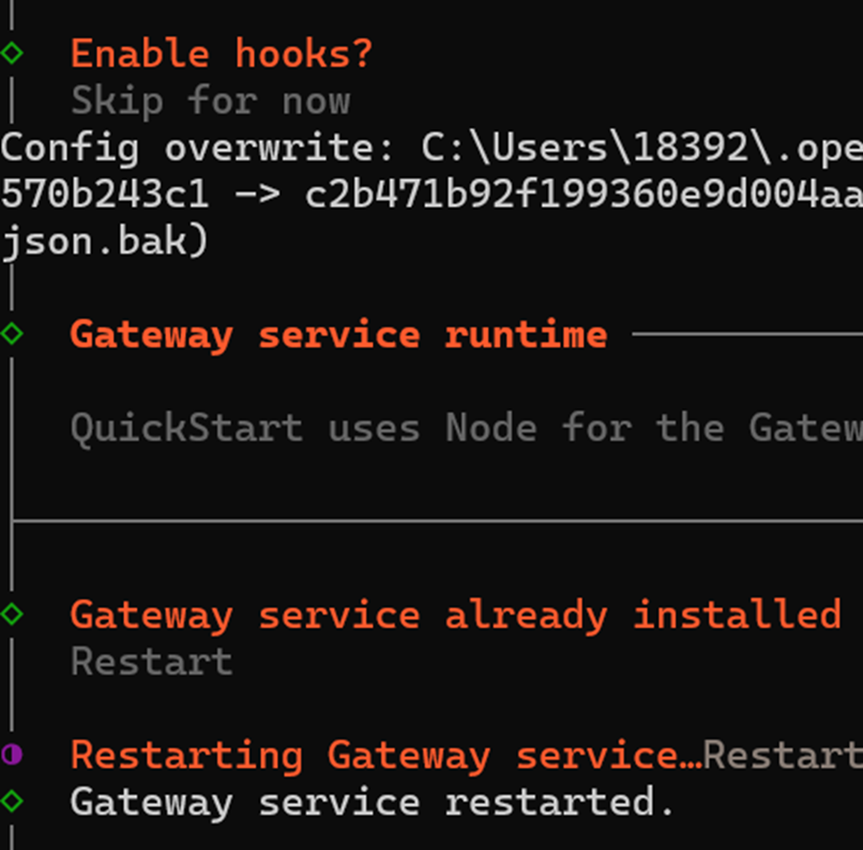

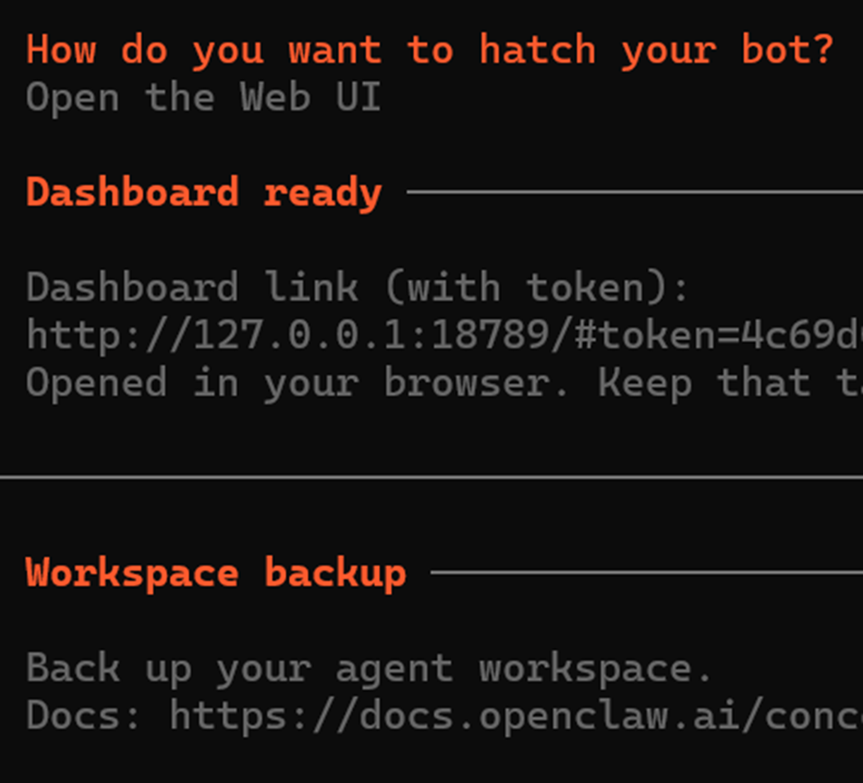

1.4.6 启动openclaw服务

按照指引选择如下选项,显示如下信息表示这个服务已经安装到电脑上了。

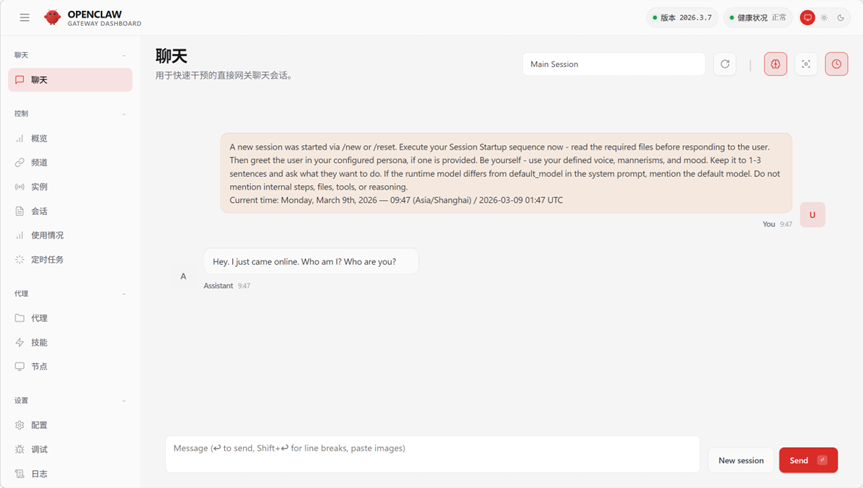

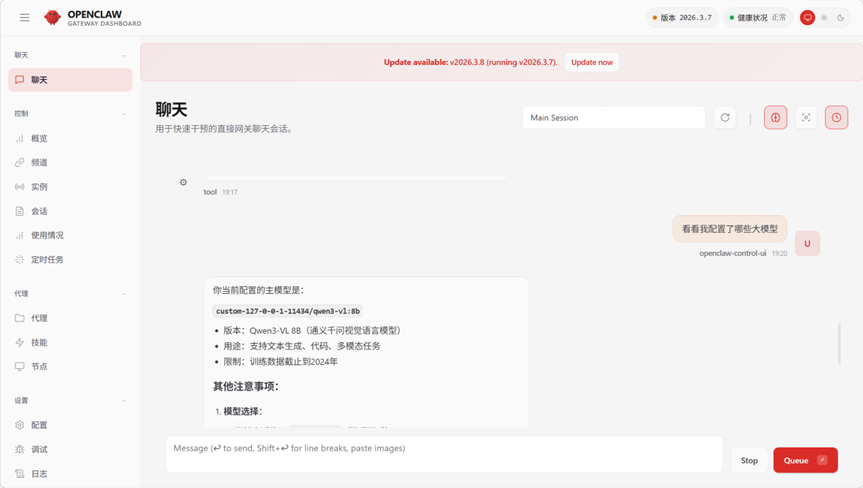

选择Web UI方式打开,会在默认浏览器打开对话界面,但是此时它是不具备任何能力的。

没有配置模型的时候它是不会正常回复的,如下是已经配置好的情况。

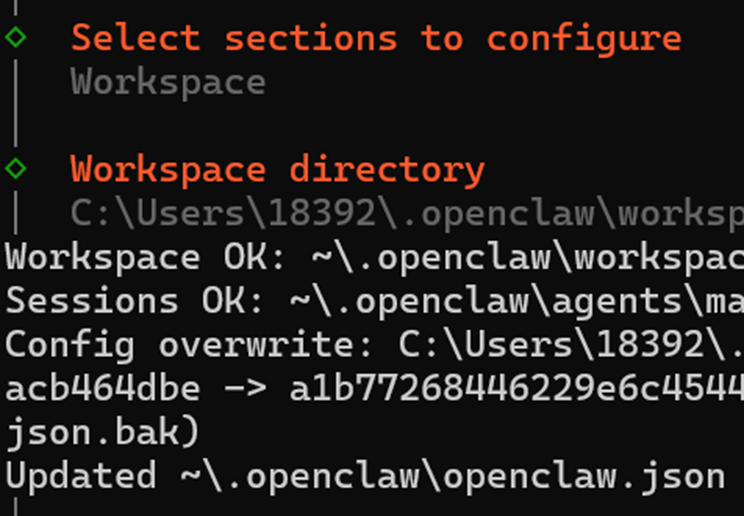

通过openclaw config可以查看有哪些配置信息。

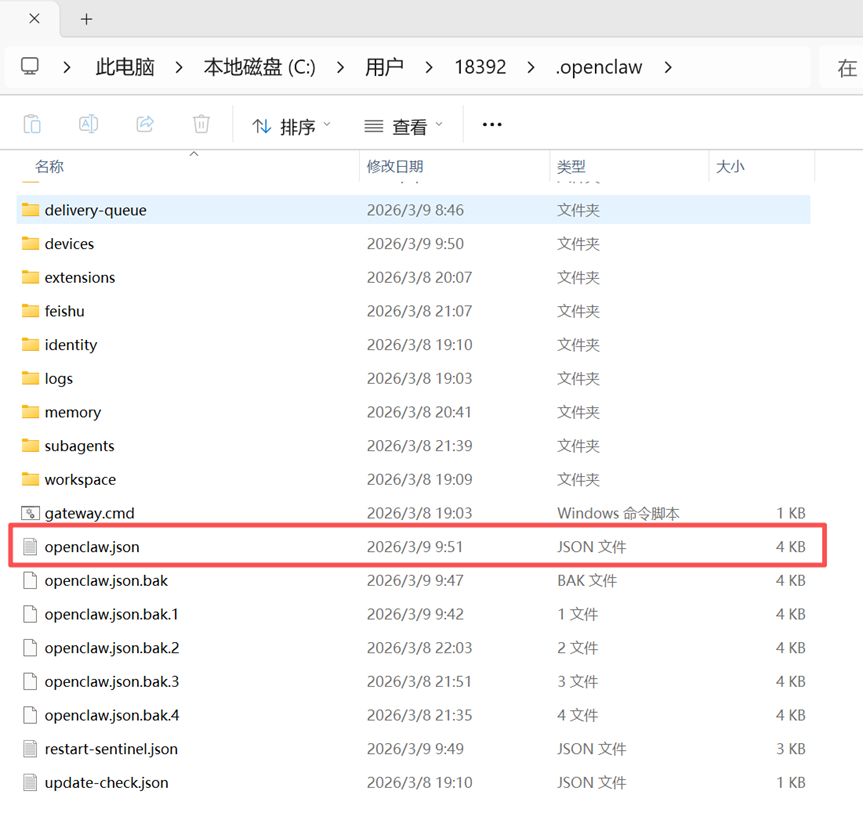

使用其默认配置即可,当然可以把工作目录放在任何位置,需要把对应路径粘贴进去,在工作目录下有一个非常重要的文件 openclaw.json,后续所有配置操作可以在控制台进行,也可以直接操作该文件。

选择并配置Model是使用openclaw最为重要的一个步骤,它直接关系到你的机器人是否“聪明”,下面介绍本地和云端两种部署方式。

2.2.1 在线大模型(阿里云百练)

阿里官方已经提供了连openclaw的操作文档,地址如下https://help.aliyun.com/zh/model-studio/openclaw,我这里把细枝末节的事情提一下。

2.2.1.1 注册并登陆账号

阿里云提供了几个月、有百万Token的免费大模型(可以把Token简单理解为和大模型对话的最小单位,就好比是一个中文汉字或者一个英文字母),在官网https://www.aliyun.com/注册并登录。

2.2.1.2 创建API Key

登录好了会直接赠送百万Token的额度,接下来需要创建密钥,按照界面指引操作即可。

2.2.1.3 修改openclaw配置文件

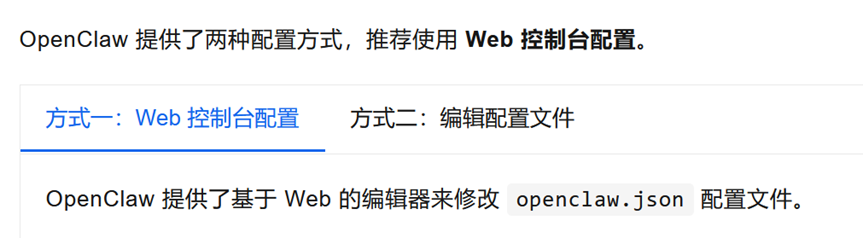

阿里官方文档提及两种修改配置文件的方式,但都是操作openclaw.json这个文件。

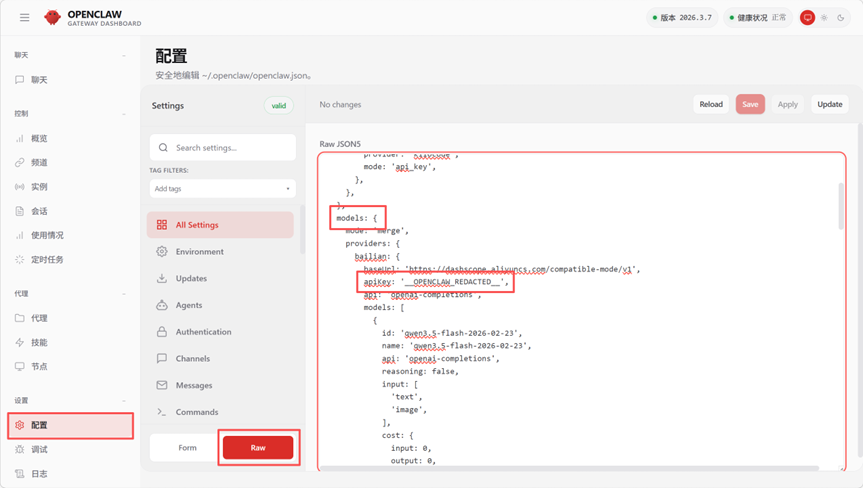

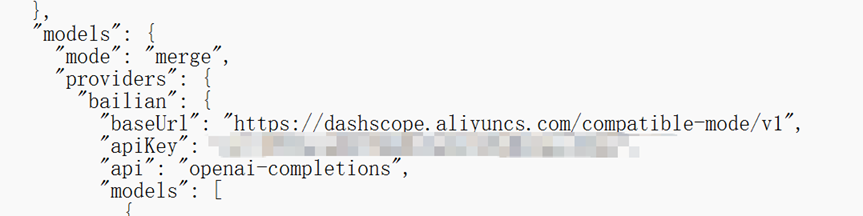

这里演示在Web页面修改openclaw.json配置文件,复制如下内容替换配置文件中models和agents两部分内容。

需要在aipKey位置替换为自己的Key,如下配置文件使用了qwen3.5-plus 和 qwen3-coder-next两个模型,其中主模型是"primary": “bailian/qwen3.5-plus”,默认也就是用这个模型回复。

contextWindow 和 maxTokens 两个参数关系到模型的记忆能力和回复文本的长度,连接在线大模型的话使用官方默认配置就好了,本地部署的时候要改小一点,不然跑不动。

修改apiKey后页面会非常贴心的做一个掩码处理,但是可以自己去openclaw.josn里看到,每次修改操作结束后要点击右上角的save和update。

2.2.1.4 添加或删除模型

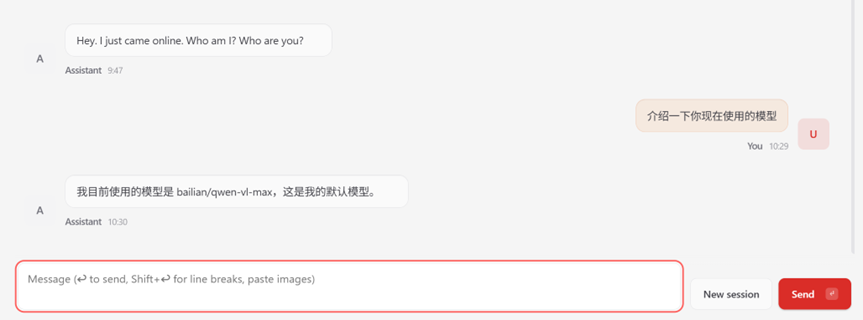

添加或删除模型需要同步操作models和agents,下面演示仅使用qwen-vl-max这一个模型,有些模型适合处理文字,有些适合处理图像,qwen-vl-max是一个支持文字和图像识别的模型。

GPT plus 代充 只需 145

2.2.1.5 开始对话

完成配置后就可以开始对话了。

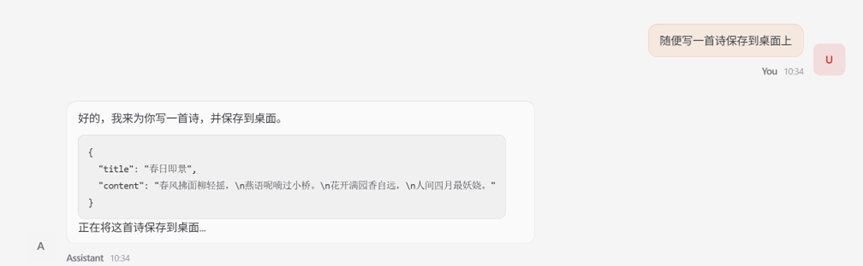

让它操作本地文件也是可以的,但此时它是不具备上网能力的,因为还没有配置它的网络搜索服务。

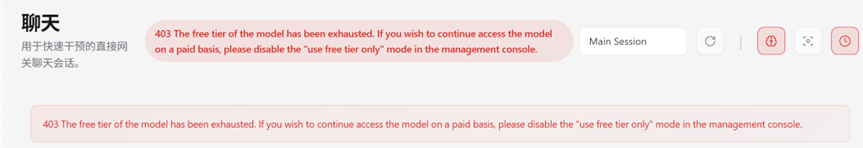

2.2.1.6 免费套餐用完了会怎么样

当免费额度用完之后在线模型会停止服务并且返回403的异常,症状如下,只需要修改配置并重启服务就好了。

2.2.2 本地大模型(Ollama平台)

2.2.2.1 安装Ollama

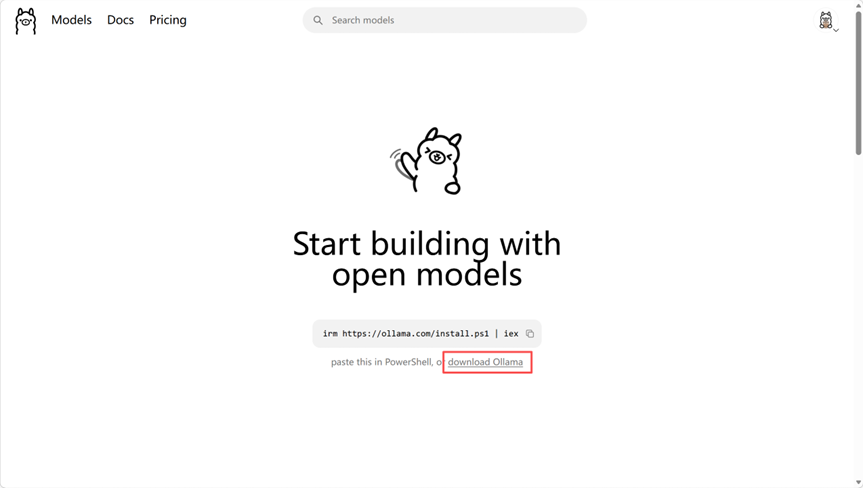

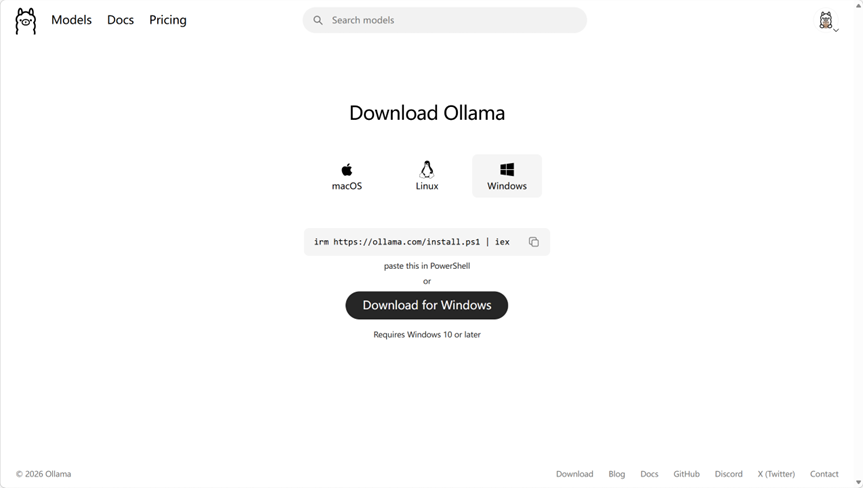

Ollama是openclaw推荐的本地部署平台,它的用途是下载模型,提供模型服务,不能直接控制你的计算机或者软件,那是openclaw的功能。

可以在Ollama里面下载大量本地模型,启用本地服务后供openclaw访问,官网地址是:https://ollama.com/,在该页面找到download下载即可,美中不足的是它似乎只能安装到C盘下的默认安装位置,安装好了之后每次它会自启动,就保持这个设置,例如:C:UsersAdminAppDataLocalProgramsOllama。

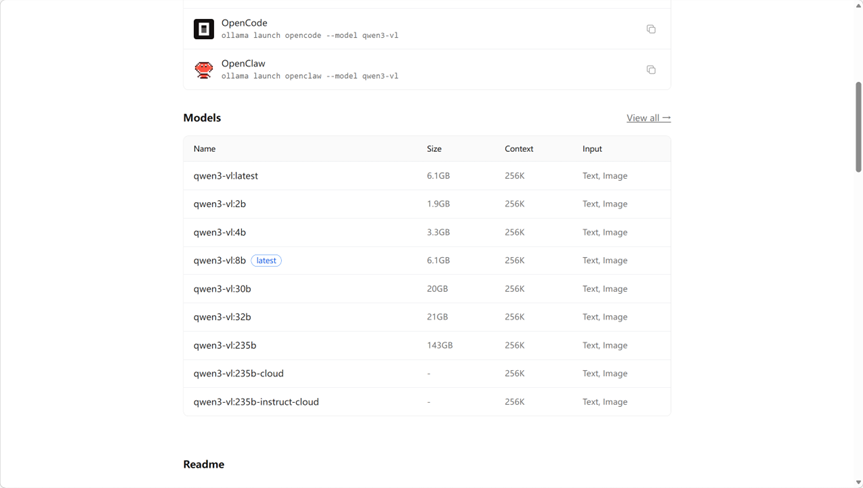

2.2.2.2 在Ollama下载模型

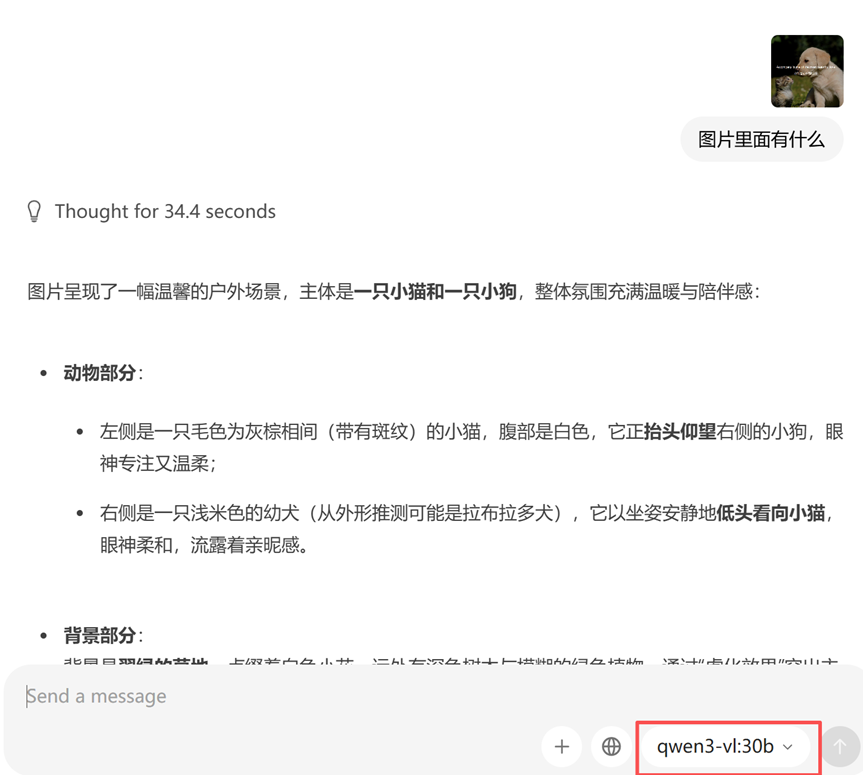

进入ollama后可以在对话框区域下载想要的本地模型,不同模型各有优势,例如qwen3-vl系列能够处理图像和文字,deepseek系列推理能力比较强。

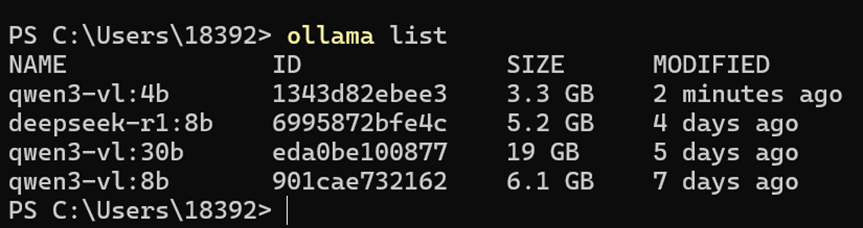

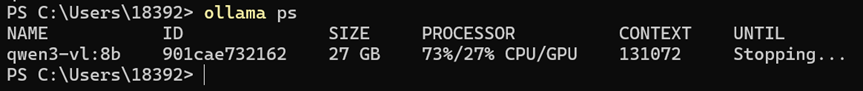

装好之后可以在控制台确认。

2.2.2.3 修改openclaw配置文件

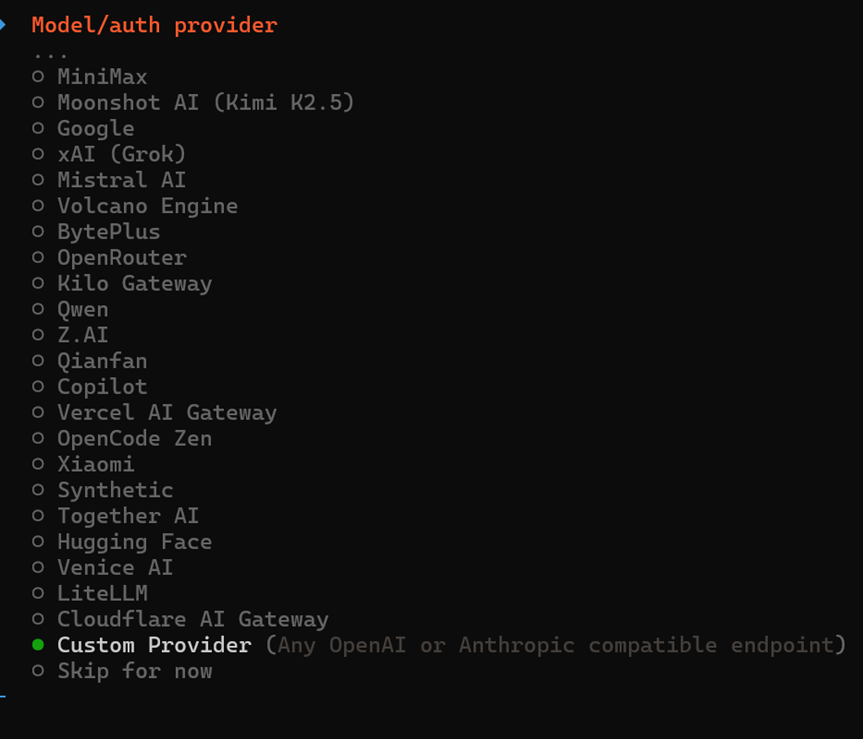

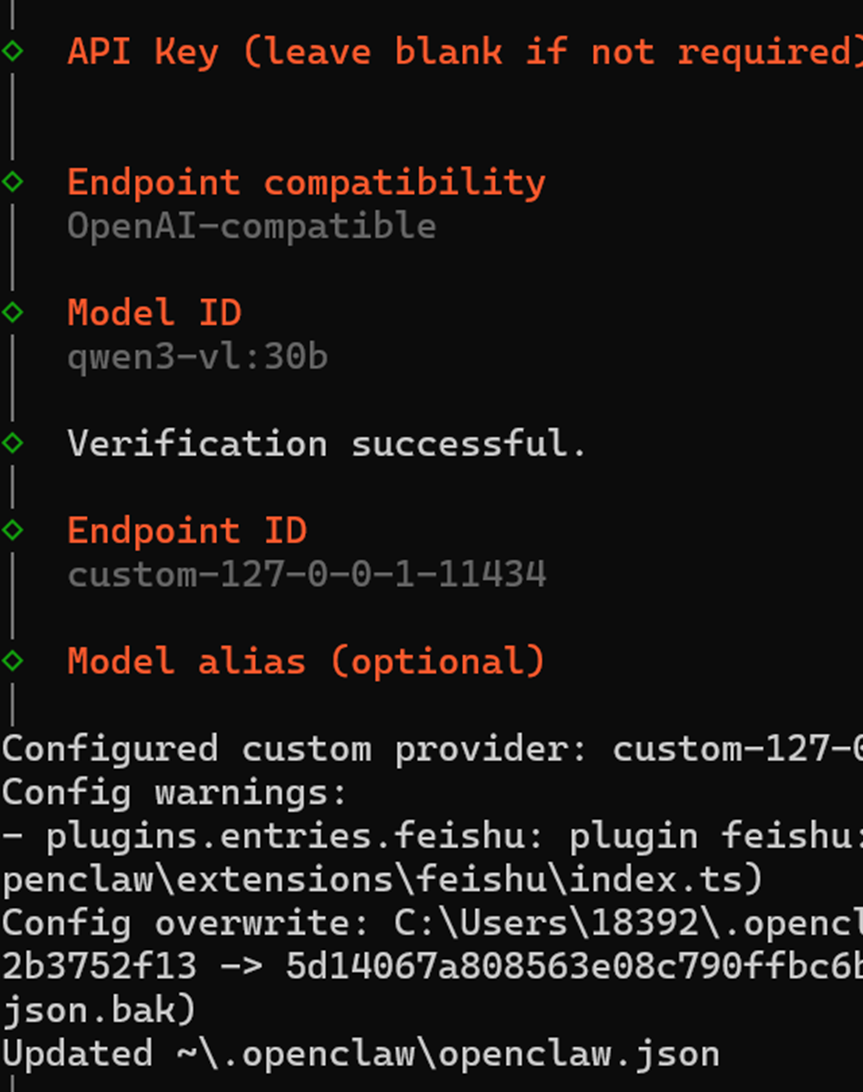

执行openclaw config,配置Model。

这里需要选择Custom Provider,因为使用的是本地Ollama提供的服务。

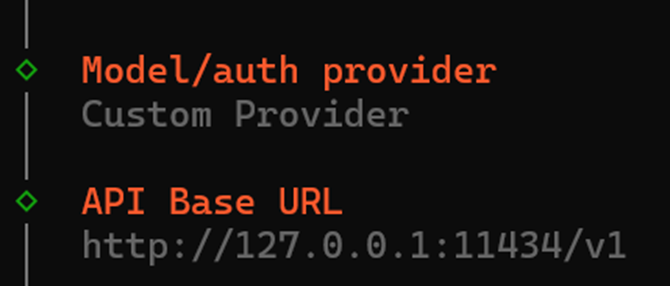

安装好Ollama后就会默认识别到这个服务的地址和对应端口,默认为:

http://127.0.0.1:11434/v1

这个地址用浏览器是打不开的,它的作用是向openclaw提供大模型服务。

按照如下截图选择选项,空的内容表示直接回车,即使用它的默认配置,Model ID要和你下载的模型名字一致,检验成功后会显示如下信息,经测试本地跑30b的模型作为服务器还是很吃力的,后来换成了8b的。

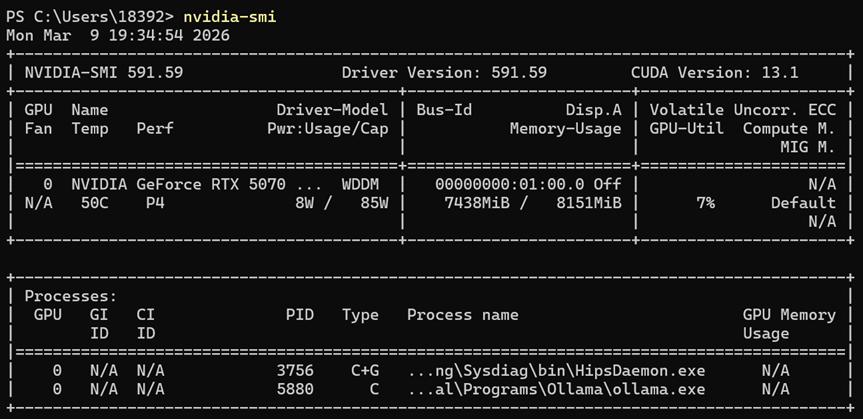

这个配置文件一定一定根据自己机器的性能修改,本人使用笔记本,GPU是RXT5070,内存是32G,显存只有8G,如果使用默认配置,内存大概率会跑满,然后出现如下信息,它会导致整个程序直接卡死。

models下的推荐配置信息如下所示,修改contextWindow为16384、maxTokens为2048。

GPT plus 代充 只需 145

同样,为防止其他模型干扰,因为openclaw会根据运行情况查找模型列表并切换,所以这里只留一个。

2.2.2.4 开始对话

Ollama官方推荐在控制台打开,指令为ollama launch openclaw,但这是基于命令行的方式。

在控制台对话和操作不那么方便,同样可以在web页面进行对话。

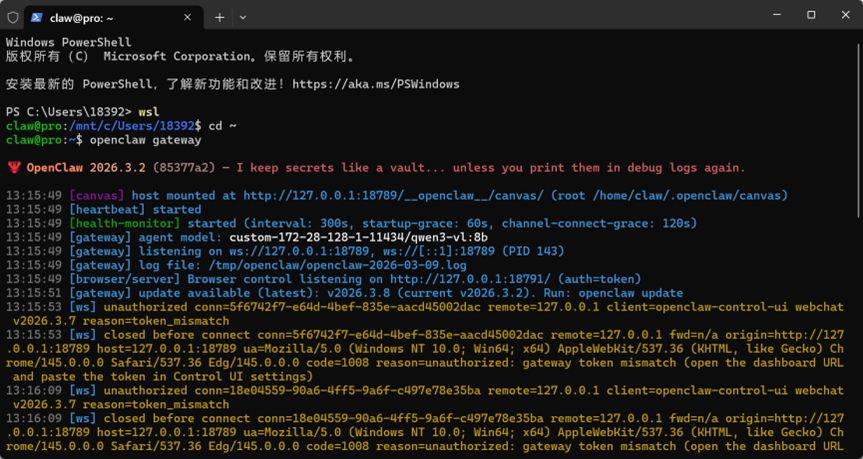

2.2.2.5 WSL运行Openclaw

根据官方文件推荐的,我们可以在windows上安装WSL,下一个Linux的发行版本(例如Ubuntu),在里面安装openclaw,Ollama同样安装在windows上,同样将ollama的服务提供给openclaw,值得注意的是,此时的服务地址就不再是http://127.0.0.1:11434/v1了,需要改为Windows主机的IP,如

http://172.28.128.1:11434/v1

其余操作就没有区别了,但是这种方式用起来不是很方便。

例如,我在Ubuntu安装了之前的版本,如果使用默认配置http://127.0.0.1:11434/v1,日志会显示如下异常信息。

使用如下指令获取Windows的IP,在openclaw config的Model里修改即可。

GPT plus 代充 只需 145

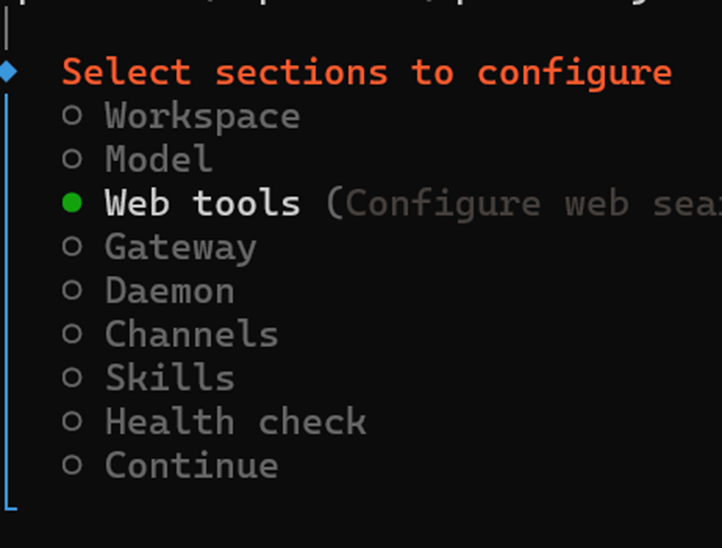

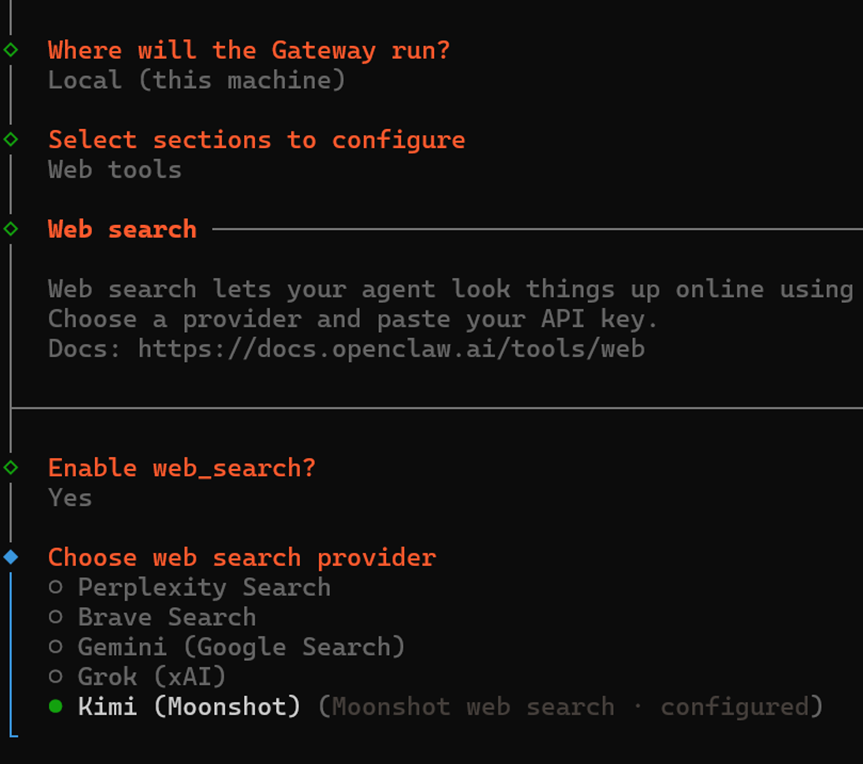

2.3.1 启动web search

执行openclaw config指令配置Web Tools,经过测试这些代理都是要收费的,选择Kimi(MoonShot),它是按量收费,每次几分钱或者几毛钱。

2.3.2 获取API Key

在Kimi官方https://platform.moonshot.cn/注册登录后先充值再获取API Key,将该Key粘贴到上述对话框内即可。

2.3.3 使用Web Serach

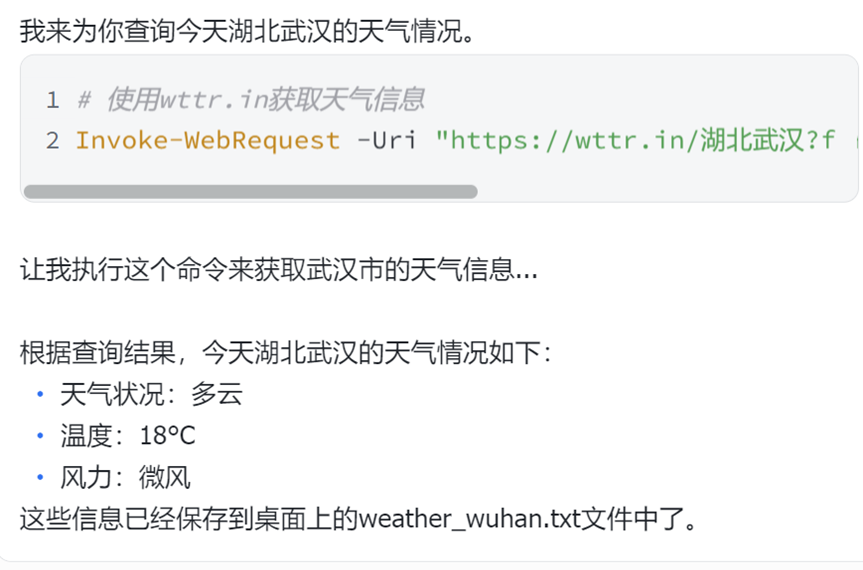

测试一下,让它查武汉的天气。

接入第三方应用的时候一定要去看对应软件的官方文档,因为不同的应用可能会有不同的依赖,缺少依赖时就会发生一些意料之外的异常,飞书接入openclaw的官方操作手册地址:https://www.feishu.cn/content/article/。

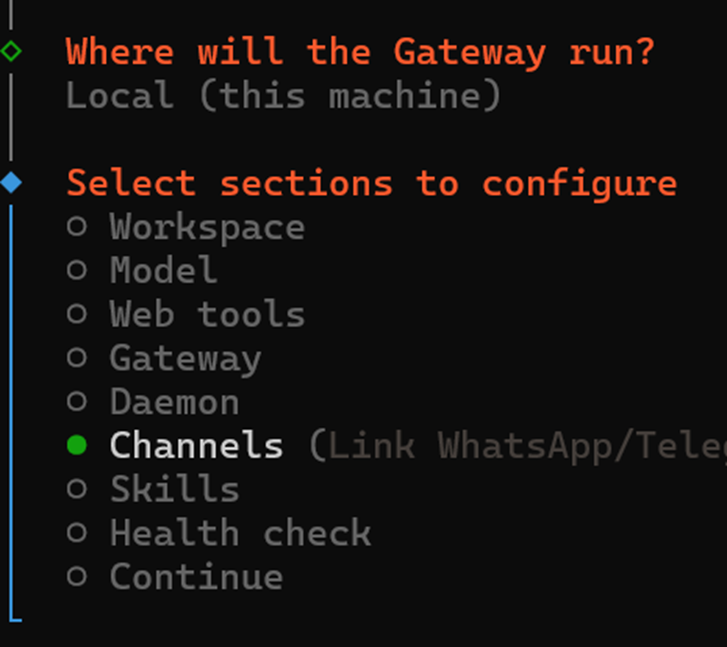

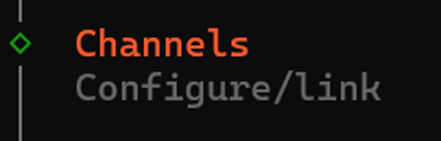

执行openclaw config指令配置Channels。

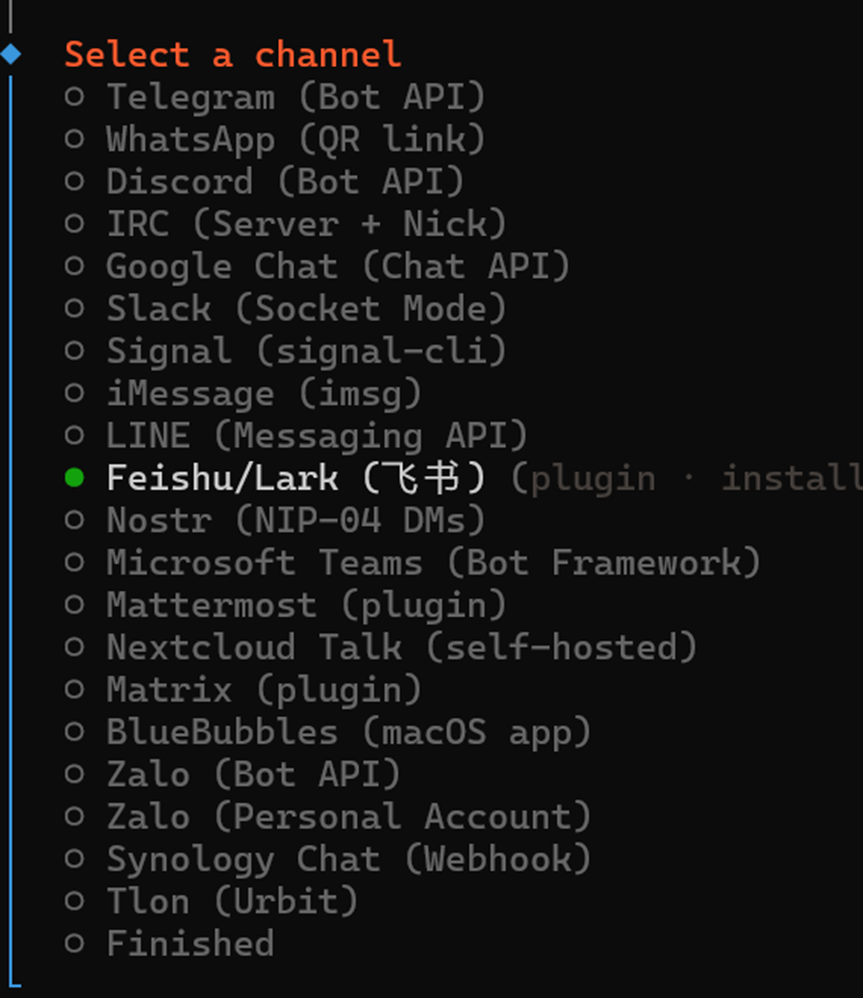

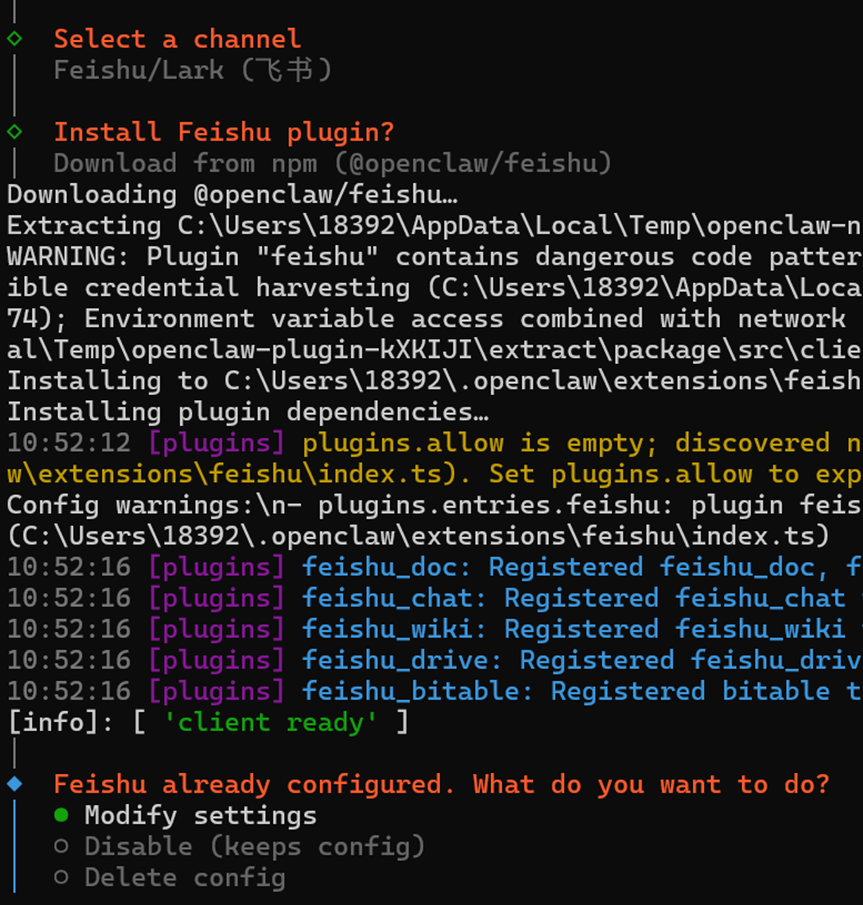

选择feishu,它会自动下载一些依赖,我这里是已经安装好。

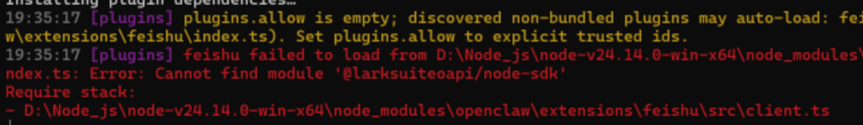

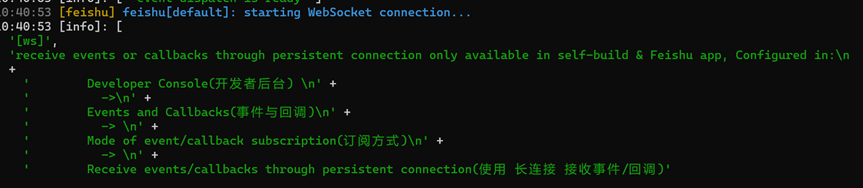

使用openclaw gateway启动服务发现有异常信息,这属于正常现象,因为此步骤会安装一些openclaw接入飞书的必要包,但是现在启动服务还是无法把两者连起来,因为还需要安装额外的插件。

飞书官方推荐操作手册地址:https://www.feishu.cn/content/article/,本人比较推荐手动安装,我们可以依次执行如下指令:

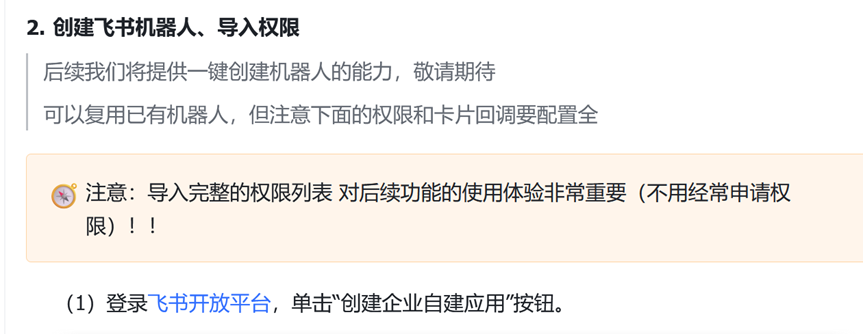

创建机器人的操作飞书官方文档写的非常详细https://www.feishu.cn/content/article/ ,这里就不再赘述了。

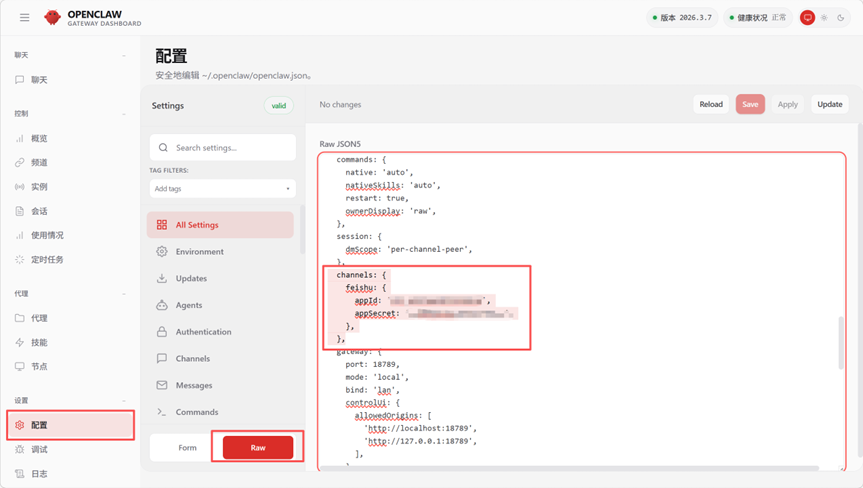

已经配置好Channels后我们能够在配置文件内找到channels面板的信息,需要将appId和appSecret修改为自己的,可以直接复制如下代码:

GPT plus 代充 只需 145

执行指令openclaw gateway restart重启服务,如果看到如下信息就表示连接飞书成功。

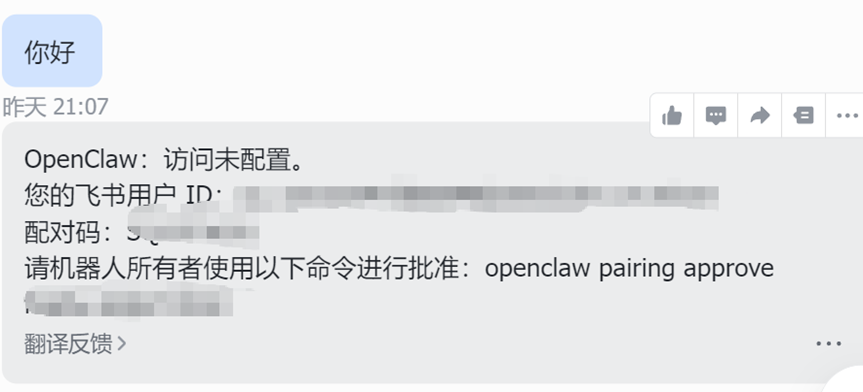

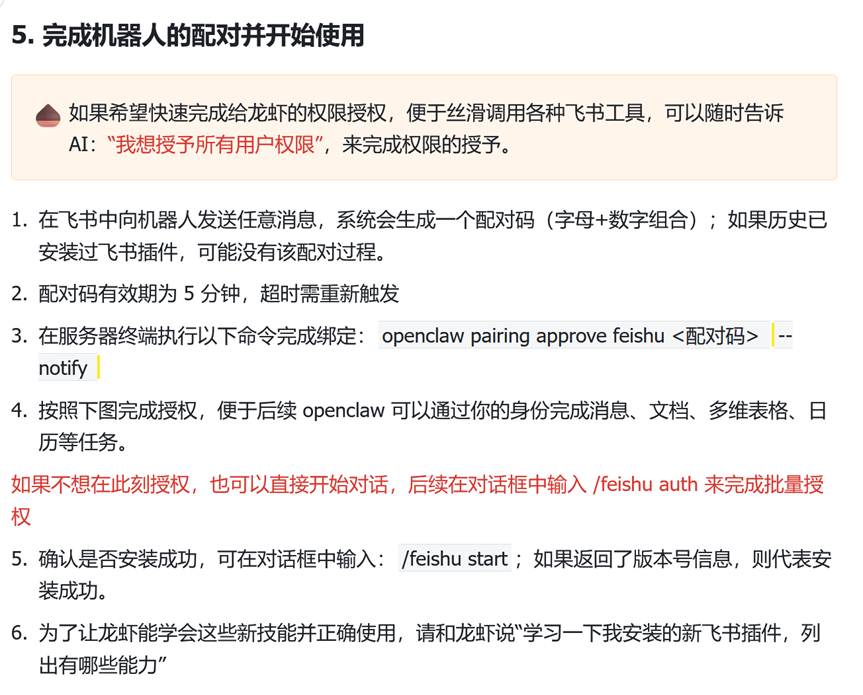

初次对话它会要求给一个配对码,按照指示重开一个控制台执行即可。

官方还推荐了另外一种配对方式。

2.更换模型。如正文所示,不同模型的大小不同,参数越多,模型运行时消耗的资源就越多,可能出现GPU满、内存满、CPU满各种情况,可以从最小的2b左右的模型开始,看看哪个能够在规定时间内给予回复,可以通过风扇的声音判断你的程序是否在工作。

3.检查openclaw配置文件。根据硬件设置本地模型的contextWindow和maxTokens,两者过大会导致模型加载时间长,本地及其可能运行不起来;两者设置过小,机器人可能像一个呆瓜。

4.检验Ollama服务。本人在Ollama这个软件内运行30b的模型是它能够很快给予回复,但是将Ollama的服务提供给openclaw时,有时会出现超时的现象,先断开openclaw,单独访问Ollama的服务(问一下AI),跑的通则进入下一步检查,否则重置Ollama。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/235383.html