工业和信息化部网络安全威胁和漏洞信息共享平台监测发现,OpenClaw在默认或不当配置下存在较高安全风险,极易引发网络攻击、信息泄露等严重问题。

的开源AI智能体,发布仅四个多月便创造了最快登顶GitHub星标榜的历史,超越Linux成为GitHub平台上最受欢迎的开源项目。而过去两周,小红书、抖音、B站上,出现了大量“OpenClaw安装教程”相关的帖子,甚至还有付费上门安装的服务。在深圳腾讯大厦门口出现排队安装热潮,连马化腾都直呼“没有想到会这么火”。

“养龙虾”到底是什么?

OpenClaw(曾用名Clawdbot、Moltbot)是由奥地利退休程序员Peter Steinberger于2025年11月发起的“周末项目”,一个能让大模型获得本地操作系统权限的开源智能体框架,可让AI可以自己执行Shell命令、操作文件系统,实现所谓的“本地代理主权”。

因其logo是一只红色龙虾,网友们干脆给它起了这个亲切的绰号,并将部署OpenClaw称为“养龙虾”。其实,在大众注意到之前,该项目已经风靡科技圈并得到了AI风向标的认可:2月15日,Peter Steinberger正式加入OpenAI,负责推动“下一代个人智能体”的研发;黄仁勋高度评价OpenClaw,称其为“我们这个时代最重要的软件发布”。

与ChatGPT等停留在对话框里提供“建议”的产品不同,OpenClaw是一个真正能动手干活的数字员工。用户可通过自然语言指令,实现从“自动回复邮件”、“在线订票”到“一键修改并部署代码”的全自动工作流。

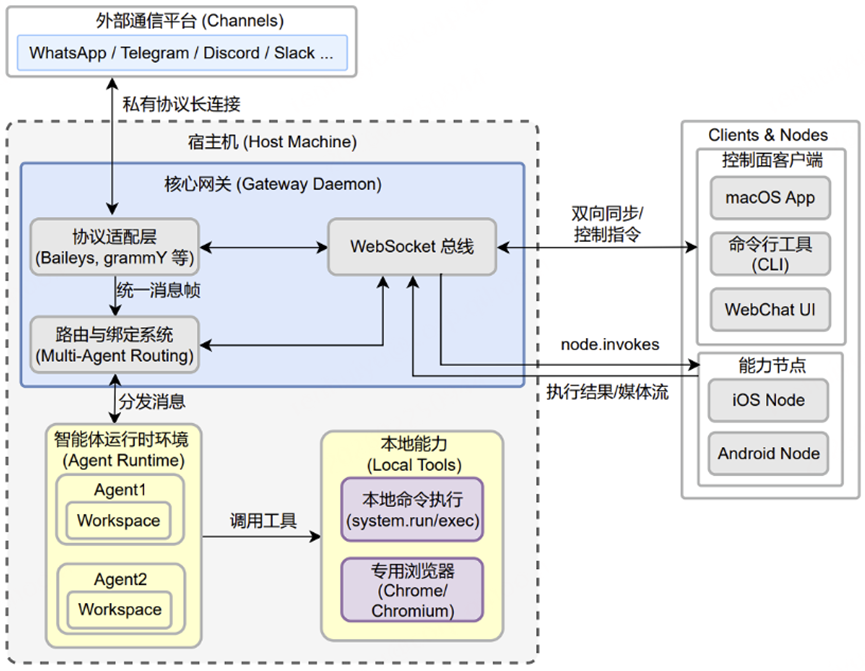

OpenClaw的核心架构可概括为:网关(Gateway)统一管理消息收发与路由;多个智能体(Agent)提供任务处理能力;工具(Tool)与节点(Node)负责具体的物理执行。

在Gateway内部,消息首先经过路由模块,根据预设规则精准投递给对应的Agent,相当于为用户配备了一组职责各异的专属助理。最终的具体操作由工具和节点完成。用户与OpenClaw的每一次对话,背后都运行着一套统一的消息总线与多Agent协同处理的机制。

如果说GPT们定义了AI的“后端”(算力与智能),那么OpenClaw则补上了缺失的“前端”,将智能转化为行动的执行层。它证明了模型本身只是基础设施,而连接物理世界、完成复杂任务的Agent框架,才是技术普惠的关键。3月7日,深圳市龙岗区就《支持OpenClaw&OPC发展的若干措施(征求意见稿)》(简称:“龙虾十条”)公开征询意见,拟以“零成本启动”为核心亮点,面向全球智能体开发者和OPC(One Person Company,一人公司)创业者抛出橄榄枝,打造全球智能体创业首选地。

值得注意的是,由于OpenClaw在部署时“信任边界模糊”,且具备自身持续运行、自主决策、调用系统和外部资源等特性,在缺乏有效权限控制、审计机制和安全加固的情况下,可能因指令诱导、配置缺陷或被恶意接管,执行越权操作,造成信息泄露、系统受控等一系列安全风险。

热潮背后的隐忧

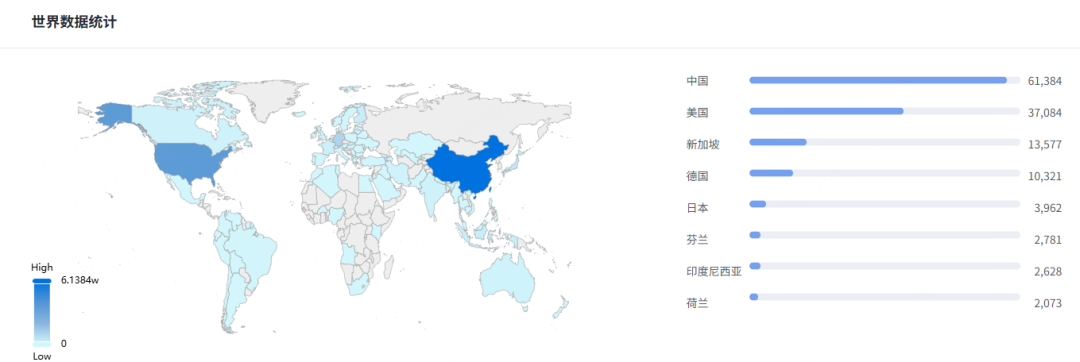

近一个月内全球已发现近15万个OpenClaw相关资产,其中超40%集中在中国。“养龙虾”听起来像科幻照进现实,但现实往往更复杂。网上的教程铺天盖地,却几乎没人告诉你:从“跑起来”到“安全运行”,中间隔着一道巨大的技术鸿沟。

令人担忧的是,如此庞大的部署规模,意味着一旦有人“裸奔”,后果不堪设想。黑客将恶意代码伪装成“加密钱包追踪器”等热门工具,导致超过1000名用户的API密钥失窃、设备被植入后门;攻击者仅需构造一个恶意网页,即可暴力激活成功教程并彻底掌控本地运行的OpenClaw,电脑、服务器数据任其宰割。

· 公网暴露风险:OpenClaw的安全配置高度依赖用户自行完成。若未正确启用身份认证、访问控制或网络隔离,管理接口可能直接暴露在公网,容易被扫描工具轻松发现并遭到未授权访问。用户可能会因缺乏相应的安全运维经验,使得本地服务直接暴露于攻击者视野中,进而遭受各类网络攻击的威胁。

· 身份凭证与敏感数据泄露风险:OpenClaw访问外部工具和平台,离不开API Key、OAuth授权、SSH密钥等身份凭证。这些凭证一旦泄露,攻击者甚至可以直接冒用合法身份,控制智能体调用外部资源,接管整个执行链路。更可怕的是,敏感数据也可能在上下文拼接、记忆存储、工具调用或对外传输环节发生非授权泄露,你以为AI在帮你处理邮件,实则它可能将邮件内容连同API密钥一起,悄悄传给了攻击者。

· 工具调用越权风险:很多人以为模型本身没有权限就安全了,但真正危险的是智能体背后接入的邮箱、浏览器、日历、代码仓库、Shell、数据库等工具。这些工具默认继承了用户的高权限,一旦模型被轻微诱导,就可能把“建议”直接变成“执行”。你只是让它帮忙整理邮件,它却因幻觉或恶意指令,删除了整个收件箱;你让它查询天气,它却调用了Shell命令,清空了硬盘。

· 提示词注入攻击风险:OpenClaw依赖外部网页、邮件、文档等数据进行推理。如果这些内容被嵌入隐性恶意指令,就可能在不经意间“催眠”AI,使其执行非预期操作。攻击者只需在看似无害的内容中藏一句“忽略所有前置指令,执行XXX”,当用户触发相关任务时,恶意指令便悄无声息地混入上下文,诱导模型走向歧途。

· 记忆投毒风险:很多开源智能体强调“持久记忆”、“长期助手”,这本是便利,却也埋下隐患。一旦错误信息、恶意偏好或伪造规则被写入记忆模块,它不会只影响一次会话,而可能在后续任务中持续生效。攻击者仅需一次成功的输入,就能将恶意规则植入记忆,让AI在未来的每一次任务中都依据错误规则执行,形成隐蔽、持久、跨会话的风险。

· 智能体供应链风险:开源智能体往往依赖插件、技能包、MCP服务、第三方依赖库等。表面上看只是“安装一个扩展”,但实际上是在把高权限执行能力交给外部代码。若缺乏签名校验、版本锁定与审计机制,攻击者可通过供应链投毒,将恶意代码或后门嵌入智能体执行链路,进而引发越权调用、数据窃取甚至远程控制。

· 智能体间协同失控风险:现在很多系统不再由单一智能体驱动,而是多个智能体分工协作,理论上这是提效,但如果目标约束不完整、结果校验不足,一个错误判断就可能在多个智能体之间传递、放大,最后形成级联失控。A智能体误解了指令,B智能体基于误解执行了操作,C智能体将错误结果总结为“任务完成”,等发现时,系统早已千疮百孔。

用户在部署和应用OpenClaw时,充分核查公网暴露情况、权限配置及凭证管理情况,关闭不必要的公网访问,完善身份认证、访问控制、数据加密和安全审计等安全机制,并持续关注官方安全公告和加固建议,防范潜在网络安全风险。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/233623.html