在现代科学技术的发展进程中,学术概念的跨语际转移(从一种语言翻译为另一种语言)往往并非简单的词汇对等映射,而是一个充满了语义协商、文化语境适应以及不可避免的意义偏差的复杂过程。在人工智能(Artificial Intelligence, AI)领域,英文术语“Agent”的中文翻译演变,正是这一复杂过程的典型缩影。针对公众与部分业内人士的质疑——即将一个原本在英文语境中极为平实、中性的词汇“Agent”,翻译为带有强烈科幻色彩和拟人化倾向的“智能体”,是否属于一种通过高级词汇进行包装的“言语腐败”(Linguistic Corruption),从而对不了解该技术底层逻辑的大众造成了概念上的误导与误解——这一问题具有极高的学术探讨价值。

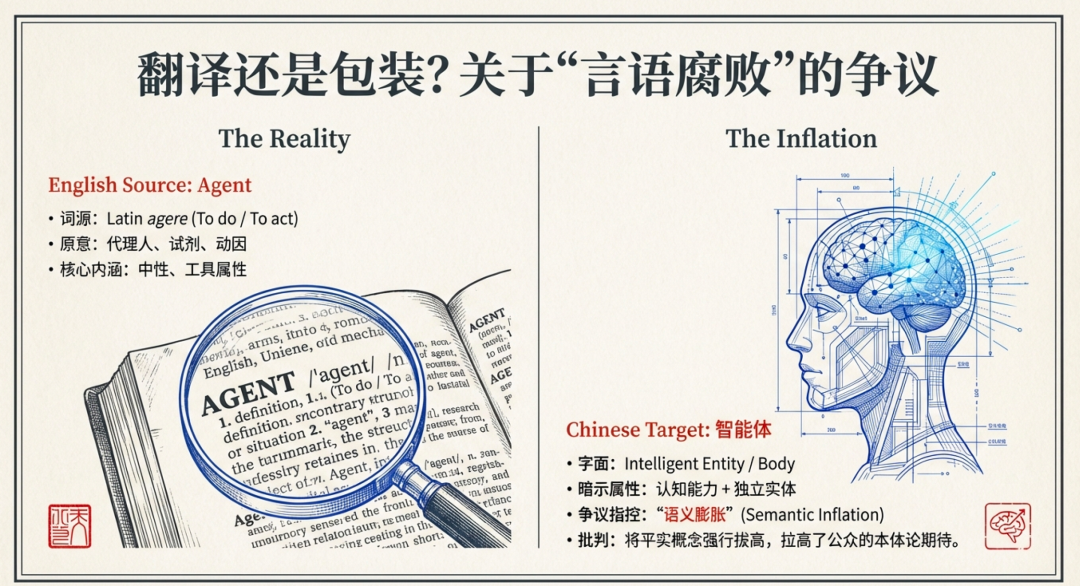

在英文原始语境中,“agent”一词源自拉丁语“agere”,其最基础的含义仅仅是“to do”(去做)或“to act”(行动)。在日常英语中,它可以指代代办处、代理人、甚至化学反应中的试剂。当这个词被引入计算机科学时,它仅仅指代一种能够感知环境并采取行动以实现某种目标的实体。然而,当它被翻译为中文的“智能体”时,其字面意思(Intelligent Entity或Intelligent Body)被强行注入了“智能”(认知能力)与“体”(具有边界的独立实体)的双重高级属性。这种命名方式确实在某种程度上拉高了公众对该技术的本体论期待。

本研究报告将进行详尽的历史考证与技术溯源,全面梳理“Agent”这一概念在西方学术界的本源、在中国人工智能圈子的翻译演变历史、官方权威机构的定名时间节点,以及这种翻译在社会语言学和法学层面所引发的深远影响。同时,本报告也将结合近年来大语言模型(LLM)的突破、具身智能(Embodied AI)的发展,以及垂直领域(如甲骨文研究)中Agent的实际应用,论证为何在当前的技术架构下,这个曾经被视为“过度包装”的译名,正在逐渐与现实技术能力走向历史性的缝合。

要深刻理解中文翻译为何被指责为“言语腐败”,首先必须剥离中文语境,回到“Agent”在西方计算机科学与人工智能理论中的最初定义。在西方学术界,Agent的概念长期以来是被严格限制在数学、逻辑学和控制论的框架之内的,其核心在于“行为”而非“智能”。

经典教科书中的功能主义定义

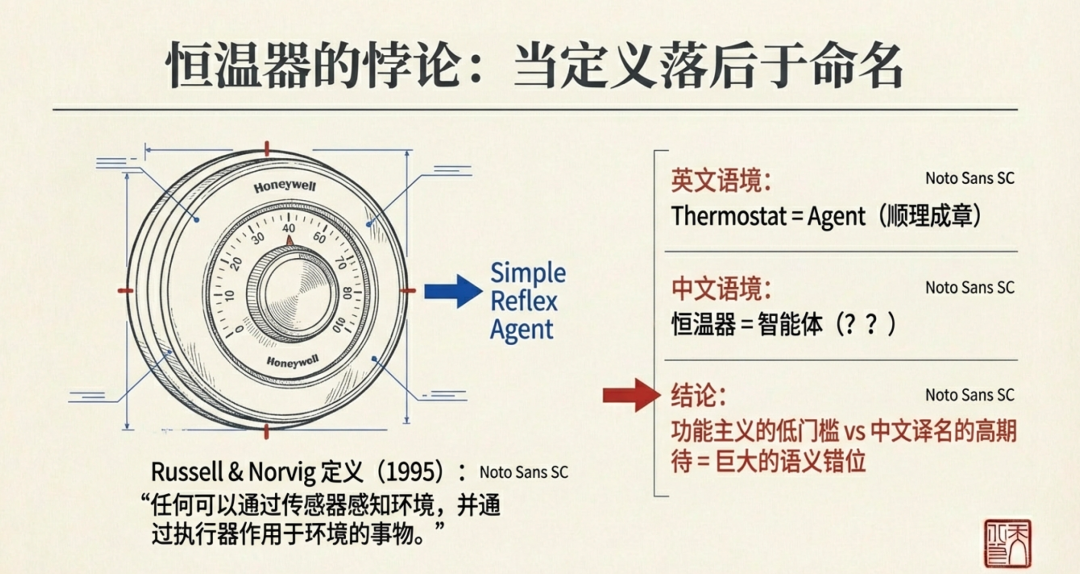

现代人工智能领域对Agent最为权威、最为基础的定义,确立于1995年。当年,人工智能领域的泰斗斯图尔特·罗素(Stuart Russell)与彼得·诺维格(Peter Norvig)出版了被奉为经典的教材《人工智能:现代方法》(Artificial Intelligence: A Modern Approach)第一版。在这部著作中,Agent被定义为“任何可以通过传感器感知其环境,并通过执行器作用于该环境的事物”。

到了2022年,该书的第四版英文版出版(其中文简体字版随后由人民邮电出版社出版,张博雅等人翻译,张志华审校,并由北京大学计算机学院教授黄铁军作序推荐)。在第四版中,作者更加明确地指出,Agent是研究人工智能方法的核心,而人工智能本质上就是关于Agent设计的科学,并辟专章详细论述了Agent的技术原理。

在这种经典的功能主义定义下,Agent的门槛极低。一个能够感知室内温度并在温度低于设定值时自动打开加热器的恒温器(Thermostat),就是一个标准的“简单反射型Agent”(Simple Reflex Agent)。在英文语境中,称呼一个恒温器为“agent”显得顺理成章,因为英文本身并不强加“智能”的先决条件。但如果按照中文的直译,称呼一个简单的恒温器为“智能体”,则显然构成了一种荒谬的语义膨胀(Semantic Inflation)。这也是为何该命名方式被批评为带有“包装”性质的核心原因。

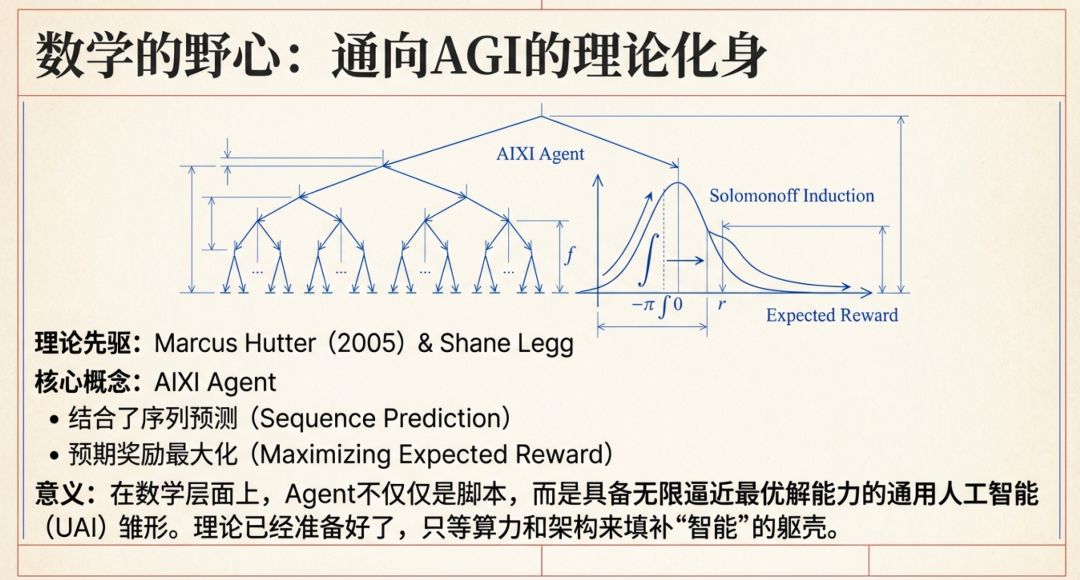

通用人工智能与Agent的数学化身

然而,Agent的概念在学术界并非停留在简单的反射器层面。随着理论的深入,Agent逐渐被赋予了更为复杂的数学内涵,这也是后来中文译者试图在翻译中体现其“高级感”的潜在原因之一。

Google DeepMind的资深研究员马库斯·胡特(Marcus Hutter)在拓宽Agent的理论边界方面做出了奠基性的贡献。他在2005年出版了关于通用人工智能(Universal Artificial Intelligence, UAI)的专著,致力于开发一个结合了序列预测(旨在预测下一个观察值的分布)和行动(旨在最大化预期奖励)的数学理论,因为这些正是Agent在未知环境中交互时所面临的核心问题。

胡特的理论框架引入了所罗门诺夫归纳法(Solomonoff Induction)。该方法提供了一种通用的序列预测方法,通过在所有可计算的序列分布空间上构建一个最优先验,从而使贝叶斯更新能够收敛到真实的预测分布。将所罗门诺夫归纳法与最优行动相结合,就产生了著名的AIXI Agent。在这一极其严谨的理论框架下,AIXI Agent被认为是通用人工智能(AGI)的一个数学化身:它是一个在一般未知环境中以最优方式行动的Agent。

此外,在2007年,Shane Legg与马库斯·胡特在他们的论文(arxiv:0712.3329)中正式提出了“通用智能”(Universal Intelligence)的衡量标准,进一步将Agent的概念与贝叶斯最优策略、Kolmogorov复杂度以及强化学习深度绑定。在这一数学高度上,Agent已经不再是一个简单的执行脚本,而是一个具备无限逼近最优解能力的理论计算实体。

伴随着西方AI理论在20世纪末至21世纪初大量涌入中国,中国本土的学术界不可避免地遭遇了“名词翻译危机”。“人工智能”一词本身最早出现于1956年的达特茅斯会议,而国内探讨人工智能问题最早的研究成果可以追溯到1978年陈步发表的《人工智能问题的哲学探讨》,该文以“智能”一词的哲学含义为起点,拉开了中国学者从理论层面审视AI的序幕。

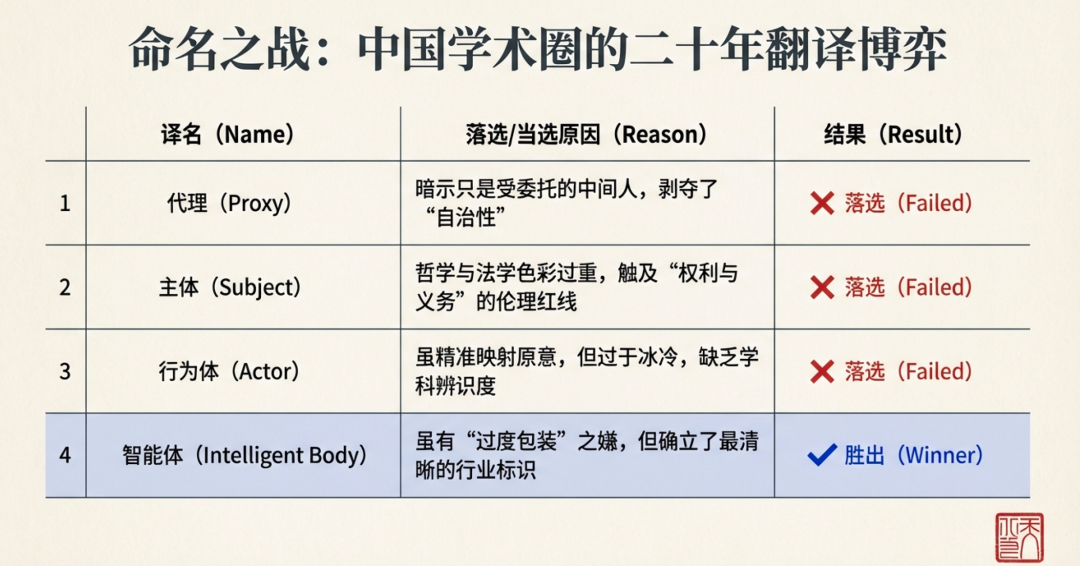

然而,当具体到“Agent”这个词时,由于其在英语中的多义性以及在计算机科学中的特定抽象含义,中国学术界经历了长达二十余年的翻译混战。根据法学与科技学者寿步在2022年发表的《人工智能中agent的中译正名及其法律意义》一文中的详细考证,Agent在中国学术圈曾有过多种截然不同的中文翻译。以下通过对比表详细梳理这些早期译名及其演变逻辑:

“Agent”早期中文译名比较与社会语言学分析

在20世纪90年代末到21世纪初的学术论文中,国内学者为了避免歧义,往往在正文中直接使用英文“Agent”,或者在首次出现时标注“Agent(代理/智能体/主体)”。此时,整个中国AI圈子并没有一个统一的称呼。

关于用户提出的核心疑问——“最早是什么时候叫做‘智能体’的?是谁第一个这样叫出来的?”——我们需要从科学史的严谨角度进行拆解。

首先,在非正式的学术讨论、内部实验室手稿或早期的硕博论文中,将Agent试探性地翻译为“智能体”的行为,散见于20世纪90年代中后期引进多智能体系统(Multi-Agent Systems, MAS)理论的过程中。然而,科学名词的诞生往往是一个从民间试用、学界争论到官方收编的渐进过程,极难(也无必要)归功于某一个特定的个体。实际上,在互联网概念广泛传播的早期,甚至在1992年尼尔·斯蒂芬森(Neal Stephenson)的科幻小说《雪崩》(Snow Crash)首次提出“元宇宙”(Metaverse)概念时,关于虚拟世界中自主行为实体的构想就已经在萌芽,并为后来“智能体”在数字孪生与智慧博物馆等领域的应用埋下了伏笔。

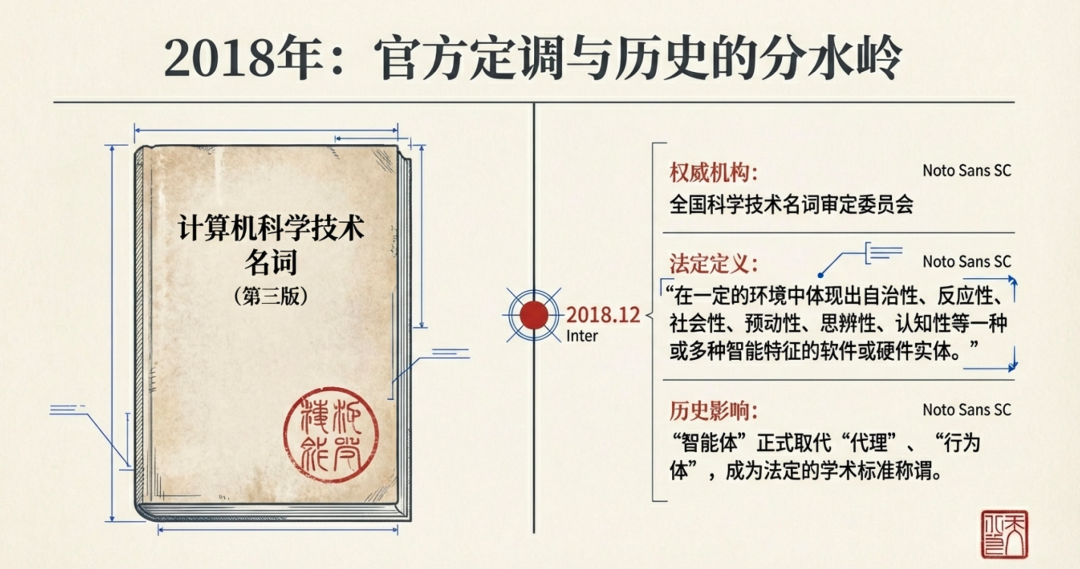

但是,具有绝对历史分水岭意义、真正将“智能体”作为中国AI圈唯一标准官方术语的时间节点是:2018年12月。

这一历史性的定名是由中国最高级别的科技名词规范机构——全国科学技术名词审定委员会(National Committee for Terms in Sciences and Technologies)所做出的。根据该委员会公布并由科学出版社于2018年12月出版的《计算机科学技术名词(第三版)》,在“计算机科学技术—人工智能—多智能体系统”这一学科分类项下,官方正式给出了“agent”的唯一标准中文译名:“智能体”。

自此之后,无论是在中国学术界的顶级期刊发表论文、申请国家自然科学基金,还是科技企业发布产品白皮书,“智能体”正式取代了“代理”、“行为体”等一切存在争议的曾用名,成为了法定的标准学术称谓。可以说,是2018年底的官方审定,完成了这一概念的最终“加冕”。

用户的质疑非常犀利且具有深刻的学术洞察力:将“Agent”命名为“智能体”,确实具有“言语腐败”或“语义膨胀”的特征。

为什么说它是一种“包装”与“误解”?

在计算机与人工智能专业技术领域,全国科学技术名词审定委员会对“智能体”给出的官方定义是:“在一定的环境中体现出自治性、反应性、社会性、预动性、思辨性(慎思性)、认知性等一种或多种智能特征的软件或硬件实体。”

如果我们将这一定义与Russell和Norvig在1995年给出的极简定义(感知环境并采取行动的事物)对比,就会发现中文定义在内涵上进行了极其庞大的“加码”。英文的Agent只要求“行动”(Act),而中文的“智能体”则在定义中塞入了“自治、社会、预动、思辨、认知”等一系列高级认知心理学词汇。

这种词汇的拔高,在面向不了解英文原文的中国大众时,不可避免地会造成误解。当普通民众听到某个互联网大厂发布了全新的“智能体”时,由于汉字“智”(智慧、认知)和“体”(生命体、有机体)的天然构词法暗示,公众很容易在脑海中勾勒出一个具有自我意识、能够像人类一样思考的硅基生命雏形。而事实上,在很多早期的应用中,这个所谓的“智能体”可能仅仅是一组包含了若干“If-Then”条件判断语句的简单决策树算法。用“智能体”来包装一个简单的算法,确实验证了用户所批评的“完全就不是什么高大上的概念,却用了这样的词来包装”的观点。

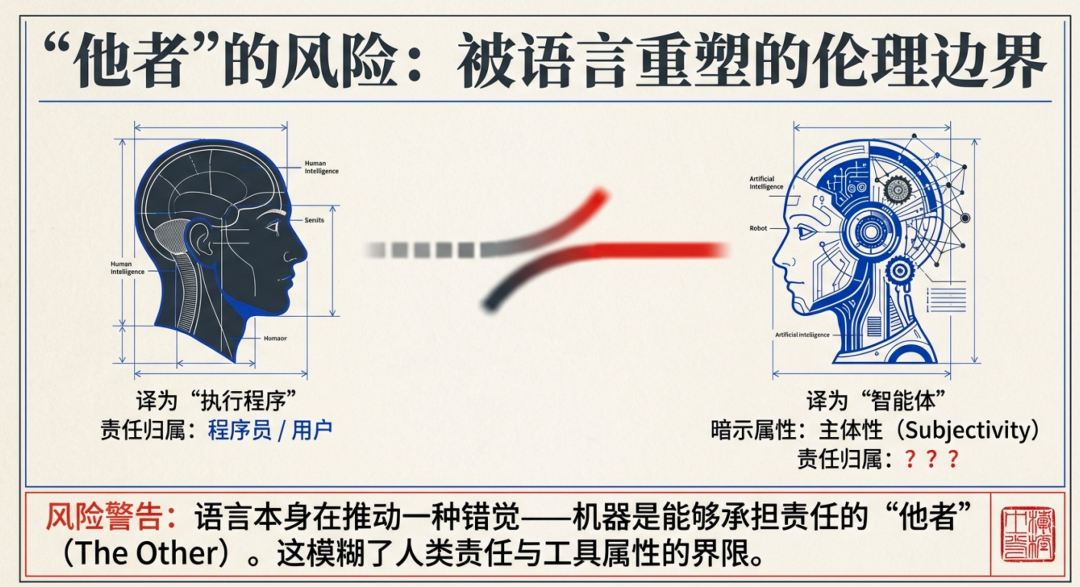

伦理与法学视角的“他者”效应

这种命名不仅影响了大众的认知,也深刻影响了中国人工智能伦理学和法学的研究轨迹。在目前的学术界,围绕“道德智能体”(Moral Agent)的讨论日益激烈。有学者指出,在当前的科学技术环境中,如果从“他者”(The Other)的视角赋予人工智能所期望的责任,那么人工智能在行为过程中就将成为某种程度的道德能动者、责任承担者、道德实践者。

试想,如果中文将Agent翻译为“执行代理程序”,那么当自动驾驶汽车发生事故时,责任溯源会自然而然地指向背后的程序员或汽车制造商。但是,当这个系统被郑重其事地命名为“智能体”时,语言本身就在暗示它具有某种程度的“主体性”。这种翻译无形中推动了学界去探讨“智能体是否能够为其行为承担责任”,从而在某种程度上模糊了人类责任与机器工具之间的界限。

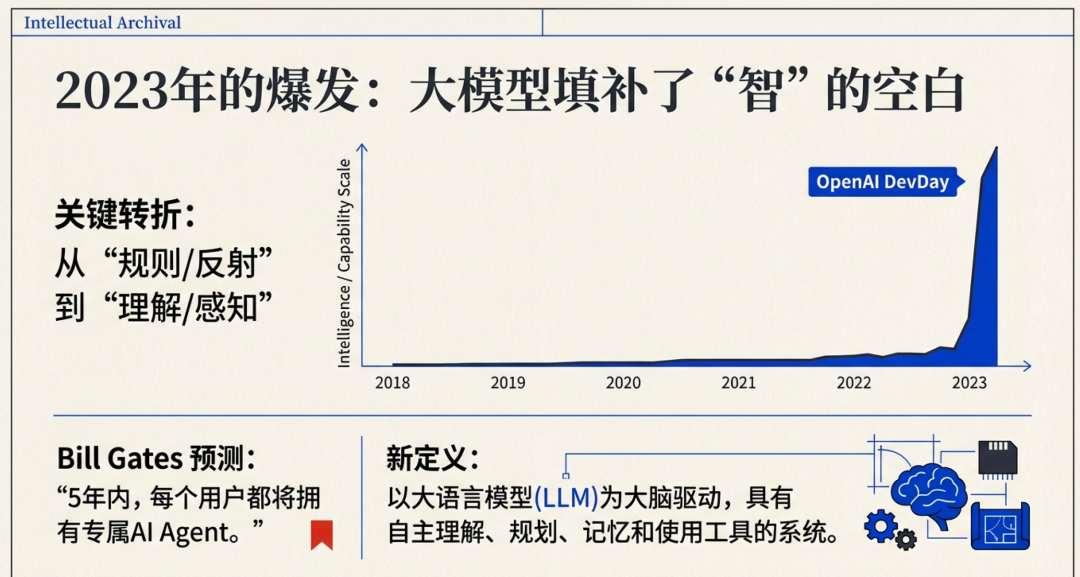

虽然“智能体”这一命名在早期(如规则引擎时代)确实有过度包装之嫌,但历史的吊诡之处在于,随着2023年以来大语言模型(LLM)技术的爆发性突破,原本带有极强科幻色彩的“智能体”一词,竟然开始与真实的底层技术能力相匹配了。技术的发展,意外地为当年略显夸张的翻译提供了现实的注脚。

大模型驱动的现代Agent架构

进入2023年末,AI Agent无疑成为了当下大模型最激动人心的发展主线,甚至被业界普遍称为“大模型下一场战事”、“最后的杀手产品”以及“开启新工业革命时代的Agent-centric(以智能体为中心)”。

2023年11月7日,OpenAI举办了首届开发者大会(OpenAI DevDay),这次大会彻底引爆了AI Agent的概念。OpenAI不仅发布了AI Agent的初期形态产品GPTs,还推出了相应的制作工具GPT Builder,并开放了包括视觉、图像DALL·E3、语音在内的大量新API以及Assistants API,让用户只需通过自然语言对话就能生成专属的GPT。正如比尔·盖茨所断言的:5年内AI Agent将大行其道,每个用户都将拥有一个专属AI Agent,用户不再需要使用不同的APP,只需用日常语言告诉他的Agent想做什么即可。甚至有学者断言,“美国Agent Store(智能体商店)发展得好,这会令中美大模型差距持续拉大”。

在这一全新的技术范式下,OpenAI将AI Agent重新定义为:“以大语言模型为大脑驱动,具有自主理解感知、规划、记忆和使用工具的能力,能自动化执行完成复杂任务的系统”。2024年,Google公司和Anthropic公司也相继发布了《Agents》白皮书和《Building effective agents》技术文件,详细描述了构建AI Agent的复杂技术框架。

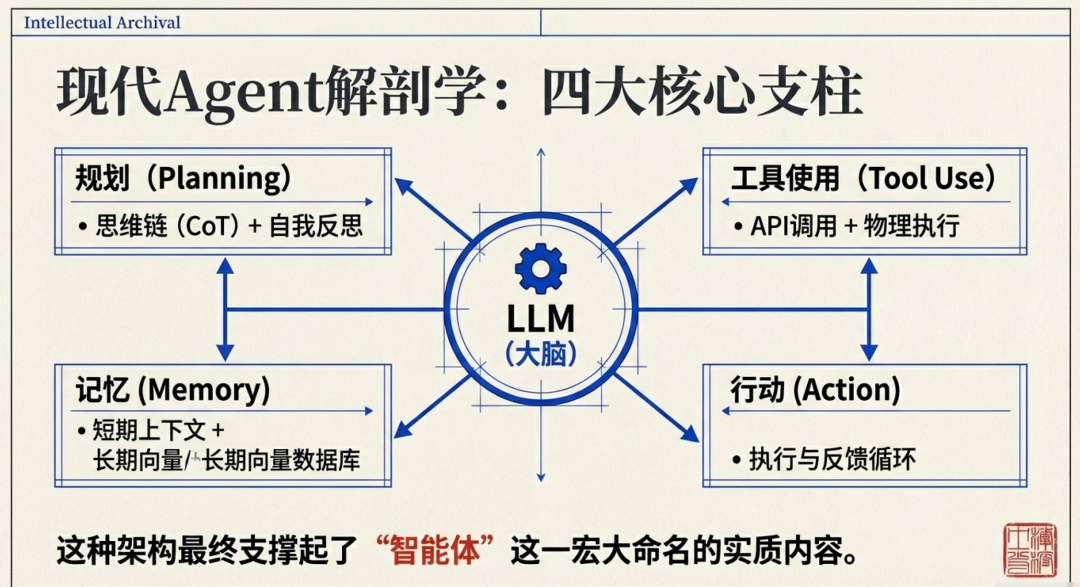

现代基于LLM驱动的智能体框架,其能力已经远远超越了简单的代理程序,主要包含以下四个核心模块,这四个模块的存在,使得“智能体”的称呼变得名副其实:

在这样的架构下,AI Agent已经具备了独立思考、调用工具并逐步完成给定目标的能力,真正成为了连接现实世界与数字世界的桥梁。此时,称呼它为“智能体”,不再是言语腐败,而是对其实际认知与执行能力的最准确概括。

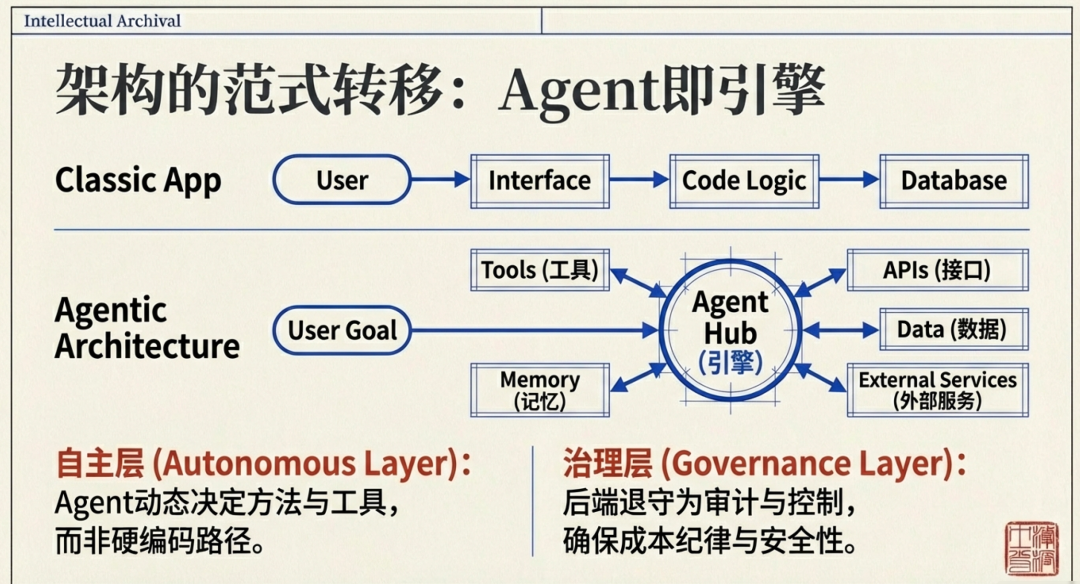

企业架构的深层范式转移

现代智能体的发展正在引发整个软件工程架构的剧变。根据技术专家Eran Stiller在2025年发表的分析指出,软件架构正在经历一场深刻的转变:AI Agent正在成为核心的“执行引擎”,而后端系统则逐步撤退到“治理层面”。

在这种新型的架构中,自主层(Autonomous Layer)使得Agent能够动态确定自己的方法并自主决定如何使用工具。这种转变要求组织在部署Agent系统时,优先考虑简单、可组合的架构,并将重点放在治理上。关键能力包括:嵌入式可观察性以监控Agent的自主行为、带有审计跟踪的安全控制,以及防止资源消耗失控的成本纪律(Cost Discipline)。所有这些治理机制都必须从架构的初始阶段就内置进去,而不是在部署后进行改装。这一趋势在垂直领域表现得尤为明显,例如Phrase推出的“AI翻译智能体”,它结合了基于生成式AI的翻译和AI译后编辑功能,能够自动应用术语、品牌声音和质量保证(QA)规则,从而提供始终如一的高质量输出,大幅减少了对人工审核和手动检查的依赖。

为了进一步印证“智能体”一词在当今技术语境下的合理性,我们必须考察该概念向物理世界和极度专业化领域的延伸。

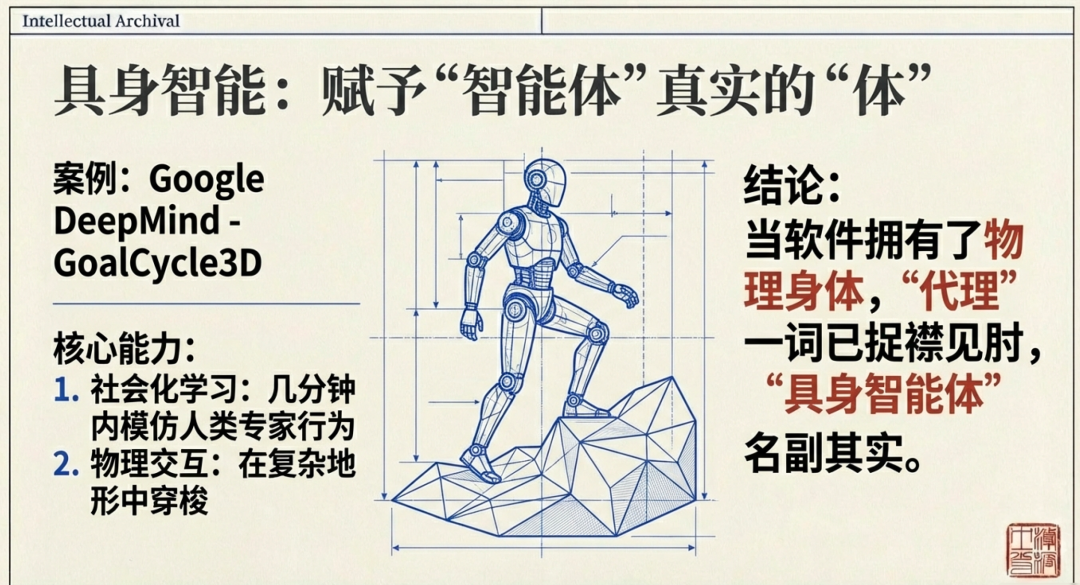

具身智能体的物理交互

“智能体”的“体”字,在“具身智能”(Embodied AI)的发展中得到了最完美的诠释。2024年度,由全国科学技术名词审定委员会事务中心联合多家机构发起的十大科技名词评选结果中,“具身智能”与人工智能+、低空经济、量子科技等一同入选,反映了科技发展的时代脉搏。

具身AI是指有物理身体并支持与真实或模拟的物理环境进行交互的智能体。它通过智能体与环境的交互来获取信息、理解问题、做出决策并执行行动,从而展现出高度的适应性。2024年,国内外在具身智能领域取得重要进展,成功推出了多款能够在不确定环境中进行自主感知和决策的具身智能机器人,并深化了其在自动驾驶(特别是动态交通环境中的决策)中的应用。

在学术前沿,《自然·通讯》(Nature Communications)于2023年11月28日发表的一篇论文中,谷歌“深度思维”(DeepMind)团队展示了一个革命性的AI智能体。在一个名为GoalCycle3D的3D物理模拟任务空间中,这个智能体能够在第一次见到的任务中,极迅速地模仿人类专家,实时可靠地获取来自人类搭档的知识。传统的智能体通常需要在监督下从大量第一人称数据中学习,既昂贵又费时;而DeepMind训练的这个智能体,仅仅通过几分钟的互动就能发现并模仿专家的行为,甚至能在充满大量障碍的复杂地形中穿梭,并在个体神经元中同时编码物理信息和社会信息。

这种能够从效率和隐私上与人类相仿的其他个体那里进行“社会化学习”的能力,标志着AI实现快速知识传播的概念验证,也是朝着人类与AI开放式互动的文化演变迈出的第一步。面对这样一个能够编码社会信息、在3D环境中与人类协同演化的系统,沿用“代理”一词显然已经捉襟见肘,而“具身智能体”则精准描绘了其技术形态。

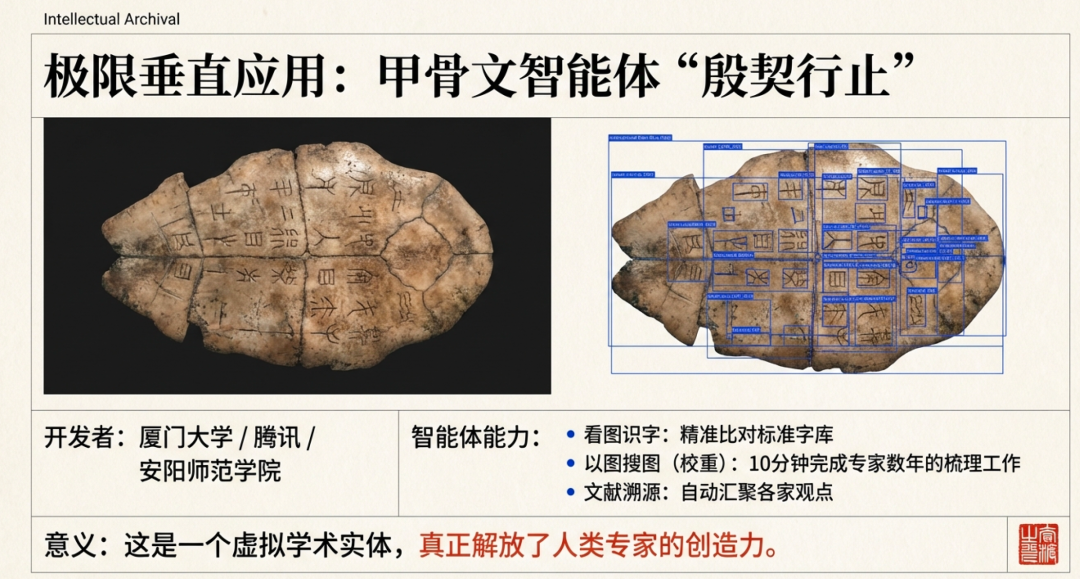

极限垂直应用:全球首个甲骨文智能体“殷契行止”

除了物理世界的具身智能,在人类最为艰深晦涩的人文学科领域,智能体也展现出了惊人的自主研究能力。2025年12月12日,由厦门大学人工智能研究院甲骨文研究团队(负责人为金泰松教授)与腾讯公司、安阳师范学院联合研发的全球首个甲骨文智能体——“殷契行止”正式上线,并通过小程序“了不起的甲骨文”向公众免费开放。

甲骨文研究长期以来面临着“识别难、比对难、共享难”三大历史性挑战。甲骨拓本图像是研究的基础,即把龟甲、兽骨上的文字用宣纸和墨印下来。由于上百年的收藏与流转,大部分甲骨留下了多个版本的拓本(被称为“重片”),对这些重片进行系统整理被称为“校重”。这是一笔规模极其庞大的“糊涂账”,传统上需要耗费学者数年的心血。

“殷契行止”智能体的出现彻底改变了这一现状,它使AI首次具备了“理解古文字”的能力。该智能体的核心能力包括:

- 看图识字与精准比对:用户只需上传一张含有甲骨文字的图片,AI即可精准比对标准字库完成文字识别,给出权威释义和参考文献。

- 文献溯源:识别出单字后,AI会自动查找该字在哪些甲骨和拓片中出现过,快速汇聚各家释读观点和演变历史,省去大量翻找资料的时间。

- 全自动甲骨校重(以图搜图):其“拓片重见检索功能”能够快速比对海量数据库,找出同一片甲骨的不同拓片版本或相似字形的甲骨,帮助追踪流传轨迹。过去需要专家数年才能完成的梳理工作,该智能体只需10分钟即可完成。

金泰松团队表示,开发这一智能体的目的并非替代专家,而是将专家从重复的劳动中解放出来,把精力留给真正的破译与思考。在这一案例中,系统自主完成了资料检索、图像比对、观点汇编等一系列原本需要极高人类认知参与的科研工作。将其称为“智能体”,恰如其分地体现了其作为“虚拟学术研究实体”的地位。

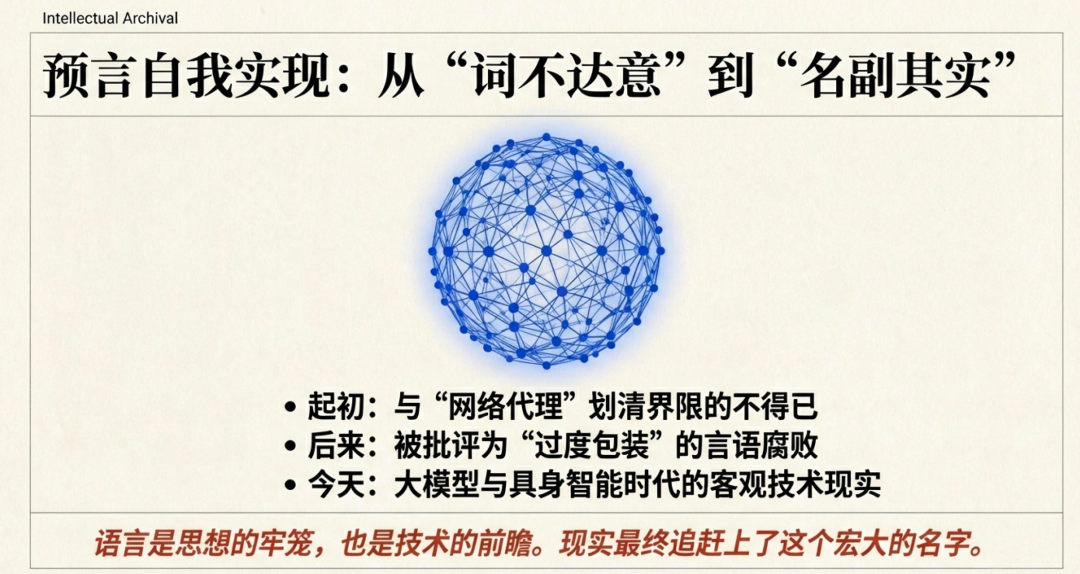

综上所述,关于人工智能领域“Agent”一词的中文翻译与历史演变,本研究得出以下具有决定性意义的结论:

第一,关于定名的时间节点与权威主体。虽然“智能体”这一词汇在20世纪90年代末至21世纪初的学术翻译中就已开始酝酿与试用,但真正将其确立为国家级标准、彻底结束译名混乱的时间是2018年12月。这并非某一个个体学者的灵光一现,而是由中国官方机构——全国科学技术名词审定委员会在《计算机科学技术名词(第三版)》中正式一锤定音的。

第二,关于“言语腐败”与“过度包装”的指控。用户的这一批评在历史语境中是完全成立且极具学术价值的。英文“Agent”本意平实,仅仅强调其执行与感知的能力。在早期的计算机科学和简单规则驱动的人工智能系统中,将其翻译为带有强烈认知暗示与实体化色彩的“智能体”,客观上确实构成了一种语义膨胀与技术概念的过度包装。这种包装不仅拉高了大众的预期,引发了不必要的误解,也在伦理学层面过度前置了关于人工智能主体性与道德责任(Moral Agent)的探讨。

第三,历史进程中的技术缝合。尽管这个译名在诞生之初存在包装嫌疑,但技术发展的指数级跃升正在重塑语言的合理性。自2023年末大语言模型(LLM)驱动的新一代AI Agent爆发以来,以及具身智能(Embodied AI)在物理世界中的成功交互,如今的Agent已经具备了深度的记忆机制、复杂的任务规划能力、自主的工具调用权限以及在物理或虚拟空间中的社会化学习能力。无论是颠覆传统软件架构的执行引擎,还是能够在10分钟内完成数年甲骨文校重研究的“殷契行止”系统,当前的系统已经真正具备了高度发达的“智能”与独立运作的“实体”特征。

语言是思想的牢笼,也是技术的前瞻。将Agent翻译为“智能体”,起初或许是一场为了与网络“代理”(Proxy)划清界限而不得已为之的“言语腐败”,但随着大模型时代的全面降临,现实中的技术框架最终追赶上了这个原本过于宏大和科幻的词汇,完成了一场从“词不达意”到“名副其实”的历史性闭环。

AI行业迎来前所未有的爆发式增长:从DeepSeek百万年薪招聘AI研究员,到百度、阿里、腾讯等大厂疯狂布局AI Agent,再到国家政策大力扶持数字经济和AI人才培养,所有信号都在告诉我们:AI的黄金十年,真的来了!

在行业火爆之下,AI人才争夺战也日趋白热化,其就业前景一片蓝海!

我给大家准备了一份全套的《AI大模型零基础入门+进阶学习资源包》,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。😝有需要的小伙伴,可以VX扫描下方二维码免费领取🆓

人才缺口巨大

人力资源社会保障部有关报告显示,据测算,当前,*我国人工智能人才缺口超过500万,*供求比例达1∶10。脉脉最新数据也显示:AI新发岗位量较去年初暴增29倍,超1000家AI企业释放7.2万+岗位……

单拿今年的秋招来说,各互联网大厂释放出来的招聘信息中,我们就能感受到AI浪潮,比如百度90%的技术岗都与AI相关!

就业薪资超高

在旺盛的市场需求下,AI岗位不仅招聘量大,薪资待遇更是“一骑绝尘”。企业为抢AI核心人才,薪资给的非常慷慨,过去一年,懂AI的人才普遍涨薪40%+!

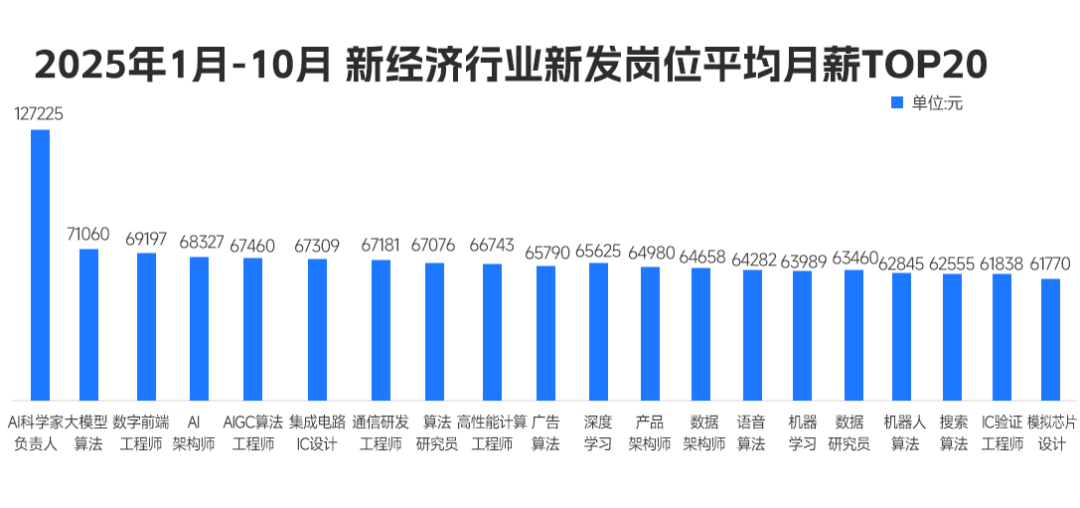

脉脉高聘发布的《2025年度人才迁徙报告》显示,在2025年1月-10月的高薪岗位Top20排行中,AI相关岗位占了绝大多数,并且平均薪资月薪都超过6w!

在去年的秋招中,小红书给算法相关岗位的薪资为50k起,字节开出228万元的超高年薪,据《2025年秋季校园招聘白皮书》,AI算法类平均年薪达36.9万,遥遥领先其他行业!

总结来说,当前人工智能岗位需求多,薪资高,前景好。在职场里,选对赛道就能赢在起跑线。抓住AI风口,轻松实现高薪就业!

但现实却是,仍有很多同学不知道如何抓住AI机遇,会遇到很多就业难题,比如:

❌ 技术过时:只会CRUD的开发者,在AI浪潮中沦为“职场裸奔者”;

❌ 薪资停滞:初级岗位内卷到白菜价,传统开发3年经验薪资涨幅不足15%;

❌ 转型无门:想学AI却找不到系统路径,83%自学党中途放弃。

他们的就业难题解决问题的关键在于:不仅要选对赛道,更要跟对老师!

我给大家准备了一份全套的《AI大模型零基础入门+进阶学习资源包》,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。😝有需要的小伙伴,可以VX扫描下方二维码免费领取🆓

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/233290.html