在实战应用中,部署一个稳定、可靠的网络爬虫系统是许多开发者和运维人员面临的挑战。今天,我想分享一个基于 InsCode(快马)平台 构建的 高可用生产部署方案。这个方案不仅仅是让爬虫跑起来,更是从工程化角度出发,确保它在复杂多变的网络环境中能够稳定、高效、可监控地运行,真正满足生产级的需求。

- 项目背景与核心目标: 作为一个功能强大的网络抓取工具,在单机测试时可能表现良好,但一旦投入生产环境,就会暴露出诸多问题。例如,目标网站的反爬策略升级、服务器突发故障、抓取任务堆积导致内存溢出、日志散落难以排查问题等。因此,我们的部署方案必须围绕 稳定性、可扩展性 和 可观测性 这三个核心目标来构建。这不仅仅是运行一个脚本,而是构建一套具备容错、弹性伸缩和全方位监控的服务体系。

- Docker容器化:统一环境与快速交付:生产环境部署的第一步,就是解决“在我机器上能跑”的困境。我们采用 Docker 进行容器化。首先,编写一个 ,基于一个轻量级的 Python 镜像,将 的源代码、依赖包列表()一并复制进去,并在容器内执行依赖安装。这样,无论在哪个服务器上,只要拉取这个镜像,运行环境就是完全一致的。更进一步,我们使用 文件来定义整个服务栈。在这个文件里,我们可以声明性地配置 服务、数据库服务、日志收集器服务等,它们之间的网络连接、依赖关系一目了然。通过一个简单的 命令,整个系统就能一键启动,极大地简化了部署和运维的复杂度。

- 高可用与负载均衡:告别单点故障:单个爬虫实例是脆弱的,网络波动、目标网站封禁IP都可能导致服务中断。因此,高可用配置至关重要。我们的方案支持启动多个 容器实例。这些实例本身是无状态的,抓取任务由外部的消息队列(如 Redis 或 RabbitMQ)进行分发。我们在 中可以通过 参数轻松指定实例数量。同时,在前端配置一个 Nginx 作为负载均衡器,将外部的 API 请求或调度指令均匀地分发到后端的多个 实例上。这样,即使其中一个实例崩溃,Nginx 会自动将后续请求转发到其他健康的实例,服务不会中断。结合健康检查机制,可以自动重启失败的容器,实现服务的自愈。

- 集成日志管理系统:让问题无处遁形:生产系统没有日志就像在黑暗中航行。我们将 的运行日志(包括访问日志、错误日志、抓取统计等)进行集中管理。在代码层面,我们使用 Python 的 模块,将日志格式化为 JSON 等结构化格式,而不是简单的文本行。然后,在容器内部署一个轻量级的日志采集 Agent(如 Filebeat),它负责实时监听日志文件的变化,并将日志数据发送到中心化的日志存储系统。这里我们提供了两种方案:一是发送到 Elasticsearch 集群,配合 Kibana 进行强大的搜索、分析和可视化;二是对于资源有限的环境,可以配置为滚动写入本地文件系统,并定期归档。无论哪种方式,都确保了日志的集中存储、长期保留和便捷查询,为故障排查和性能分析提供了坚实的数据基础。

- 性能监控与告警:从“救火”到“预防”:仅仅有日志还不够,我们需要主动感知系统的健康状况。我们实现了一个性能监控模块。这个模块会定期(例如每分钟)收集关键指标:抓取成功率(成功请求数/总请求数)、平均响应时间、队列堆积任务数、以及容器本身的 CPU/内存使用率。这些指标通过一个简单的 HTTP 端点暴露出来。然后,使用 Prometheus 这样的监控系统来抓取这些指标,并存储在时间序列数据库中。最后,在 Grafana 中配置监控仪表盘,实时展示这些指标的变化曲线。更重要的是,我们需要设置告警规则,例如“连续5分钟抓取成功率低于95%”或“内存使用率超过80%”。当触发告警时,可以通过 Webhook 通知到钉钉、企业微信或邮件,让运维人员能在用户感知到问题之前就介入处理,变被动为主动。

- 数据持久化与备份策略:保障数据资产安全: 抓取的数据是核心资产,必须安全存储。我们的方案将抓取到的结构化数据(如文章标题、内容、发布时间等)自动写入到数据库中,例如 PostgreSQL 或 MySQL。在 中,数据库作为一个独立服务运行,数据目录通过卷(volume)挂载到宿主机,避免容器销毁时数据丢失。对于非结构化的原始页面或文件,我们保存到对象存储(如 MinIO)或网络附加存储(NAS)中。同时,必须设计备份策略:对数据库进行每日全量备份和每小时增量备份,备份文件加密后传输到另一台离线服务器或云存储服务上。我们编写 Shell 脚本,利用 定时任务来自动化执行备份和清理旧备份的操作,并记录备份日志,确保在极端情况下数据可恢复。

- 部署与运维实践要点:在具体实施时,还有一些细节需要注意。例如,所有配置文件(数据库连接串、消息队列地址、日志级别等)都应通过环境变量注入容器,而不是硬编码在代码中,这提高了配置的灵活性。密钥信息(如 API Token)应使用 Docker Secret 或专门的密钥管理服务。此外,我们还需要编写详细的 文档,说明如何构建镜像、如何通过环境变量配置、如何查看日志和监控、如何进行扩缩容等。一个清晰的项目结构和文档,是项目能否顺利移交和长期维护的关键。

通过以上七个方面的系统化构建,我们成功将一个简单的爬虫脚本,升级为具备生产级韧性的数据采集服务。这个过程涉及了容器化、编排、监控、日志、备份等多个 DevOps 领域的实践,虽然看起来步骤不少,但每一个环节都是为了解决实际生产中会真实遇到的问题。

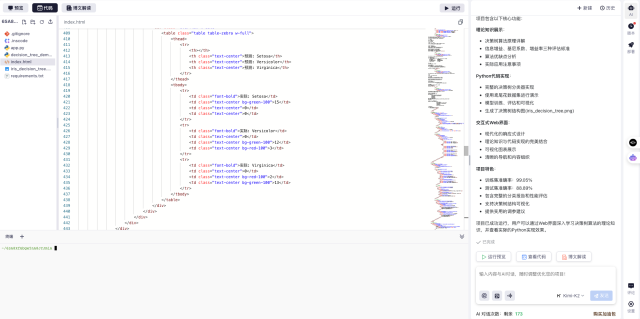

整个方案的代码和配置,我都是在 InsCode(快马)平台 上完成的。这个平台最让我省心的地方在于,它提供了一个开箱即用的云端开发环境。我不需要在本地折腾 Docker 和 Python 环境,打开浏览器就能直接开始编写 、 和各种脚本。它的 AI 对话功能在我编写配置遇到疑问时(比如某个 Docker 指令的详细用法)也能快速提供参考,加快了搭建速度。

最关键的是,对于这样一个包含多个服务的项目,平台的一键部署功能简直太方便了。我不需要自己去租服务器、安装 Docker、配置网络。在 InsCode 上,我可以直接将这个包含完整编排配置的项目部署成一个在线的、持续运行的服务。部署后,我就能通过生成的外链访问到负载均衡器,测试抓取接口,并且实时观察日志和监控指标是否正常上报。这种“编码即部署”的体验,让我能更专注于方案设计本身,而不是繁琐的运维准备工作。对于想快速验证一个复杂服务架构是否可行的朋友来说,这个平台确实是个很实用的工具。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/232034.html