随着多模态技术的持续迭代,OpenAI 推出了基于 GPT-4o 架构的原生多模态文本-图像生成与编辑模型——gpt-image-1,该模型于 2025 年 3 月以 GPT-4o 图像生成功能首次亮相,4 月 23 日正式定名并开放 API,同时登陆 Microsoft Azure OpenAI 服务,全面替代并升级了此前的 DALL·E 系列模型,为图像生成领域带来了全新突破。

gpt-image-1 凭借四大核心能力,成为当前多模态图像生成的标杆产品:

- 高精度文本转图像:支持 1024×1024、1024×1536、1536×1024 等主流尺寸,可精准解析复杂文本提示,图像内文字渲染清晰度 显著优于早期 DALL·E 系列,解决了此前生成图中文字模糊、乱码的痛点。

- 灵活的图像编辑能力:上传参考图配合文字指令,可实现局部修改、风格迁移、重绘等操作,专用的蒙版编辑头进一步提升了编辑精准度,支持「图生图+指令微调」的组合创作。

- 强跨模态整合:直接继承 GPT-4o 的世界知识与指令理解能力,可处理长文本描述、多物体空间关系、精细风格指定(如「复古胶片风+日系动漫角色+手写体标题」),指令遵循度大幅提升。

- 安全与溯源保障:生成图像默认嵌入 C2PA 元数据,搭配严格的内容安全过滤机制,兼顾商用合规性与内容溯源需求。

版本更新

- 2025 年 10 月 DevDay:推出 ,成本较标准版降低约 80%,适配轻量化、高并发的生成场景;

- 2025 年 12 月 16 日:迭代至 ,编辑精度、生成速度双提升,API 调用成本下降约 20%。

计费模式(按 Token 计费)

类型 单价 文字输入 $5/1M tokens 图像输入 $10/1M tokens 图像输出 $40/1M tokens

实际生成成本参考(1024×1024 尺寸):

- 低质量:约 $0.011/张

- 中质量:约 $0.042/张

- 高质量:约 $0.166/张

维度 gpt-image-1 DALL·E 3 底层架构 GPT-4o 解码器+视觉适配器(原生多模态) 独立扩散模型外挂 文字渲染 清晰稳定,支持 logo/标题/数字生成 易模糊、乱码,文字效果差 编辑流程 对话内连续编辑,无需反复上传 需重新上传图片,编辑流程割裂

要开始使用 OpenAI 的服务,你首先需要获取一个 API Key。以下是获取 API Key 的详细步骤:

1. 访问 OpenAI

在浏览器中点击 OpenAI 。

2. 创建账户

- 点击网站右上角的“Sign Up”或者选择“Login”登录已有用户。

3. 进入 API 管理界面

- 登录后,导航到“API Keys”部分。

4. 生成新的 API Key

- 在 API Keys 页面,点击“Create new key”按钮,按照提示完成 API Key 的创建。

注意:创建 API Key 后,务必将其保存在安全的地方,避免泄露。

现在你已经拥有了 API Key 并完成了充值,接下来是如何在你的项目中使用 GPT-4.0 API。以下是一个简单的 Python 示例,展示如何调用 API 生成文本:

代码解析

- 导入库:首先导入必要的库。

- 设置 API Key:通过环境变量设置 API Key。

- 调用 API:发送一个包含问题的请求到 GPT-4.0 模型。

- 打印响应:打印出模型生成的答案。

通过这段代码,你可以轻松地与 OpenAI 的 GPT-4.0 模型进行交互,获取你所需的文本内容。✨

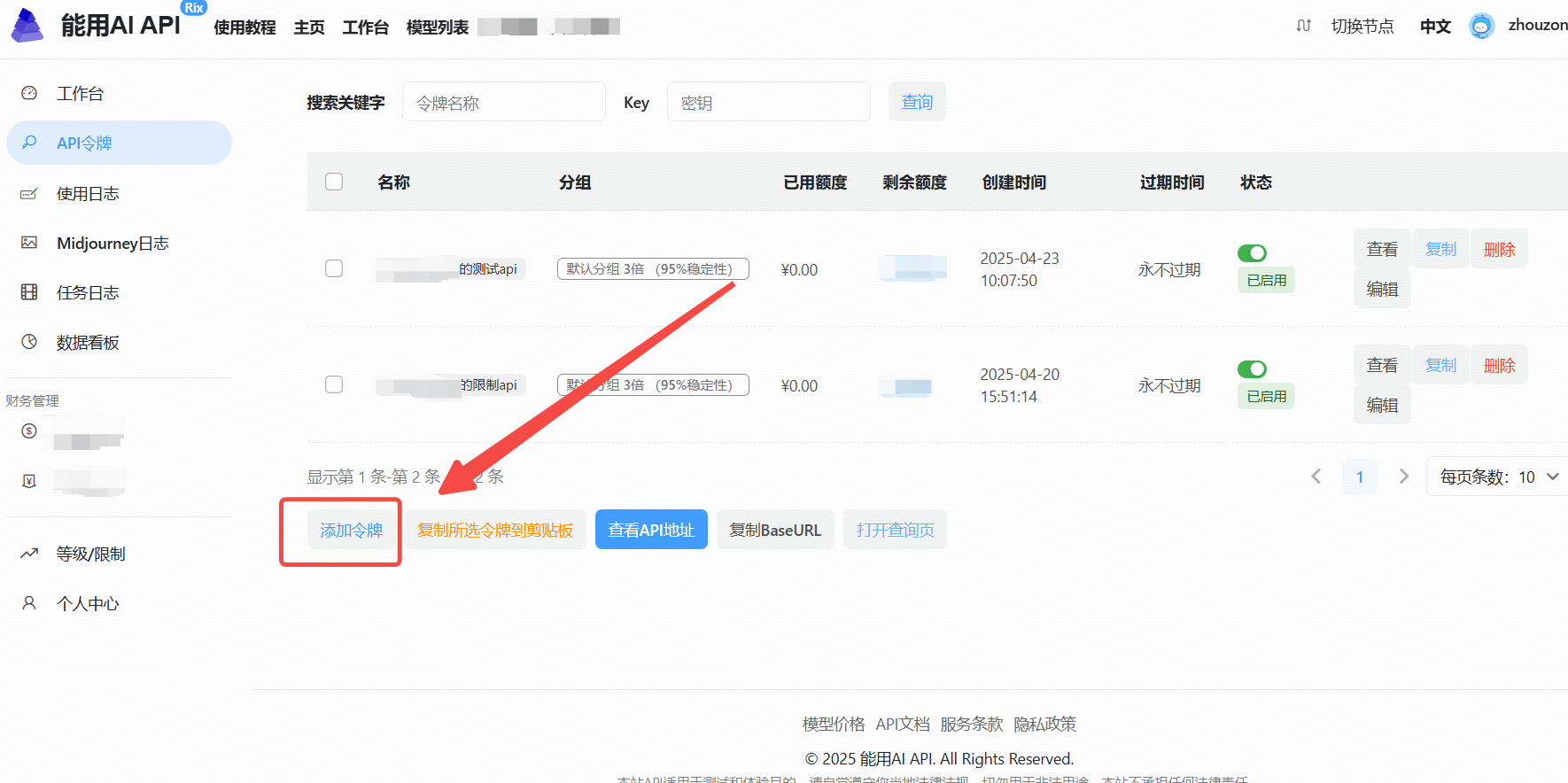

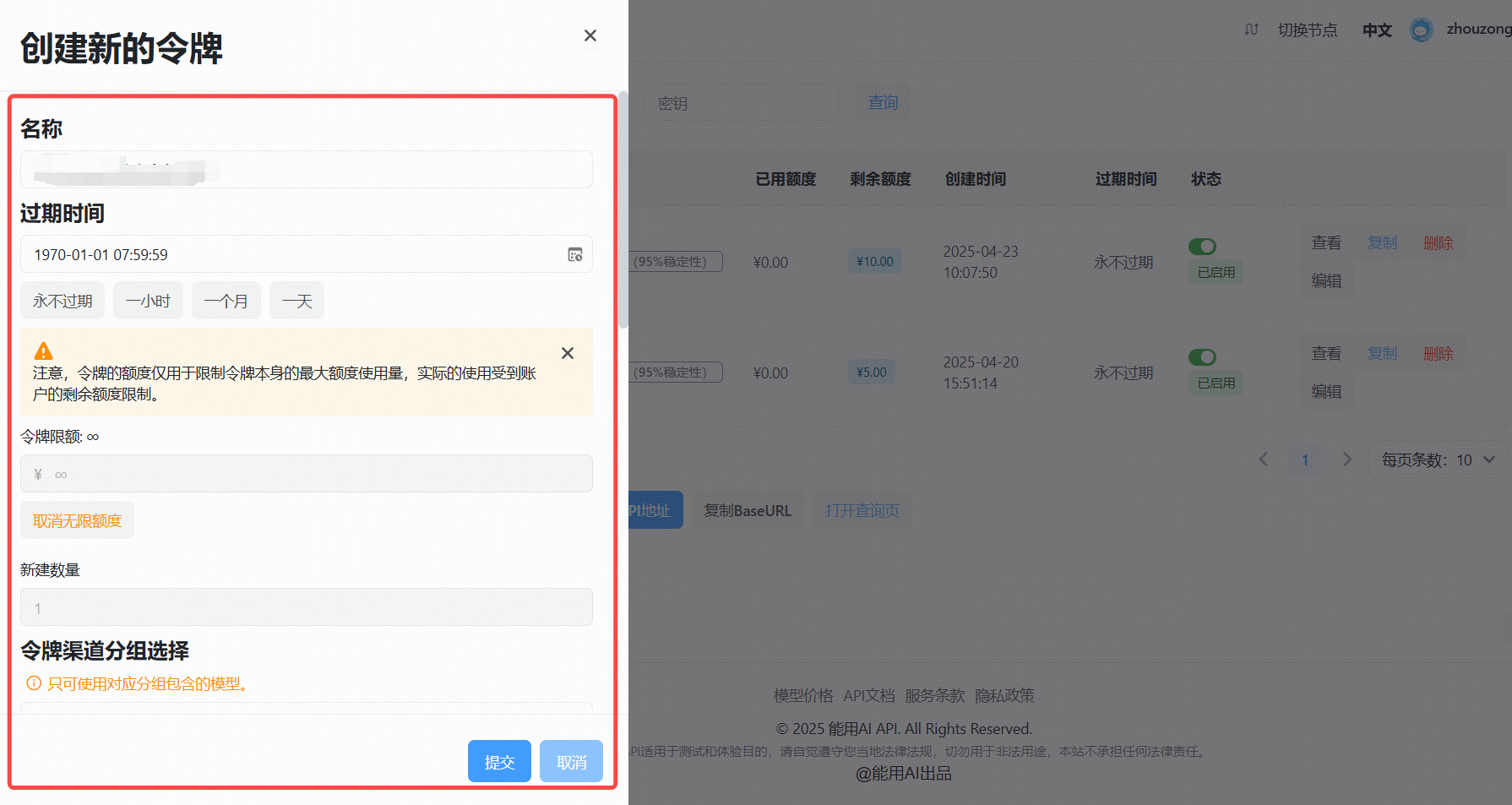

要开始使用 能用AI 的服务,以下是获取 API Key 的详细步骤:

1. 点击 [能用AI 工具]

在浏览器中打开 能用AI 工具。

2. . 进入 API 管理界面

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/230839.html