OpenClaw(龙虾)是一款开源AI执行中枢,核心功能是调用大模型作为“大脑”,打通本地软件与网络服务,自动完成文件管理、设计出图、文档生成、批量处理等任务。本报告重点阐述Windows系统下,如何通过免费API、开源工具、免费Skills,实现“龙虾”的全程免费部署、运营与优化,无需商业软件授权、云服务器费用及大模型付费调用,兼顾新手友好与实用性,所有操作均适配Word文档阅读习惯,步骤清晰、可直接落地。

当Windows本地设备算力不足(如无独立显卡、内存较低),或需处理复杂任务时,免费API可作为零成本算力兜底方案。

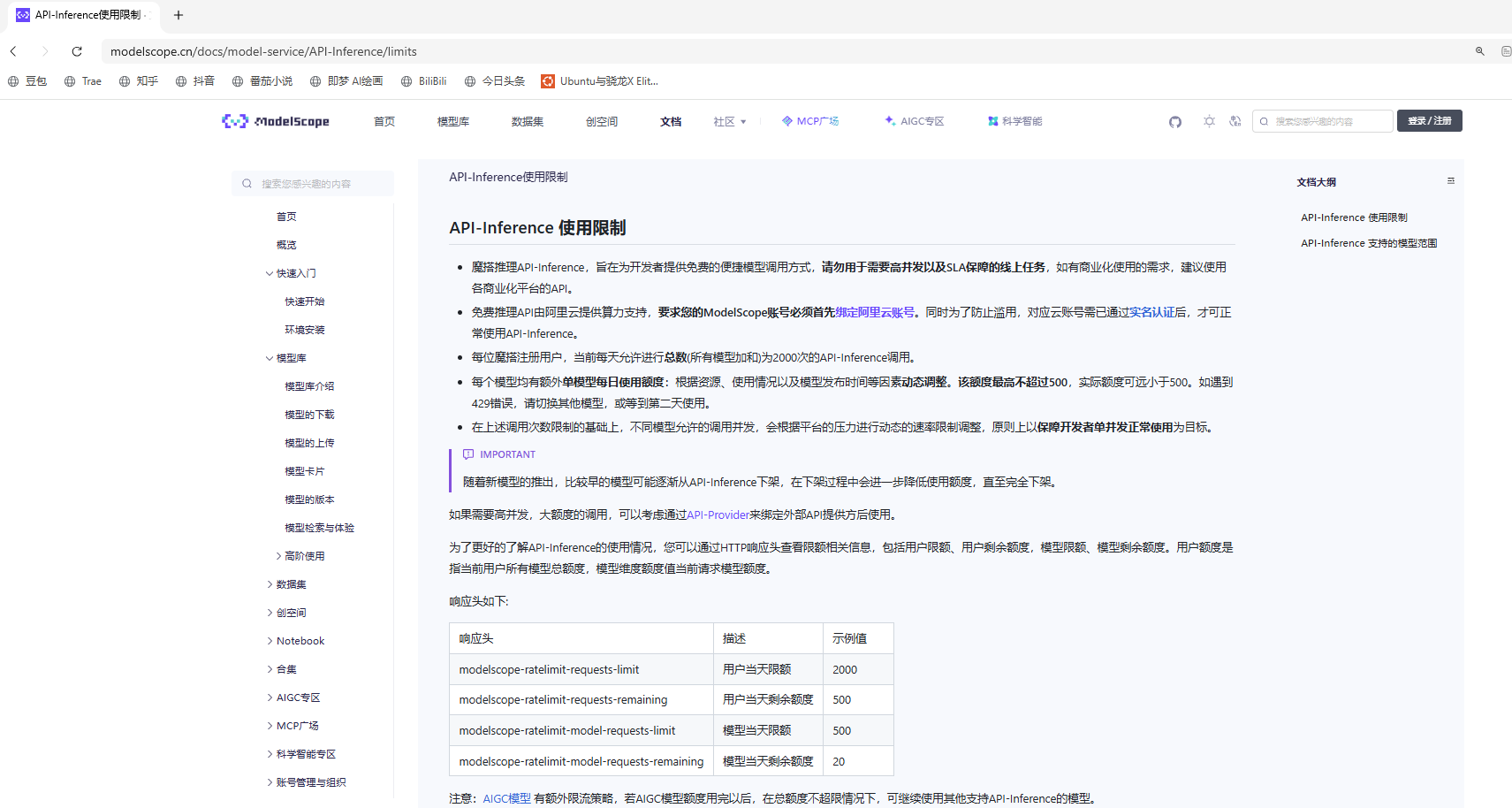

魔搭社区 (ModelScope)

1. 官网:ModelScope 魔搭社区

2. 免费额度:每日总计2000次API调用

3. 限制:单个模型每日上限500次,需绑定阿里云账号

4. 详情查看:https://www.modelscope.cn/docs/model-service/API-Inference/intro

Google Gemini API

1. 官网:https://aistudio.google.com/

2. 注意事项:需要使用网络代理工具访问

模型

类别

RPM

TPM

RPD

gemini-2.5-flash

文本输出模型

5

250K

20

gemini-2.5-flash-lite

文本输出模型

10

250K

20

gemini-2.5-flash-tts

多模态生成模型

3

10K

10

gemini-3-flash

文本输出模型

5

250K

20

gemini-robotics-er-1.5-preview

其他模型

10

250K

20

gemma-3-12b

其他模型

30

15K

14.4K

gemma-3-1b

其他模型

30

15K

14.4K

gemma-3-27b

其他模型

30

15K

14.4K

gemma-3-2b

其他模型

30

15K

14.4K

gemma-3-4b

其他模型

30

15K

14.4K

gemini-2.5-flash-native-audio-dialog

Live API

无限制

1M

无限制

速率限制

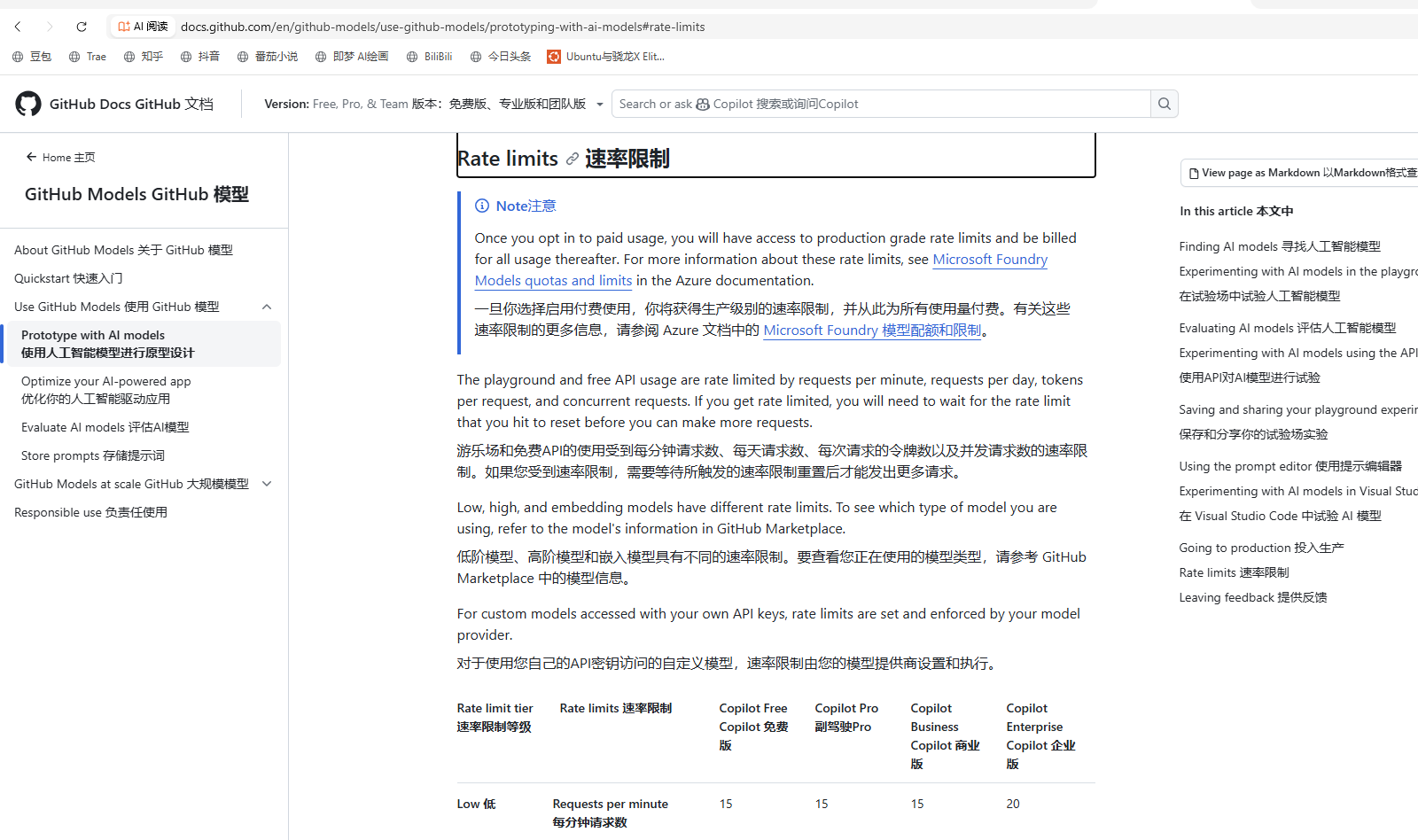

GitHub Models

1. 官网:https://github.com/marketplace/models

2. 免费可调用模型:gpt-4.1、gpt-4o、gpt-4.1-mini、DeepSeek-V3-0324、Llama-3.3-70B-Instruct等

3. 模型查看:https://github.com/marketplace?type=models(点击具体模型查看免费速率限制等级)

4. 速率限制说明:https://docs.github.com/en/github-models/use-github-models/prototyping-with-ai-models#rate-limits

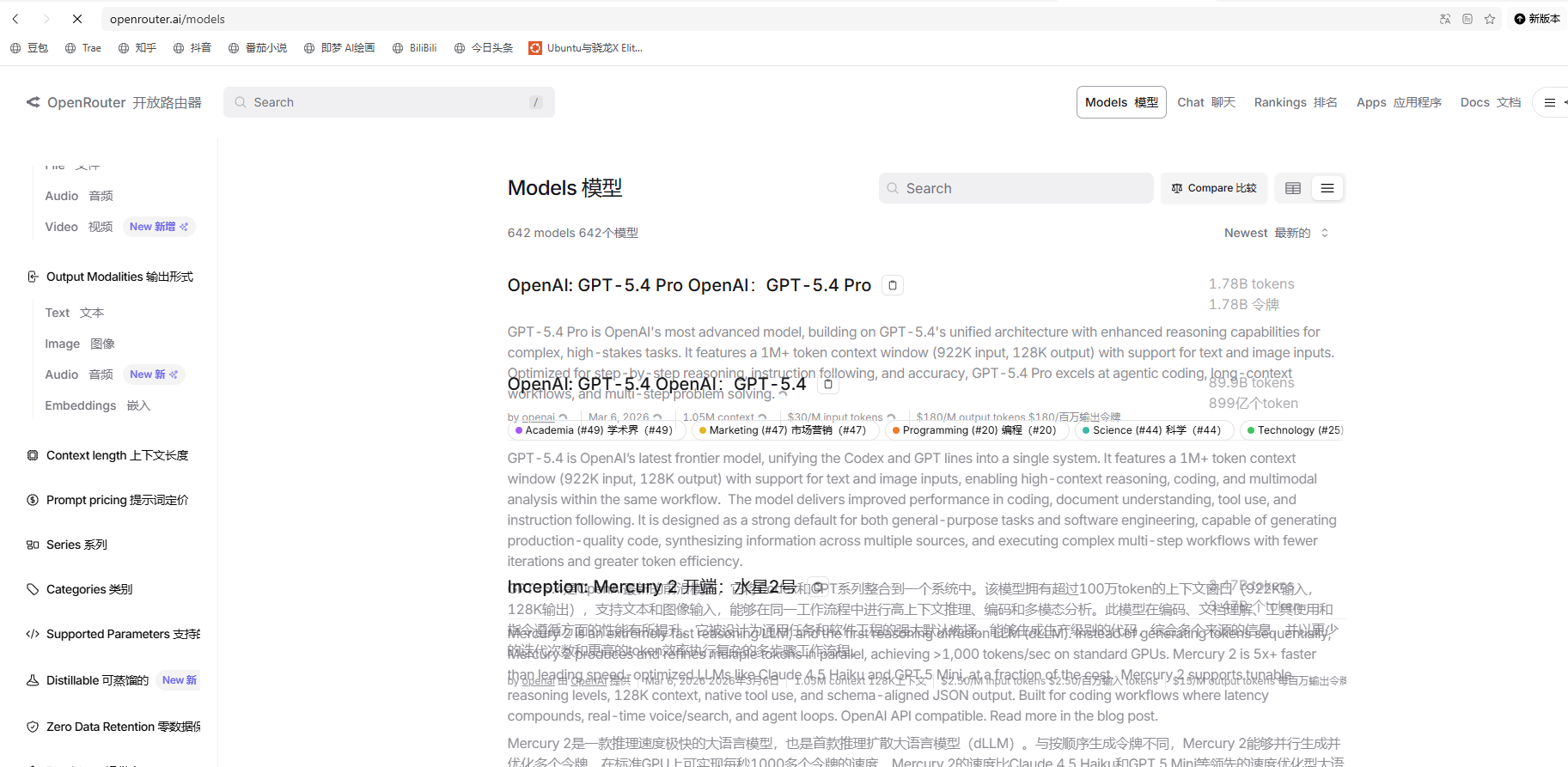

OpenRouter

1. 官网:https://openrouter.ai

2. 平台特点:知名模型聚合商,接口统一,需查找名称后缀带free的模型

3. 免费额度:每日50个请求(所有免费模型总计);付费用户(累计购买至少$10 credits,即使credits已用完)每日限额提升至1000个请求 按“/”插入内容,或让 AI 帮我写

Groq

1. 官网:https://console.groq.com/

2. 注意事项:需要使用网络代理工具访问 3. 免费可用模型及限制如下表:

模型

RPM

RPD

TPM

TPD

ASH

ASD

allam-2-7b

30

7K

6K

500K

-

-

canopylabs/orpheus-arabic-saudi

10

100

1.2K

3.6K

-

-

canopylabs/orpheus-v1-english

10

100

1.2K

3.6K

-

-

groq/compound

30

250

70K

-

-

-

groq/compound-mini

30

250

70K

-

-

-

llama-3.1-8b-instant

30

14.4K

6K

500K

-

-

llama-3.3-70b-versatile

30

1K

12K

100K

-

-

meta-llama/llama-4-maverick-17b-128e-instruct

30

1K

6K

500K

-

-

meta-llama/llama-4-scout-17b-16e-instruct

30

1K

30K

500K

-

-

meta-llama/llama-guard-4-12b

30

14.4K

15K

500K

-

-

meta-llama/llama-prompt-guard-2-22m

30

14.4K

15K

500K

-

-

meta-llama/llama-prompt-guard-2-86m

30

14.4K

15K

500K

-

-

moonshotai/kimi-k2-instruct

60

1K

10K

300K

-

-

moonshotai/kimi-k2-instruct-0905

60

1K

10K

300K

-

-

openai/gpt-oss-120b

30

1K

8K

200K

-

-

openai/gpt-oss-20b

30

1K

8K

200K

-

-

openai/gpt-oss-safeguard-20b

30

1K

8K

200K

-

-

playai-tts

10

100

1.2K

3.6K

-

-

playai-tts-arabic

10

100

1.2K

3.6K

-

-

qwen/qwen3-32b

60

1K

6K

500K

-

-

whisper-large-v3

20

2K

-

-

7.2K

28.8K

whisper-large-v3-turbo

20

2K

-

-

7.2K

28.8K

ChatAnywhere(GitHub 项目)

1. 项目地址:https://github.com/chatanywhere/GPT_API_free

2. 使用要求:使用GitHub账号绑定领取免费Key

3. 调用限制:免费API Key限制200请求/天/IP&Key

4. 免费版支持模型及日调用次数:

(1)gpt-5.2、gpt-5.1、gpt-5、gpt-4o、gpt-4.1:每日5次

(2)deepseek-r1、deepseek-v3、deepseek-v3-2-exp:每日30次

(3)gpt-4o-mini、gpt-3.5-turbo、gpt-4.1-mini、gpt-4.1-nano、gpt-5-mini、gpt-5-nano:每日200次

智谱AI (BigModel)

1. 官网:智谱AI开放平台

2. 免费策略:Flash系列模型(如GLM-4.5-Flash)完全免费

3. 限制:主要限制并发数(Concurrency)

4. 详情查看:https://bigmodel.cn/usercenter/proj-mgmt/rate-limits

硅基流动 (SiliconFlow)

1. 官网:硅基流动 SiliconFlow - 致力于成为全球领先的AI能力提供商

2. 免费策略:大部分10B参数以下的中小模型免费

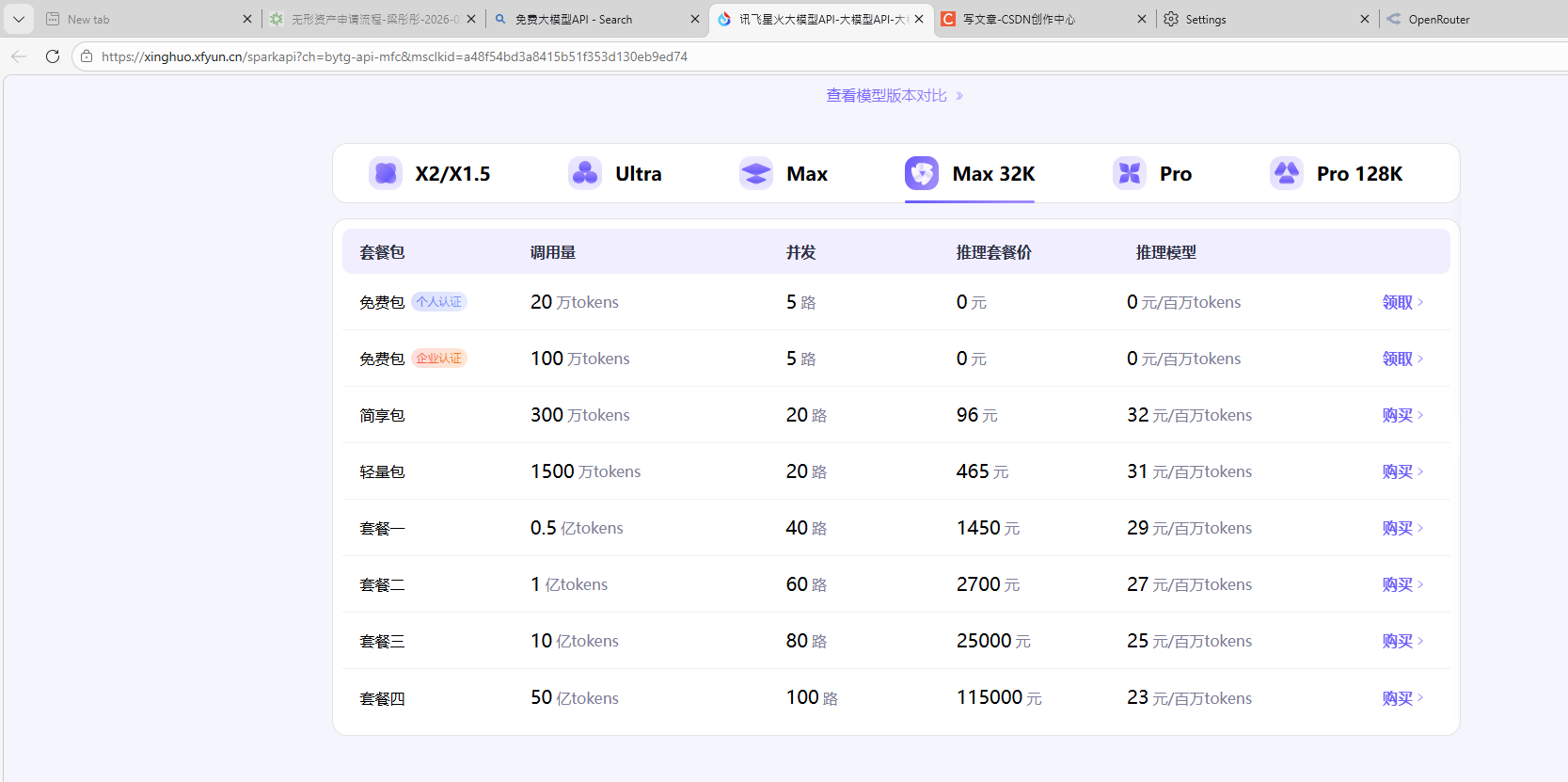

科大讯飞星火大模型

心流开放平台

心流开放平台

iFlow CLI 是一款终端AI助手,可以分析代码、执行编程任务、处理文件操作。本指南帮您快速上手核心功能。

心流 API 提供与 OpenAI 100% 兼容的接口服务,让您可以无缝切换到我们的 AI 服务,享受更高性能和更具成本效益的解决方案。

1.支持的模型

• tstars2.0

• qwen3-coder-plus

• qwen3-max

• qwen3-vl-plus

• qwen3-max-preview

• kimi-k2-0905

• glm-4.6

• kimi-k2

• deepseek-v3.2

• deepseek-r1

• deepseek-v3

• qwen3-32b

• qwen3-235b-a22b-thinking-2507

• qwen3-235b-a22b-instruct

• qwen3-235b

2.使用限制

所有模型完全免费使用,并发请求数为1

3. 官网

心流开放平台 - 心流开放平台 | 心流开放平台

DeepSeek(深度求索)

1. 官方平台:DeepSeek开放平台(https://www.deepseek.com/)

2. 使用要求:注册DeepSeek账号并完成实名认证,通过官方平台申请API Key,API Key需通过HashiCorp Vault动态获取,禁止明文写入Git

3. 调用限制:免费版单Key每日请求限额50次(未购买积分用户),购买至少10个积分后每日限额提升至1000次,单模型每分钟请求数(RPM)≤10,基础功能免费但存在速率限制(每小时30次交互)

4. 限制条件说明链接:https://huggingface.co/deepseek-ai/DeepSeek-R1/blob/main/modeling_deepseek.py

5. 免费版支持模型及日调用次数:

(1)deepseek-r1、deepseek-reasoner:每日30次

(2)deepseek-v3、deepseek-v3.2、deepseek-v3-2-exp:每日30次

(3)deepseek-chat、deepseek-v3.1-:每日50次

英伟达(NVIDIA)

1. 官方平台:NVIDIA Build平台(https://build.nvidia.com/explore/discover)

2. 使用要求:注册NVIDIA账号,完成手机号验证(支持国内手机号,可切换+86),生成并保存API Key(Key生成后无法再次查看,需妥善保管)

3. 调用限制:免费版每分钟请求数(RPM)≤40,无固定日请求数限制,部分模型不兼容Anthropic格式,使用人数较多时可能影响响应速度,支持国内用户正常使用

4. 限制条件说明链接:https://build.nvidia.com/models

5. 免费版支持模型及日调用次数:

(1)NVIDIA NeMo LLM 7B/13B:每日30次

(2)Mixtral-8x7B-Instruct-v0.1(优化版):每日20次

(3)Gemma-2-9B-It(合作模型)、z-ai/glm4.7:每日40次

高通(Qualcomm)

1. 官方平台:Qualcomm AI Hub(https://aihub.qualcomm.com/)

2. 使用要求:注册高通账号,同意开发者协议,部分API需申请内测资格方可使用

3. 调用限制:免费版每日总请求数≤100次,单请求Token上限2K,无明确并发限制,仅支持指定免费模型调用

4. 限制条件说明链接:https://aihub.qualcomm.com/docs/rate-limits

5. 免费版支持模型及日调用次数:

(1)Qualcomm Cloud AI 10B:每日30次

(2)Llama-3-8B-QNN(优化版):每日50次

(3)Mistral-7B-Q4_K_M(量化版):每日20次

阿里云

1. 官方平台:魔搭社区(ModelScope,https://www.modelscope.cn/)

2. 使用要求:注册阿里云账号并完成绑定,无需额外付费,注册后即可领取免费调用额度

3. 调用限制:每日总计2000次API调用,单个模型每日上限500次,平台可能对部分模型单独设置并发限制,额度可能随时调整

4. 限制条件说明链接:https://www.modelscope.cn/docs/model-service/API-Inference/intro

5. 免费版支持模型及日调用次数:

(1)通义千问Qwen-7B/14B:每日500次

(2)ERNIE 3.0 Titan、GLM4.5:每日300次

(3)Mixtral-8x7B(社区版):每日400次

(4)各类中小规模模型(≤10B参数):总计2000次(按单个模型上限分配)

百度智能云

1. 官方平台:百度智能云千帆大模型平台(https://cloud.baidu.com/product/qianfan.html)

2. 使用要求:注册百度智能云账号,完成实名认证,无需绑定支付方式即可领取免费额度

3. 调用限制:免费额度有效期3个月,每日总请求数≤300次,并发数≤5,智能搜索生成、百度百科相关API每日各100次免费调用

4. 限制条件说明链接:https://cloud.baidu.com/doc/QIANFAN/s/6lq0z5n42

5. 免费版支持模型及日调用次数:

(1)文心一言ERNIE 4.0 Lite:每日100次

(2)文心一言ERNIE 3.5:每日80次

(3)文心一格(图像生成):每日20次

(4)百度飞桨PaddleNLP系列模型:每日100次

字节跳动火山引擎

1. 官方平台:火山方舟大模型平台(https://www.volcengine.com/product/ark)

2. 使用要求:注册火山引擎账号,申请免费API额度,领取后获取API Key即可使用

3. 调用限制:免费版每日总请求数≤200次,单模型每分钟Token数(TPM)≤10K,可免费获取100万Token试用额度,部分功能受限

4. 限制条件说明链接:https://www.volcengine.com/docs/82379/

5. 免费版支持模型及日调用次数:

(1)火山豆包(Doubao)基础版:每日80次

(2)火山方舟Embedding模型:每日100次

(3)Llama-3-8B(火山优化版):每日20次

OpenAI

1. 官方平台:OpenAI Platform(https://platform.openai.com/)

2. 使用要求:注册账号并绑定支付方式(免费额度无需扣费),部分用户可参与数据共享计划获取额外免费Token

3. 调用限制:新用户免费额度$5(有效期3个月),按Token计量;参与数据共享计划的用户,根据账户层级可获得每日25万-1000万Token免费额度,无固定日请求数限制(超出额度后需付费)

4. 限制条件说明链接:https://platform.openai.com/settings/organization/limits

5. 免费版支持模型及额度换算(按$5额度估算):

(1)gpt-3.5-turbo:约可调用1428次(每次按1K Token计算)

(2)gpt-4o-mini:约可调用714次(每次按1K Token计算)

(3)text-embedding-3-small:约可处理7142K Token

(4)DALL·E 2(256x256):约可生成44张图片

腾讯云

1. 官方平台:腾讯云AI开放平台(https://console.cloud.tencent.com/lkeap/)

2. 使用要求:注册腾讯云账号并完成实名认证,创建API Key即可使用,部分服务需单独申请接入

3. 调用限制:DeepSeek-V3、DeepSeek-R1模型曾限时免费(原限时至2025年2月25日),当前腾讯云Copilot API新用户每月1000次免费调用,OCR API每月1000次免费额度,部分服务全免费、不限量开放

4. 限制条件说明链接:https://cloud.tencent.com/document/product/1729/97754

5. 免费版支持模型及日调用次数:

(1)DeepSeek-V3、DeepSeek-R1(限时免费延续):每日50次

(2)腾讯混元多模态模型:每日30次

(3)腾讯云Copilot API、OCR API:每月1000次(折算每日约33次)

亚马逊云(AWS)

1. 官方平台:AWS AI服务平台(https://aws.amazon.com/cn/ai/)

2. 使用要求:注册AWS账号,完成身份验证,部分免费服务需开通对应产品权限

3. 调用限制:免费套餐包含每月100万次REST API调用、100万次WebSocket API消息推送,每月15GB出站数据传输,免费额度长期有效(部分服务有期限限制)

4. 限制条件说明链接:https://aws.amazon.com/cn/free/?all-free-tier

5. 免费版支持模型及日调用次数:

(1)Amazon Bedrock基础模型(如Claude 3 Haiku):每月100万次调用(折算每日约3.3万次)

(2)Amazon SageMaker基础模型推理:每月100万次调用(折算每日约3.3万次)

(3)CloudFront分发API:每月100万次HTTP/HTTPS请求(折算每日约3.3万次)

此类模型专注于文本交互,参数规模小(≤10B),经量化后可在普通电脑流畅运行,无需复杂配置,是日常使用频率最高的轻量模型类型。

1. Qwen-1.8B(通义千问轻量版)

1. 模型核心特点:阿里通义千问推出的轻量模型,参数1.8B,中文优化极佳,支持对话、文案润色、简单翻译、办公文档生成,INT4量化后仅需~1GB内存,推理速度快,无明显卡顿,适配所有日常电脑,树莓派等嵌入式设备也可运行。

2. 本地部署配置要求(最低):CPU:2核及以上;内存:4GB及以上;硬盘:预留2-3GB(量化版);无GPU可正常运行,核显可加速。

3. 部署难度:极低(小白友好),支持一键部署工具,无需编写代码,可通过Ollama、魔搭社区工具快速安装。

4. 调用方式:部署后可通过本地网页界面、命令行调用,也可集成到办公软件(如Word、WPS),支持API调用(简单配置即可)。

5. 官方部署指引链接:https://modelscope.cn/models/qwen/Qwen-1.8B-Chat/summary

2. Phi-3 Mini(微软轻量版)

1. 模型核心特点:微软推出的小参数高性能模型,参数3.8B,推理效果接近7B级模型,擅长逻辑推理、代码生成、英文交互,INT4量化后仅需~2GB内存,CPU推理延迟低,4核CPU即可流畅运行,适配Windows、macOS系统,支持离线运行,注重用户隐私保护。

2. 本地部署配置要求(最低):CPU:4核及以上(支持AVX2指令集,如Intel 8代后、AMD Zen2后);内存:8GB及以上;硬盘:预留4-5GB;无GPU可正常运行,有入门级GPU可提升推理速度。

3. 部署难度:低,可通过Ollama一键部署,也可通过llama.cpp编译部署,提供详细的小白部署教程。

4. 调用方式:支持命令行调用、本地网页界面交互,可通过Python脚本简单调用,适合程序员、学生日常使用。

5. 官方部署指引链接:https://learn.microsoft.com/zh-cn/azure/ai-services/openai/phi-3-model-overview#local-deployment

3. Mistral-7B(INT4量化版)

1. 模型核心特点:开源标杆轻量模型,参数7B,经INT4量化后内存占用降至~4GB,支持多语言交互、文案创作、逻辑分析,配合llama.cpp的CPU多核优化,8核CPU可流畅推理,适配所有主流系统,社区资源丰富,可自定义优化部署参数。

2. 本地部署配置要求(最低):CPU:8核及以上(如i7/Ryzen 7);内存:8GB及以上(16GB**);硬盘:预留8-10GB;无GPU可运行,有独立GPU(2GB及以上显存)可大幅提升速度。

3. 部署难度:中低,适合有少量电脑基础的用户,可通过Ollama、llama.cpp部署,网上有大量小白适配教程。

4. 调用方式:命令行调用、本地API调用、网页界面交互,可集成到各类本地工具,支持批量处理文本。

5. 官方部署指引链接:https://mistral.ai/news/mistral-7b/

4. TinyLLM(轻量集成模型)

1. 模型核心特点:GitHub开源项目,专注于在普通消费级硬件上部署轻量LLM,集成多种轻量模型(如Llama系列、Qwen系列),提供ChatGPT-like网页界面,支持向量数据库、外部网站访问等扩展功能,可根据自身电脑配置自动匹配最优模型版本,适配Intel、AMD、Apple Silicon CPU。

2. 本地部署配置要求(最低):CPU:Intel、AMD或Apple Silicon;内存:8GB及以上;硬盘:128GB及以上SSD;GPU:NVIDIA(如GTX 1060 6GB)或Apple M1/M2(可选,加速推理);系统:Ubuntu Linux、macOS(Windows可通过虚拟机适配)。

3. 部署难度:中低,提供手动部署脚本和容器部署方案,支持Ollama、llama.cpp、vllm三种部署方式,适合想体验多种轻量模型的用户。

4. 调用方式:本地网页界面交互,支持OpenAI API兼容接口,可轻松集成到其他本地工具。

5. 官方部署指引链接:https://github.com/jasonacox/TinyLLM

5. Gemini Nano-2(谷歌轻量版)

1. 模型核心特点:谷歌专为移动/边缘设备、普通电脑设计,参数1.8B,功耗低,适配ARM/x86架构,支持TensorFlow Lite,擅长语音转文本后处理、简单对话交互,INT8量化后内存占用低,适合低配置办公本部署,可离线运行,保护用户数据隐私。

2. 本地部署配置要求(最低):CPU:2核及以上(支持NEON/AVX2指令集);内存:2GB及以上;硬盘:预留2-3GB;无GPU可正常运行,适配Windows、macOS、Linux系统。

3. 部署难度:极低,谷歌提供官方部署工具,支持一键安装,无需复杂配置,小白可快速上手。

4. 调用方式:命令行调用、本地API调用,可集成到语音处理工具,适合日常简单对话、语音转写辅助。

5. 官方部署指引链接:https://ai.google.dev/models/gemini/nano

此类模型支持文本+图像交互,参数规模小,无需高端GPU,可在普通电脑部署,满足日常图文创作、图像识别、视觉问答等需求,兼顾实用性和轻量化。

1. MiniGPT-4(轻量化重构版)

1. 模型核心特点:基于Qwen-1.8B和轻量化CLIP模型重构,支持图文对话、图像描述生成、图文匹配,INT4量化后内存占用~3GB,无需高端GPU,普通办公本可流畅运行,适合日常创意设计、图文内容创作辅助。

2. 本地部署配置要求(最低):CPU:6核及以上(如i7/Ryzen 7);内存:6GB及以上(16GB**);硬盘:预留10-15GB;无GPU可运行,有入门级GPU(2GB及以上显存)可提升图像处理速度。

3. 部署难度:中等,需要简单配置Python环境,网上有详细的小白部署教程,步骤清晰。

4. 调用方式:本地网页界面交互,可上传图片+输入文本,生成图像描述、创意文案,支持简单图像编辑建议。

5. 官方部署指引链接:https://github.com/Vision-CAIR/MiniGPT-4

2. BLIP-Large(裁剪版)

1. 模型核心特点:图文理解轻量模型,替换原模型视觉编码器为MobileViT-XXS,文本编码器为DistilBERT,INT8量化后内存~2GB,擅长视觉问答(VQA)、图像 captioning,适配普通电脑,可离线处理图像,无需联网即可生成图像描述。

2. 本地部署配置要求(最低):CPU:4核及以上;内存:4GB及以上;硬盘:预留5-8GB;无GPU可正常运行,适配所有主流系统。

3. 部署难度:中低,可通过Hugging Face Transformers部署,提供详细的代码示例,适合有基础的小白。

4. 调用方式:Python脚本调用、本地网页界面交互,可批量处理图像,生成图像描述,适合日常图文整理、素材标注。

5. 官方部署指引链接:https://huggingface.co/docs/transformers/model_doc/blip

此类模型专注于图像处理,参数规模极小(≤10M),经量化后可在普通电脑快速运行,适合日常图像识别、物体计数、简单质检等轻量视觉任务,无需复杂配置。

1. YOLOv8n(nano版)

1. 模型核心特点:目标检测轻量模型,参数仅3.2M,INT8量化后CPU推理可达10~30FPS(取决于CPU性能),擅长物体检测、计数,体积小、加载快,适配普通办公本,适合日常图像识别、简单监控辅助等场景。

2. 本地部署配置要求(最低):CPU:2核及以上(如树莓派4B、Intel Celeron);内存:1GB及以上;硬盘:预留1-2GB;无GPU可正常运行,适配所有主流系统。

3. 部署难度:低,支持Python一键安装,提供官方部署工具,小白可快速上手,无需复杂代码编写。

4. 调用方式:Python脚本调用、本地工具调用,可上传图像、视频,实时检测物体并标注,适合日常图像处理、简单监控。

5. 官方部署指引链接:https://docs.ultralytics.com/models/yolov8/#quickstart

信息获取与搜索

序号

技能名称

核心用途

推荐理由

安装命令

1

Tavily Search

AI实时联网搜索

专为AI优化的搜索引擎,可获取最新信息、新闻、论文,无广告且结果结构化。

clawhub install tavily-search

2

weather

全球天气查询

零配置,无需API Key,直接查询全球城市的实时天气和未来预报。

clawhub install weather

3

desearch-web-search

深度网络研究

支持自定义搜索引擎和筛选时间范围,适合进行SEO分析或技术查询。

npx clawhub@latest install desearch-web-search –force

知识管理与笔记

序号

技能名称

核心用途

推荐理由

安装命令

4

Obsidian

笔记库读写

直接读写Obsidian笔记库,自动将聊天记录、资料存为Markdown并建立知识链接。

clawhub install obsidian

5

Summarize

多格式内容总结

一键总结长文、PDF、YouTube视频、邮件等,快速提炼核心信息。

clawhub install summarize

6

PDF Parser

PDF文档解析

精准提取PDF中的文字、表格,供AI进一步分析处理。

clawhub install pdf-parser

办公与效率自动化

序号

技能名称

核心用途

推荐理由

安装命令

7

GOG

谷歌全家桶集成

集成Gmail、日历、Drive,实现自动收发邮件、安排日程、管理文件。

clawhub install gog

8

n8n-workflow-automation

跨应用工作流自动化

连接数百个应用,例如邮件自动同步到Notion、更新Trello等。

npx clawhub@latest install n8n-workflow-automation

9

web-form-automation

网页表单自动填写

自动填写并提交网页表单,适合批量注册或数据提交场景。

npx clawhub@latest install web-form-automation

10

Todo Tracker

任务管理

让AI帮你管理待办事项,设置提醒,跟踪任务进度。

clawhub install todo-tracker

自我进化与记忆

序号

技能名称

核心用途

推荐理由

安装命令

11

self-improving-agent

自我迭代优化

让AI记录错误、总结经验、自动优化行为,越用越聪明。

clawhub install self-improving-agent

12

proactive-agent

主动性任务规划

赋予AI主动性,使其能自主规划任务、分解步骤并执行。

clawhub install proactive-agent

13

ontology / memory

长期记忆与知识图谱

让AI拥有长期记忆,跨对话记住你的偏好和信息。

clawhub install memory

开发与网页操作

序号

技能名称

核心用途

推荐理由

安装命令

14

ai-web-automation

浏览器自动化控制

模拟人工操作浏览器,实现点击、输入、截图等,适合数据采集。

npx clawhub@latest install ai-web-automation

15

GitHub

GitHub仓库管理

集成GitHub,可搜索代码、管理Issue/PR、创建仓库。

clawhub install github

16

skill-creator

创建自定义技能

元技能,可用自然语言让AI帮你创建新的专用技能。

clawhub install skill-creator

17

find-skills

智能推荐与安装技能

让AI根据你的需求,在ClawHub中搜索并推荐合适的技能。

clawhub install find-skills

安全与管理

序号

技能名称

核心用途

推荐理由

安装命令

18

skill-vetter

技能安全扫描

安装前扫描其他技能代码,检查恶意请求或漏洞,保障安全。

clawhub install skill-vetter

19

CLI Utilities

系统命令执行

让AI在授权下执行系统命令,简化服务器运维操作。

clawhub install cli-utilities

20

Personal Assistant

综合个人助理

整合日程、提醒、信息查询等日常功能。

clawhub install personal-assistant

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/228673.html