今天给大家分享下,Cursor + MCP 彻底颠覆我的 Cursor工作流,效率直接起飞。

MCP 是一种开放协议,它标准化了应用程序向 LLM 提供上下文的方式。可以将 MCP 视为 AI 应用程序的 USB-C 端口。正如 USB-C 提供了一种将设备连接到各种外围设备和配件的标准化方式一样,MCP 提供了一种将 AI 模型连接到不同数据源和工具的标准化方式。

MCP 是 Claude (Anthropic) 主导发布的一个开放的、通用的、有共识的协议标准。还多提一句,这个协议的发布**机会应该是属于 OpenAI 的。如果 OpenAI 刚发布 GPT 时就推动协议,相信大家都不会拒绝,但是 OpenAI 变成了 CloseAI,只发布了一个封闭的 GPTs。这种需要主导和共识的标准协议一般很难由社区自发形成,通常需要行业巨头来主导。

看到这里你可能有一个问题,在 2023 年 OpenAI 发布 GPT function calling 的时候,不是也可以实现类似的功能吗?我们之前介绍的 AI Agent,不就是用来集成不同的服务吗?为什么又出现了 MCP?

Function Calling、AI Agent、MCP 这三者之间有什么区别? 1、Function Calling

- Function Calling 指的是 AI 模型根据上下文自动执行函数的机制。

- Function Calling 充当了 AI 模型与外部系统之间的桥梁,不同的模型有不同的 Function Calling 实现,代码集成的方式也不一样。由不同的 AI 模型平台来定义和实现。

2、Model Context Protocol (MCP)

- MCP 是一个标准协议,如同电子设备的 Type C 协议(可以充电也可以传输数据),使 AI 模型能够与不同的 API 和数据源无缝交互。

- MCP 旨在替换碎片化的 Agent 代码集成,从而使 AI 系统更可靠,更有效。通过建立通用标准,服务商可以基于协议来推出它们自己服务的 AI 能力,从而支持开发者更快地构建更强大的 AI 应用。开发者也不需要重复造轮子,通过开源项目可以建立强大的 AI Agent 生态。

- MCP 可以在不同的应用/服务之间保持上下文,从而增强整体自主执行任务的能力。

3、AI Agent

- AI Agent 是一个智能系统,它可以自主运行以实现特定目标。传统的 AI 聊天仅提供建议或者需要手动执行任务,AI Agent 则可以分析具体情况,做出决策,并自行采取行动。

- AI Agent 可以利用 MCP 提供的功能描述来理解更多的上下文,并在各种平台/服务自动执行任务。

可以简单地理解为,MCP 将不同服务和平台的能力列表告诉 AI Agent,AI Agent 根据上下文和模型的推理,判断出是否需要调用某个服务,接着使用 Function Calling 执行函数,这个函数是通过 MCP 来告诉 Function Calling 的,最后通过 MCP 协议提供的具体代码来完成整个过程。

MCP 对于社区生态的好处主要是以下两点:

- 标准化:提供了一个标准的协议,让 AI 模型与已有服务进行交互,不需要为每个模型开发不同的集成代码。

- 生态系统:建立在一个共同协议上的生态系统,可以让开发者专注于构建更强大的应用,而不是重复造轮子。

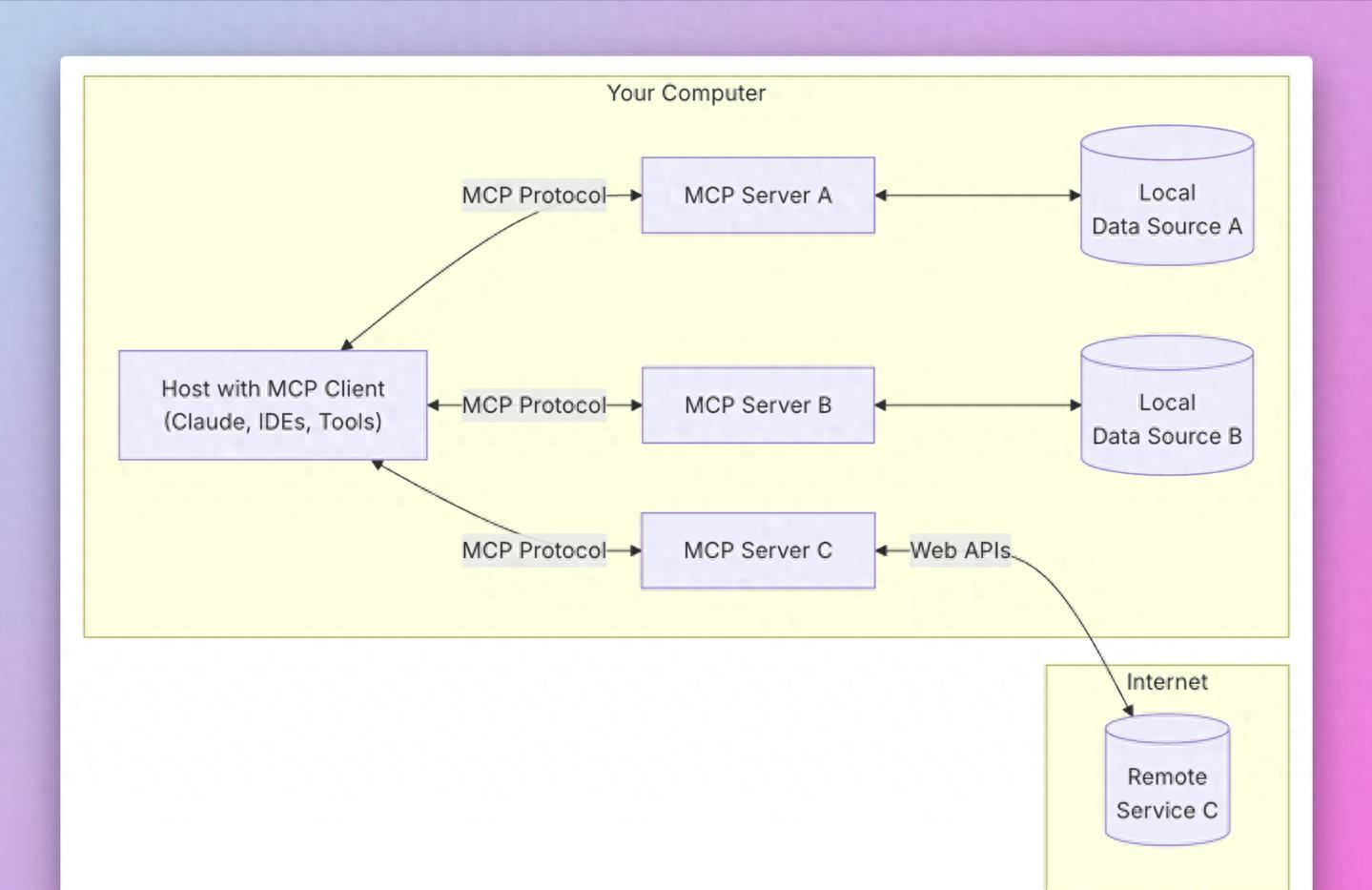

MCP 的核心是客户端-服务器架构,其中主机应用程序可以连接到多个服务器

- MCP 主机:希望通过 MCP 访问数据的程序,例如 Claude Desktop、IDE 或 AI 工具

- 客户端:与服务器保持 1:1 连接的协议客户端

- 服务器:轻量级程序,每个程序都通过标准化模型上下文协议公开特定功能

- 本地数据源:MCP 服务器可以安全访问的您的计算机文件、数据库和服务

- 远程服务:MCP 服务器可通过互联网(例如通过 API)连接到的外部系统

MCP Server 就像是一个翻译和安全管理员,它连接 AI 和你的本地环境(如文件系统、数据库或 API)。

以上是对 MCP 的解释,下面我们开始使用 Cursor 配置 MCP 完成一个小案例,来展示它们组合的强大。

首先要安装和注册登录 Cursor。具体可以看这篇文章:

下面开始详细的配置,遵循一下步骤:

可以直接去官网或者 GitHub 上搜索 MCP。

- https://github.com/wopal-cn/mcp-hotnews-server

- https://github.com/smithery-ai/reference-servers/tree/main/src/sequentialthinking

这里个给出两个现在要用的,更多前往文末查看。

在 github 里可以找到这个配置

{ “mcpServers”: {"mcp-server-hotnews": { "command": "npx", "args": [ "-y", "@wopal/mcp-server-hotnews" ] } } }

转换成 Cursor 识别的。 npx -y @wopal/mcp-server-hotnews –config “{"sources":"[1,2,3,4,5,6,7,8,9]"}”

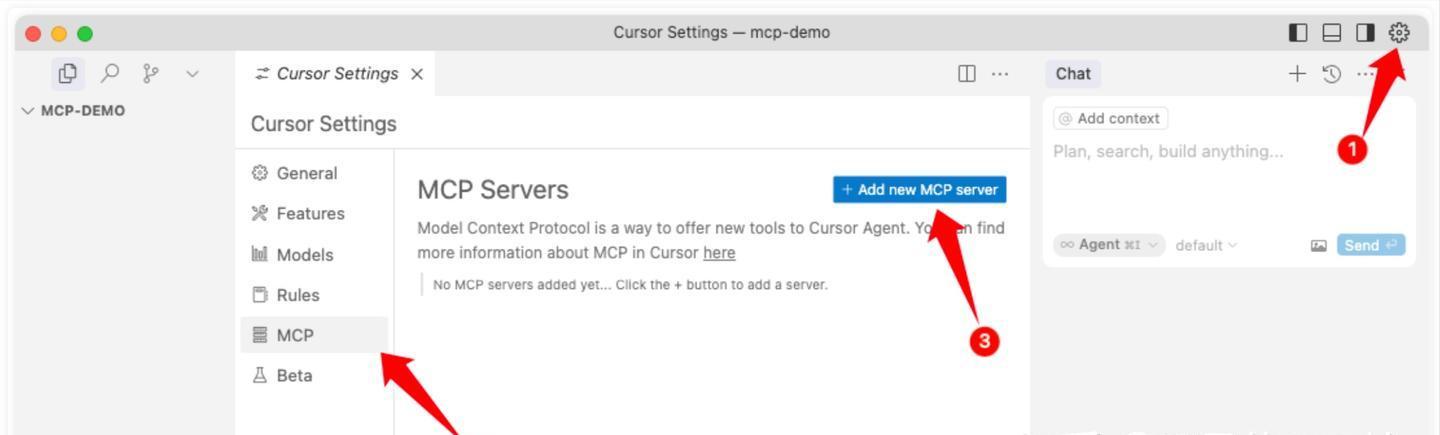

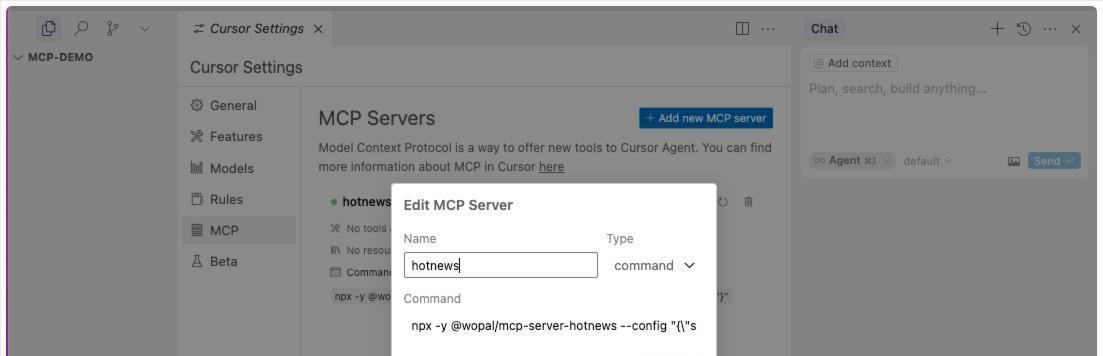

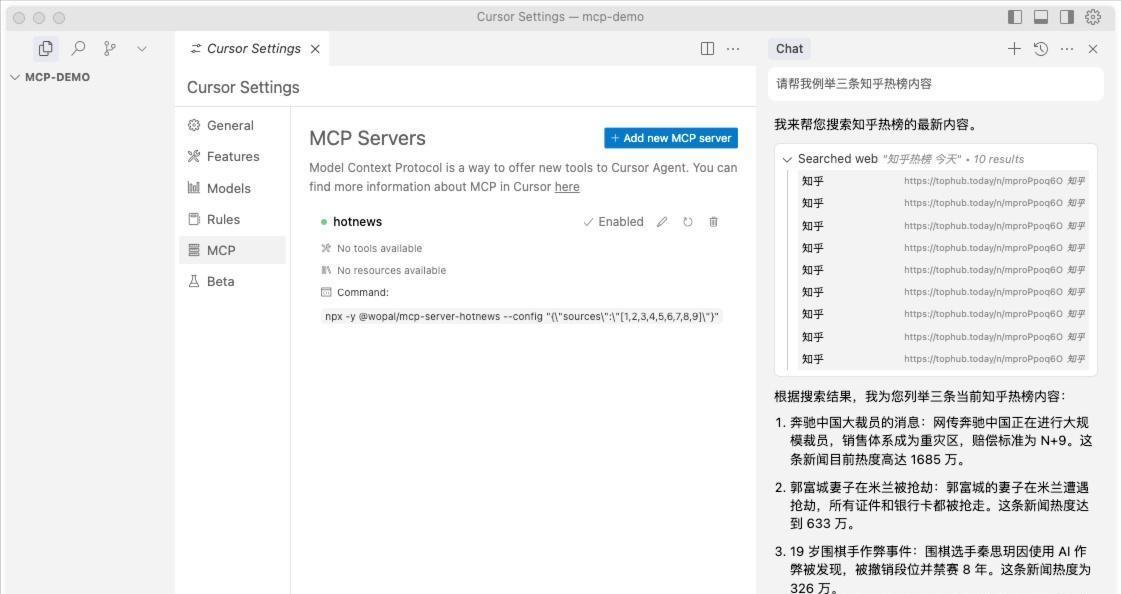

启动 Cursor IDE ,参照图片步骤进入 MCP 配置的位置

输入名称,选择 Command 类型,和配置

npx -y @wopal/mcp-server-hotnews –config “{”sources“:”[1,2,3,4,5,6,7,8,9]“}”

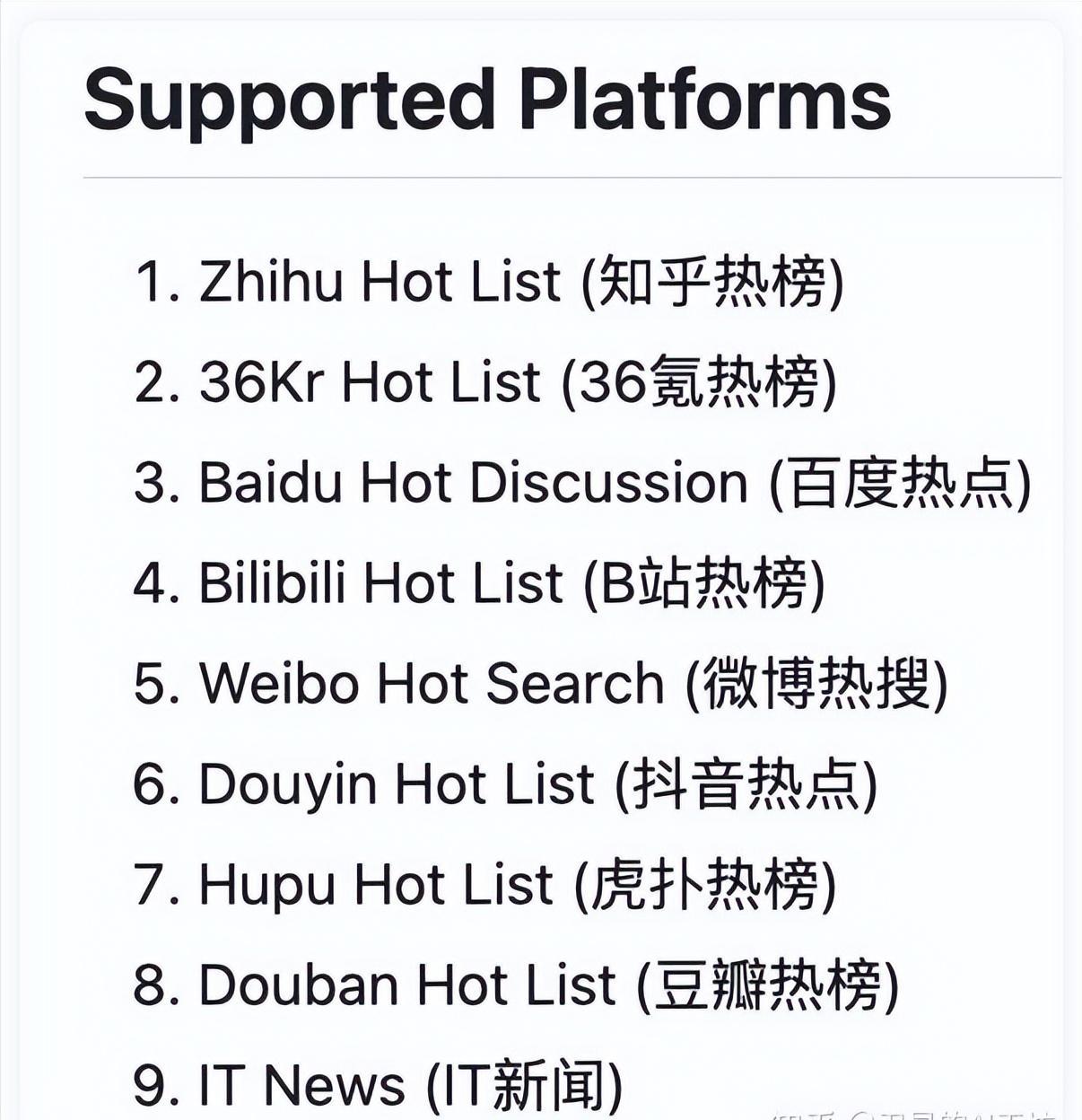

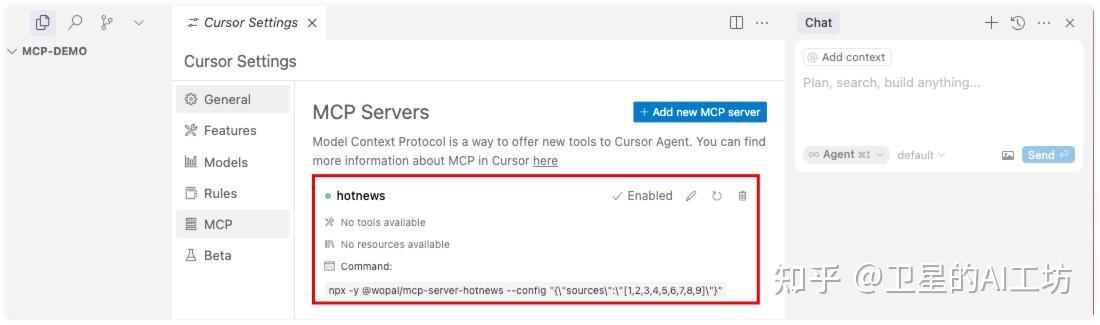

这里的 sources 对对一的数字值含义是支持查询平台的编号

点击save之后稍等,出现绿色的点,表示配置成功了。

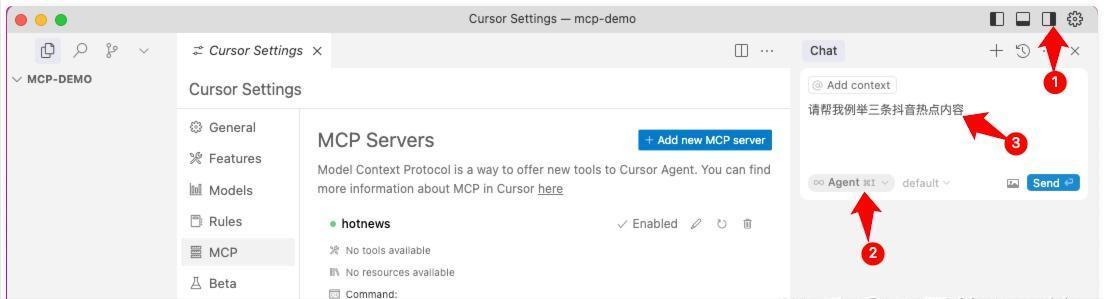

打卡 Cursor 的 Chat 对话框,选择Agent 模式,输入要求

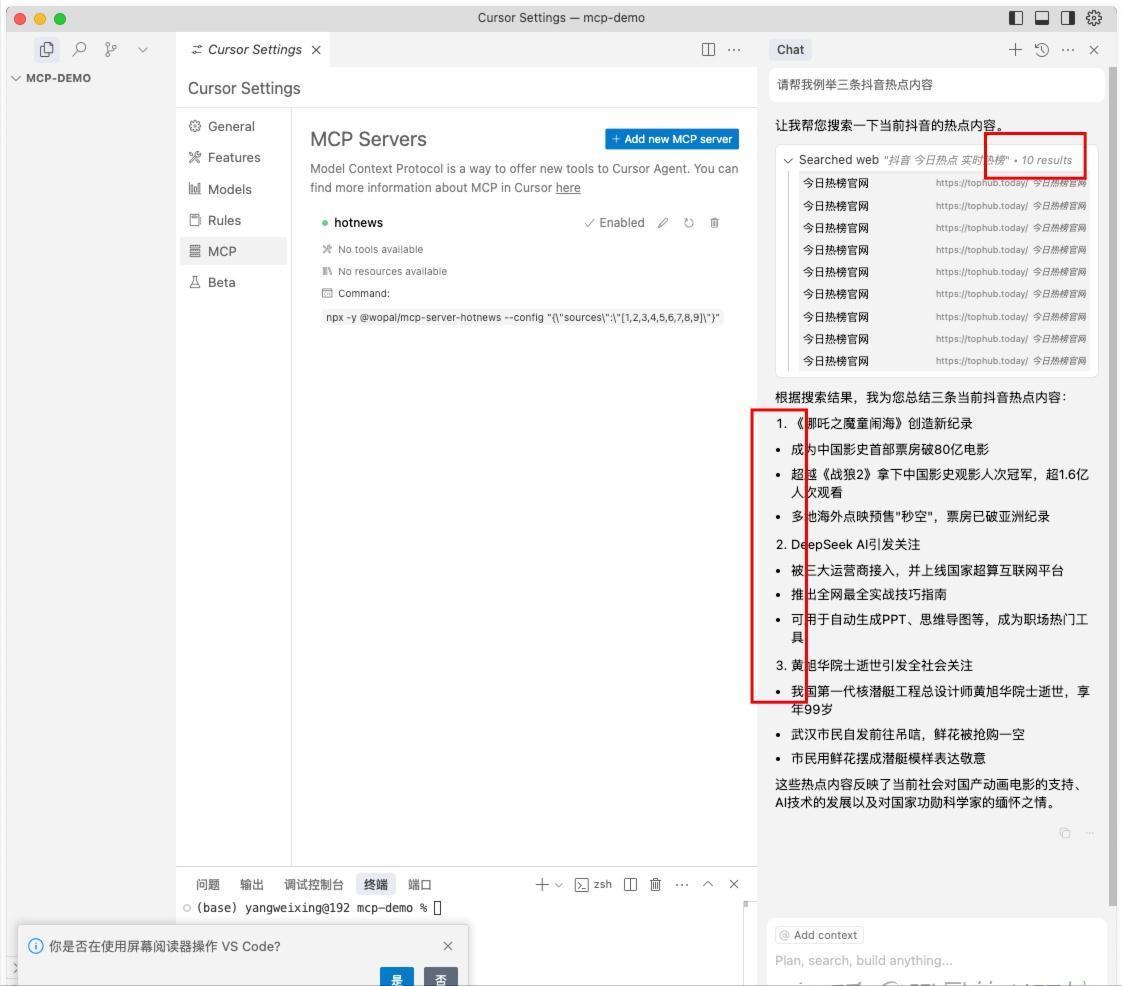

看看输出的结果,搜索的是今日热榜的新闻,搜索结果是 10 条,给出的结果 3 条。

在来测试一个知乎热榜:

到这里,我们就使用 Cursor 配置了热榜的 mcp-server,如果我们想开发一个类似热榜的程序,那么再也不需要逐个对接,护着写爬虫。可以直接使用开源 mcp-server,借助 AI 来帮助我们完成。

为大家总结下 MCP (Model Context Protocol) 将带来的三个最重要的改变:

- 开放式工具连接能力

- 通俗解释:就像手机可以通过蓝牙连接各种设备(耳机、音箱等)一样,MCP 让 AI 助手可以轻松连接并使用各种工具和数据源

- 比如:AI 可以直接查询公司数据库、分析本地文件、使用开发工具等

- 重要性:这让 AI 助手变得更加实用,不再局限于简单的对话,而是能够实际帮助我们完成各种具体工作

- 标准化和开源优势

- 通俗解释:就像 USB 接口成为了通用标准一样,MCP 提供了一个开放的标准,让所有人都可以开发和使用

- 开发者可以自由地为 AI 添加新功能,不需要重新开发整个系统

- 重要性:这将大大降低开发成本,加速 AI 工具的发展和普及,让更多创新成为可能

- 智能代理的进化

- 通俗解释:AI 助手将变得更加智能和自主,能够根据不同场景自动找到并使用最合适的工具

- 比如:可以自动为特定公司、部门或个人定制超专业的 AI 助手

- 重要性:这将带来全新的 AI 应用方式,让 AI 助手更贴近实际需求,真正成为我们工作和生活中的得力助手

总的来说,MCP 的出现就像是给 AI 装上了一个“万能适配器”,让它能够更好地理解和使用各种工具,从而真正融入到我们的日常工作中,带来更实用和个性化的 AI 体验。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/222421.html