在讲解最新版本(2025.3)的AutoGPT本地部署教程之前呢,先在这里简单介绍一下它,当然已经有过基本了解的小伙伴可以直接跳到第二章节。

AutoGPT是github上的一个开源项目,问世以来便受到了大量关注,有许多AI界的大佬为其大力宣传,更有甚至称其开拓了ChatGPT之后的新时代。

从名字来看,大家也能基本猜到这个产品的概念了,那就是自主的GPT;什么是自主呢,即自主实现用户设定的任何目标。更具体一点来讲,AutoGPT会把一个目标进行任务拆解,然后自主地递归调用LLM来对每一个子任务设定计划、实施计划,直至完成最终目标。

AutoGPT的原理浓缩成一个词很简单,那就是LLM递归调用;具体来说,其基本原理有以下三点:

也有人将其总结为一句话:

AutoGPT 就相当于是为基于 GPT 的模型提供了内存和主体。,当然了,这里的GPT对AutoGPT来讲可不只是ChatGPT的不同版本,还有许多其他LLM产品,这在后续文章中会详细提到。

其实为什么想要写这篇文章呢,很大程度上是因为本人在自己尝试部署使用时,看到了很多网上的老版本的教程,基本上可以说对新版本AutoGPT的部署来讲是没有什么参考意义的,最后自己是从官方的文档与社区中不断摸索、交流才最终应用成功的。所以,写下这篇文章呢也是想给后来的小伙伴们一些参考建议,同时也能在后续的使用中互相交流学习(因为AutoGPT目前其实还是属于一个不断开发完善的状态,所以新旧版本会存在有很大的差异)。ok,开始部署!!!

小伙伴们需要提前在本地安装并配置好Docker、Node.js、Git、VScode:

- Node.js、Git和VSCode的本地安装呢网上已经有很多教程了,也基本不会存在版本不兼容的问题(至少我没遇见hah),没安装的小伙伴可以自行去网上找找。

- Docker的安装:这里本人安装的是Docker desktop,大家可以参考这篇安装教程:Windows10安装Docker Desktop(大妈看了都会)-腾讯云开发者社区-腾讯云

- 安装好之后呢可以在windows的开始界面看到如下显示:

4. 然后记得在VSCode中也需要安装好对应的docker和wsl插件扩展:

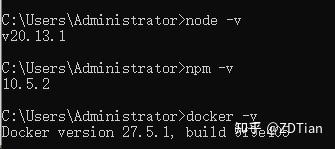

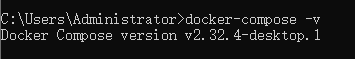

5. 检查是否安装成功:win+R打开CMD命令窗口输入命令:

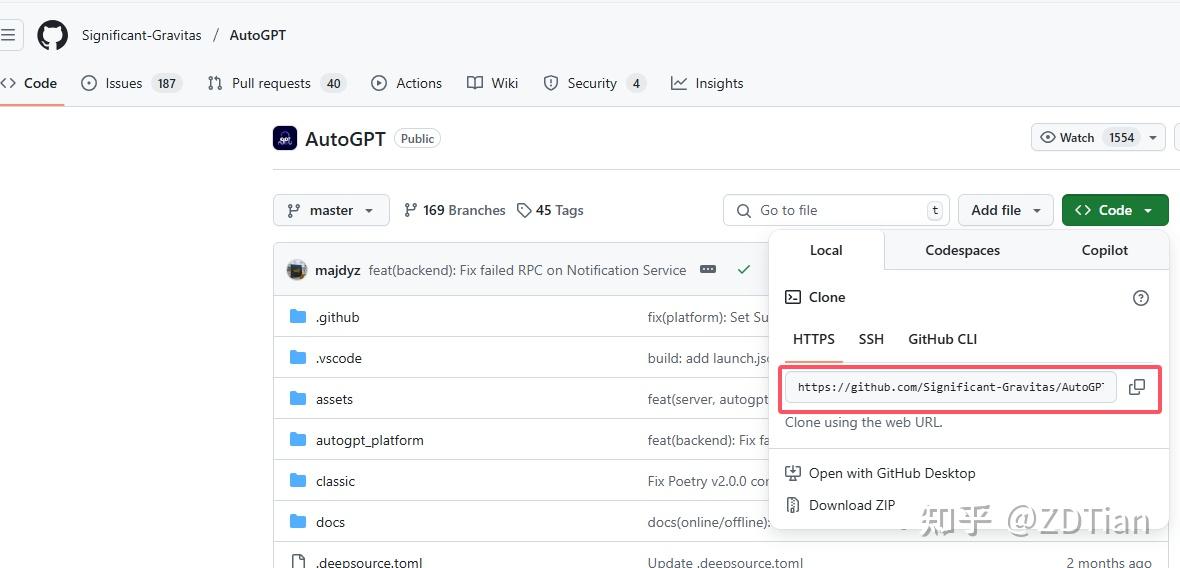

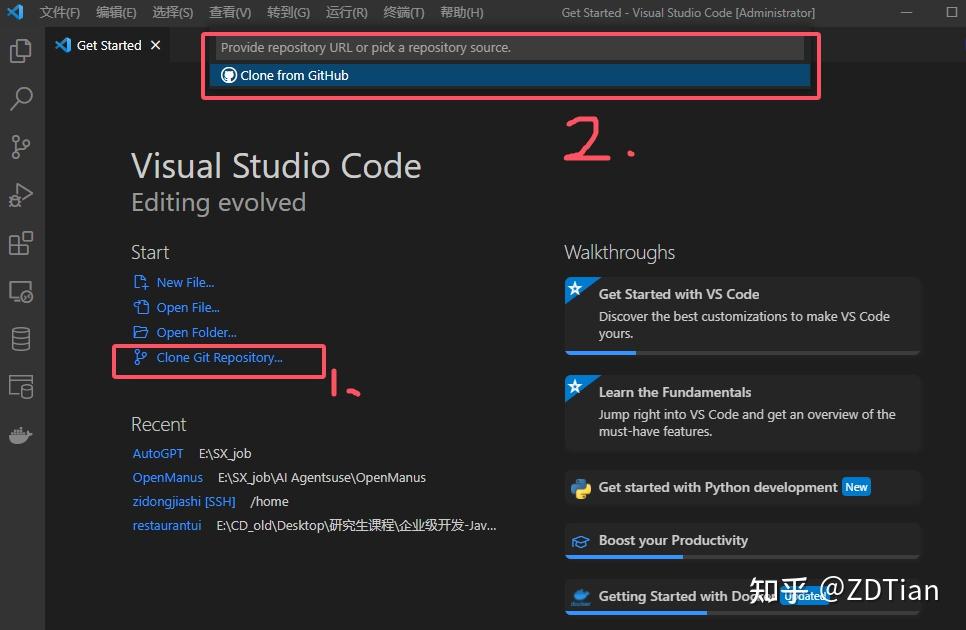

首先,打开VSCode,将github上的项目克隆地址输入完成克隆:

官网地址:Significant-Gravitas/AutoGPT: AutoGPT is the vision of accessible AI for everyone, to use and to build on. Our mission is to provide the tools, so that you can focus on what matters.

克隆好之后呢,就可以在VSCode中看到完整的项目结构了。

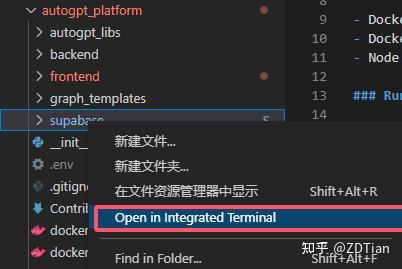

- 接下来,从autogpt_platform下的supabase文件夹路径打开终端:

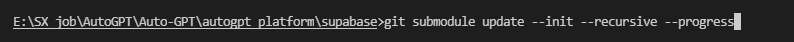

在终端中输入命令并回车:git submodule update –init –recursive –progress

这一步需要一些时间,运行结束之后,会在supabase的目录下看到出现了克隆好的众多文件。

2. 从autogpt_platform文件夹路径打开终端(参照上一点),并在终端输入命令并回车:

cp supabase/docker/.env.example .env

运行结束之后呢,可以在autogpt_platform目录下看到.env文件。

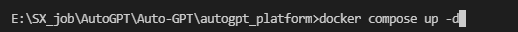

3. 终端继续输入命令并回车:docker compose up -d 完成镜像拉取与后端服务运行(只有第一次需要拉取镜像,后续便可以直接启动了)

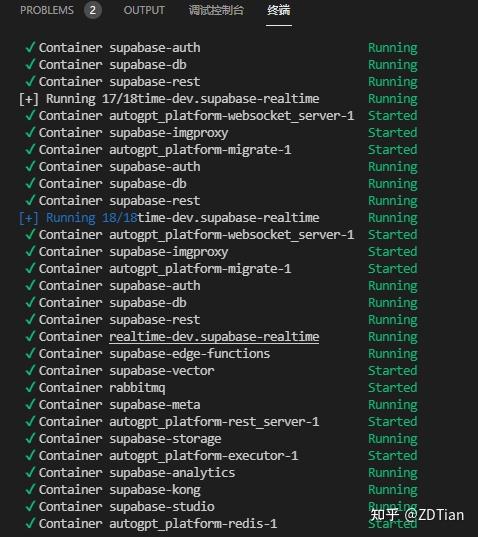

镜像拉取成功之后终端会显示如下(很长,这里只截取部分作为参照):

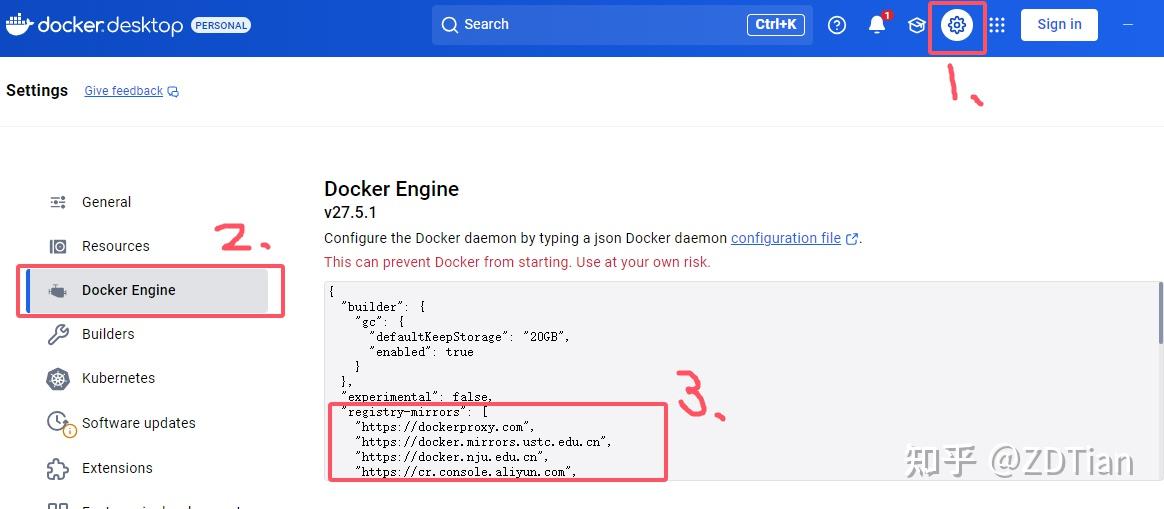

在这里,本人遇到了一个难题,就是总是拉取过程中报错终止,拉取失败;在网上找了很多原因,大多是指需要为docker配置镜像,然后就去网上找了三五个镜像源在docker desktop中完成配置(怎么设置看下文),但还是报错,弄了很久之后终于确定问题:镜像源选少了!!!,因为需要拉取的镜像很多,所以它是按照镜像源一个一个来的,如果所有镜像都拉不到呢就报错失败了。最终,去找了一大片镜像源配置好之后,也是拉取成功了!这里是我的配置,有需要的小伙伴可以参考一下:

① 镜像源:参考这个链接(有很多镜像hah):Docker更换国内镜像源_群晖docker更换国内镜像源-CSDN博客

② 复制好镜像源之后,docker desktop是支持可视化的镜像配置操作的,大家可以根据下图完成配置:

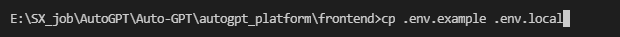

- 进入autogpt_platform下的frontend的终端,输入命令并回车:cp .env.example .env.local

运行结束之后,会在frontend目录下发现.env.local文件,这是前端的环境变量配置文件。

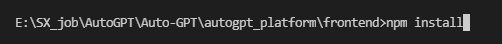

2. 前端依赖下载,终端输入命令并回车:npm install

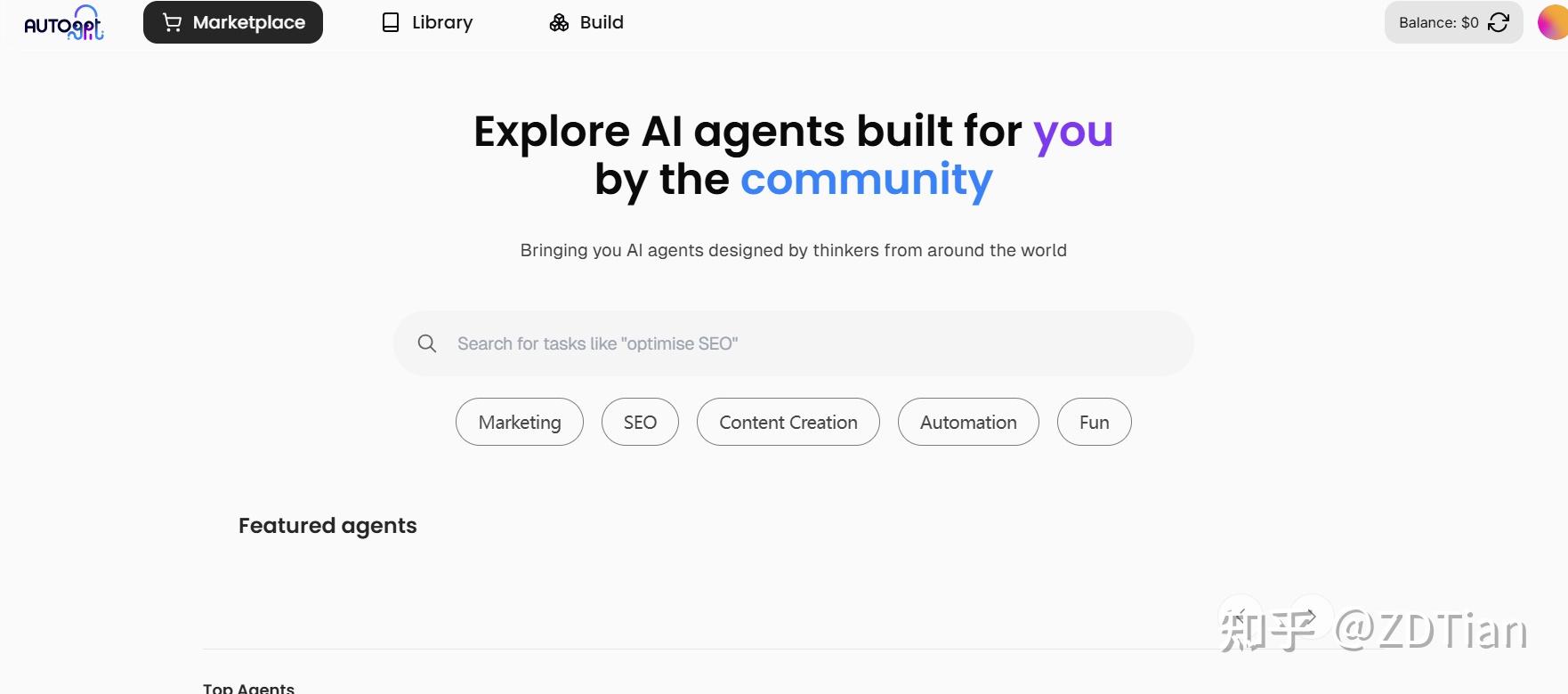

3. 依赖下载好之后,就可以运行前端服务了:npm run dev

到这里呢,就可以访问你部署在本地的AutoGPT了,直接在浏览器输入localhost:3000/login并完成注册与登录即可。注册与登录这里就不详细介绍了,登录之后看到这个界面就可以愉快地使用AutoGPT了!

其次,这里的第一步、第二步和第三步呢其实在官方文档中也有写,如果有些地方和官方文档中记载不一样呢小伙伴们还是以官方为准,毕竟后续不知道啥时候可能官方版本和目前的版本就有差异了。

最后本来还想记录一下自己在开始使用时遇到的一些误解和问题,不过这篇已经很长了,就等下次再更新吧。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/220181.html