硬件需求与模型选择指南

1. 硬件配置建议

1.5B模型适用配置

- 最低要求

4GB显存的GPU(如GTX 1050 Ti) + 8GB内存。

- 推荐配置

6GB显存的GPU(如RTX 2060) + 16GB内存,可提升推理速度。

- 适用场景

简单文本生成、基础问答、轻量级任务(如分类、短文本摘要)。

7B模型适用配置

- 最低要求

8GB显存的GPU(如RTX 3060) + 16GB内存。

- 推荐配置

12GB显存的GPU(如RTX 3080) + 24GB内存,支持更复杂推理。

- 适用场景

中等复杂度任务(如代码生成、机器翻译、情感分析)。

14B及以上模型配置

- 14B模型

需16GB显存的GPU(如RTX 4090) + 32GB内存,适合复杂推理和大规模任务。

- 32B/70B模型

需企业级显卡(如NVIDIA A100) + 64GB内存,适用于科研或高性能计算场景。

2. 模型版本选择建议

|

参数量

|

文件大小

|

适用场景

|

硬件建议

15亿

|

1.1GB

|

轻量级任务(基础对话、文本分类)

|

低端GPU/CPU + 8GB内存

70亿

|

4.7GB

|

中等任务(代码辅助、情感分析)

|

中端GPU(RTX 3060) + 16GB内存

140亿

|

9.0GB

|

复杂推理(逻辑分析、长文本生成)

|

高端GPU(RTX 4090) + 32GB内存

320亿

|

20GB

|

科研级任务(大规模数据分析)

|

企业级GPU(A100) + 64GB内存

|

软件环境

- 操作系统

支持Windows、macOS和Linux系统。

- Ollama

用于本地运行大模型的开源工具。

1.下载Ollama

- 访问Ollama官网(https://ollama.com),选择适合你操作系统的版本进行下载。

- 如果下载很慢,可以从这个地址下载https://www.gy328.com/app/ollama/

- 打开页面点击立即下载

- 然后点击下载,等待下载完成

安装完成后默认启动了Ollama,我们先关闭。右键任务栏的Ollama图标点击退出。

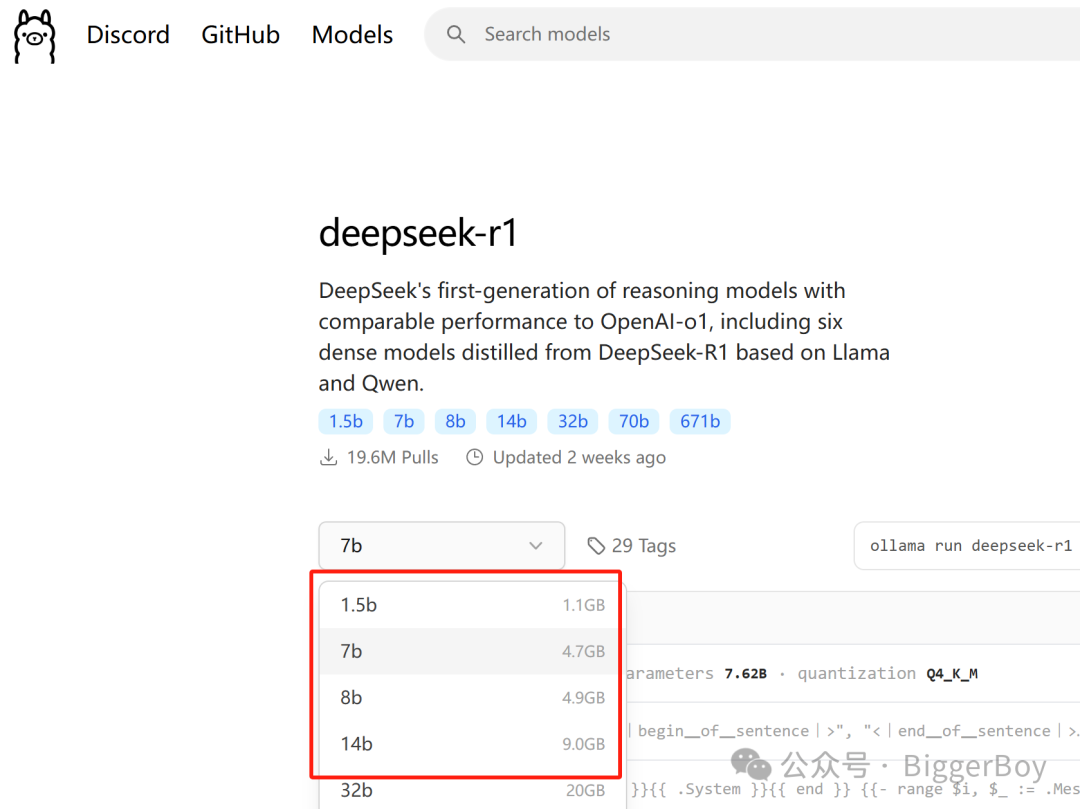

选择模型版本

- 访问Ollama官网的模型库(https://ollama.com/library/deepseek-r1)

- 选择适合你硬件配置的DeepSeek模型版本。例如:

- `deepseek-r1:1.5b`:适合低端设备。

- `deepseek-r1:7b`:适合中端设备。

- `deepseek-r1:14b`:适合高端设备。

- `deepseek-r1:32b`:适合科研级设备。

下载并运行模型

- 我的笔记本电脑配置较低,所以以1.5b模型演示,你可以根据你的硬件配置选择合适的模型。

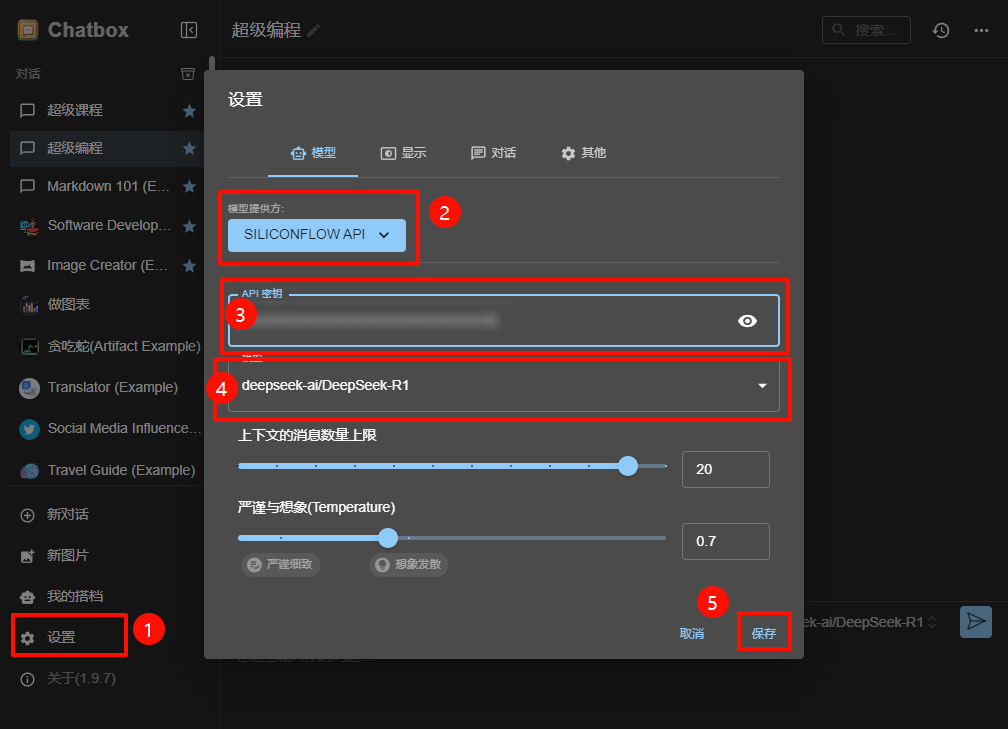

使用Chatbox

- 下载Chatbox

访问Chatbox官网(),下载并安装适合你操作系统的版本。

- 配置Chatbox

打开Chatbox,进入设置页面,选择“Ollama API”作为模型提供方。

在模型选择中,找到已安装的DeepSeek模型(如),保存配置。

- 开始对话

配置完成后,即可在Chatbox中与DeepSeek模型进行交互,享受直观的对话体验。

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “?”“”等问题热议不断。

事实上,

继等巨头公司发布AI产品后,很多中小企业也陆续进场!超高年薪,挖掘AI大模型人才! 如今大厂老板们,也更倾向于会AI的人,普通程序员,还有应对的机会吗?

与其焦虑……

不如成为「」,毕竟AI时代,谁先尝试,谁就能占得先机!

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高。

基于此,我用做产品的心态来打磨这份大模型教程,深挖痛点并持续修改了近70次后,终于把整个AI大模型的学习门槛,降到了最低!

在这个版本当中:

第一您不需要具备任何算法和数学的基础

第二不要求准备高配置的电脑

第三不必懂Python等任何编程语言

您只需要听我讲,跟着我做即可,为了让学习的道路变得更简单,这份大模型教程已经给大家整理并打包,现在将这份 分享出来:包括等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

👉CSDN大礼包🎁:全网最全《LLM大模型入门+进阶学习资源包》免费分享(安全链接,放心点击)👈

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

四、LLM大模型开源教程(LLaLA/Meta/chatglm/chatgpt)

五、AI产品经理大模型教程

阶段1:AI大模型时代的基础理解

- 目标:了解AI大模型的基本概念、发展历程和核心原理。

- 内容:

- L1.1 人工智能简述与大模型起源

- L1.2 大模型与通用人工智能

- L1.3 GPT模型的发展历程

- L1.4 模型工程

- L1.4.1 知识大模型

- L1.4.2 生产大模型

- L1.4.3 模型工程方法论

- L1.4.4 模型工程实践

- L1.5 GPT应用案例

阶段2:AI大模型API应用开发工程

- 目标:掌握AI大模型API的使用和开发,以及相关的编程技能。

- 内容:

- L2.1 API接口

- L2.1.1 OpenAI API接口

- L2.1.2 Python接口接入

- L2.1.3 BOT工具类框架

- L2.1.4 代码示例

- L2.2 Prompt框架

- L2.3 流水线工程

- L2.4 总结与展望

阶段3:AI大模型应用架构实践

- 目标:深入理解AI大模型的应用架构,并能够进行私有化部署。

- 内容:

- L3.1 Agent模型框架

- L3.2 MetaGPT

- L3.3 ChatGLM

- L3.4 LLAMA

- L3.5 其他大模型介绍

阶段4:AI大模型私有化部署

- 目标:掌握多种AI大模型的私有化部署,包括多模态和特定领域模型。

- 内容:

- L4.1 模型私有化部署概述

- L4.2 模型私有化部署的关键技术

- L4.3 模型私有化部署的实施步骤

- L4.4 模型私有化部署的应用场景

这份 包括等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

👉CSDN大礼包🎁:全网最全《LLM大模型入门+进阶学习资源包》免费分享(安全链接,放心点击)👈

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/217611.html