你是否也想真正理解AI,而不只是会用ChatGPT?deepseek?

今天,我用一张图、三个层次、五个要点,带你看透AI的全貌。读完这篇文章,你不仅知道怎么用AI,更能理解它为什么这么智能。

很多人把ChatGPT和AI画等号,这就像把“心血管科医生”等同于“整个医学体系”一样荒谬。

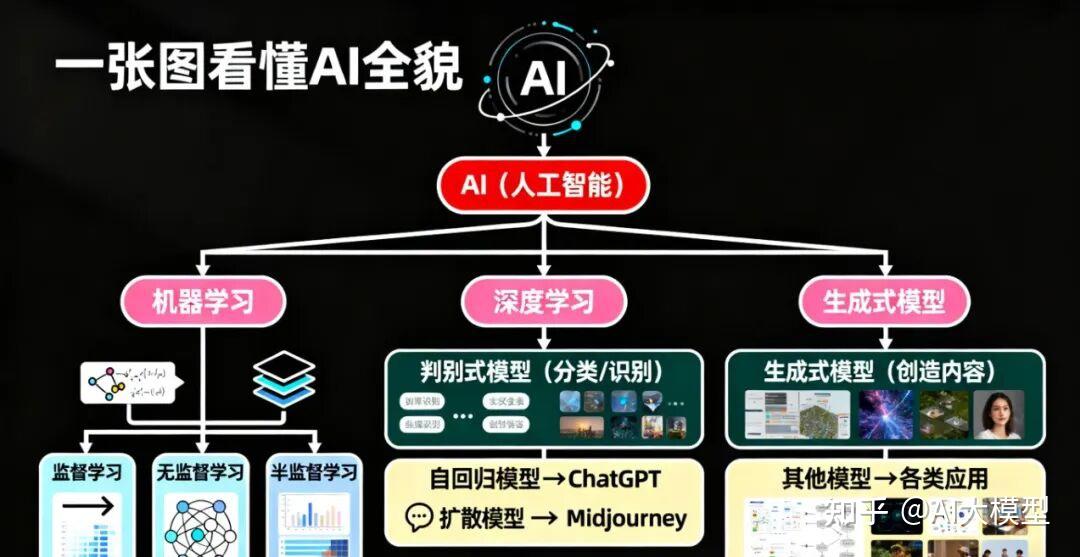

让我用一个医学体系的比喻说清楚:

- AI = 整个医学体系

- 机器学习 = 内科

- 深度学习 = 心血管科

- ChatGPT = 心血管科的一位医生

看到了吗?ChatGPT只是AI大家族中的一个应用。

第一层:**机器学习

机器学习主要解决“让机器从数据中学习规律”的问题,分为三种类型:

- 监督学习:有标签的数据

- 应用:图像分类、语音识别、价格预测

- 无监督学习:只有数据,没有标签

- 应用:用户分群、异常检测

- 半监督学习:少量标签+大量无标签数据

- 应用:医学影像分析(标注成本高的领域)

第二层:**深度学习

想象一个多层的网络结构:

- 输入层:接收原始数据

- 隐藏层:层层处理和提取特征

- 输出层:给出最终结果

随着网络层数增加,AI能处理的任务复杂度呈指数级增长——从识别猫狗,到生成文章,再到写代码。

第三层:**生成式AI

这是当前最火的方向,包括:

- 自回归模型(GPT系列):一个字一个字地预测

- 扩散模型(Midjourney):从噪声逐步生成清晰图像

- 变分自编码器:压缩-解压的方式生成

- 生成对抗网络(GAN):生成器vs判别器的博弈

记住这句话就够了:

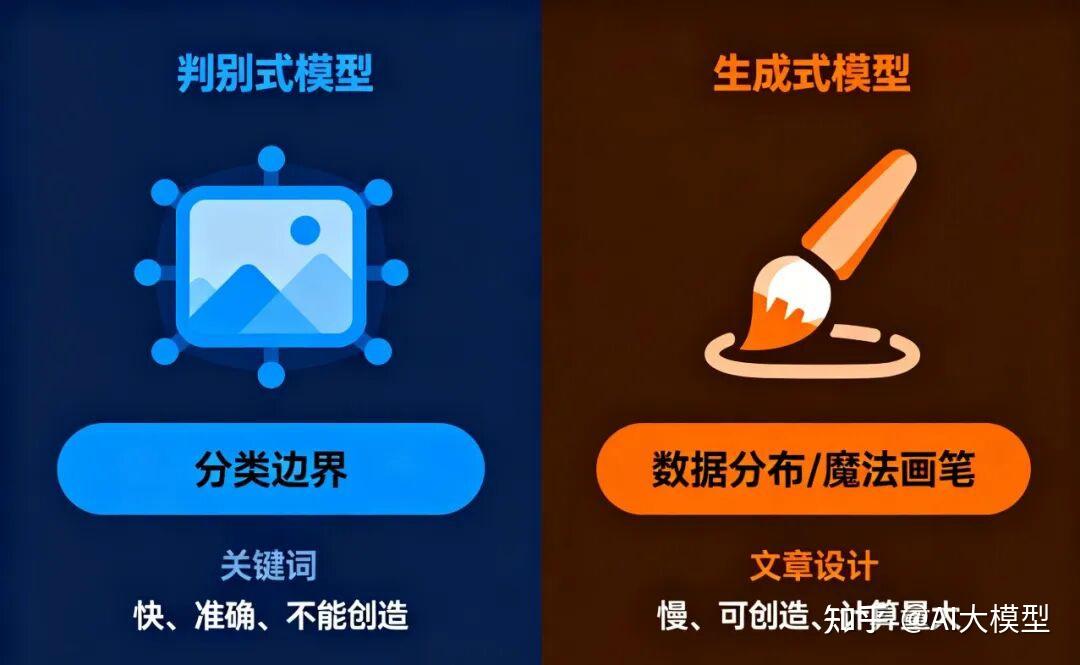

- 判别式模型关注边界(这是猫还是狗?)

- 生成式模型关注分布(猫长什么样?我来画一只)

判别式模型的特点:

✓ 训练快、准确度高

✗ 几乎无法创造新内容

生成式模型的特点:

✓ 能创造全新内容

✗ 训练慢、计算量大

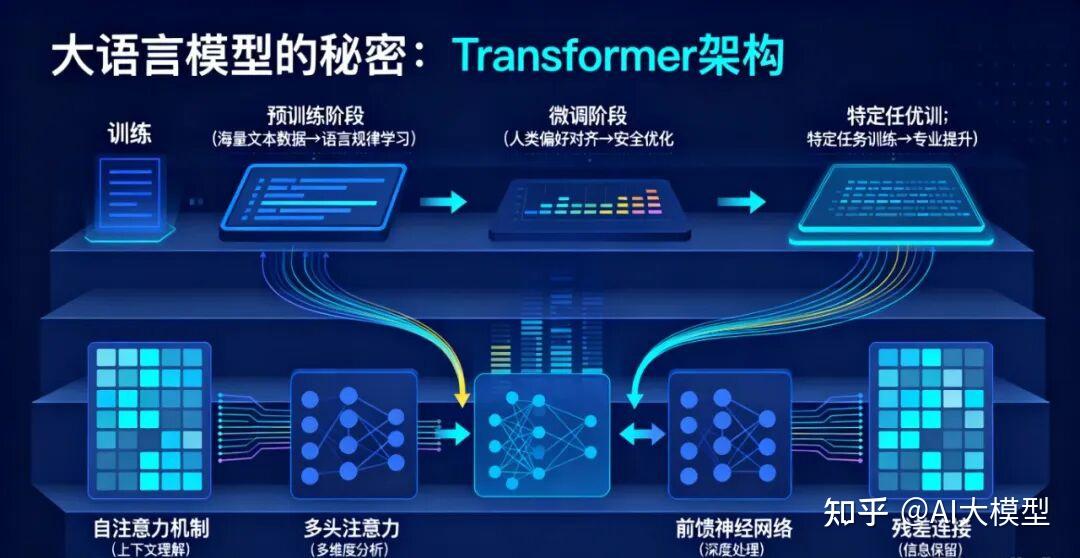

ChatGPT、Claude等大语言模型,底层都是Transformer架构。

它们的训练分两步:

1. 预训练阶段

- 喂给模型海量文本数据

- 让它学会语言的基本规律

2. 微调阶段

- 加入人类偏好对齐(让AI更安全)

- 针对特定任务优化(让AI更专业)

Transformer的核心组件:

- 自注意力机制:理解上下文关系

- 多头注意力:从多个角度理解信息

- 前馈神经网络:深度处理信息

- 残差连接:保证信息不丢失

这就是AI“看起来在思考”的技术基础。

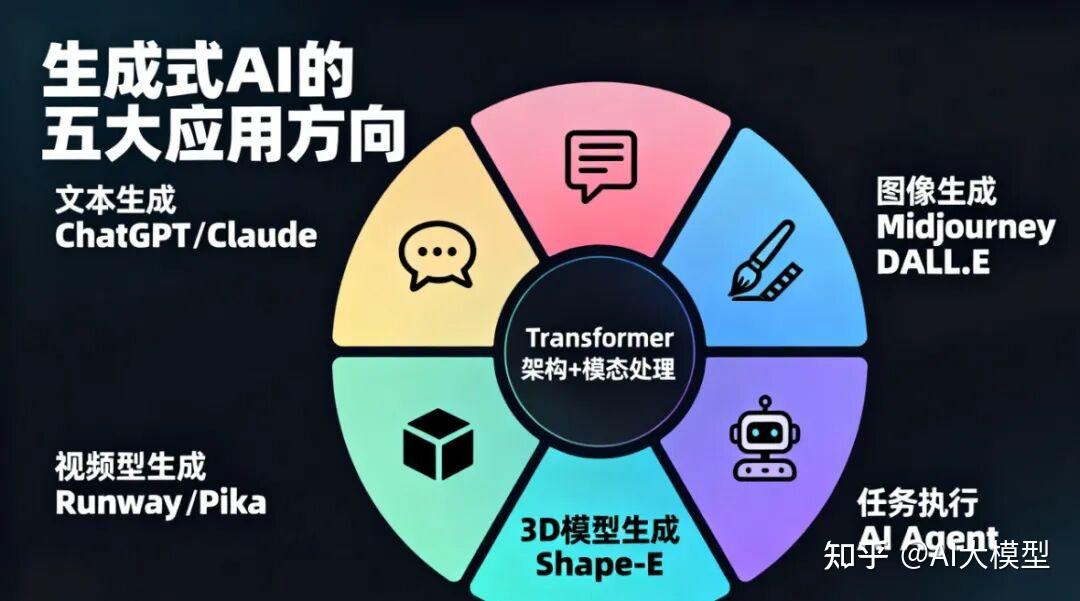

文本生成:ChatGPT、Claude

图像生成:Midjourney、DALL-E

视频生成:Runway、Pika

3D模型生成:Shape-E

任务执行:AI Agent(智能体)

看似不同的应用,背后都是相同的Transformer架构+不同的模态处理。

写在最后:

理解AI的技术脉络,不是为了成为技术专家,而是为了在AI时代做出更明智的选择。

当你知道ChatGPT为什么能写文章,Midjourney为什么能画画,你就能更好地驾驭这些工具,而不是被工具驾驭。

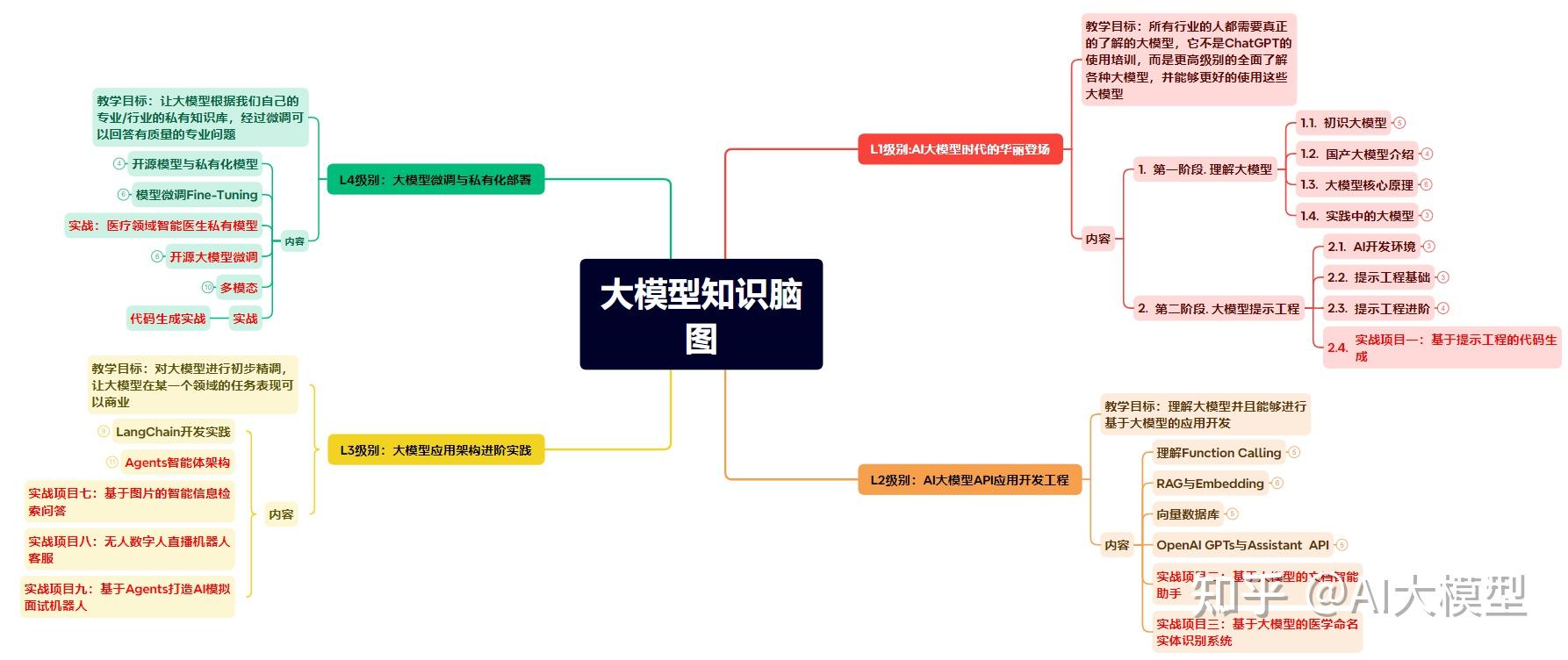

为了帮助开发者打破壁垒,快速了解大模型核心技术原理,学习相关大模型技术。从原理出发真正入局大模型。这里给大家准备了一份涵盖了AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频 全系列的学习资料。这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。

【2025最新总结】AI大模型全套学习资料,免费领取!含最新学习路线、大厂面试真题、可落地的项目实战、经典的PDF书籍…….为了成为更好的 AI大模型 开发者,这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

该阶段让大家对大模型 AI有一个最前沿的认识,对大模型 AI 的理解超过 95% 的人,可以在相关讨论时发表高级、不跟风、又接地气的见解,别人只会和 AI 聊天,而你能调教 AI,并能用代码将大模型和业务衔接。

- 大模型 AI 能干什么?

- 大模型是怎样获得「智能」的?

- 用好 AI 的核心心法

- 大模型应用业务架构

- 大模型应用技术架构

- 代码示例:向 GPT-3.5 灌入新知识

- 提示工程的意义和核心思想

- Prompt 典型构成

- 指令调优方法论

- 思维链和思维树

- Prompt 攻击和防范

- ….

该阶段我们正式进入大模型 AI 进阶实战学习,学会构造私有知识库,扩展 AI 的能力。快速开发一个完整的基于 agent 对话机器人。掌握功能最强的大模型开发框架,抓住最新的技术进展,适合 Python 和 JavaScript 程序员。

- 为什么要做 RAG

- 搭建一个简单的 ChatPDF

- 检索的基础概念

- 什么是向量表示(Embeddings)

- 向量数据库与向量检索

- 基于向量检索的 RAG

- 搭建 RAG 系统的扩展知识

- 混合检索与 RAG-Fusion 简介

- 向量模型本地部署

- ….

恭喜你,如果学到这里,你基本可以找到一份大模型 AI相关的工作,自己也能训练 GPT 了!通过微调,训练自己的垂直大模型,能独立训练开源多模态大模型,掌握更多技术方案。

到此为止,大概2个月的时间。你已经成为了一名“AI小子”。那么你还想往下探索吗?

- 为什么要做 RAG

- 什么是模型

- 什么是模型训练

- 求解器 & 损失函数简介

- 小实验2:手写一个简单的神经网络并训练它

- 什么是训练/预训练/微调/轻量化微调

- Transformer结构简介

- 轻量化微调

- 实验数据集的构建

- ….

对全球大模型从性能、吞吐量、成本等方面有一定的认知,可以在云端和本地等多种环境下部署大模型,找到适合自己的项目/创业方向,做一名被 AI 武装的产品经理。

- 硬件选型

- 带你了解全球大模型

- 使用国产大模型服务

- 搭建 OpenAI 代理

- 热身:基于阿里云 PAI 部署 Stable Diffusion

- 在本地计算机运行大模型

- 大模型的私有化部署

- 基于 vLLM 部署大模型

- 案例:如何优雅地在阿里云私有部署开源大模型

- 部署一套开源 LLM 项目

- 内容安全

- 互联网信息服务算法备案

- …

学习是一个过程,只要学习就会有挑战。天道酬勤,你越努力,就会成为越优秀的自己。

如果你能在15天内完成所有的任务,那你堪称天才。然而,如果你能完成 60-70% 的内容,你就已经开始具备成为一名大模型 AI 的正确特征了。

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/217035.html