在 2025 年,AI / 大模型服务(OpenAI 的 GPT、Anthropic 的 Claude、各种开源模型、绘图模型等)已经成为产品和业务中不可或缺的组成。但对于中国 /国内开发者来说,直接对接这些模型 API,常常遇到以下瓶颈:

- 网络访问受限 / 不稳定:直接调用 OpenAI / Claude 等接口可能受国际链路瓶颈影响,尤其在高并发场景下容易卡顿或失败。

- 多模型接入成本高:不同平台的 API 规范、认证方式、请求路径、错误格式各异,给开发、维护带来负担。

- 账号 / 支付 / 额度管理分散:你可能要在多个平台分别充值、分别监控消耗、处理多个 Key 的限额、计费方式等。

- 切换模型 / 多源容错难:业务中有可能需要切换到备用模型、不同模型组合混用、模型出问题要自动降级等处理,自己做容易出错。

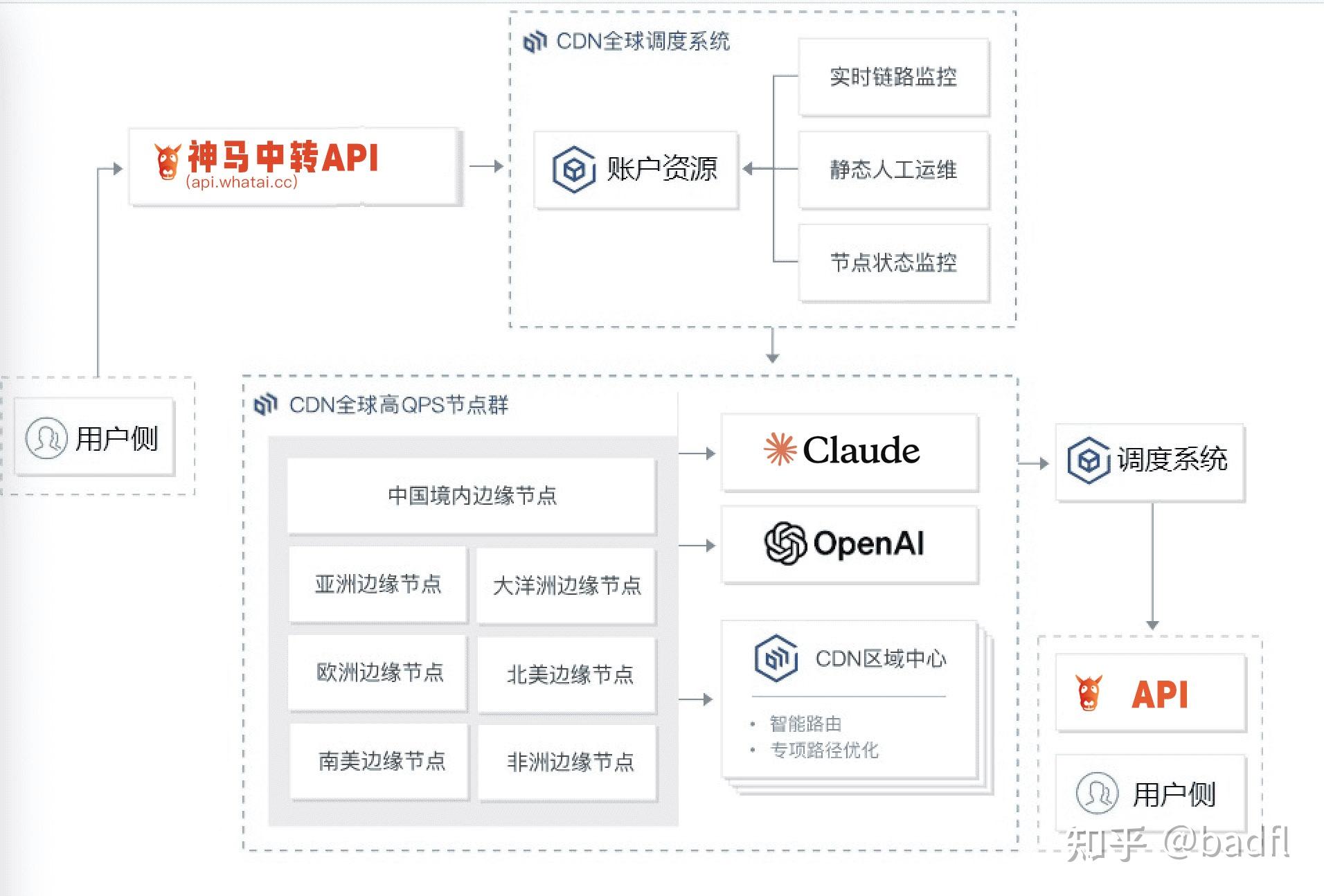

中转 API 的核心价值就在于:做一层统一“中间层”,把对接多个模型、网络加速、错误切换、计费整合等复杂工作都交给中转方处理。你只需一套标准接口、一把 Key,就能调用多种模型。

这也正是用户推荐、行业口碑中常强调的卖点 —— “一个 Key 用遍全球模型”“国内直连”“统一管理”“稳定折扣” 等。知乎上就有不少用户把它比作“大模型的万能适配器”或“中转管道”:

“它就是一个‘万能适配器 + 聚合通道’,帮你把各种大模型的 API 统一成一个标准来用。”

“简单来说,它为你提供一个稳定、快速、低成本的方式使用各种顶级 AI 模型,无需处理跨境网络或支付障碍,开箱即用。”

在中转 API 的生态中,神马中转 API(http://api.whatai.cc) 是其中比较有代表性、功能比较完善的方案之一。下面我从它的产品优势、典型场景、以及接入教程三个方面给出一个结构化介绍。

神马聚合中转 API(http://api.whatai.cc) 是一个将 OpenAI、Claude、Midjourney、Suno 等多个模型 / 服务通过统一接口中转的服务平台。你可以把它理解为一个“AI 模型管道中转站”。

它的主要特点 /卖点包括:

| 特性 / 优势 | 说明 |

|---|---|

| 统一接口标准化 | 对外暴露一套类似 OpenAI 风格的接口(如 /v1/chat/completions、/v1/images/generations 等),下层中转其它模型,实现接口兼容。 |

| 高可用 / 跨区部署 / 加速 | 为了减少跨境网络问题或异地访问瓶颈,平台通常部署多个节点 /加速线路,提供稳定访问。 |

| 聚合计费 / 充值统一管理 | 你在神马中转 API 平台充值后,就可以用同一个 Key 调用多个模型,中转平台帮你做模型层面的计费。 |

| 支持多模型 + 快速切换 | 支持 OpenAI 系列模型、Claude 系列、甚至绘图 /音频 /多模态模型,用户可在请求中切换模型名即可。 |

| 成本 / 折扣 / 促销机制 | 通常平台会以略低于或折扣价向用户提供 model 调用额度(与官方定价进行折扣 /优惠)。 |

| 日志 / 可视化 / 管理面板 | 你可以在后台看到每一次调用、消耗明细、使用趋势等,便于监控。 |

| 开发者友好 | 提供示例代码、SDK、文档说明,接入成本低。 |

- 个人开发者 / 学习者

想做一个聊天机器人或写一个简单 AI 应用,但不想为每个模型注册账号、开通海外支付、管理多个 Key。只要一个 Key,就能调用 GPT / Claude /开源模型。 - 产品/创业团队快速试错

原型期 / MVP 期时,希望快速切换不同模型做对比(可能先用一个模型,再切换更强或成本更低的模型),不希望因对接成本拖慢上线。 - 多模型混用 /降级策略

在正式业务中,希望主用 GPT-4,高峰期切换到 Claude 或更便宜的模型作为 fallback,或按照成本自动切换。中转 API 可以做自动调度 / 多模型切换。 - 跨平台 / 跨区域部署

如果你的应用需要在多个区域(国内、香港、东南亚等)部署,使用中转 API 可以屏蔽网络异构性、跨境访问问题。 - 运维 /监控 /计费统一

企业用户希望统一看到调用日志、成本消耗、异常警报、报警策略等,不想分散在多个平台。

- 注册 /登录

在神马中转 API (http://api.whatai.cc)平台注册账号 - 创建 /获取 API Key /令牌

在控制台生成 /查看你的 API Key 或 Token - 构造请求 / 指定模型

发送请求时带上 API Key、请求体、指定模型名称 - 调试 /查看日志 /监控

在平台后台查看调用日志、消耗明细、错误信息等 - 部署 /上生产 /监控 & 容错

添加重试 /降级策略 /并发控制等,正式上线

平台会给 SDK /示例代码 + 文档帮助你快速上手。

下面是几个常用模型(Claude / OpenAI / Sora / Nano Banana 等)的接入示例代码(以 Python + HTTP 请求为例)。注意:这些代码是基于假设的 API 格式,实际以平台文档为准。

API 统一请求格式

所有模型(包括非OpenAI模型)的请求格式已统一为OpenAI格式。

功能特点

- 使用OpenAI请求格式可调用所有模型(Claude、Gemini、Doubao、Qwen等)

- 支持直接使用OpenAI SDK调用任意模型

基础信息

- Base URL: https://api.whatai.cc

- 认证方式: API Key (替换为

)

import openai配置API密钥

openai.api_key = “” # 替换为你的实际API密钥 openai.api_base = “https://api.whatai.cc" # 设置API基础地址

调用示例(以Claude模型为例)

response = openai.ChatCompletion.create(

GPT plus 代充 只需 145model="claude", # 指定模型名称 messages=[ {"role": "user", "content": "你好"} ]

)

print(response.choices[0].message.content)

Claude 格式 vs OpenAI 格式对比

🎯 请求路径区别

| 接口类型 | 示例请求路径 |

|---|---|

| OpenAI 格式 | http://api.whatai.cc/v1/chat/completions |

| Claude 格式 | http://api.whatai.cc/v1/messages |

🧾 请求体格式差异

OpenAI 格式请求示例:

{GPT plus 代充 只需 145"model": "gpt-4.1", "messages": [ { "role": "user", "content": "Hello!" } ]

}

Claude 格式请求示例:

{GPT plus 代充 只需 145"model": "claude-3-5-sonnet-", "max_tokens": 1024, "messages": [ { "role": "user", "content": "Hello, world" } ]

}

关键差异:

- 参数结构:Claude 请求中必须显式指定

max_tokens;OpenAI 中为可选。 - 字段命名:如

messages等字段虽然类似,但默认行为及语义略有差异。

📦 响应格式差异对比

OpenAI 返回示例

{GPT plus 代充 只需 145"choices": [ { "finish_reason": "stop", "index": 0, "logprobs": null, "message": { "annotations": [], "content": "Hello! How can I assist you today? 😊", "refusal": null, "role": "assistant" } } ], "created": , "id": "chatcmpl-BwvbRo5aJ8TXqFwmmOXsE7eicJig3", "model": "gpt-4.1", "object": "chat.completion", "system_fingerprint": "fp_07e970ab25"

}

Claude 返回示例

{GPT plus 代充 只需 145"id": "msg_01NufbyqybJo5fVtRkH1VPzk", "type": "message", "role": "assistant", "model": "claude-3-5-sonnet-", "content": [ { "type": "text", "text": "Hello! How can I assist you today? Is there anything specific you'd like to talk about or any questions you have?" } ], "stop_reason": "end_turn"

}

主要结构差异:

| 项目 | OpenAI | Claude |

|---|---|---|

| 回复结构 | 使用 choices 数组 | 顶层 content 数组 |

| 内容位置 | choices[0].message.content | content[0].text |

| 元信息 | 包括 created, id, model 等 | 命名结构不同但信息类似 |

| 停止标识 | finish_reason | stop_reason |

- 错误 /重试 /降级机制:即使中转平台比较稳定,也建议在客户端做重试、超时控制、错误 fallback(如主模型调用失败切备用模型)等。

- Token / 上下文限制:模型通常有最大 token 限制(例如 GPT-4 /Claude 等),你要在应用层做好截断 /上下文管理。

- 费用 /消耗监控:密切关注每次调用消耗 tokens /额度,避免意外超支。

- 日志 /异常追踪:在客户端与平台都保留日志,以便排查问题。

- 模型切换策略:你可以在业务逻辑层设计策略,比如“默认用 GPT-4,遇到错误或延迟时切 Claude 或降级模型”

- 版本 /模型更新:平台可能不断引入新的模型版本,建议定期关注平台公告 &新增模型支持。

- 安全 /权限控制:不要把 API Key 写在客户端(如前端 /移动端),应在后端服务器调用中转接口。

- 神马中转 API 是一个 AI 模型中转 / 聚合服务平台,旨在让开发者只用一把 Key 就能调用多个模型,降低接入成本、屏蔽网络困难、统一管理。

- 它的主要价值在于:统一接口 + 高可用 + 模型切换 + 聚合计费 + 易于扩展。

- 常见模型(如 OpenAI、Claude、Sora、Nano Banana 等)只需在调用时指定不同模型名称即可,调用接口形式一致,适配成本很低。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/216903.html