在AI自动化工具快速迭代的2026年,OpenClaw(前身为Clawdbot、曾用名Moltbot)凭借开源属性、多场景适配及灵活的模型调用能力,成为个人与轻量团队打造专属智能助手的热门选择。以往用户部署后常受限于默认国际模型,而2026年的优化版本支持接入国内主流大模型,通过简单命令即可完成配置,大幅提升中文场景下的交互体验与功能适配性。本文整合官方最新指南与实操经验,详细拆解OpenClaw的一键部署流程(含阿里云等主流云平台方案),并重点讲解国内13家主流大模型的接入步骤,同时提供通用配置模板与问题排查方案,确保不同技术基础的用户都能顺利落地。

GPT plus 代充 只需 145

一、核心认知:部署与模型接入的基础逻辑

在启动操作前,需先明确OpenClaw的部署本质与模型接入的核心原理,避免后续配置踩坑。OpenClaw作为AI代理与自动化平台,其核心功能依赖“运行环境+大模型能力+通信通道”三大模块:运行环境提供程序执行载体,大模型负责自然语言理解与任务规划,通信通道则实现多工具(如、钉钉)的交互衔接。此次教程的核心是“先完成部署搭建基础环境,再通过API配置接入目标大模型”,两者结合才能让OpenClaw具备完整的智能执行能力。

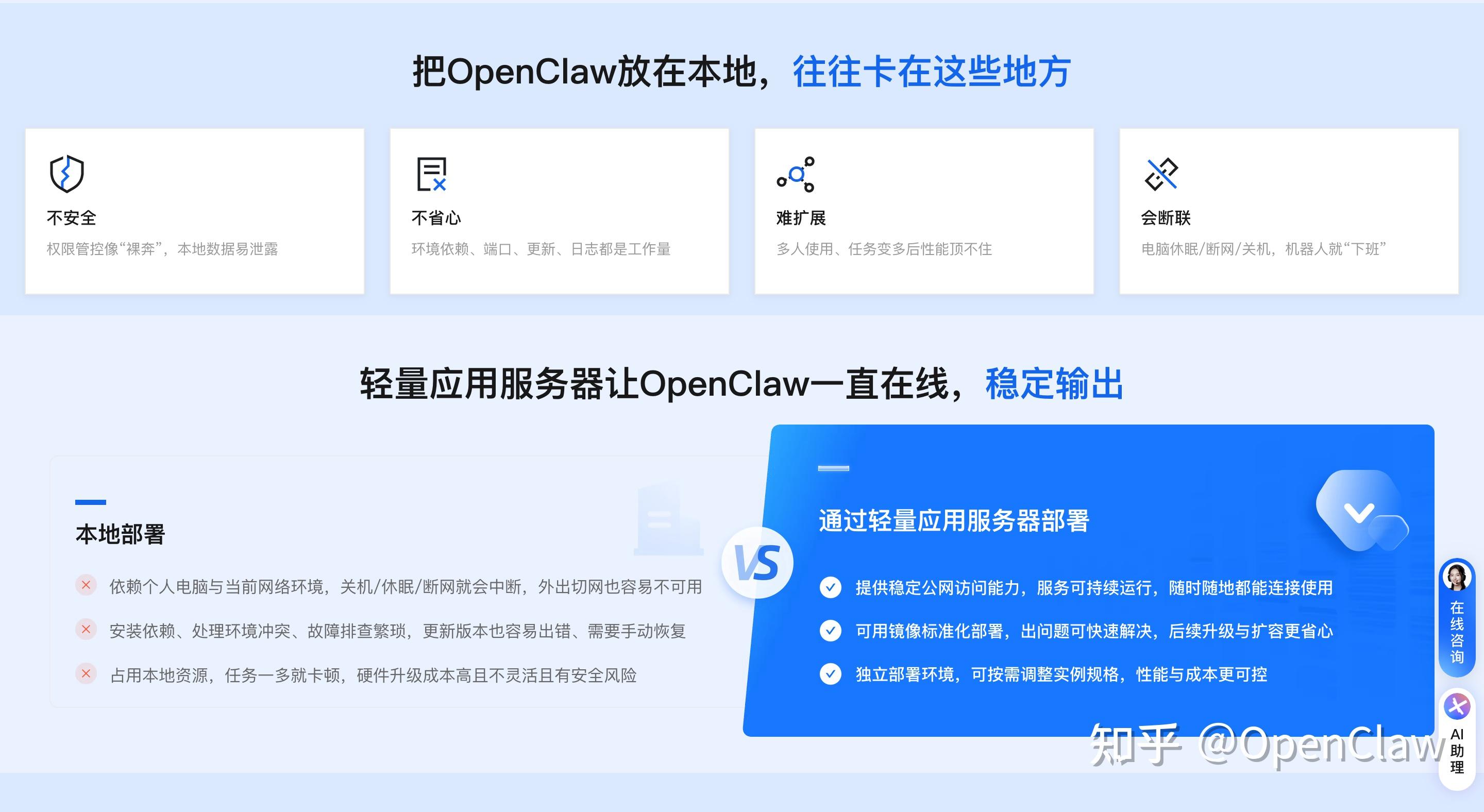

从部署载体来看,OpenClaw支持云服务器与本地设备两种方式:云服务器部署(如阿里云轻量应用服务器)依托云端算力,可实现7×24小时不间断运行,且无需手动配置复杂依赖,适合零基础用户与需要长期运行自动化任务的场景;本地部署则数据存储在本地设备,适合对隐私敏感但无需跨设备访问的用户,但需手动处理Node.js等依赖安装,且受设备性能限制。

模型接入的关键在于“兼容OpenAI协议”——国内多数主流大模型均提供兼容该协议的接口,OpenClaw通过配置baseUrl(模型接口地址)、apiKey(授权凭证)与models(模型列表)三大参数,即可实现与目标模型的对接。无论是深度求索、通义千问等独立大模型厂商,还是硅基流动等AI基础设施平台,接入逻辑均遵循这一标准,仅需根据不同厂商的参数要求调整配置内容。

二、前置准备:部署与模型接入的必备条件

无论选择何种部署方式或接入哪个大模型,以下基础准备需提前完成,确保后续流程顺畅:

(一)环境与载体准备

- 部署载体选择:

- 云服务器部署(推荐):优先选择2vCPU+2GiB内存以上配置,如阿里云轻量应用服务器,默认地域推荐海外/港澳台(如中国香港、新加坡,免ICP备案),国内地域(如杭州、北京)需完成备案后才能正常访问。

- 本地部署:需确保设备满足CPU≥2核、内存≥2GiB、存储≥40GB,且Node.js版本≥22(部分功能依赖该版本核心特性),Windows用户建议安装WSL2以提升兼容性。

- 工具准备:

- 终端工具:Windows用PowerShell(管理员模式),macOS/Linux用系统自带终端,用于执行部署与配置命令;

- 浏览器:推荐Chrome/Edge最新版,用于访问OpenClaw配置页面与大模型平台;

- 记事本:用于保存

apiKey、服务器公网IP等核心凭证,避免配置时反复查找。

- 大模型APIKey:这是接入模型的核心授权凭证,需在对应厂商平台注册账号并完成实名认证(个人用户通常10分钟内可完成,企业用户需1-3个工作日审核),然后在“密钥管理”页面创建并复制

apiKey。国内主流大模型的apiKey获取地址后续会详细列出,建议提前收藏对应平台链接。 - 云服务器相关凭证(若选择云部署):如阿里云账号(需完成实名认证)、服务器公网IP(部署后用于访问OpenClaw配置页面),新用户可在云平台领取试用额度,降低测试成本。

- 通信通道Token(可选):若需通过、钉钉等工具与OpenClaw交互,需提前准备对应平台的Token(如钉钉APP KEY、机器人Token),可在部署完成后补充配置。

- OpenClaw版本:需确保为2026年1月后更新的版本(推荐v2026.1.25及以上),旧版本可能存在模型接入兼容性问题,可通过

openclaw –version命令查看当前版本,低于要求则执行npm update -g openclaw升级。 - 模型协议兼容性:确认目标大模型支持OpenAI协议(多数国内厂商均已支持,可在官网文档中查询),避免选择仅提供专属SDK的模型(需额外开发适配,新手不推荐)。

三、第一步:OpenClaw一键部署全流程(阿里云方案为例)

阿里云作为主流云平台,提供OpenClaw专属预置镜像,可跳过手动安装依赖的步骤,零基础用户也能在10分钟内完成部署,具体步骤如下:

(一)云服务器实例创建与镜像部署

- 进入专属部署页面:登录阿里云控制台,直接 访问阿里云OpenClaw一键部署专题页面,或通过“产品→人工智能→OpenClaw云服务”进入部署页面,点击“立即购买”跳转至配置界面。

阿里云OpenClaw一键部署专题页面:https://www.aliyun.com/activity/ecs/clawdbot

- 核心参数配置:

- 镜像选择:切换至“应用镜像”分类,搜索“OpenClaw(原Moltbot/Clawdbot)”,选中官方认证镜像(2026年默认版本为v2026.1.25,基于Alibaba Cloud Linux 3构建,已预装Node.js 22、Python 3.9及所有核心依赖)。

- 实例规格:默认2vCPU+2GiB内存+40GiB ESSD系统盘+200Mbps带宽,满足日常自动化任务(如文档生成、邮件分类);若需处理多工具并发,可升级至4vCPU+4GiB配置。

- 地域选择:海外/港澳台地域(如中国香港、新加坡)免备案,购买后可直接使用;国内地域需后续完成ICP备案,否则无法正常访问公网IP。

- 购买时长:短期测试选月付,长期使用选年付(性价比更高),支持随时升级配置。

- 完成购买与实例启动:核对参数与费用后,勾选服务协议并支付,等待1-3分钟直至实例状态从“创建中”变为“运行中”,记录实例的公网IP地址(后续配置核心凭证)。若已有阿里云服务器,可通过“重置系统”功能选择OpenClaw镜像(重置前需备份系统盘数据)。

- 端口放通:进入轻量应用服务器控制台,找到目标实例并点击“应用详情”,OpenClaw默认通信端口为18789,点击“一键放通”按钮,系统会自动配置防火墙规则,无需手动编写命令。

- 服务启动验证:打开浏览器,在地址栏输入“http://服务器公网IP:18789”,若页面显示“OpenClaw Gateway”登录界面,说明服务器端部署成功;若提示“无法访问”,可刷新页面等待30秒(服务可能延迟启动),或检查端口是否放通。

(三)本地部署备选方案(技术用户可选)

若选择本地部署,需手动安装依赖,步骤如下:

- 安装Node.js:Windows用户下载官网msi安装包(https://nodejs.org/),选择v22及以上版本,安装时勾选“Add Node.js to PATH”;macOS/Linux用户通过

brew install node@22(macOS)或sudo apt install nodejs=22.x.x(Linux)安装。 - 一键安装OpenClaw:

- Windows(PowerShell管理员模式):

iwr -useb https://clawd.bot/install.ps1 | iex; - macOS/Linux:

curl -fsSL https://clawd.bot/install.sh | bash。

- 启动服务:执行

openclaw gateway start启动核心服务,输入openclaw –version显示版本号即部署成功,本地访问地址为“http://localhost:18789”。

第二步:国内主流大模型接入详细步骤

完成部署后,需接入大模型才能让OpenClaw具备智能交互能力。以下按“独立厂商模型”“AI基础设施平台模型”分类,详细讲解13家主流大模型的接入步骤,所有操作均在终端(云服务器通过远程连接,本地部署直接打开终端)中执行。

(一)独立厂商大模型接入(11家主流方案)

1. 深度求索(DeepSeek)

- APIKey获取:访问https://platform.deepseek.com/api_keys,登录后点击“创建API Key”,复制生成的密钥。

- 执行配置命令:clawdbot config set ‘models.providers.deepseek’ –json ‘{ “baseUrl”: “https://api.deepseek.com/v1”, “apiKey”: “你的DeepSeek APIKey”, “api”: “openai-completions”, “models”: [ { “id”: “deepseek-chat”, “name”: “DeepSeek Chat” }, { “id”: “deepseek-reasoner”, “name”: “DeepSeek Reasoner” } ] }’

- 设置默认模型:

clawdbot models set deepseek/deepseek-chat,执行后OpenClaw默认使用该模型响应指令。

- APIKey获取:登录阿里云百炼平台(https://dashscope.console.aliyun.com/apiKey),在“密钥管理”页面创建并复制APIKey。

- 执行配置命令:clawdbot config set ‘models.providers.qwen’ –json ‘{ “baseUrl”: “https://dashscope.aliyuncs.com/compatible-mode/v1”, “apiKey”: “你的阿里云百炼APIKey”, “api”: “openai-completions”, “models”: [ { “id”: “qwen-max”, “name”: “Qwen Max” }, { “id”: “qwen-plus”, “name”: “Qwen Plus” }, { “id”: “qwen-turbo”, “name”: “Qwen Turbo” }, { “id”: “qwen3-coder-plus”, “name”: “Qwen3 Coder Plus” } ] }’

- 设置默认模型:

clawdbot models set qwen/qwen-max,适合中文创作与逻辑推理场景。

- APIKey获取:访问https://console.bce.baidu.com/qianfan/ais/console/applicationConsole/application,创建应用后获取APIKey与SecretKey(需在配置中拼接为“APIKey:SecretKey”格式)。

- 执行配置命令:clawdbot config set ‘models.providers.baidu’ –json ‘{ “baseUrl”: “https://qianfan.baidubce.com/v2”, “apiKey”: “你的APIKey:SecretKey”, “api”: “openai-completions”, “models”: [ { “id”: “ernie-4.0-8k”, “name”: “ERNIE 4.0 8K” }, { “id”: “ernie-4.0-turbo-8k”, “name”: “ERNIE 4.0 Turbo 8K” }, { “id”: “ernie-3.5-8k”, “name”: “ERNIE 3.5 8K” } ] }’

- 设置默认模型:

clawdbot models set baidu/ernie-4.0-8k,适合产业级知识问答场景。

- APIKey获取:访问https://hunyuan.cloud.tencent.com/#/app/apiKeyManage,登录后创建并复制APIKey。

- 执行配置命令:clawdbot config set ‘models.providers.hunyuan’ –json ‘{ “baseUrl”: “https://api.hunyuan.cloud.tencent.com/v1”, “apiKey”: “你的混元APIKey”, “api”: “openai-completions”, “models”: [ { “id”: “hunyuan-2.0-instruct-”, “name”: “混元 2.0 Instruct” }, { “id”: “hunyuan-turbo-latest”, “name”: “混元 Turbo Latest” }, { “id”: “hunyuan-pro”, “name”: “混元 Pro” } ] }’

- 设置默认模型:

clawdbot models set hunyuan/hunyuan-2.0-instruct-,中文理解能力突出。

- APIKey获取:访问https://open.bigmodel.cn/usercenter/apikeys,创建并复制APIKey。

- 执行配置命令:clawdbot config set ‘models.providers.zhipu’ –json ‘{ “baseUrl”: “https://open.bigmodel.cn/api/paas/v4”, “apiKey”: “你的智谱APIKey”, “api”: “openai-completions”, “models”: [ { “id”: “glm-4-plus”, “name”: “GLM-4 Plus” }, { “id”: “glm-4-air”, “name”: “GLM-4 Air” }, { “id”: “glm-4v-plus”, “name”: “GLM-4V Plus” } ] }’

- 设置默认模型:

clawdbot models set zhipu/glm-4-plus,适合代码生成与多模态交互。

- APIKey获取:登录火山引擎控制台(https://console.volcengine.com/ark/region:ark+cn-beijing/apiKey),创建应用后获取APIKey。

- 执行配置命令:clawdbot config set ‘models.providers.doubao’ –json ‘{ “baseUrl”: “https://ark.cn-beijing.volces.com/api/v3”, “apiKey”: “你的豆包APIKey”, “api”: “openai-completions”, “models”: [ { “id”: “doubao-pro-32k”, “name”: “豆包 Pro 32K” }, { “id”: “doubao-lite-32k”, “name”: “豆包 Lite 32K” } ] }’

- 设置默认模型:

clawdbot models set doubao/doubao-pro-32k,适合日常对话与创作。

- APIKey获取:访问https://console.xfyun.cn/services/bm35,创建应用后获取APIKey与SecretKey(配置时需拼接)。

- 执行配置命令:clawdbot config set ‘models.providers.spark’ –json ‘{ “baseUrl”: “https://spark-api-open.xf-yun.com/v1”, “apiKey”: “你的APIKey:SecretKey”, “api”: “openai-completions”, “models”: [ { “id”: “spark-4.0-ultra”, “name”: “星火 4.0 Ultra” }, { “id”: “spark-max”, “name”: “星火 Max” }, { “id”: “spark-lite”, “name”: “星火 Lite” } ] }’

- 设置默认模型:

clawdbot models set spark/spark-4.0-ultra,中文语义理解能力强。

- APIKey获取:访问https://platform.minimaxi.com/user-center/basic-information/interface-key,复制APIKey。

- 执行配置命令:clawdbot config set ‘models.providers.minimax’ –json ‘{ “baseUrl”: “https://api.minimaxi.com/v1”, “apiKey”: “你的MiniMax APIKey”, “api”: “openai-completions”, “models”: [ { “id”: “MiniMax-M2.1”, “name”: “MiniMax M2.1” }, { “id”: “MiniMax-M2.1-lightning”, “name”: “MiniMax M2.1 Lightning” } ] }’

- 设置默认模型:

clawdbot models set minimax/MiniMax-M2.1,适合轻量交互场景。

- APIKey获取:访问https://platform.moonshot.cn/console/api-keys,创建并复制APIKey。

- 执行配置命令:clawdbot config set ‘models.providers.moonshot’ –json ‘{ “baseUrl”: “https://api.moonshot.cn/v1”, “apiKey”: “你的Moonshot APIKey”, “api”: “openai-completions”, “models”: [ { “id”: “moonshot-v1-8k”, “name”: “Moonshot V1 8K” }, { “id”: “moonshot-v1-128k”, “name”: “Moonshot V1 128K” } ] }’

- 设置默认模型:

clawdbot models set moonshot/moonshot-v1-128k,长上下文处理能力突出(支持128K tokens)。

- APIKey获取:访问https://platform.baichuan-ai.com/console/apikey,创建并复制APIKey。

- 执行配置命令:clawdbot config set ‘models.providers.baichuan’ –json ‘{ “baseUrl”: “https://api.baichuan-ai.com/v1”, “apiKey”: “你的百川APIKey”, “api”: “openai-completions”, “models”: [ { “id”: “Baichuan4”, “name”: “百川4” }, { “id”: “Baichuan3-Turbo-128k”, “name”: “百川3 Turbo 128K” } ] }’

- 设置默认模型:

clawdbot models set baichuan/Baichuan4,适合知识问答与长文本生成。

- APIKey获取:访问https://platform.stepfun.com/interface-key,复制APIKey。

- 执行配置命令:clawdbot config set ‘models.providers.stepfun’ –json ‘{ “baseUrl”: “https://api.stepfun.com/v1”, “apiKey”: “你的阶跃星辰APIKey”, “api”: “openai-completions”, “models”: [ { “id”: “step-2-16k”, “name”: “Step 2 16K” }, { “id”: “step-1-128k”, “name”: “Step 1 128K” } ] }’

- 设置默认模型:

clawdbot models set stepfun/step-2-16k,多模态理解能力优异。

(二)AI基础设施平台模型接入(2家主流方案)

1. 硅基流动

- 特点:提供多种开源与闭源模型的统一访问接口,性价比高,适合需要切换多模型的场景。

- APIKey获取:访问https://cloud.siliconflow.cn/account/ak,创建并复制APIKey。

- 执行配置命令:clawdbot config set ‘models.providers.siliconflow’ –json ‘{ “baseUrl”: “https://api.siliconflow.cn/v1”, “apiKey”: “你的硅基流动APIKey”, “api”: “openai-completions”, “models”: [ { “id”: “deepseek-ai/DeepSeek-V3”, “name”: “DeepSeek V3” }, { “id”: “Qwen/Qwen2.5-72B-Instruct”, “name”: “Qwen2.5 72B” }, { “id”: “meta-llama/Llama-3.3-70B-Instruct”, “name”: “Llama 3.3 70B” } ] }’

- 设置默认模型:

clawdbot models set siliconflow/deepseek-ai/DeepSeek-V3。

- 特点:除通义千问外,还支持接入第三方模型,适合统一管理多模型授权。

- APIKey获取:同“通义千问”步骤,使用阿里云百炼APIKey。

- 执行配置命令(以接入Llama 3为例):clawdbot config set ‘models.providers.aliyun-bailian’ –json ‘{ “baseUrl”: “https://dashscope.aliyuncs.com/compatible-mode/v1”, “apiKey”: “你的阿里云百炼APIKey”, “api”: “openai-completions”, “models”: [ { “id”: “llama-3-70b-instruct”, “name”: “Llama 3 70B Instruct” }, { “id”: “claude-3-opus-”, “name”: “Claude 3 Opus” } ] }’

- 设置默认模型:

clawdbot models set aliyun-bailian/llama-3-70b-instruct。

(三)通用配置模板:接入任意兼容OpenAI协议的模型

若上述未覆盖目标模型,可使用以下通用模板,只需替换{provider_name}(厂商标识)、{baseurl}(模型接口地址)、{model_id}(模型ID)与{model_name}(模型名称)即可:

# 1. 配置模型参数 clawdbot config set ‘models.providers.{provider_name}’ –json ‘{ “baseUrl”: “https://{baseurl}”, “apiKey”: “你的模型APIKey”, “api”: “openai-completions”, “models”: [ { “id”: “{model_id}”, “name”: “{model_name}” } ] }’ # 2. 设置模型合并模式(支持多模型共存) clawdbot config set models.mode merge # 3. 设置默认模型 clawdbot models set {provider_name}/{modelid}

例如接入某小众模型“ABC-Model”,参数替换后为:

clawdbot config set ‘models.providers.abc’ –json ‘{ “baseUrl”: “https://api.abc-ai.com/v1”, “apiKey”: “sk-abc”, “api”: “openai-completions”, “models”: [ { “id”: “abc-model-8k”, “name”: “ABC Model 8K” } ] }’ clawdbot config set models.mode merge clawdbot models set abc/abc-model-8k

四、功能验证与常见问题排查

(一)模型接入验证

配置完成后,需通过简单指令测试模型是否正常响应:

- ”>打开OpenClaw配置页面(云部署:http://公网IP:18789;本地部署:http://localhost:18789);

- 在对话输入框中发送指令,如“帮我生成一份周工作计划模板”“解释什么是AI代理”;

- 若10秒内收到符合逻辑的文字回复,说明模型接入成功;若长时间无响应或提示“模型调用失败”,需按以下步骤排查。

(二)高频问题解决方案

1. APIKey验证失败(最常见)

- 现象:配置后提示“apiKey invalid”或“未授权访问”;

- 原因:APIKey输入错误(多空格、少字符)、密钥已过期、账号无可用调用额度;

- 解决方案:

- 重新复制APIKey,确保无多余空格或字符遗漏(建议直接从厂商平台复制,避免手动输入);

- 登录模型厂商平台,检查密钥状态(是否被禁用)与剩余额度(新用户可领取免费额度);

- 若使用拼接格式(如百度文心的“APIKey:SecretKey”),确认分隔符为英文冒号,无中文符号。

- 现象:提示“连接超时”或“无法解析域名”;

- 原因:baseUrl与模型厂商实际接口地址不匹配,或地域节点选择错误;

- 解决方案:

- 查阅厂商官方文档,确认兼容OpenAI协议的baseUrl(如通义千问为“https://dashscope.aliyuncs.com/compatible-mode/v1”,不可直接使用专属SDK地址);

- 若模型分地域节点(如阿里云百炼分北京、杭州),选择与服务器地域邻近的节点,降低延迟。

- 现象:提示“model not found”或“模型不存在”;

- 原因:model_id与厂商提供的实际ID不匹配(区分大小写);

- 解决方案:

- 从厂商文档中复制正确的model_id(如智谱GLM-4 Plus的ID为“glm-4-plus”,不可写为“GLM-4-Plus”);

- 部分模型需指定版本号(如腾讯混元的“hunyuan-2.0-instruct-”),不可省略后缀。

- 现象:配置后仍使用旧模型响应;

- 原因:修改模型配置后未重启OpenClaw服务,新参数未加载;

- 解决方案:执行

clawdbot gateway restart重启服务,等待30秒后重新测试。

- 现象:本地无法访问OpenClaw配置页面;

- 原因:18789端口未放通,或防火墙规则限制;

- 解决方案:

- 阿里云部署:进入实例“应用详情→防火墙配置”,确认18789端口已放通;

- 本地部署:Windows关闭防火墙或添加端口例外,Linux执行

sudo ufw allow 18789/tcp。

五、进阶技巧:多模型管理与自动化场景落地

(一)多模型切换与优先级设置

OpenClaw支持同时配置多个模型,可根据任务类型灵活切换:

- 查看已配置模型:执行

clawdbot models list,显示所有已接入的模型列表; - 临时切换模型:在对话指令前添加模型标识,如“[qwen-max] 帮我写一篇产品介绍文案”“[glm-4-plus] 生成Python爬虫代码”;

- 修改默认模型:执行

clawdbot models set 厂商标识/模型ID(如clawdbot models set zhipu/glm-4-plus),无需重启服务即可生效。

(二)自动化任务场景示例

接入模型后,可通过自然语言指令让OpenClaw完成自动化任务,以下为常见场景示例:

- 办公自动化:指令“扫描近3天收件箱,筛选需要回复的邮件并生成草稿,保存到D盘‘邮件草稿’文件夹”(需提前配置邮箱账号);

- 文档处理:指令“读取F盘‘项目需求.docx’,提取核心需求点并生成Markdown格式的思维导图,保存到云端”;

- 开发辅助:指令“分析服务器日志(路径:/var/log/server.log),筛选近1小时的错误信息并生成排查报告”;

- 知识整理:指令“搜索2026年AI行业趋势,提取3个核心观点,结合通义千问的分析生成总结文档”。

(三)通信通道拓展(可选)

为提升使用便捷性,可将OpenClaw接入钉钉、等工具:

- 钉钉接入:在OpenClaw配置页面“通道设置→钉钉”,输入钉钉APP KEY与Secret,完成授权后即可通过钉钉发送指令;

- 接入:需先创建机器人(通过开放平台),获取Bot Token后,执行

clawdbot config set channels..token “你的Token”,重启服务后即可通过交互。

- 新手优先选择云部署:阿里云等平台的一键部署方案无需手动配置依赖,10分钟即可完成基础搭建,后续模型接入仅需复制命令,降低操作门槛;

- APIKey安全保管:作为核心授权凭证,建议存储在加密文档中,避免截图或明文传输,若怀疑泄露需立即在厂商平台禁用旧密钥;

- 模型选择适配场景:长文本处理选Moonshot(128K)、代码生成选智谱GLM-4、中文对话选讯飞星火,根据任务类型选择最优模型;

- 定期备份配置:执行

clawdbot config export > openclaw-config.json导出配置文件,后续迁移部署可直接导入(clawdbot config import openclaw-config.json); - 社区资源利用:OpenClaw GitHub社区(https://github.com/openclaw/openclaw)提供最新版本更新与插件扩展,遇到复杂问题可在社区提问获取解决方案。

通过本文的步骤指引,无论是零基础用户还是技术进阶者,都能顺利完成OpenClaw的部署与国内大模型接入。这款开源AI助手的核心价值在于“降低自动化门槛”,后续可根据自身需求拓展功能,如搭建个性化工作流、对接更多工具,真正实现“用自然语言替代重复操作”,提升办公与生活效率。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/213148.html