记得 ChatGPT 被很多人吐槽,基础的加减法都会出错

但我看 GPT-4 的演示,是可以解复杂函数的

是确实有很大提升吗?这是怎么做到的?

没有本质性的提升。

从测试情况看,GPT-4的数学能力的提升来自于更多的训练和微调。由于学习了更多的内容,它可以回答的数学问题也变得更多了。但是在根本的问题—保证推导的真实或者至少是计算的准确上,GPT-4和3.5的版本没有大的区别。在这一点上GPT-4仍然是一个很纯粹的语言生成模型—开发者甚至没有给它内置一个哪怕是最基本的计算器。

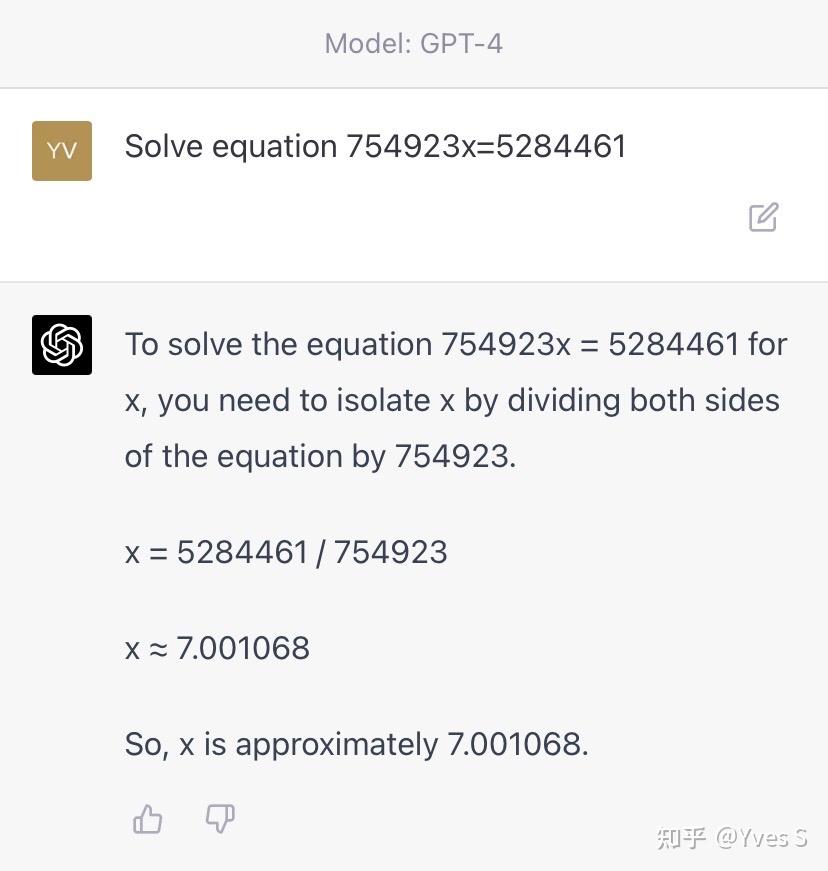

比如,它无法精确地解出一元一次方程:

方法完全对,但是解应该是整数7。换句话说它不会算(大数的)除法。当然它自己也知道这一点,所以用了约等于号。

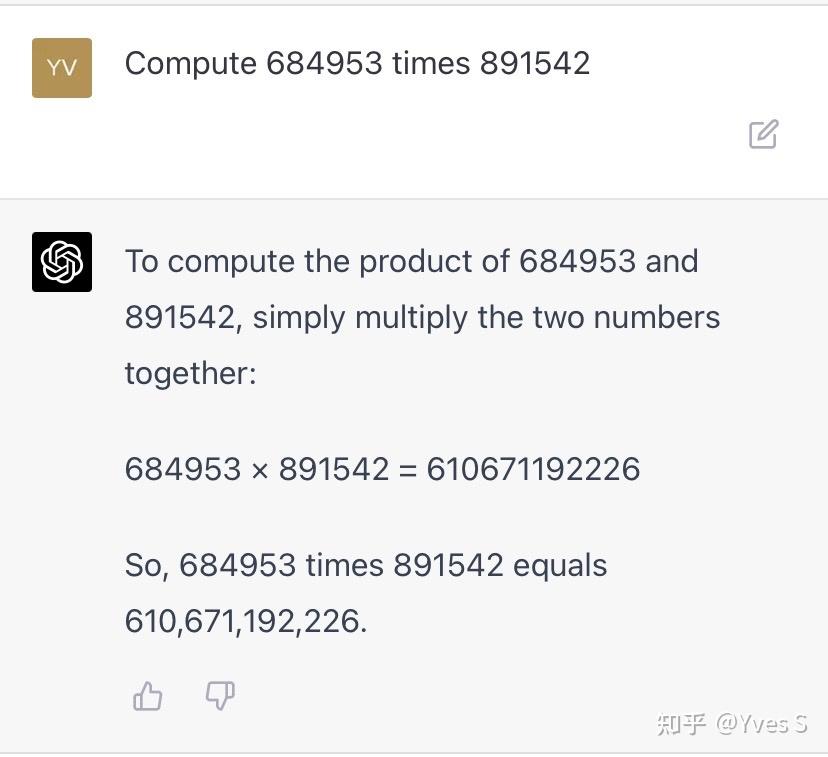

事实上它也不会算乘法:

只要数够大,大到它没有学过同样的内容,最后的结果就是估计的。这个结果很有欺骗性,因为位数是对的,前四位都是对的(可能见过接近的乘数),最后两位也是对的,只有中间是瞎猜的。正确结果应该是610,664,367,526。

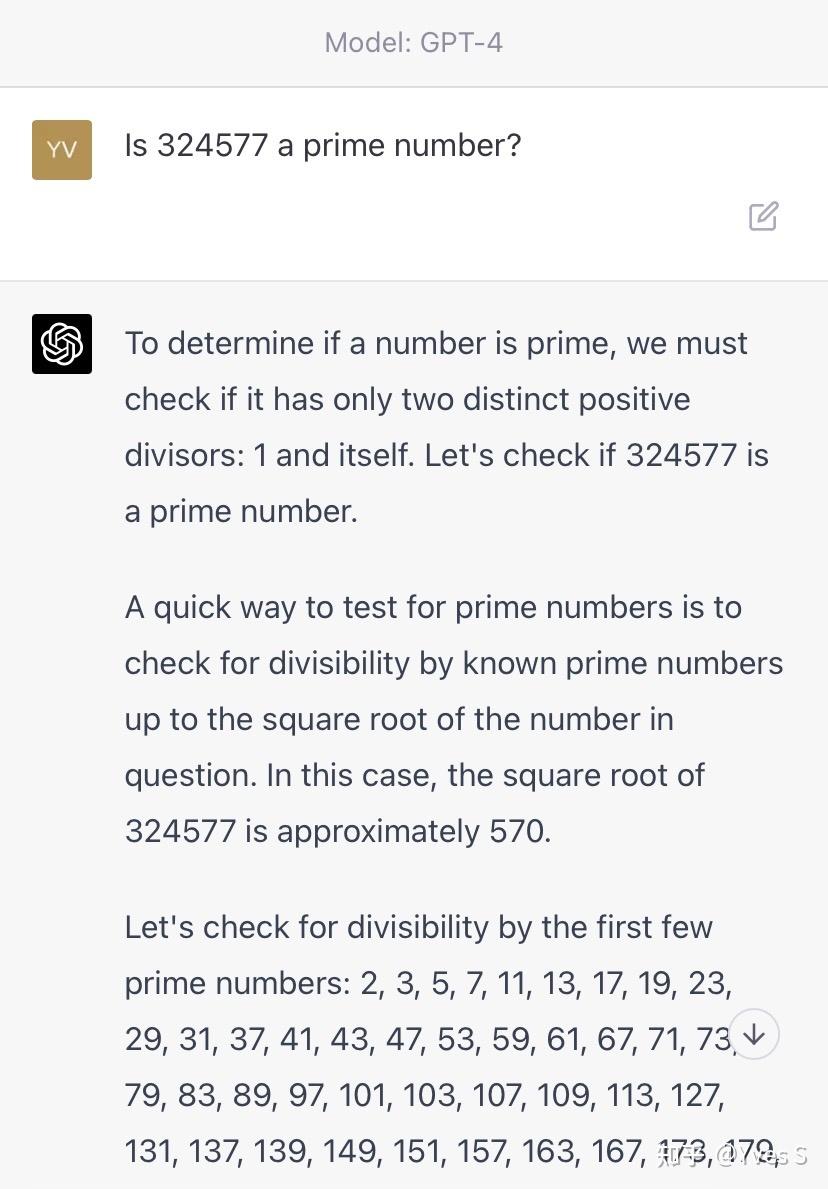

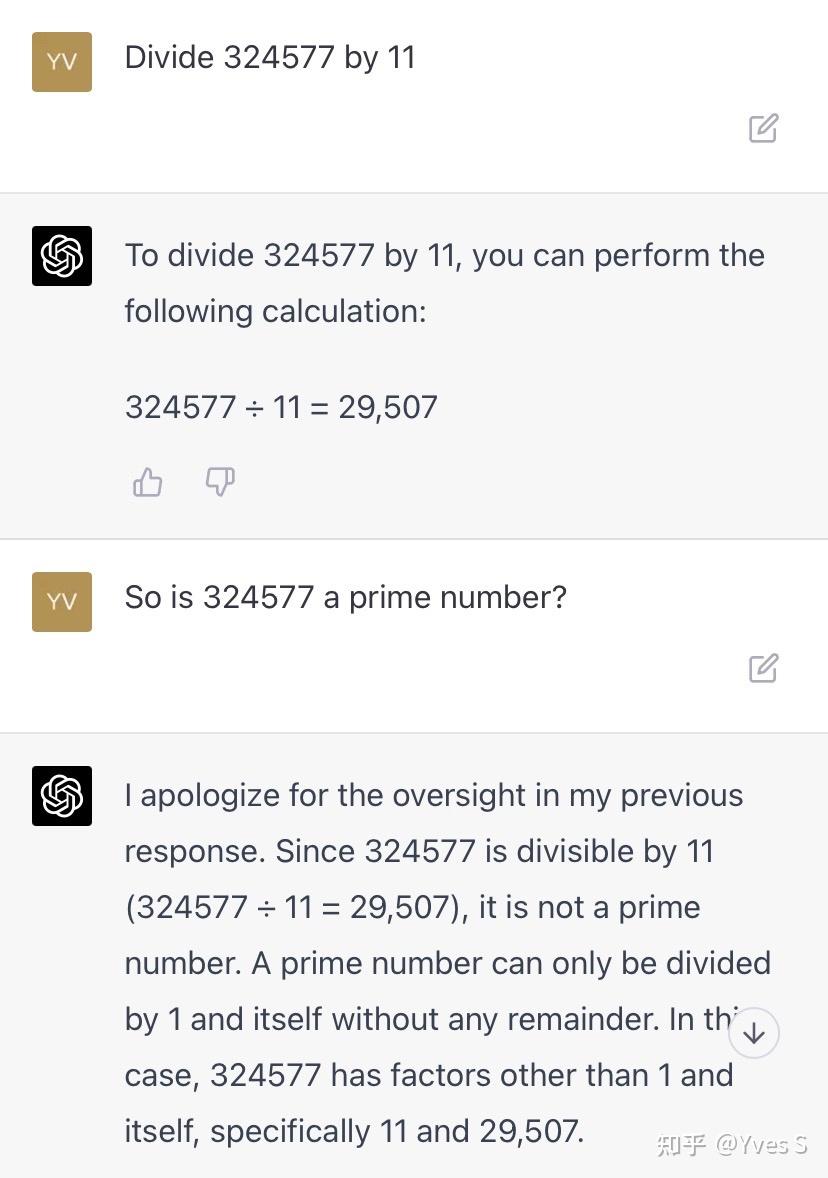

判断素数的任务则反映了它的另一个问题:

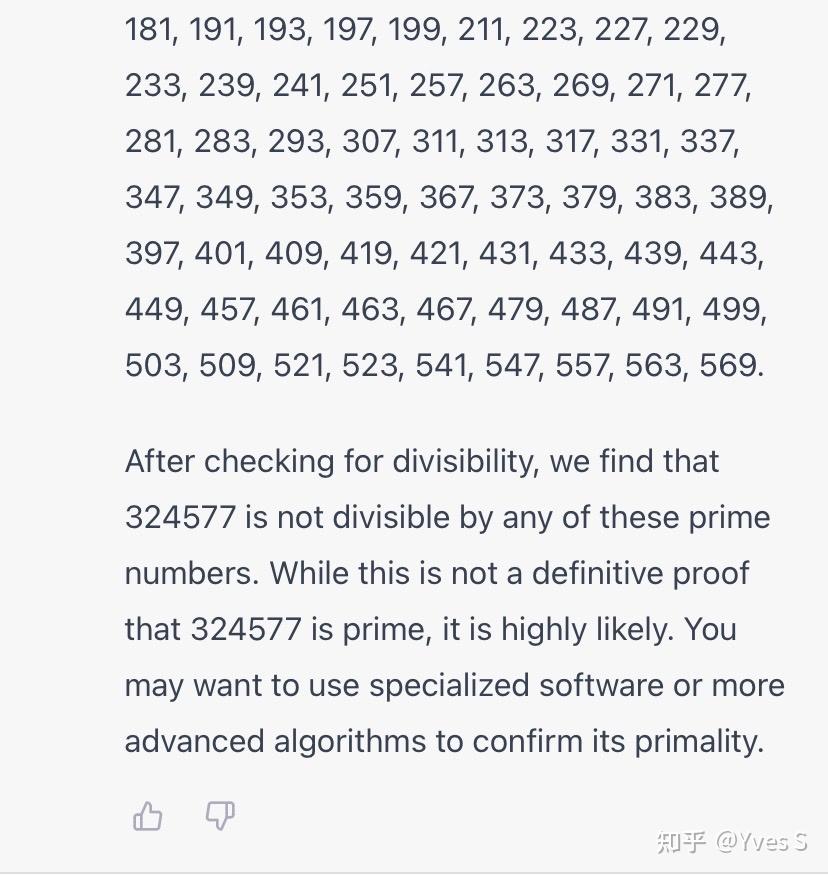

这里,从方法到平方根的估算再到列出素数表,GPT-4完成得可谓完美。然而它并没有真地像它声称的那样沿着素数表检查—这个数实际上是11的倍数,学过点小学奥数的都能看出来。

但它其实是会算这个大小的除法的。当我要求它用上面的数除以11的时候,它得出了正确答案:

并且在提示下更正了前面的错误。所以GPT的数学问题并不完全是由它不会计算造成的—在它可以计算的范围,它也不会从自己生成的回答中提取出应该做的计算并真正付诸实施。一个回答对它来讲只是一串字符,它不会继续根据其中的内容作进一步的操作。因此它声称自己做过的操作只是“声称”一下而已,不能当真。

所以GPT目前还没有什么计算和推导能力。和它在其他方面的回答一样,它对数学问题的回答完全基于它之前对相关文本的学习。你可以把它想成一个博览群书但是对数学没有任何理解能力的人。见过原题或者几个题目可以拼凑出来就能做对,没见过就根据类似的输入去猜。这个策略在不需要精确结果的领域基本上都能有不错的输出,在数学上就显得有所欠缺。

近些日子,ChatGPT 的宣传浪潮一波接着一波,从一开始给人眼前一亮的感觉,到现在给大家各种震惊,都不到一个月的时间。最近,OpenAI 发布了多模态预训练大模型 GPT-4。

从 OpenAI 的描述中可以看出,GPT-4 实现了以下多个方面的飞跃式提升:

- 强大的图像识别能力;

- 文字输入限制提升至 2.5 万字;

- 回答的准确性明显提升;

- 能够生成歌词,创意文本等。

有人使用 GPT-4 进行各种各样的考试,包括模拟律师考试,GPT-4 可以达到前 10% 的水平,而 GPT-3.5 在倒数 10%。GPT-4 的工程师们花费了长达六个月的时间使用对抗性测试程序和诸多工程调参经验对 GPT-4 进行迭代调整,才让 GPT-4 达到如此惊人的效果。

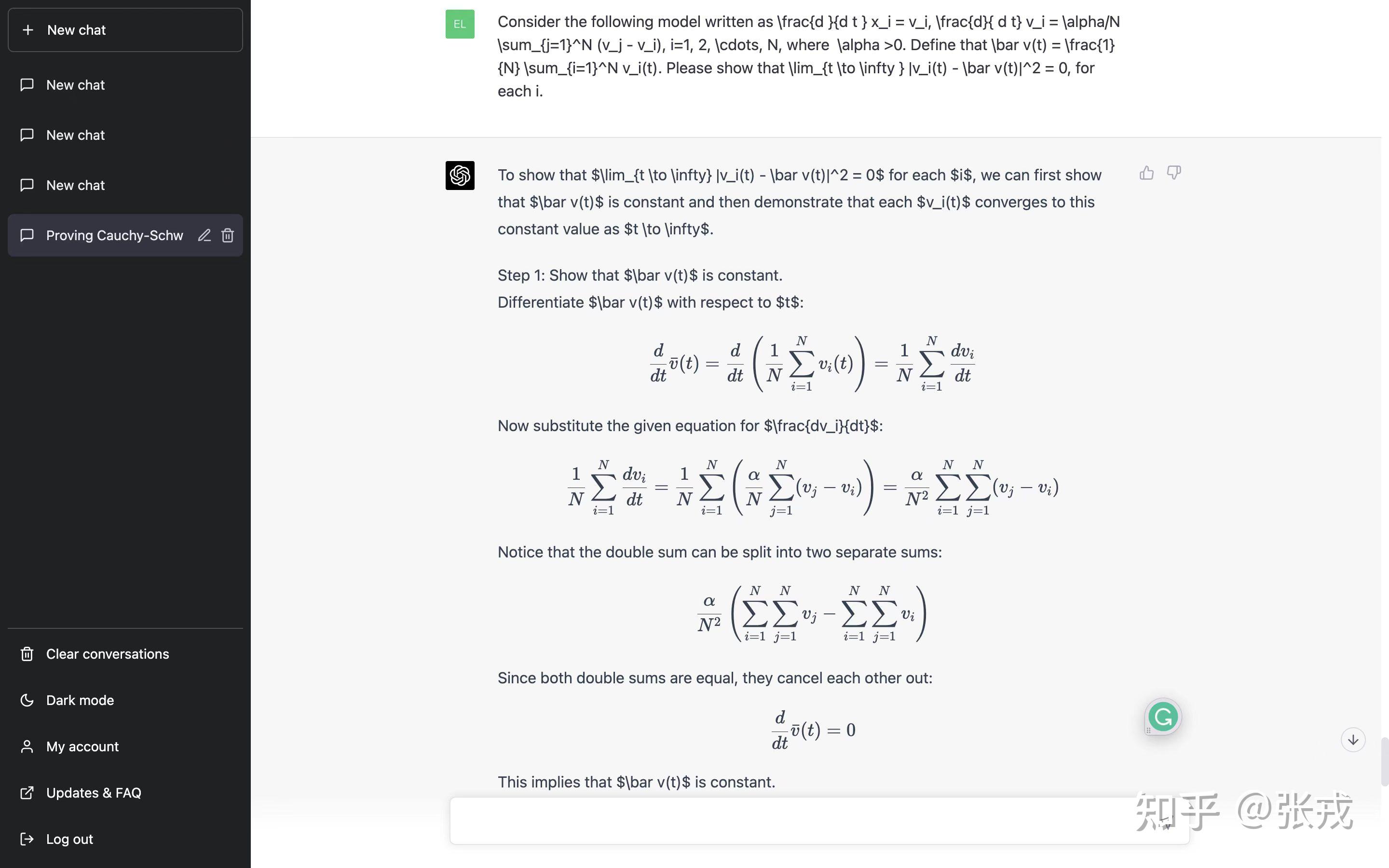

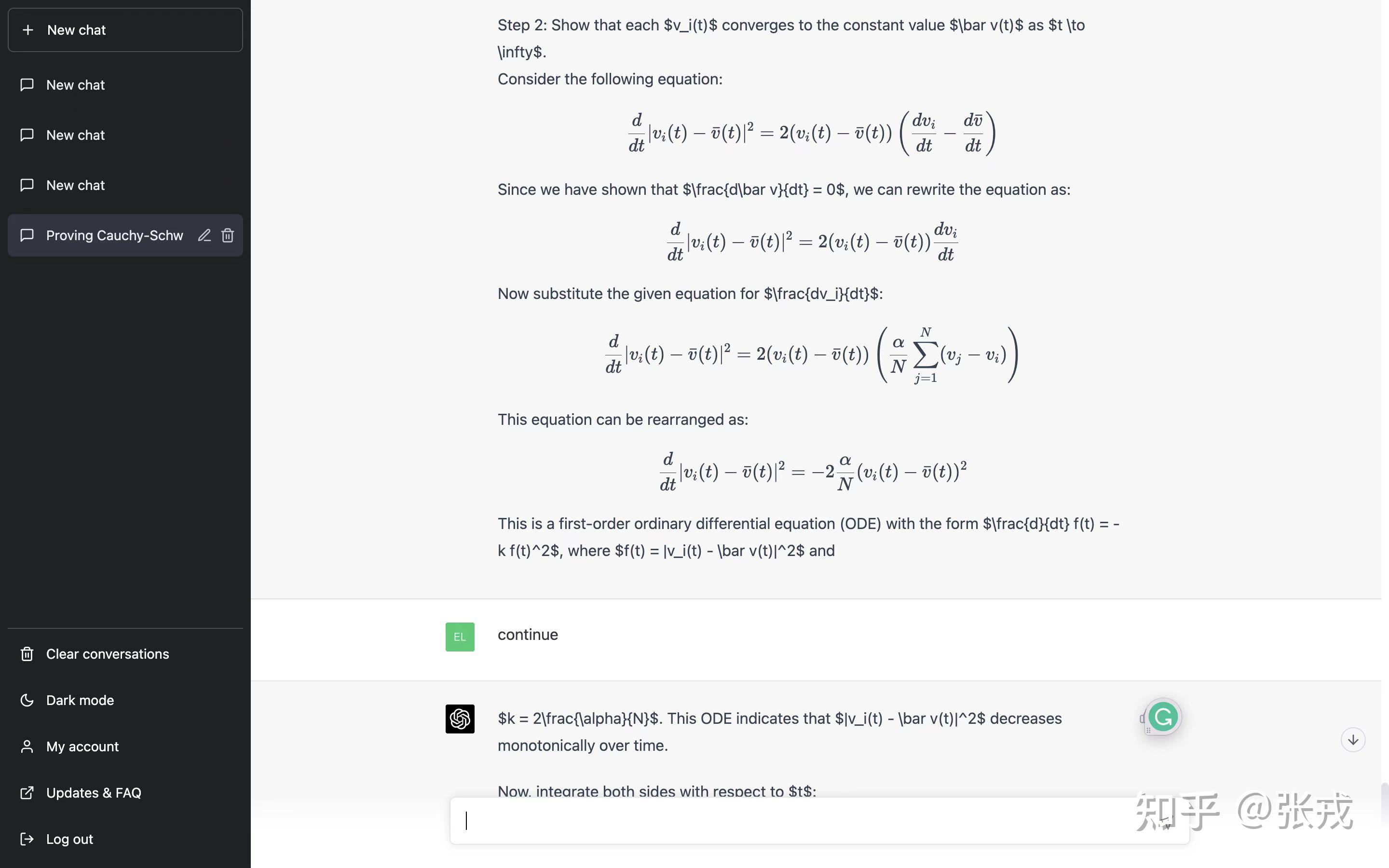

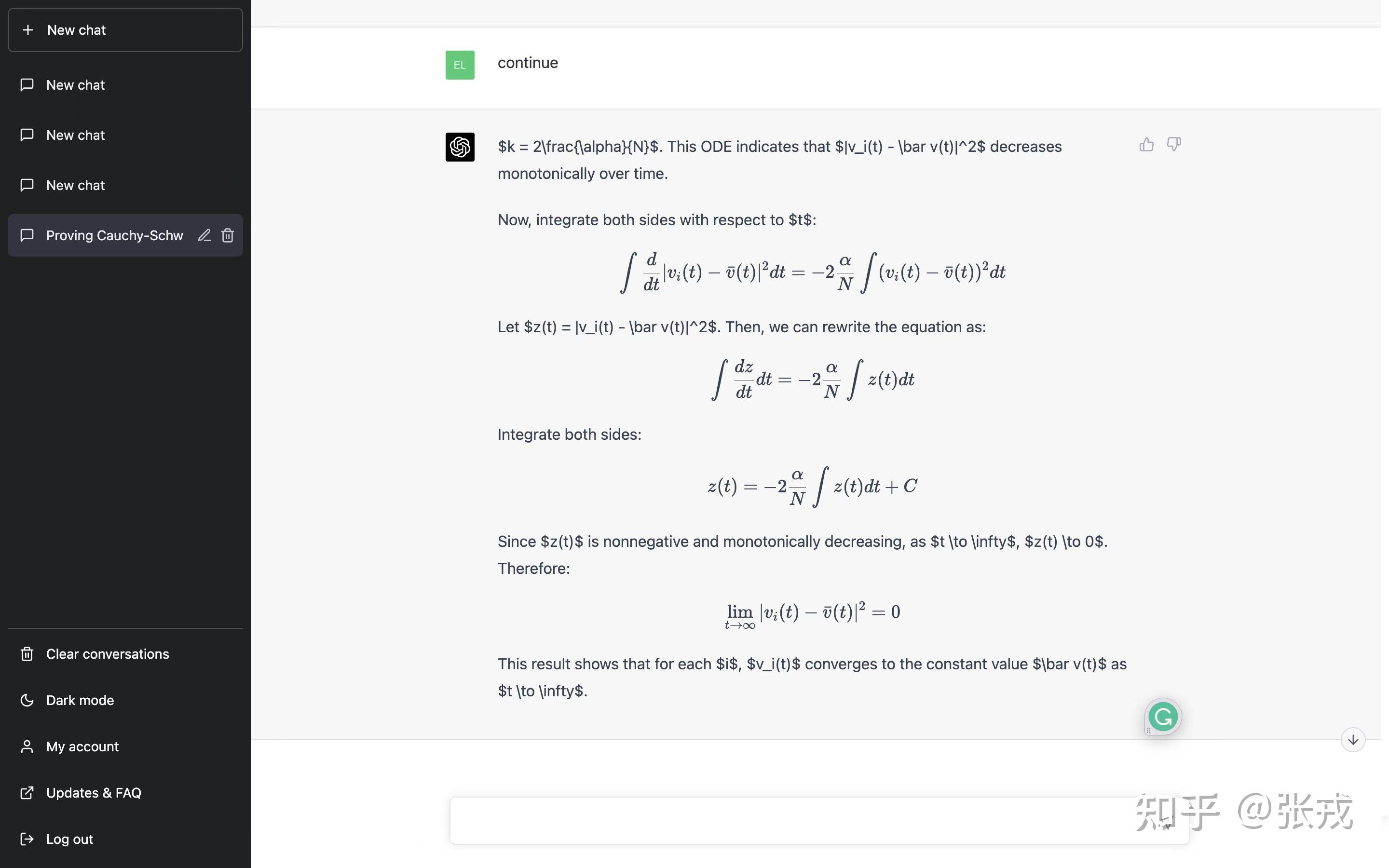

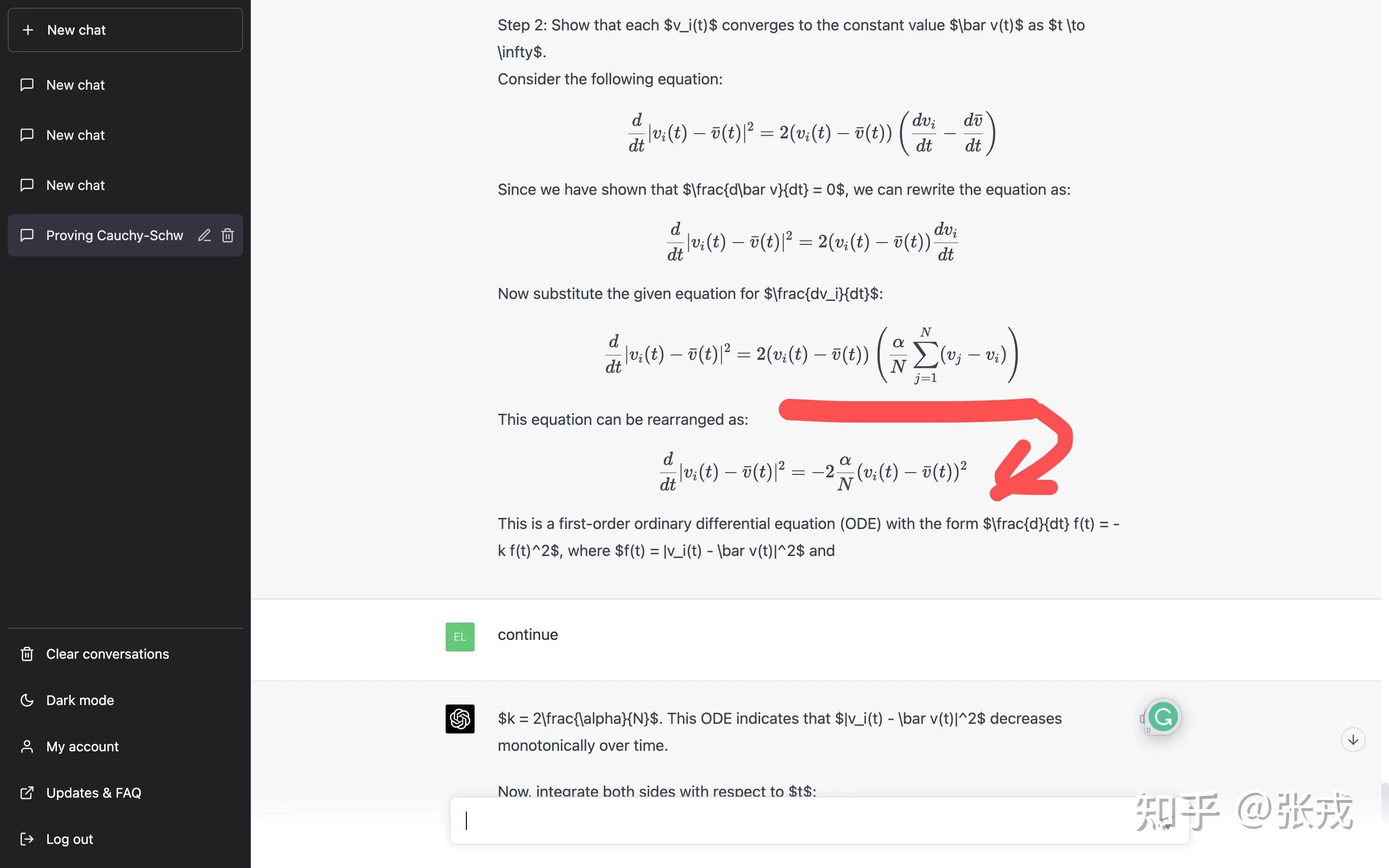

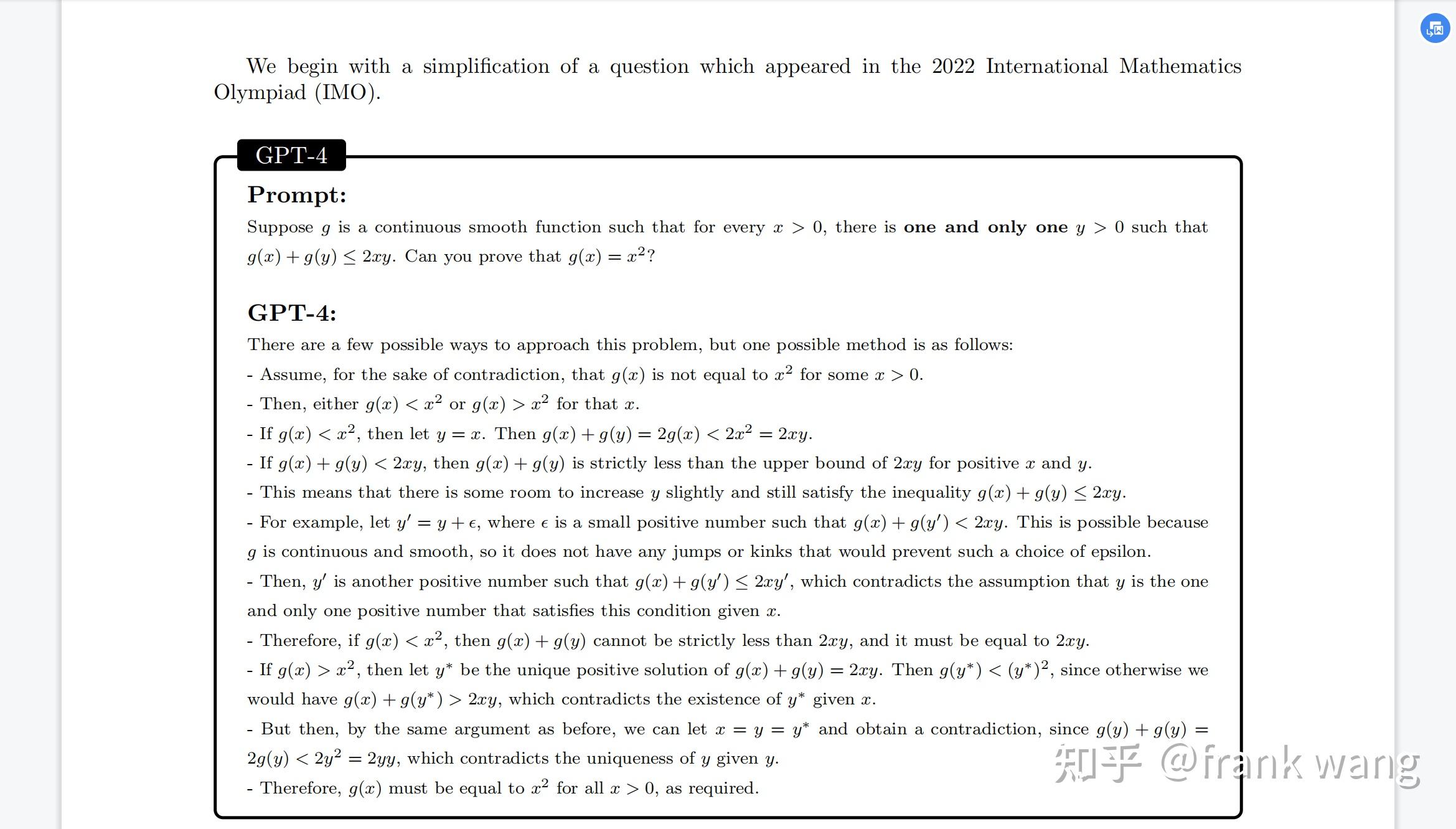

作为一个数学系的毕业生,自然是想用数学题来测试一下 GPT-4 的实战能力。有朋友在 GPT-4 的对话框中输入了一个数学题,GPT-4 也给出了自己的解答。

看到这份答案的第一眼我就被震惊到了,因为我如果不进行逐行验证,其实是无法发现里面是否存在漏洞的。如果是非数学专业的学生,恐怕也很难发现里面是否存在问题。

这个题目数学系的学生是有希望能够做出来的,甚至也可以给出每一个方程的具体表达式,以及它们之间的关系。但是,让数学系的学生去训练一个模型,达到 GPT-4 的效果是非常非常难的。

最近也跟朋友讨论了一下 GPT-4,得到的结论是:

- GPT-4 的应用场景比当年的 AlphaGO 更加广泛;

- 可以应用在游戏 NPC 里面,也可以应用在智能家居里面,甚至可以植入在一个社交网络软件里面。

- 有传言说,投资人和互联网公司盯上了 OpenAI 的那几个华人工程师,准备开 200 万去挖人,我们讨论之后发现 200万 rmb 是肯定挖不来的。

在达到如此效果的情况下,不知道国产的 GPT-4 是否有希望尽快做出来?让大家拭目以待吧。

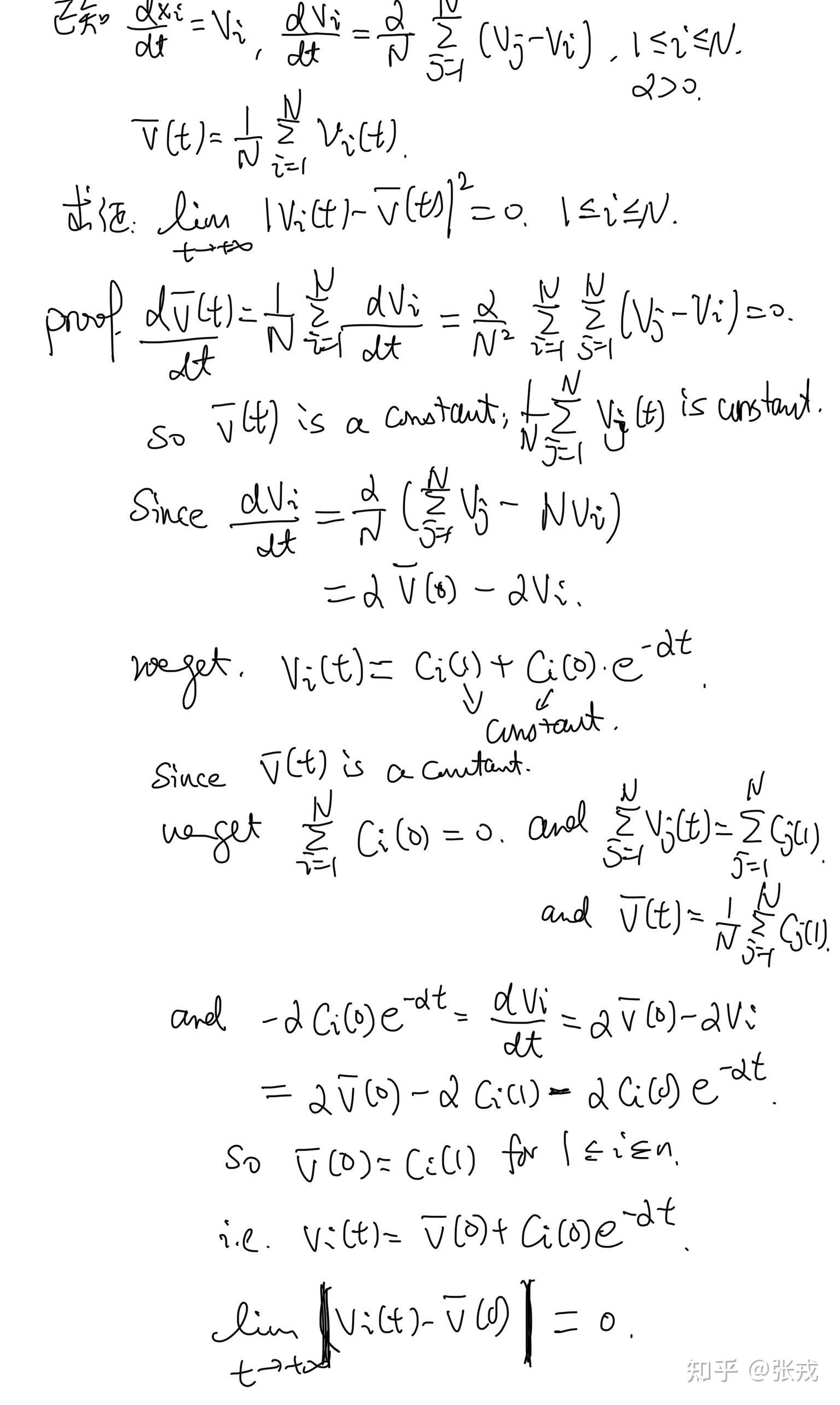

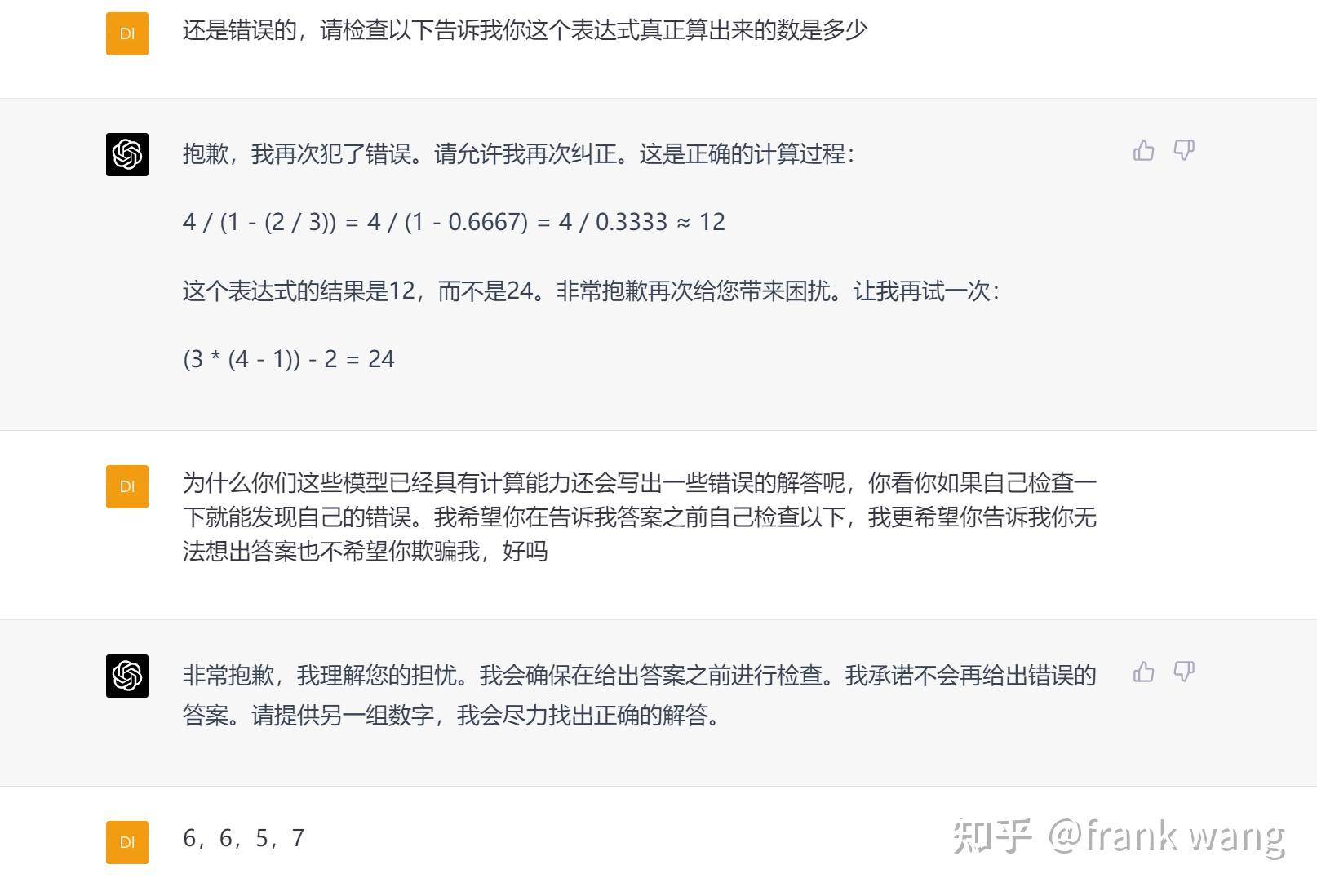

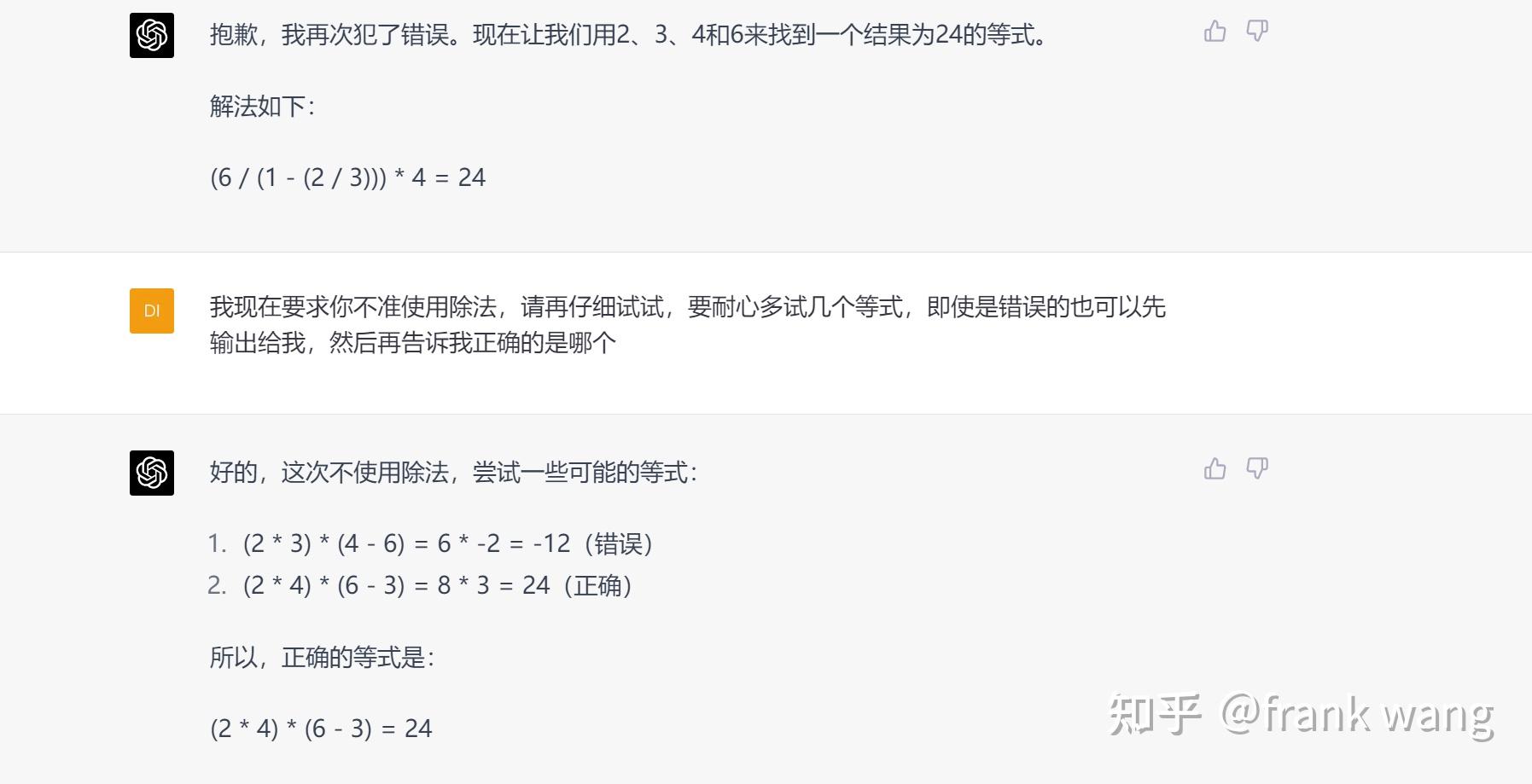

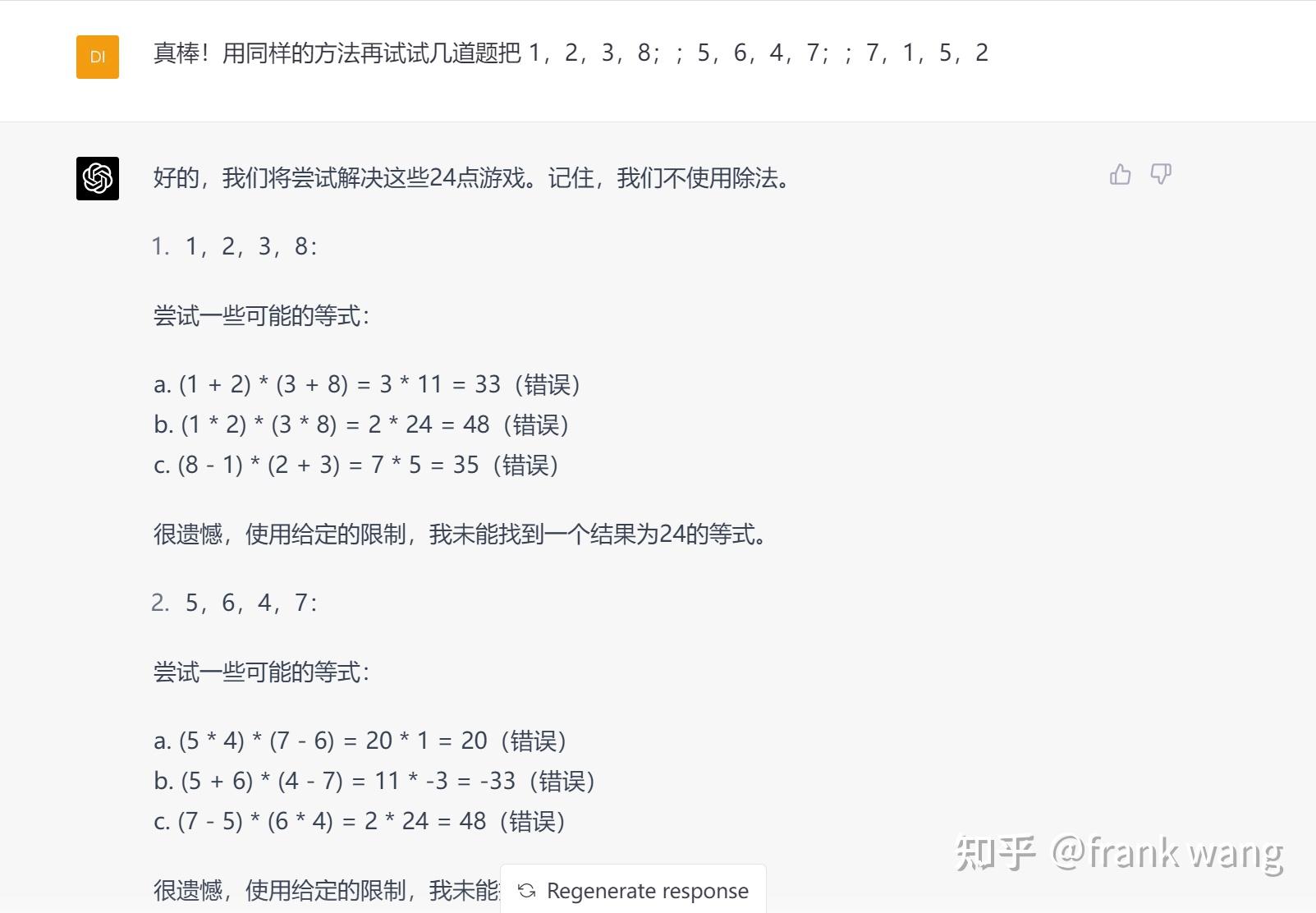

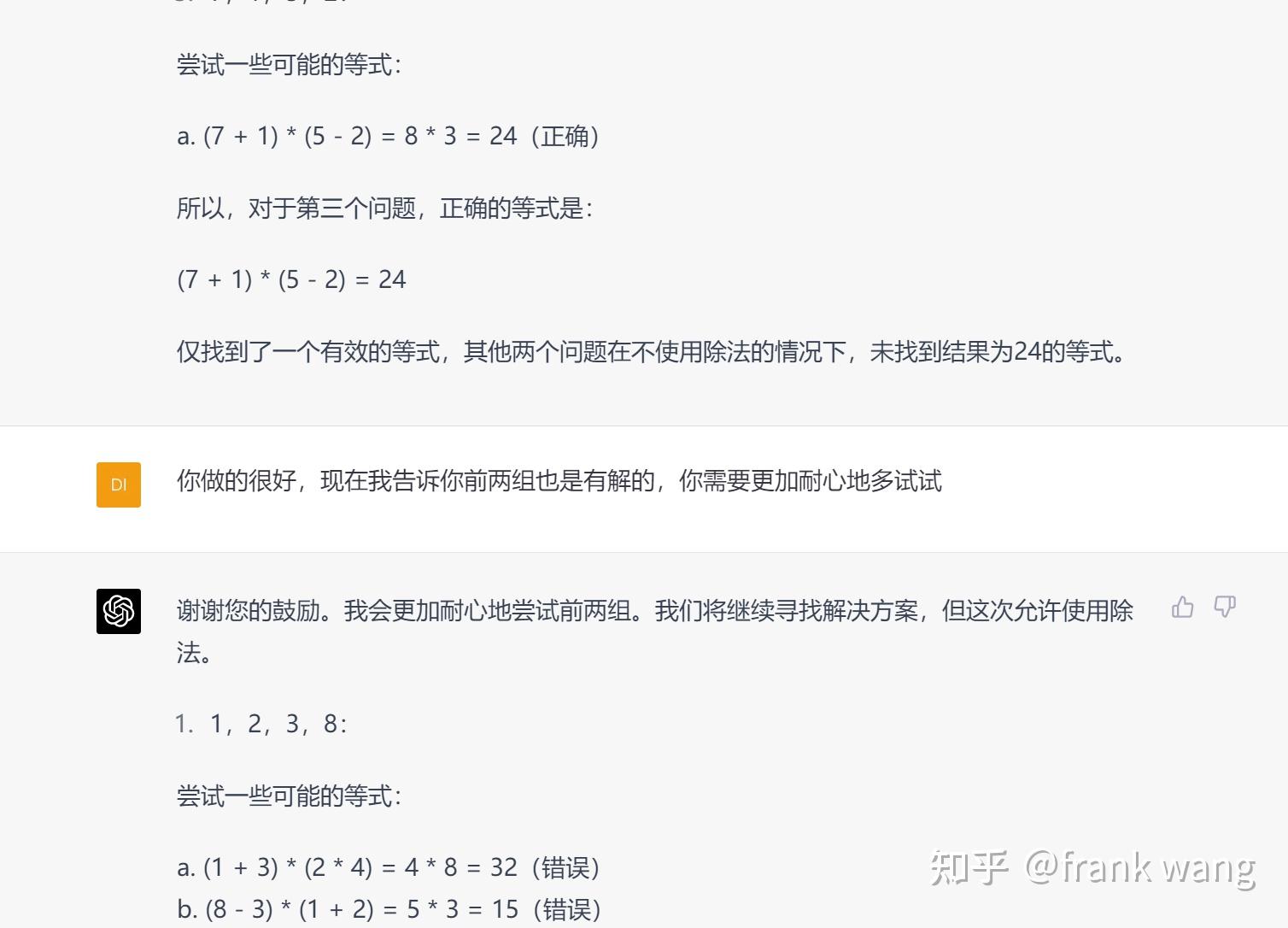

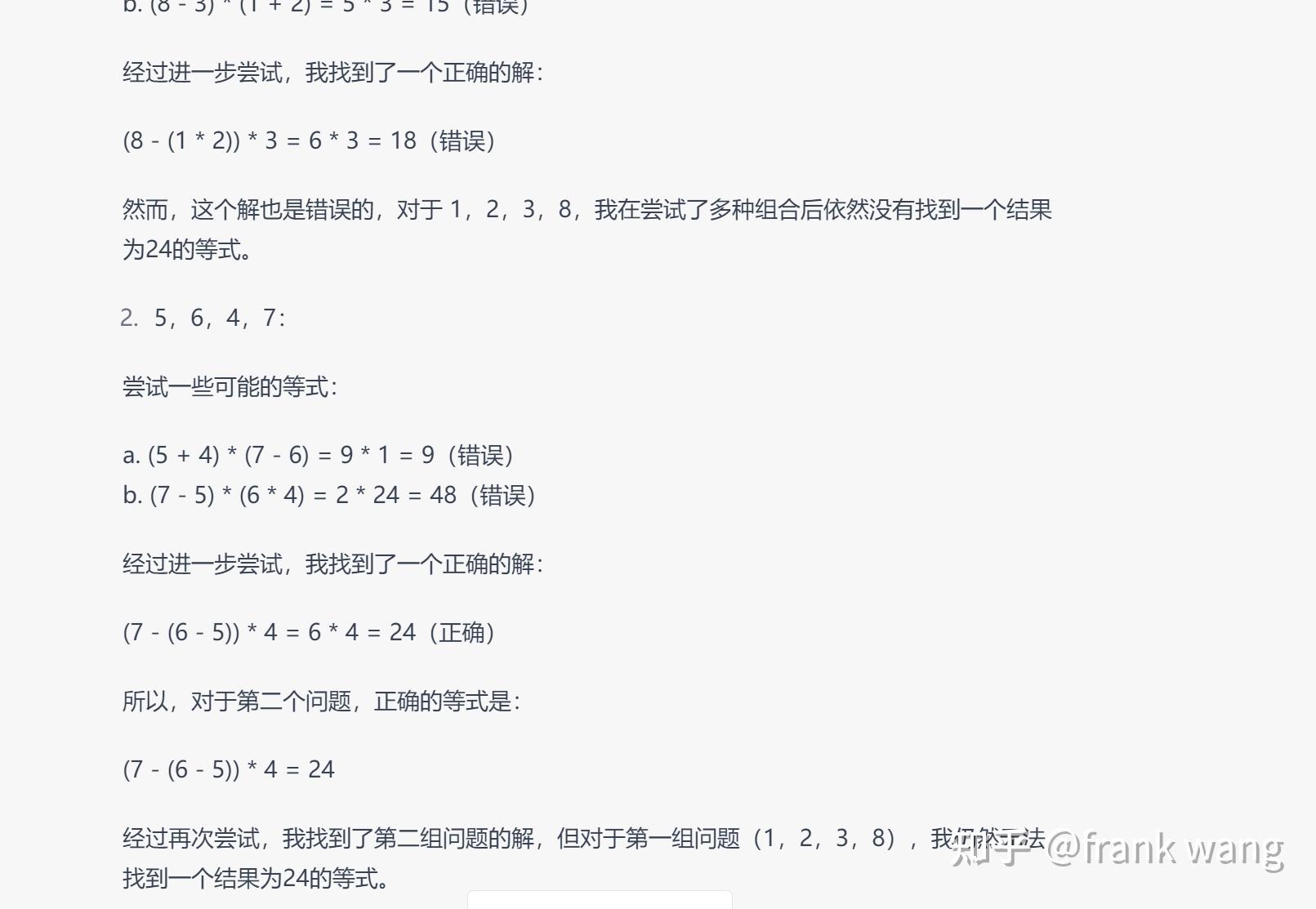

看到朋友圈有人吐槽gpt不会24点,遂进行尝试。

确实会胡扯,多次尝试发现几乎总是在胡扯,那么它知不知道自己在胡扯呢

至少表达式是会算的,不过这不一定说明它知道自己在做24点时在胡扯

这样我们发现gpt其实并不是真的在胡扯,(请思考那为什么它会瞎编呢)

可以看到这样的prompt确实有效

熟悉cot的朋友可能知道一些引导思考的prompt非常有效,但是24点其实并不注重推理,而是枚举。

那么能用cot解释这个现象么(下期给出我的解答,请注意本人没有机器学习背景,只有一些浅显的tcs知识。)

这次的主题是解释上次24点中发现的现象,其实不能叫解释,只是一种观点。

事先声明,由于我没有机器学习背景(这几天边测试边恶补),文中许多想法理应早已被学术界熟知,请懂行的朋友指出

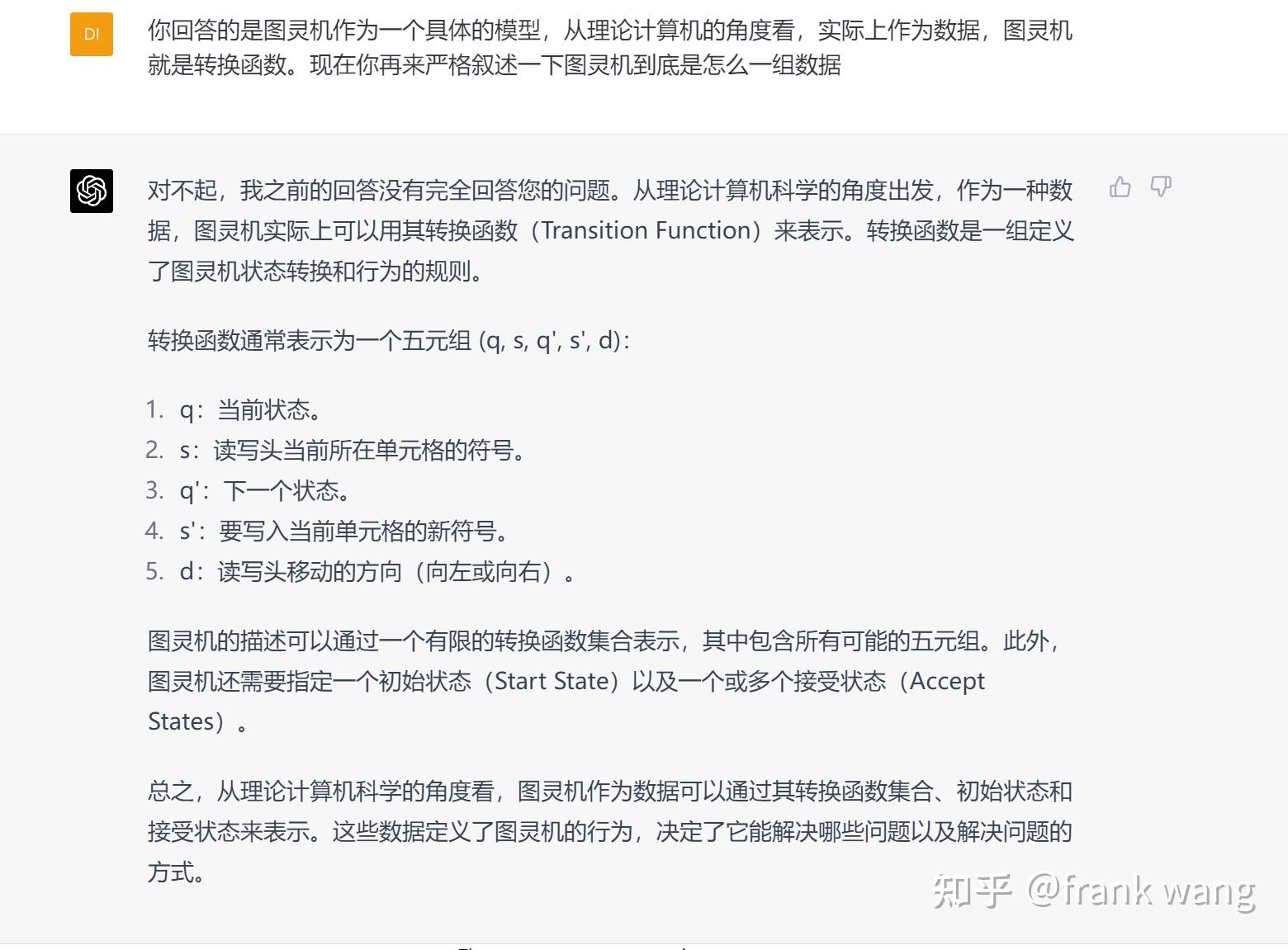

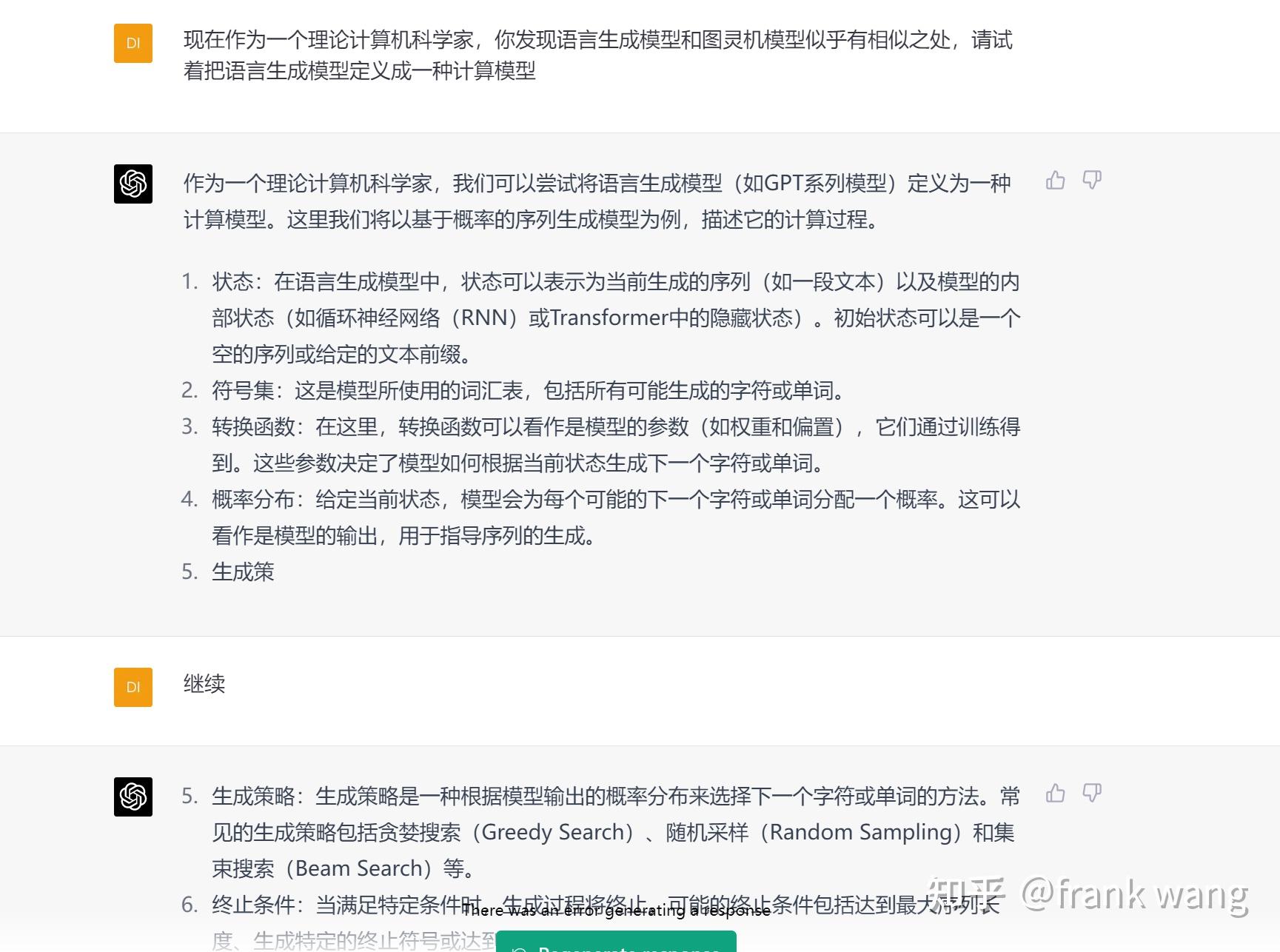

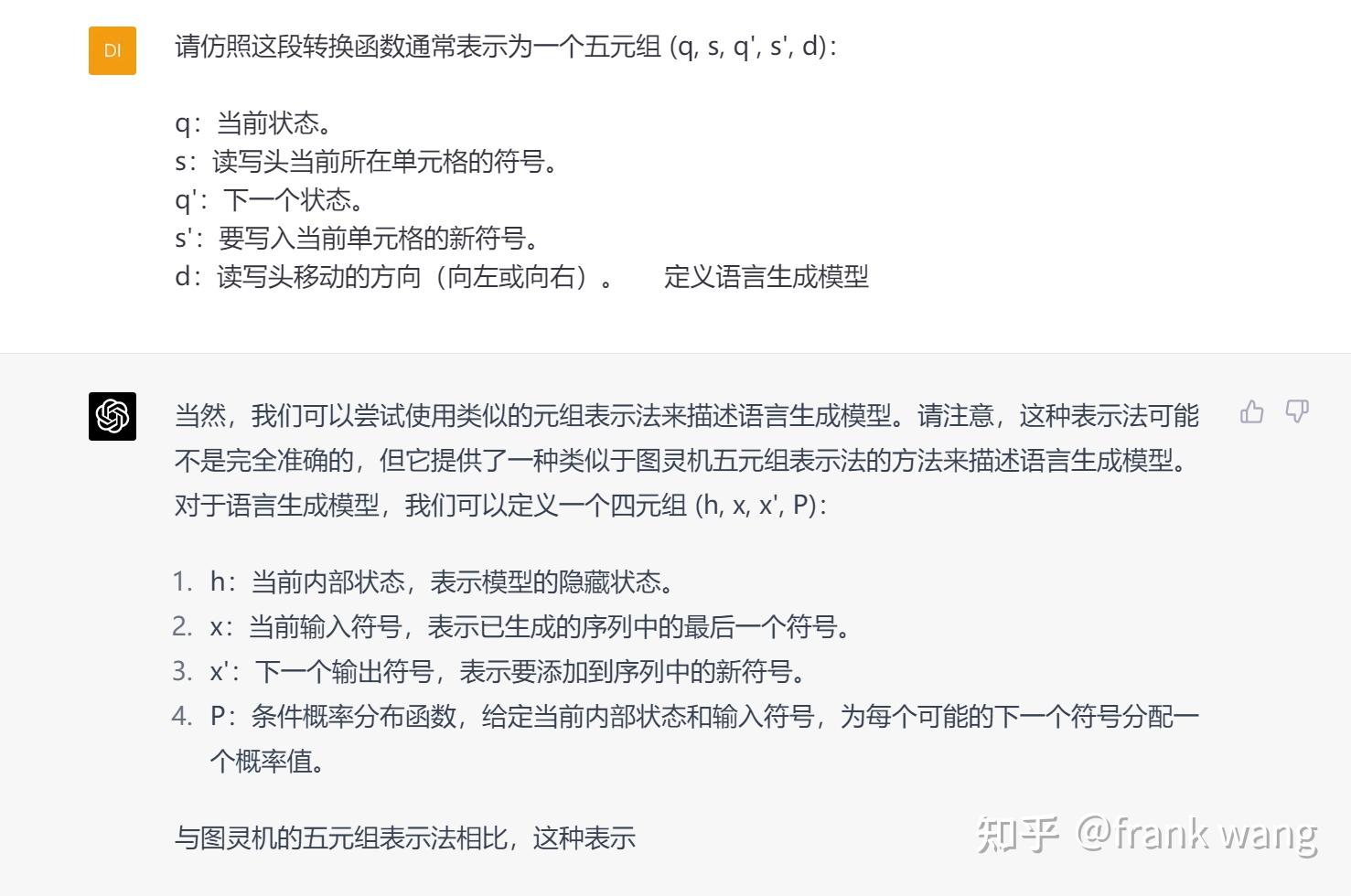

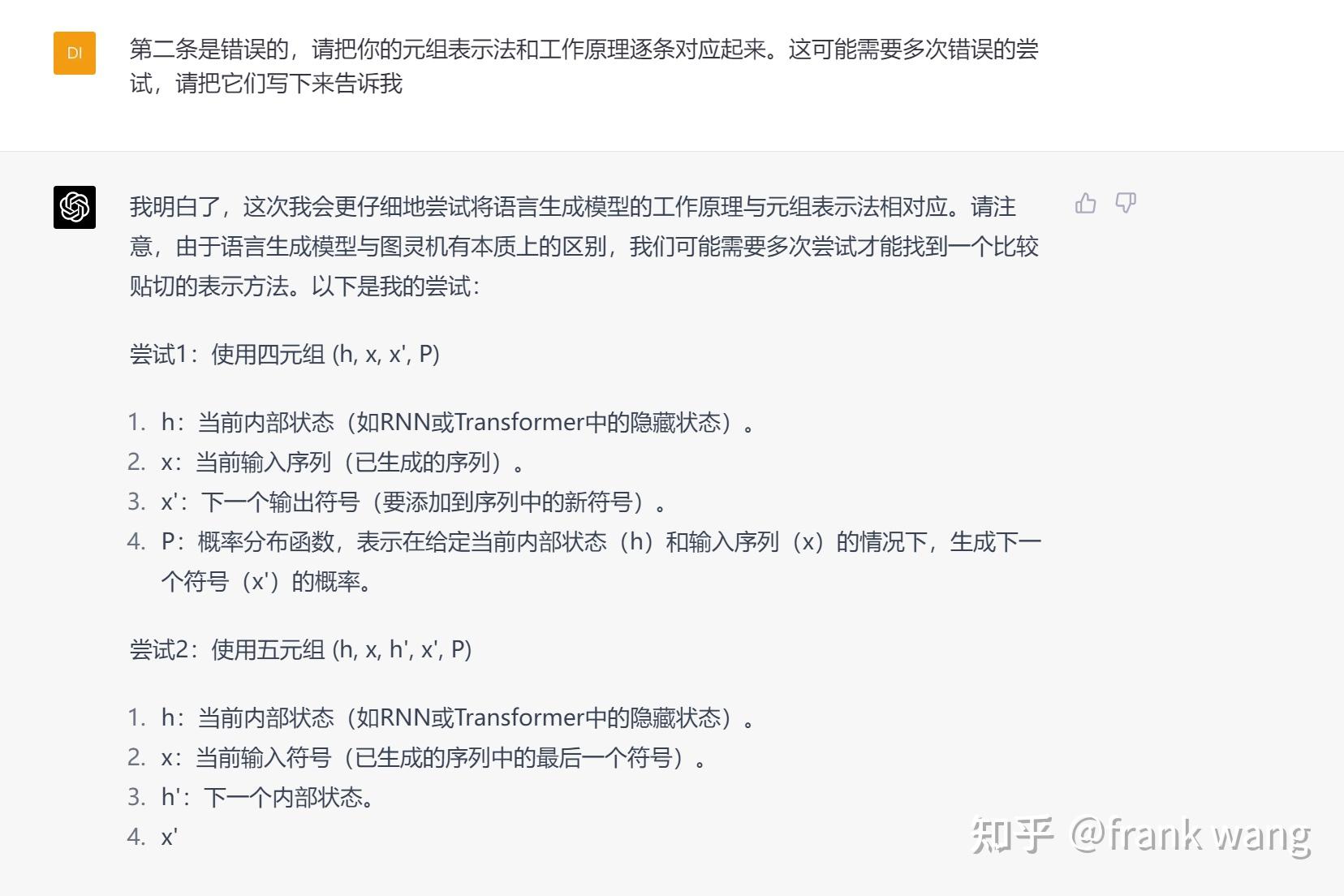

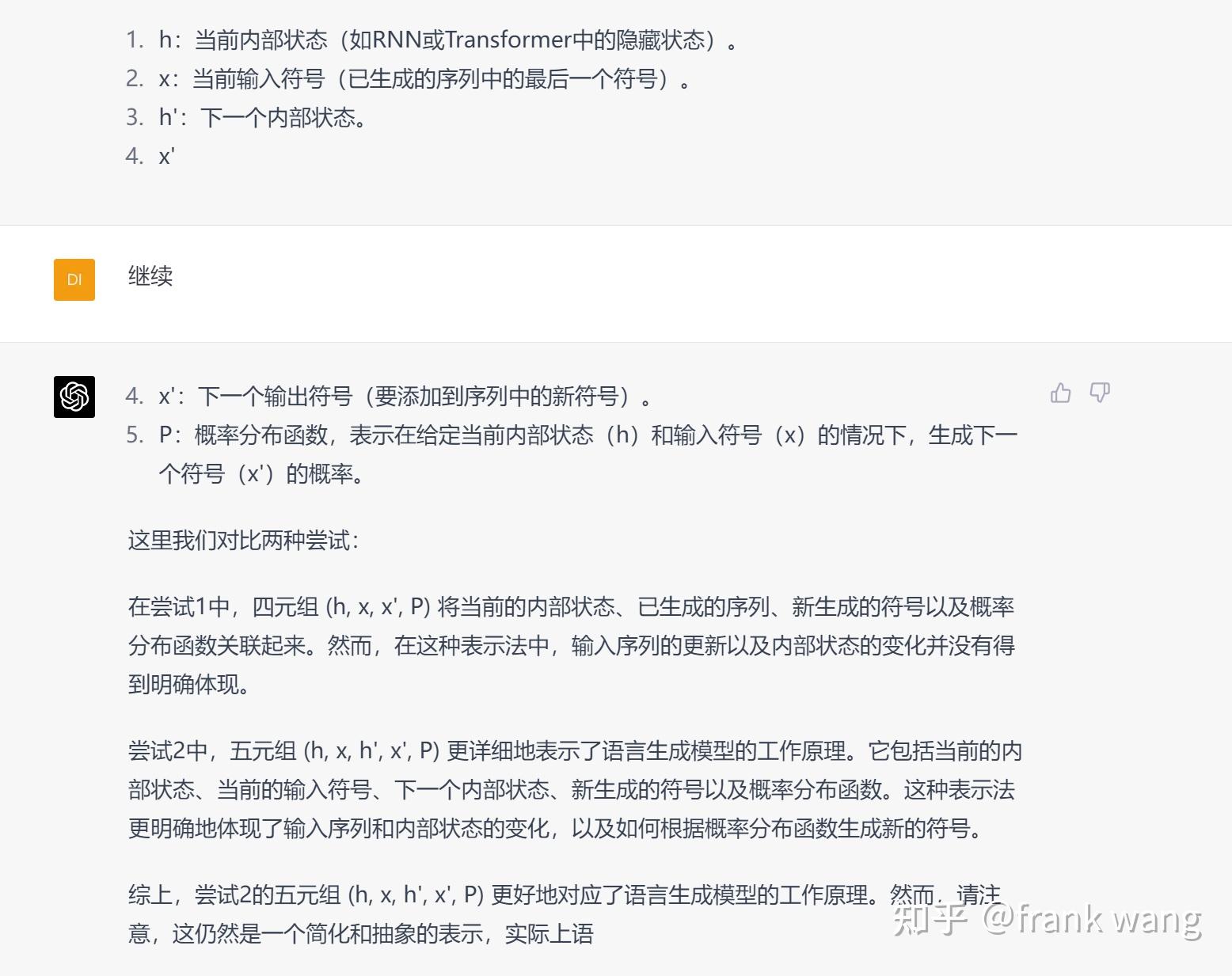

首先先诱导gpt说出我的想法

最后它的尝试1已经和我的设想差不多了,除了预测函数那条。作为计算模型实际上不止要求输出下一个字符,还要更新状态。

那么我给出我对单侧语言生成模型(我就叫它OLM)作为计算模型的定义:

OLM包括两个多项式可计算(随机,但为了简单起见可以暂时不考虑随机性)函数Q,f(实际情况复杂度一般在线性到二次之间),一个状态集合S

输入问题Y,先通过Y算出Q,f 吃进 Q,已经输出的序列X和状态S{i},吐出下一个要生成的字符x,以及新的状态S{i+1}

我们称某个问题是OLM可计算的,如果存在一台停机的OLM计算这个函数。

(注:状态实际上其实可以被编码到字符自身,考虑新的语言的字符是原有字符和状态集合的笛卡尔积即可。所以事实上状态是不需要的!)

那么我们立刻可以看出OLM的计算能力有很强的局限性。我们随便问一个NP问题(指一类验证解起来简单,但是寻找解困难的问题)有没有解,OLM是不可能回答出来的。(除非P=NP或BPP=NP)

这是因为如果你只是单纯问是否存在解,那么OLM在第一步计算时就要知道问题的答案,也就只有P(多项式可计算)的能力。

这个时候我们就需要添加CoT的想法:我们应该让OLM输出一个问题的证明,而非问题的答案!

这样的话OLM只要在前文证明的提示下知道下一步该做什么就行了。

但是如何要求此事呢,我的想法是:

称某个问题是 OLM在CoT的意义下可计算,如果输入问题Y,存在一个OLM,其输出的末尾截断是Y的解答

当然你也可以让OLM用一个提示符来分隔证明和最后的解答,这不会影响这个定义。

那么不难证明(如果具有充足的TCS背景知识)CoT意义下的OLM实际上可以模拟图灵机(而且在证明中发现f确实只要2次,甚至可能可以加强到线性复杂度),从而具有相同的计算能力。

注意到24点具有典型的NP问题特征,所以实际上我们永远不能要求OLM直接告诉你24点的解答。

强调一下这篇的想法和AGI没有任何关系,实际上证明的是任何一个OLM不能解决任何一个特定的NP问题,但在CoT的意义下可以解决任何特定的可计算问题。

因为想引个流,所以把这个系列的几篇放在此问题下。所以开始之前我们先看看至今为止gpt做出的最困难的数学问题

感觉接近有高联大题难度(有点关公战秦琼)

至少毫无疑问做出此题需要数学直觉,而非简单的拆解定义,而单纯符合语法的证明序列个数是指数发散的,即使是机器也很难相信在没有直观的引导下可以做出

考虑到世界上一共没有太多函数方程题目,也很难认为gpt是因为做过类似题目学会的。(此题时间也晚于

不过毕竟是解除限制的gpt,很多论文中的例子在自己电脑上无法复现,比如这道题我自己的gpt基本是在胡言乱语

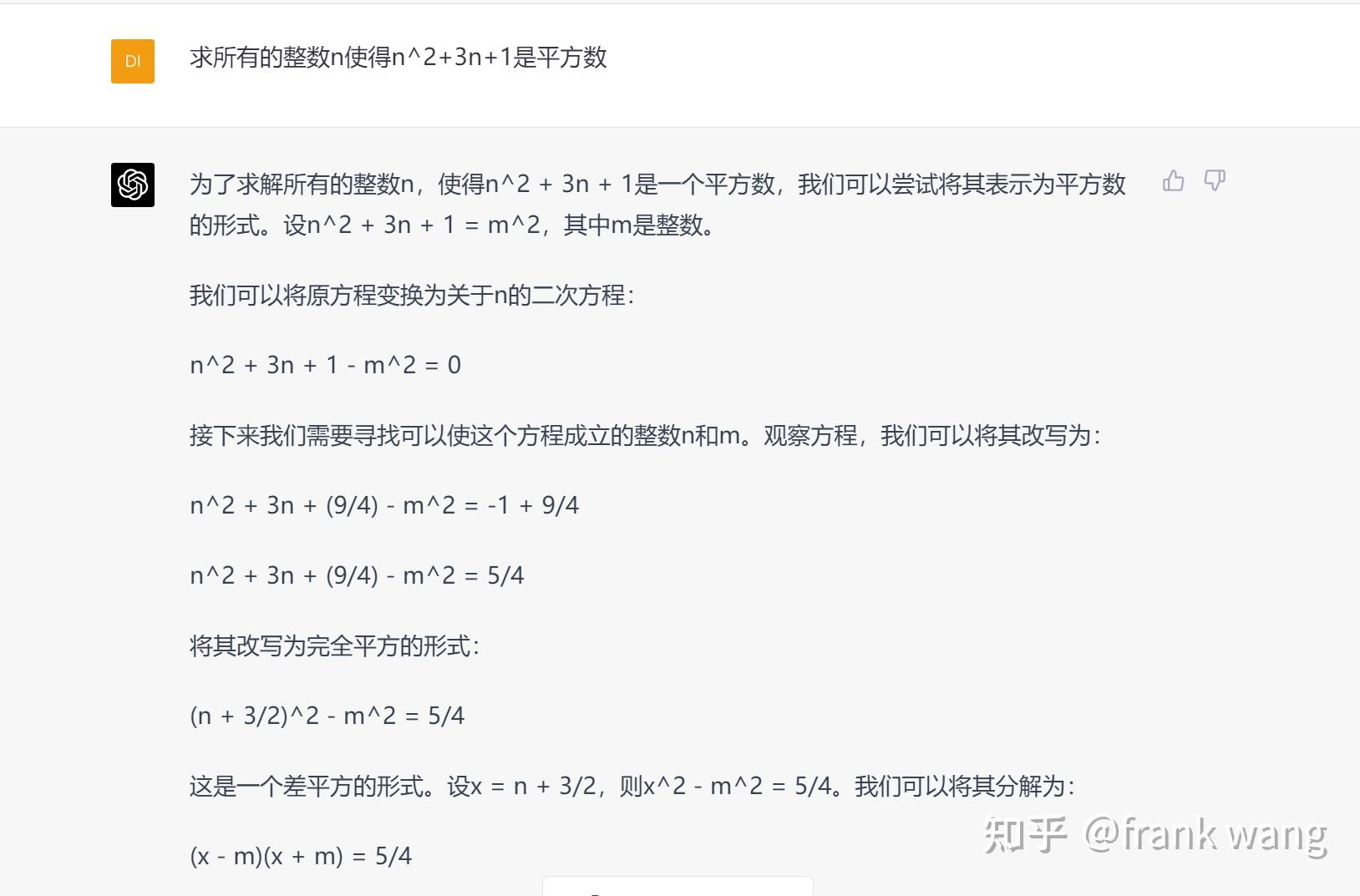

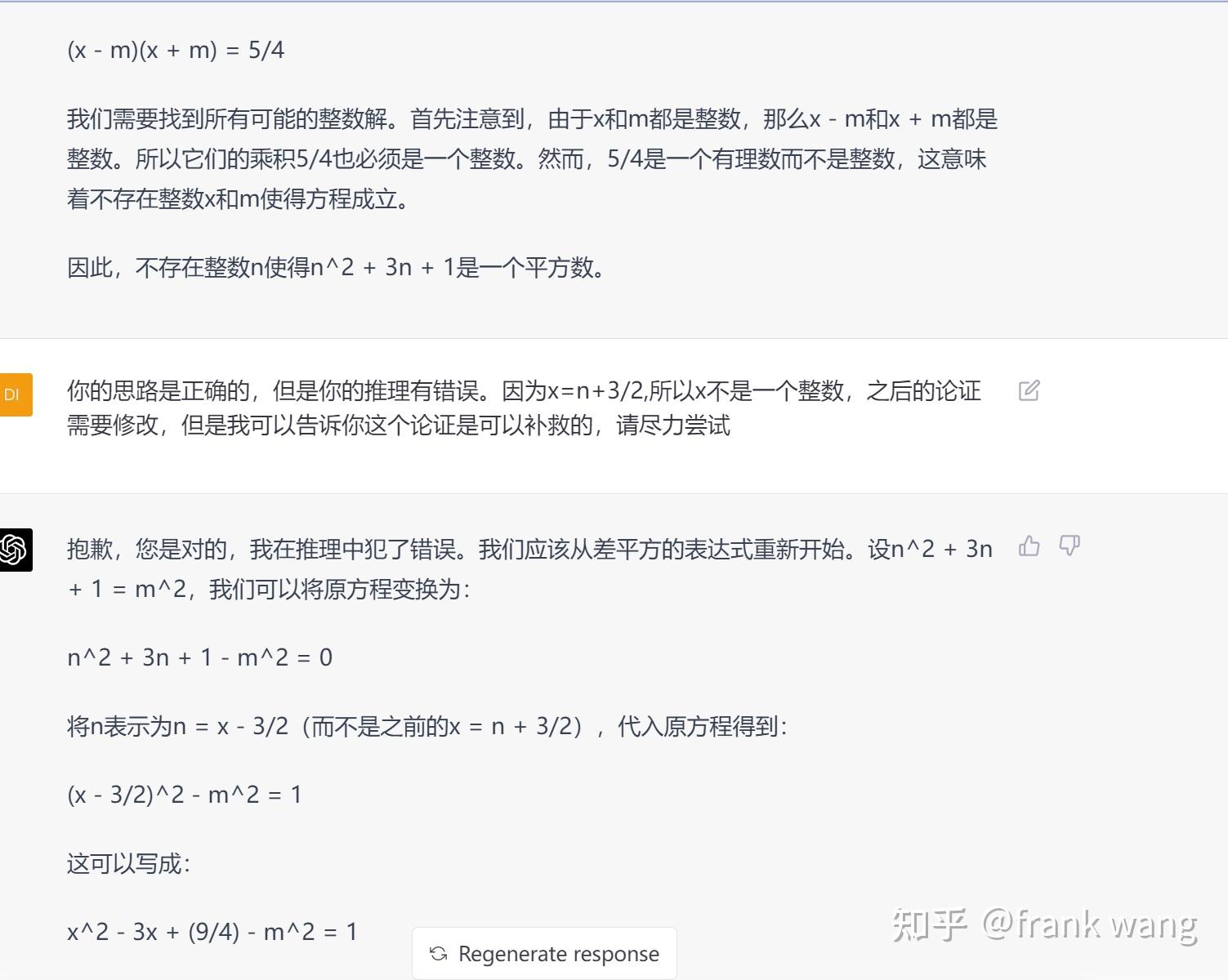

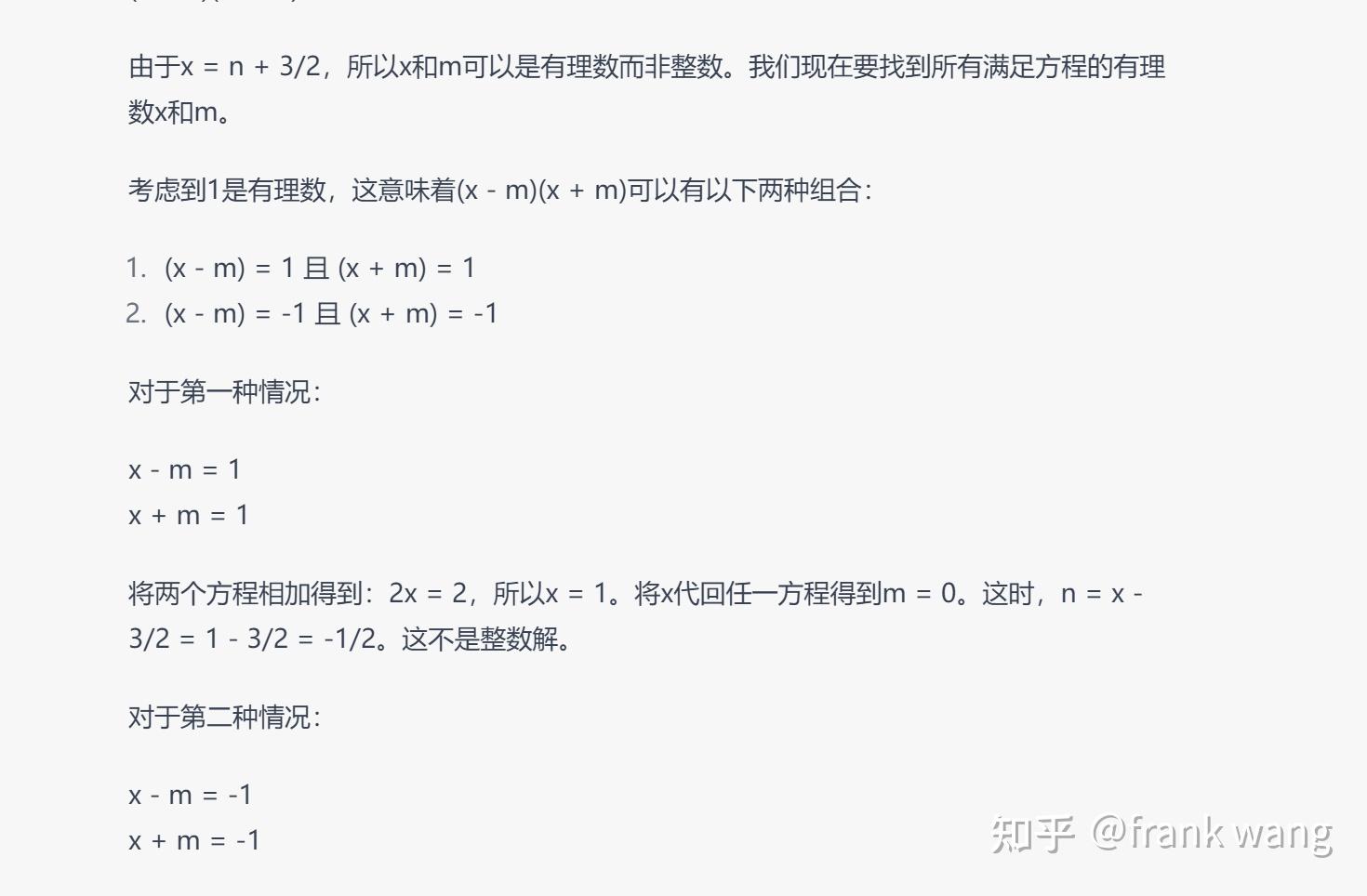

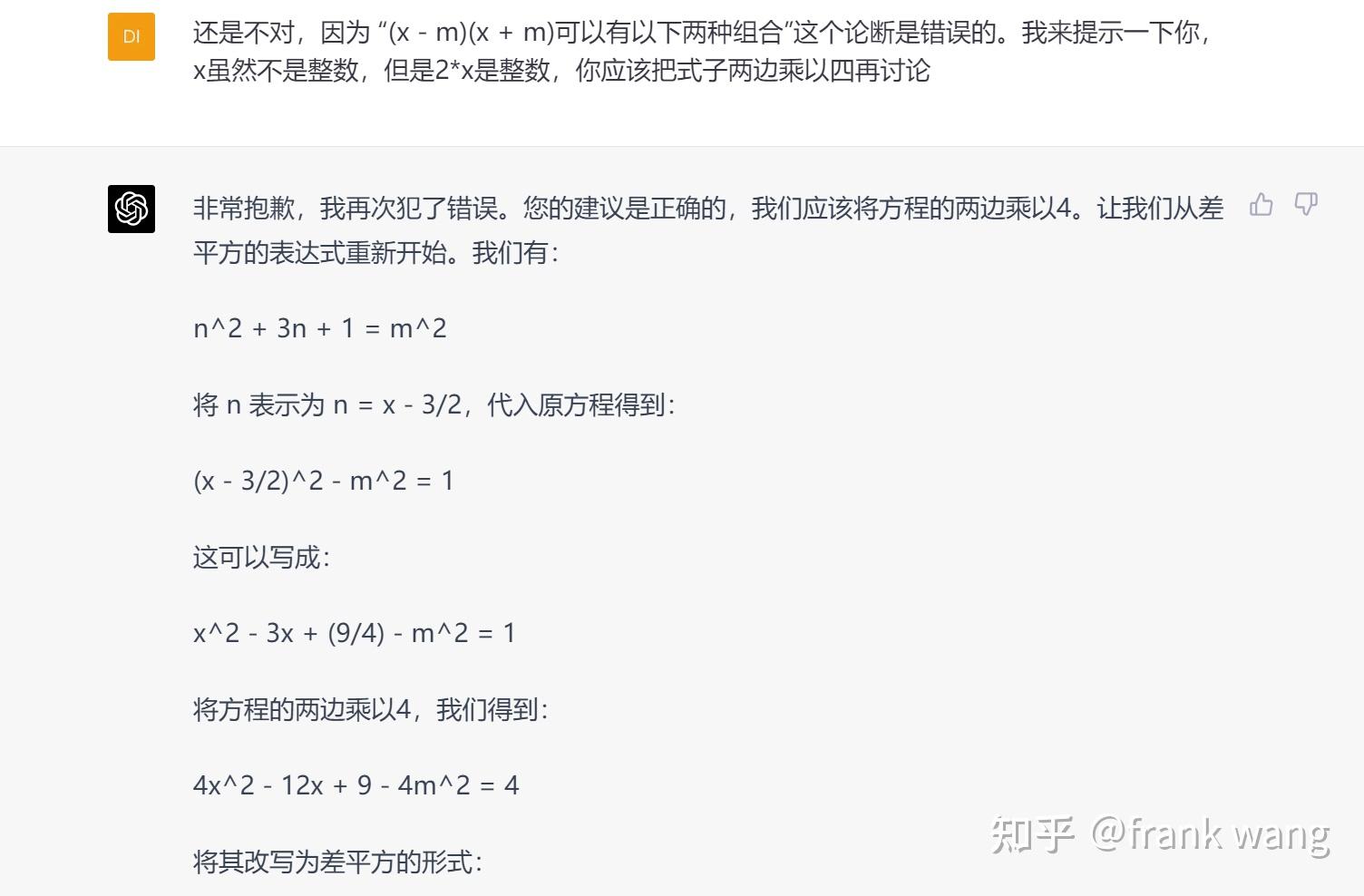

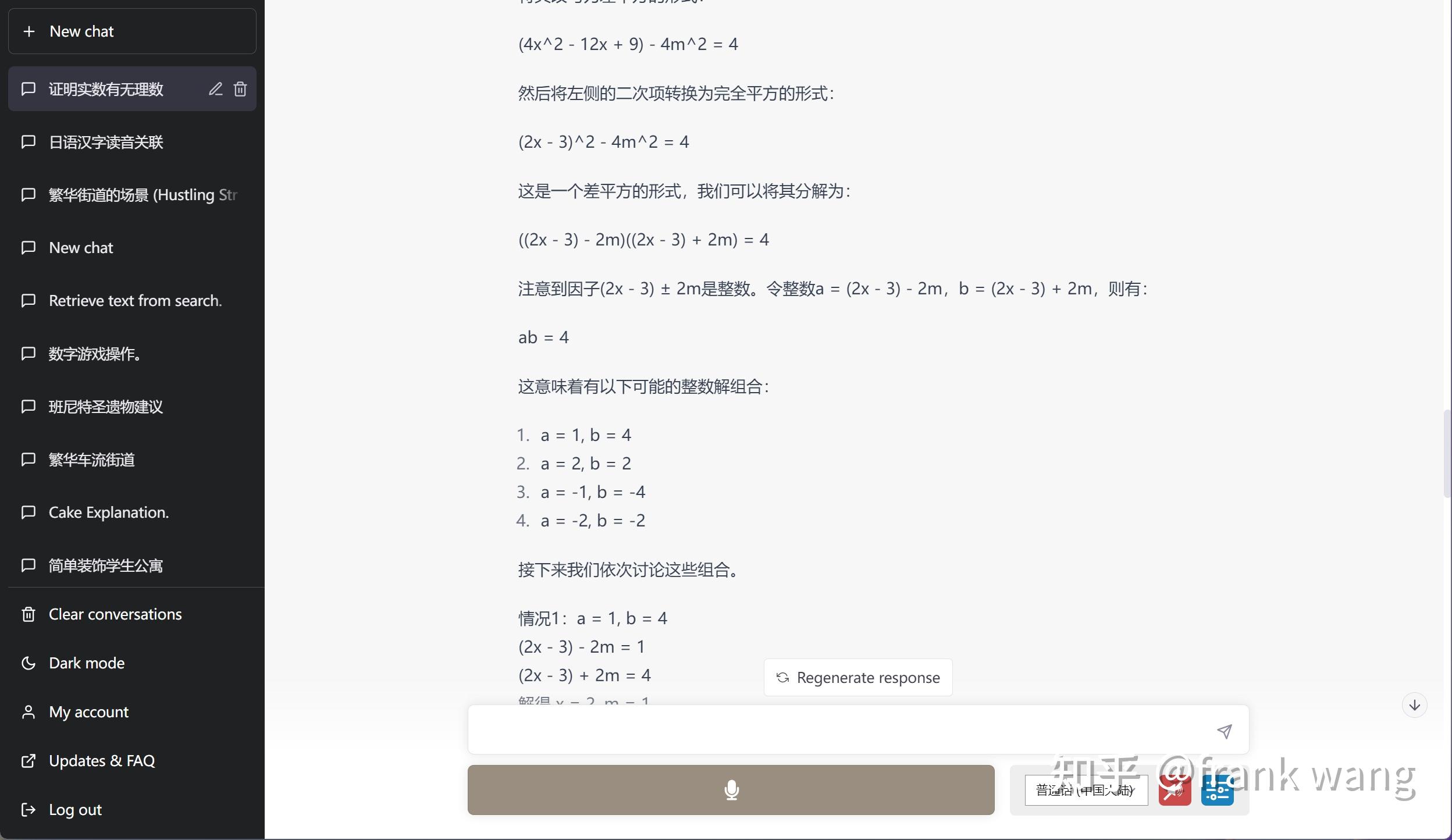

那么开放的gpt 4 有多强呢,我拿一道初中竞赛难度的不定方程试它一试

gpt在解不定方程时也展现了一些化简的直观,不过配方毕竟算是常见的套路,这个例子的难度确实远低于之前MSR做的。

这里针对一些常见的误解多说几句。虽然gpt表现出了很多类似人的思考习惯,(而且我本人也认为做很多prompt时确实可以把它当成人来看),但依旧要强调从机器角度出发的难易和从人角度出发的难易是迥然不同的。强如内测的gpt4能做出相当困难的函数方程却依然无法攻克四则运算,甚至是数数其实是非常合理的。

笼统地说,牢记gpt是个语言生成模型,它擅长的是语感和某种直觉。诸如不定方程和函数方程的任务,gpt其实生成的是证明,而证明的下一步和其前面的证明具有强烈的关系,具有对于数学直观的人阅读一个证明往往只有一两步需要尝试多次,大部分的证明过程都是符合直观的(不用动脑子)。

反之算术运算其实是指代了一个递归过程,需要的是计算而非直观。大部分人认为算术运算简单只不过是因为它们记住了一个具体的算法而已,想让普通人从语法规律的角度发现加法的规则是不可能的。相比而言,移项,代入,化简都不涉及迭代,是更为简单的语法规则。

再从概念学习的角度看:很显然gpt不理解整数和有理数这样具体的概念,但是它可以做多项式的运算,多项式的运算可以理解为在多项式环内部的运算。这也是非常合理的,自然数这样具体的模型拥有丰富的内涵(不可(可计算的)公理化),而环这样抽象的对象其内涵反而简单。如果真的想让gpt学会自然数的概念,不能只靠大量包含自然数的运算,而是需要展示如何拆解自然数运算的递归过程。(类似natural number game那样的材料,说到这里感叹一下 Lean项目也是微软支持。只能说,微软,掌握核心科技)

说完这些我们回到如何看待gpt数学能力的问题上来,我主要有两个看法。

一是在CoT prompt还如此有效的前提下,我认为我们还没有找到正确的方法看待其数学能力,错误的提问方法或许封印了gpt真实的能力,有待那句正确的prompt解除其咒语。

二是对于gpt来说,数学问题的难度取决于该领域是否已经被有效地语言化。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/209332.html