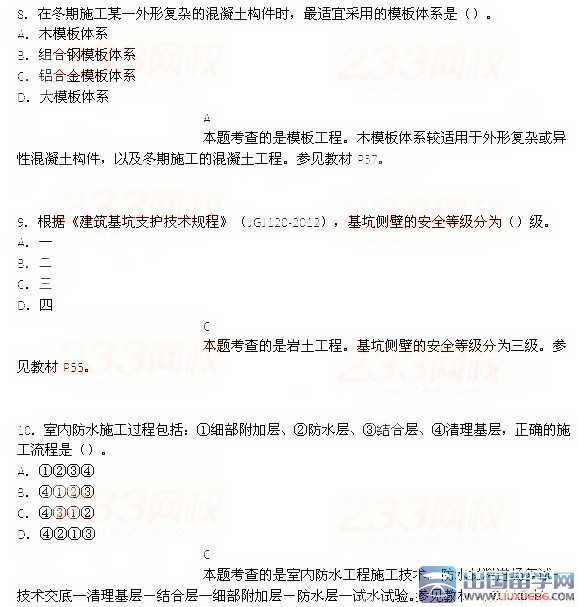

此外,我们提出了一个自训练的知识蒸馏框架,GLIP作为教师模型,利用其初始预测作为伪标签,以应对高密度细胞核检测带来的挑战,包括漏检、误检和实例重叠问题。我们的方法在无标注的细胞核检测中表现出色,优于所有现有的无监督方法,并展现出良好的通用性。目前,大规模视觉-语言预训练模型(VLPMs)通过从大量网络来源的文本-图像对中学习对齐的文本和图像特征,获得了语义丰富、多功能且可迁移的视觉特征,从而催生了新的无监督学习方法。带有“*”标记的方法基于医学图像,而带有“”标记的方法专门基于 H&E 图像。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容,请联系我们,一经查实,本站将立刻删除。

如需转载请保留出处:https://51itzy.com/kjqy/165722.html